Development of RT Component

Making an OpenCV RT-Component (Flip component)

Making an OpenCV RT-Component (Flip component)

This section describes creating an RT-Component to invert an image using the OpenCV library and VC9:- The cvFlip() function

- Component outline

- Operating and development environment

- Generate the Flip component template

- Implement the component activities

- Test the component

The cvFlip() function

The cvFlip() function flips a 2D array (i.e. an image) on the vertical axis, horizontal axis, or both axes at the same time.

void cvFlip(IplImage* src, IplImage* dst=NULL, int flip_mode=0); #define cvMirror cvFlip src Input array dst Output array. If dst is NULL, the result will be written into src. flip_mode Flag setting the axes to flip on. flip_mode = 0: Flip on the X axis (swap top and bottom) flip_mode > 0: Flip on the Y axis (swap left and right) flip_mode < 0: Flip on both axes

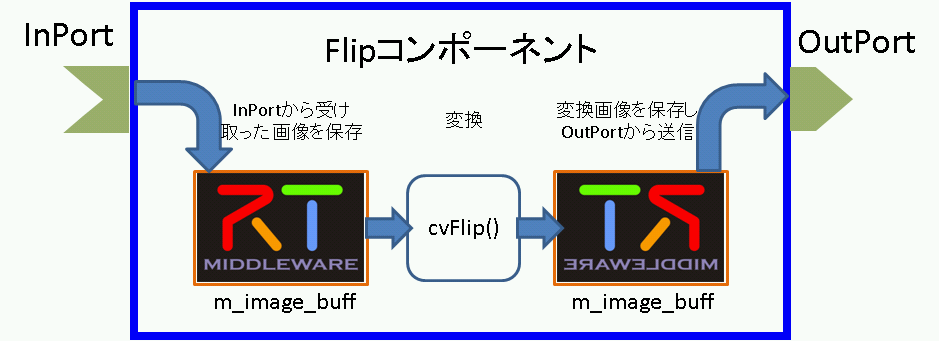

Component outline

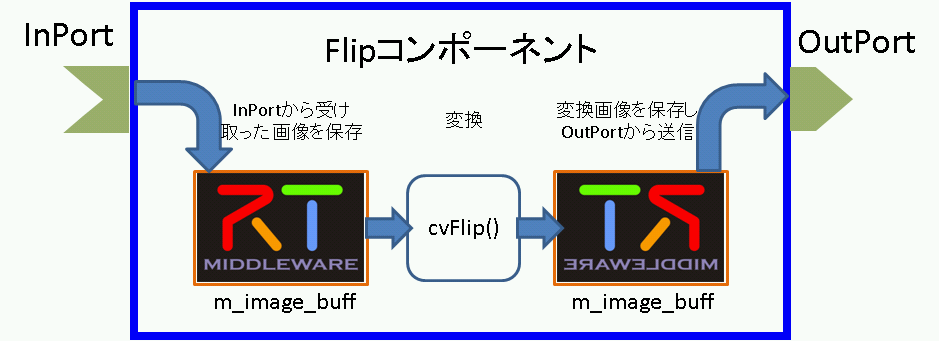

The component will flip an image received by an InPort and output it on an OutPort.

The flip mode will be controlled by an RTC configuration parameter called "flip_mode." Set flip_mode as below:

- Flip on the X axis: 0

- Flip on the Y axis: 1

- Flip on both axes: -1

The specification of the component we will create is as follows:

- InPort

- Captured image data (TimedOctetSeq)

- OutPort

- Flipped image data (TimedOctetSeq)

- Configuration

- Flip mode (int)

※ TimedOctetSeq is a data type specified in BasicDataType.idl from OpenRTM-aist.

※ octet is a CORBA IDL base type that can store and transmit any data in 8-bit format without transformation.

struct Time

{

unsigned long sec; // sec

unsigned long nsec; // nano sec

};

struct TimedOctetSeq

{

Time tm;

sequence<octet> data;

};

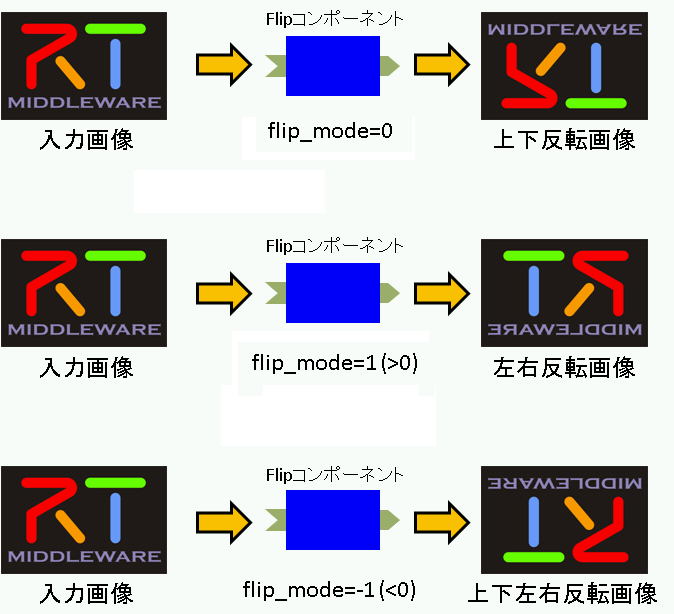

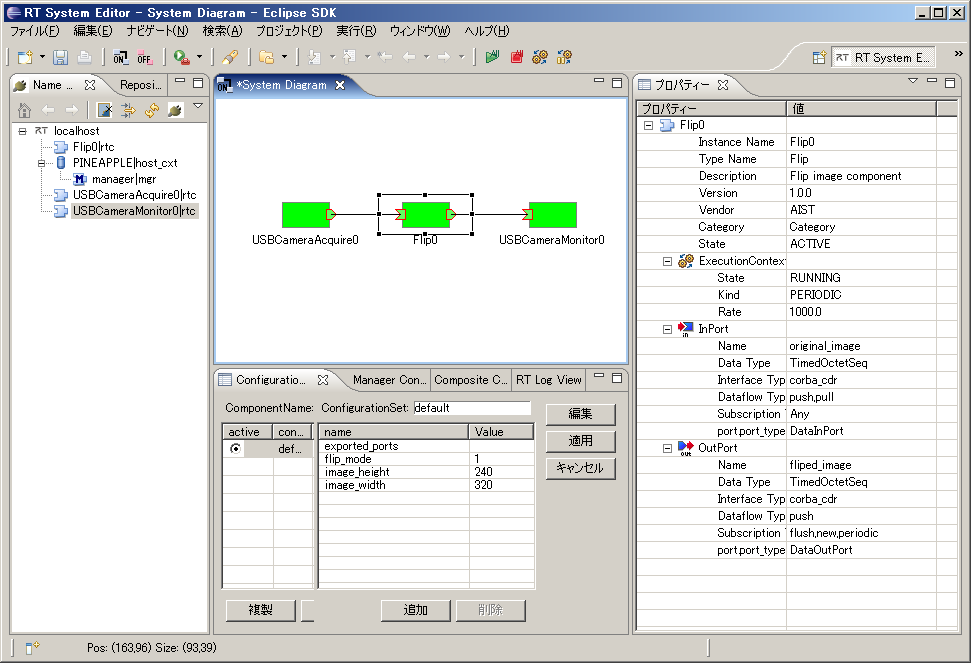

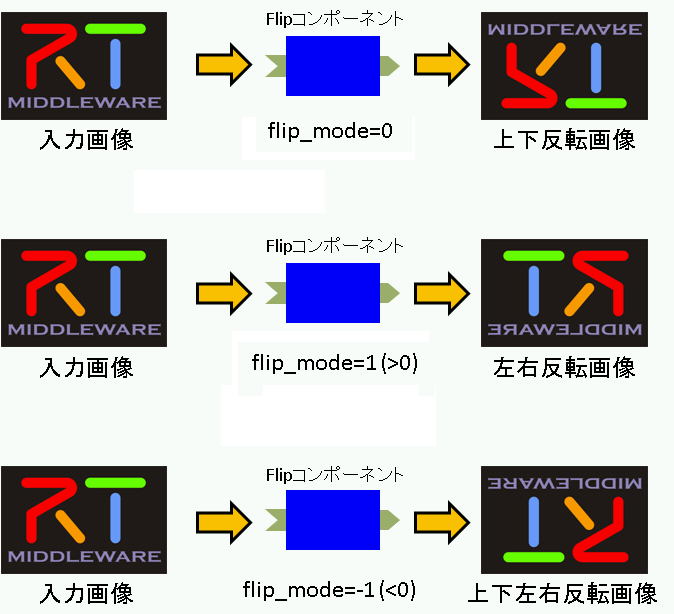

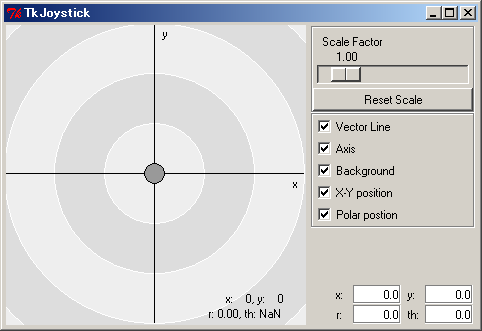

Figure 1 illustrates the effects of different flip_mode settings.

Operating environment and development environment

- OS: Windows XP SP2

- Compiler: Visual C++ 2008 Express Edition

- omniORB: version 4.1.2

- OpenCV: version 1.0

- OpenRTM-aist: version 1.0.0-RC1

- RTSystemEditor 1.0

- RTCBuilder 1.0

- Decompression tool (e.g. Lhaplus)

Generate the Flip component template

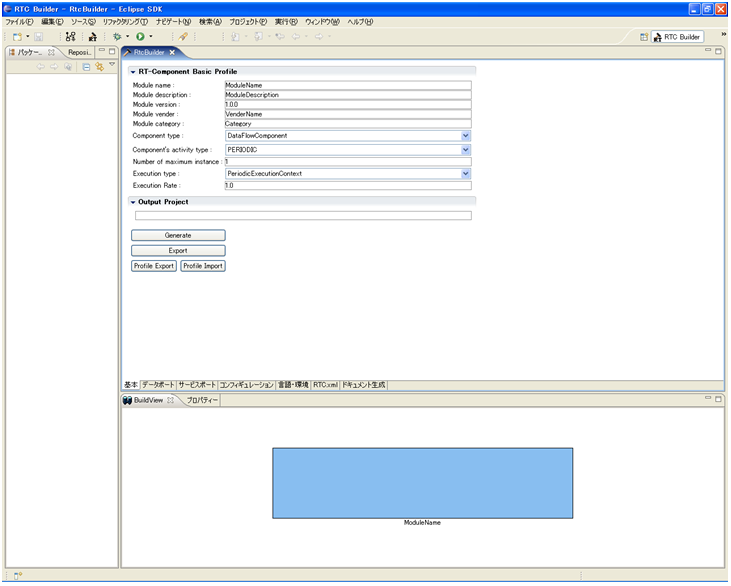

We will generate the Flip component template using RTCBuilder.

Starting RTCBuilder

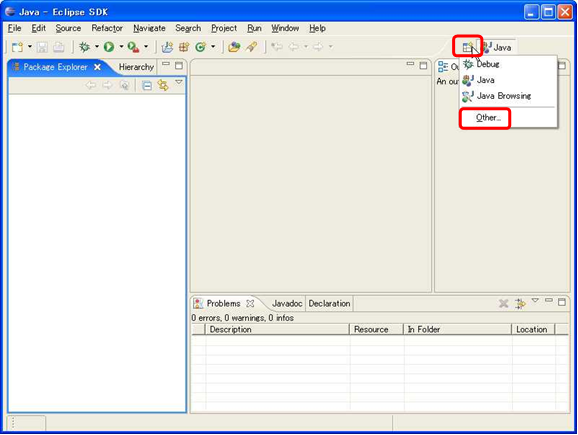

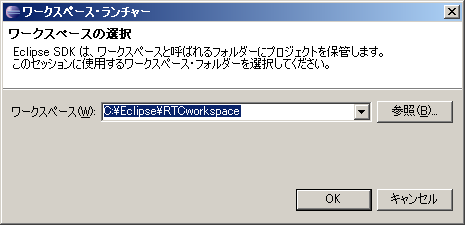

Upon starting Eclipse with a new workspace, the Welcome page will be displayed.

Close this Welcome screen using the close button to display the default perspective view.

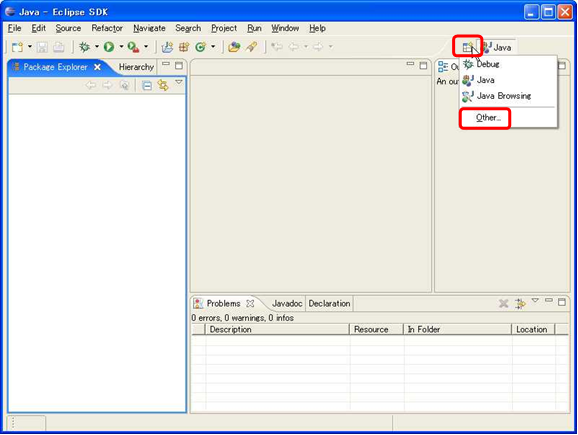

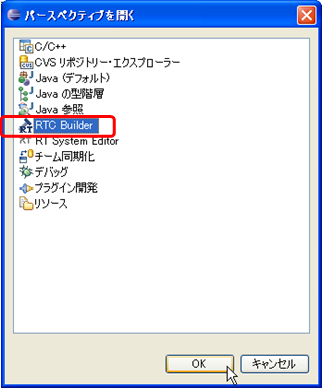

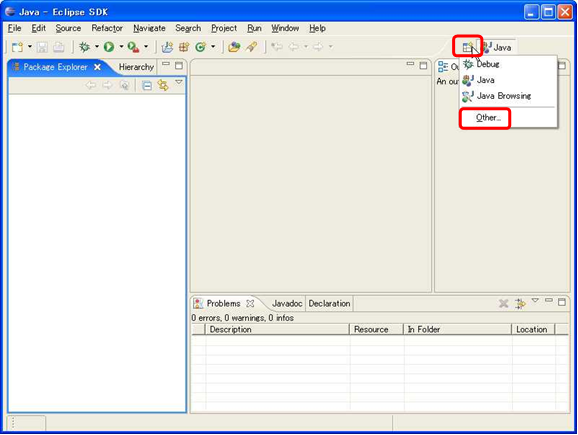

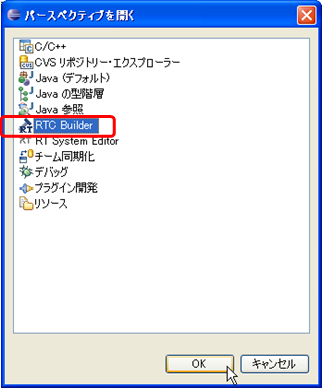

Click the "Open Perspective" button in the top right and select "Other..." from the menu.

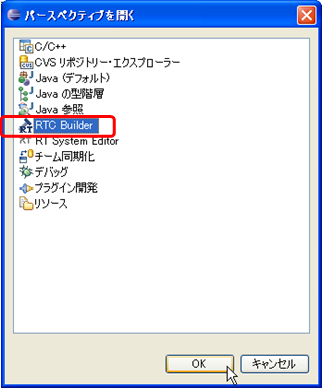

Select "RTC Builder".

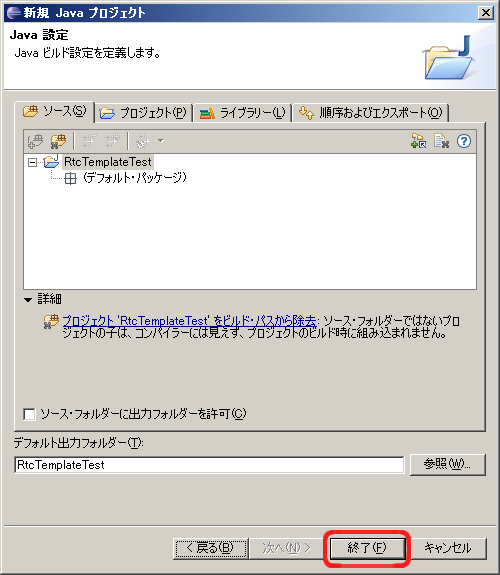

Making an RTCBuilder project

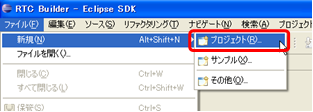

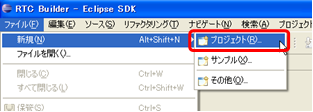

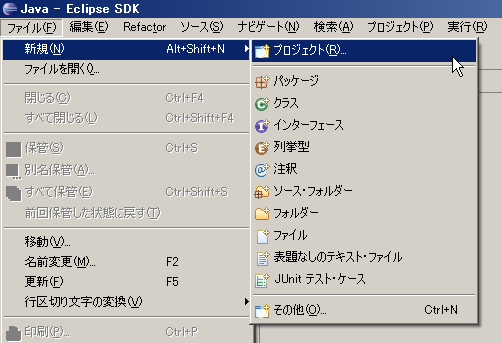

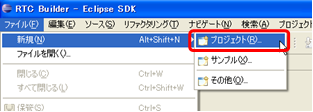

First, we will make an Eclipse project for the RT-Component. From the File menu, select "New," then "Project."

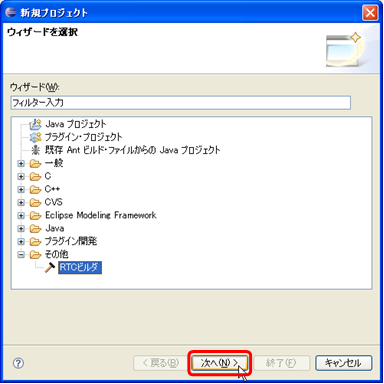

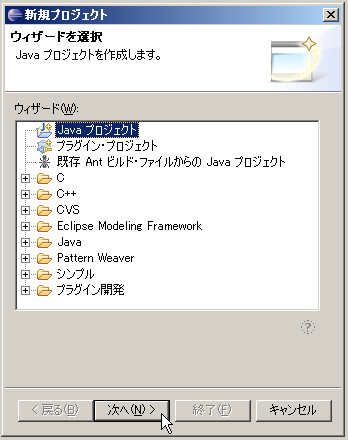

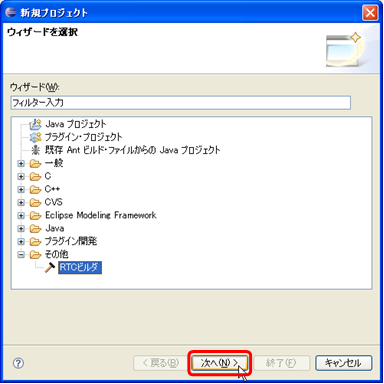

In the displayed dialog, select "Other," then "RTCBuilder" (RTC ビルダ) and click "Next".

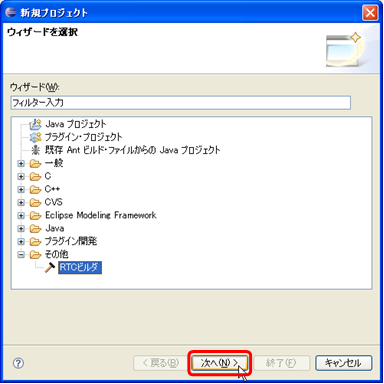

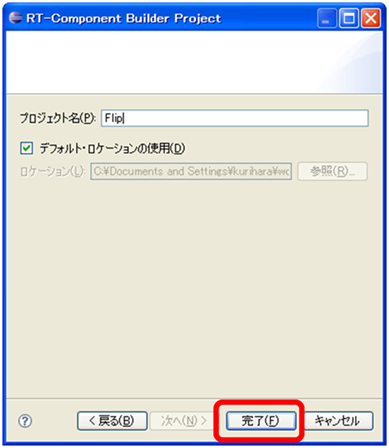

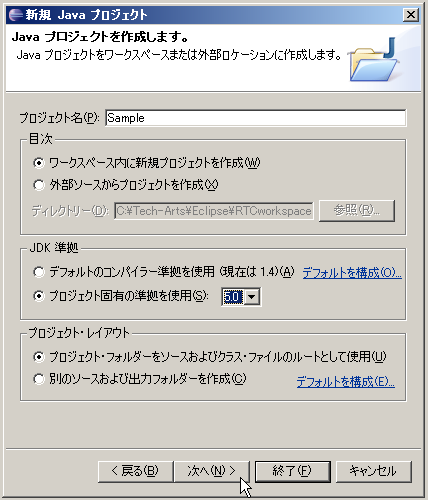

Enter a project name and click "Finish."

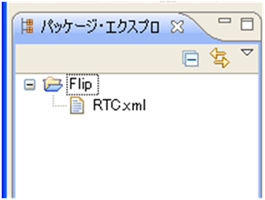

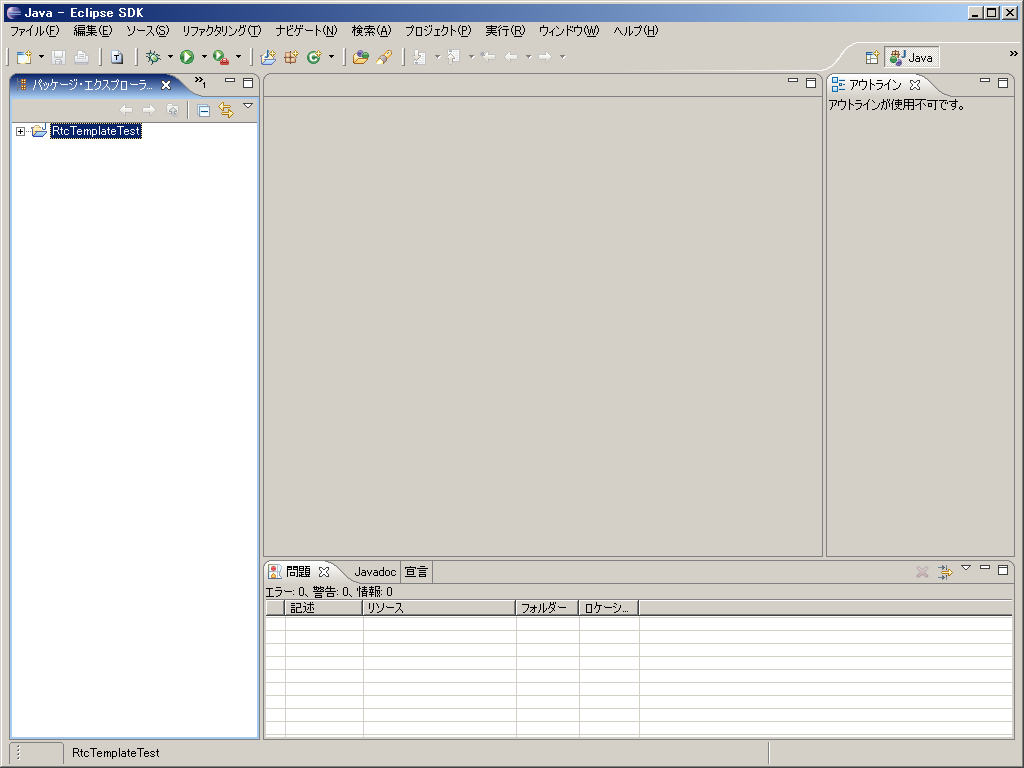

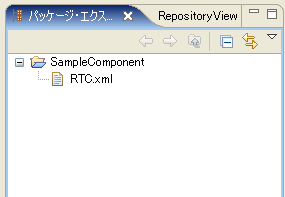

A project using the given name will be created and displayed in the package explorer.

Within the generated project will be an RTC profile XML (RTC.xml) containing default values.

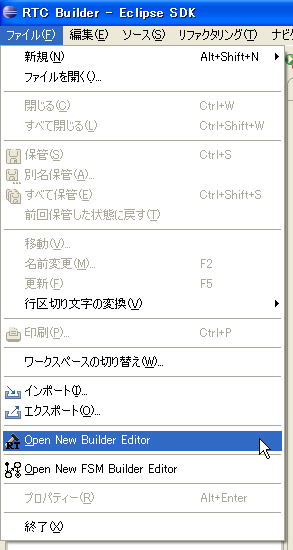

Starting the RTC Profile Editor

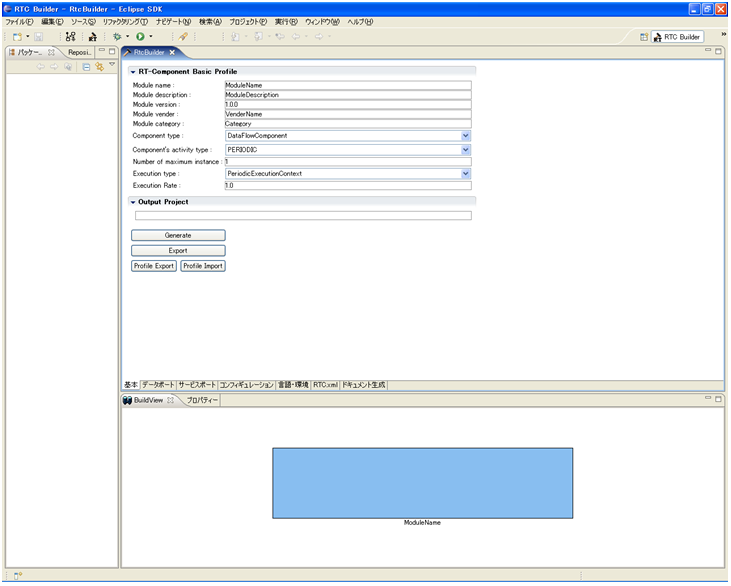

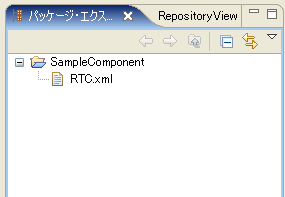

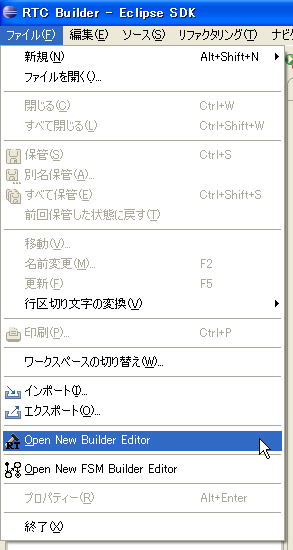

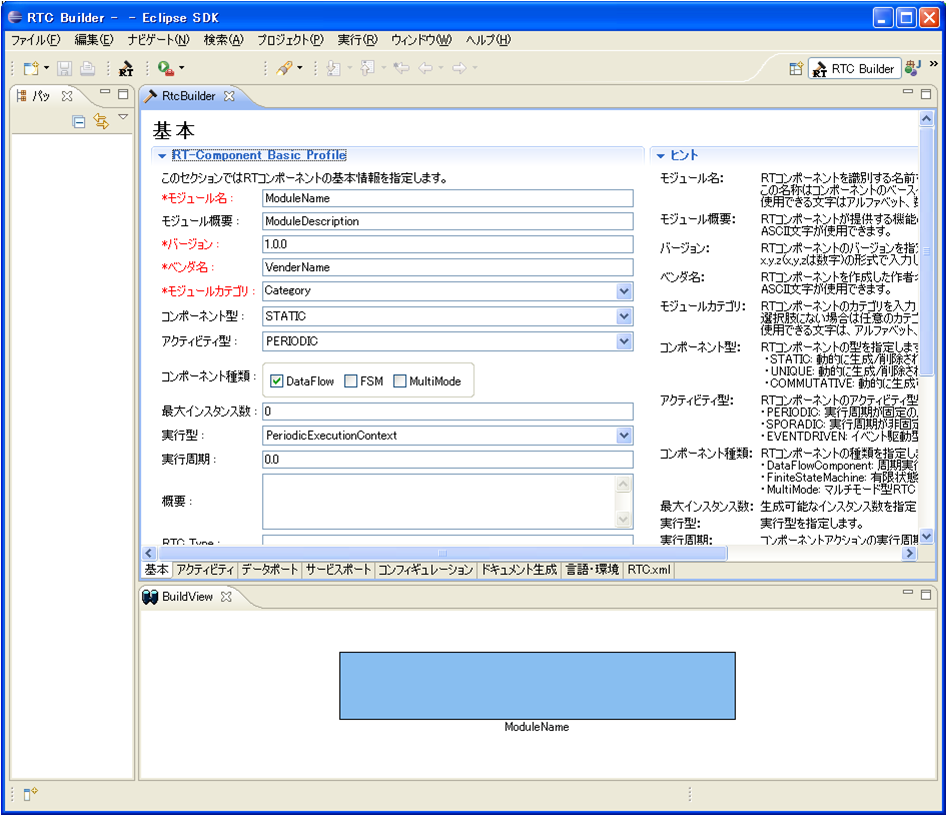

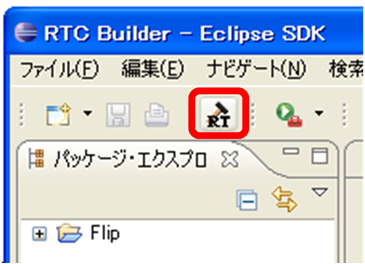

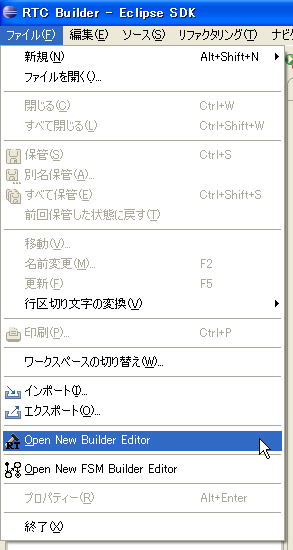

To open the RTC Profile Editor, click the "Open New RtcBuilder Editor" button on the toolbar, or select "Open New Builder Editor" from the File menu.

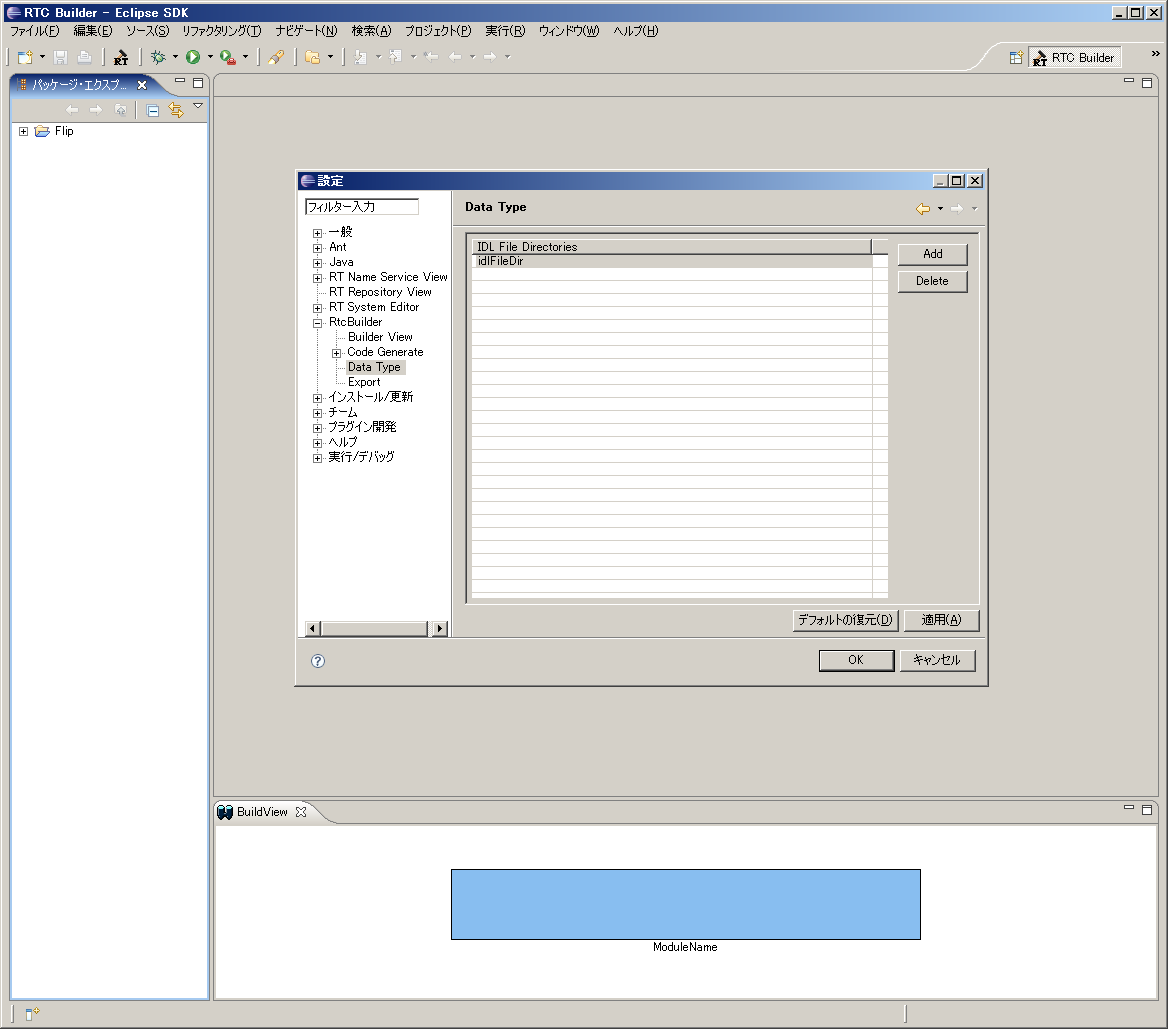

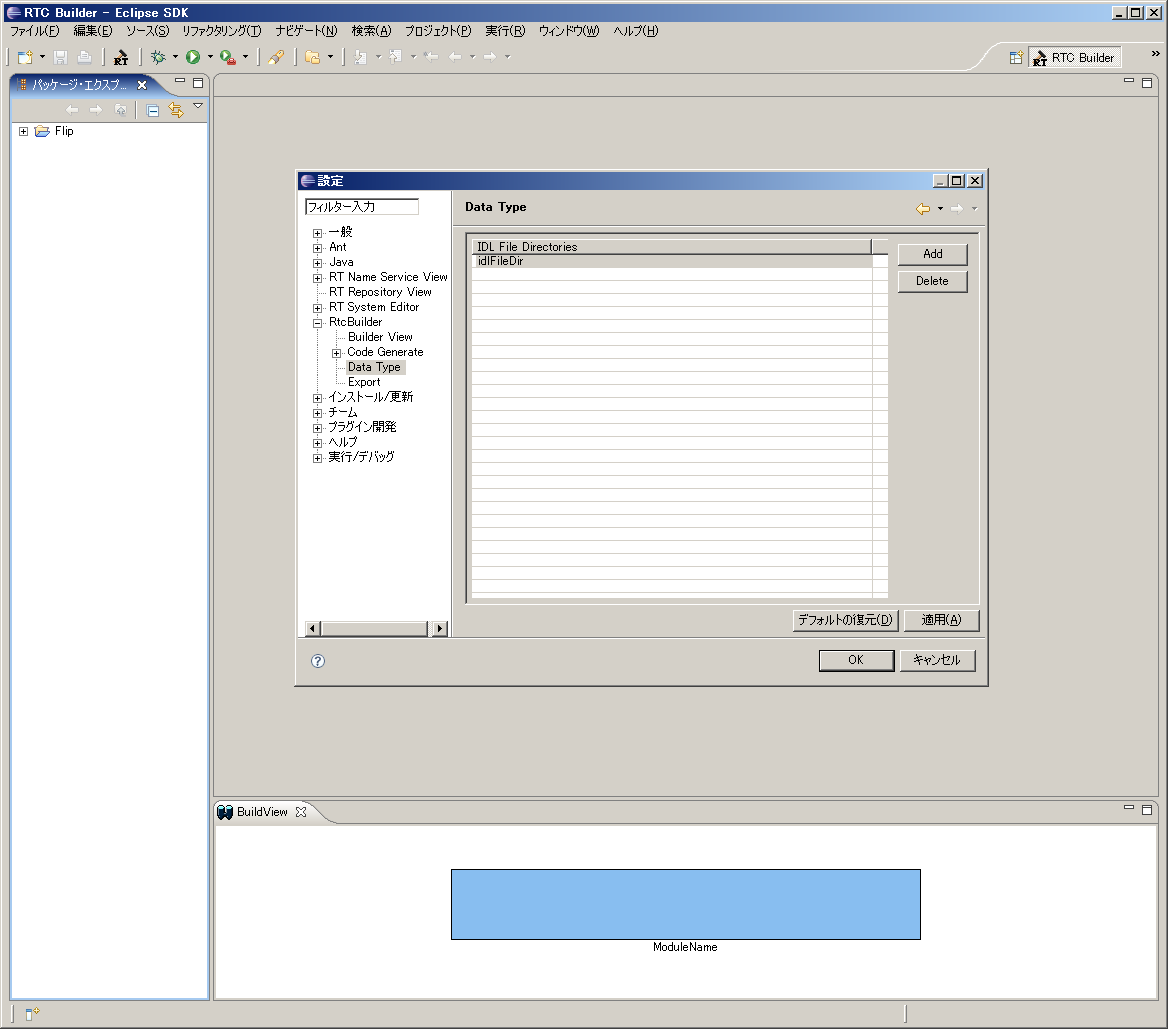

Data type definition files location

It is necessary to set the location of the IDL files that define data types used by data ports and service ports.

※ This value is valid for the entire workspace, so it does not need to be set for each project created within the same workspace.

1. Open the settings dialog by selecting "Settings" from the "Window" menu.

2. Expand the "RtcBuilder" branch and select "Data Type."

3. Click the "Add" button and enter values for "IDL File Directories." IDL files included with OpenRTM-aist are installed to this path by default:

C:\Program Files\OpenRTM-aist\1.0\rtm\idl

4. Click the "OK" button to finish.

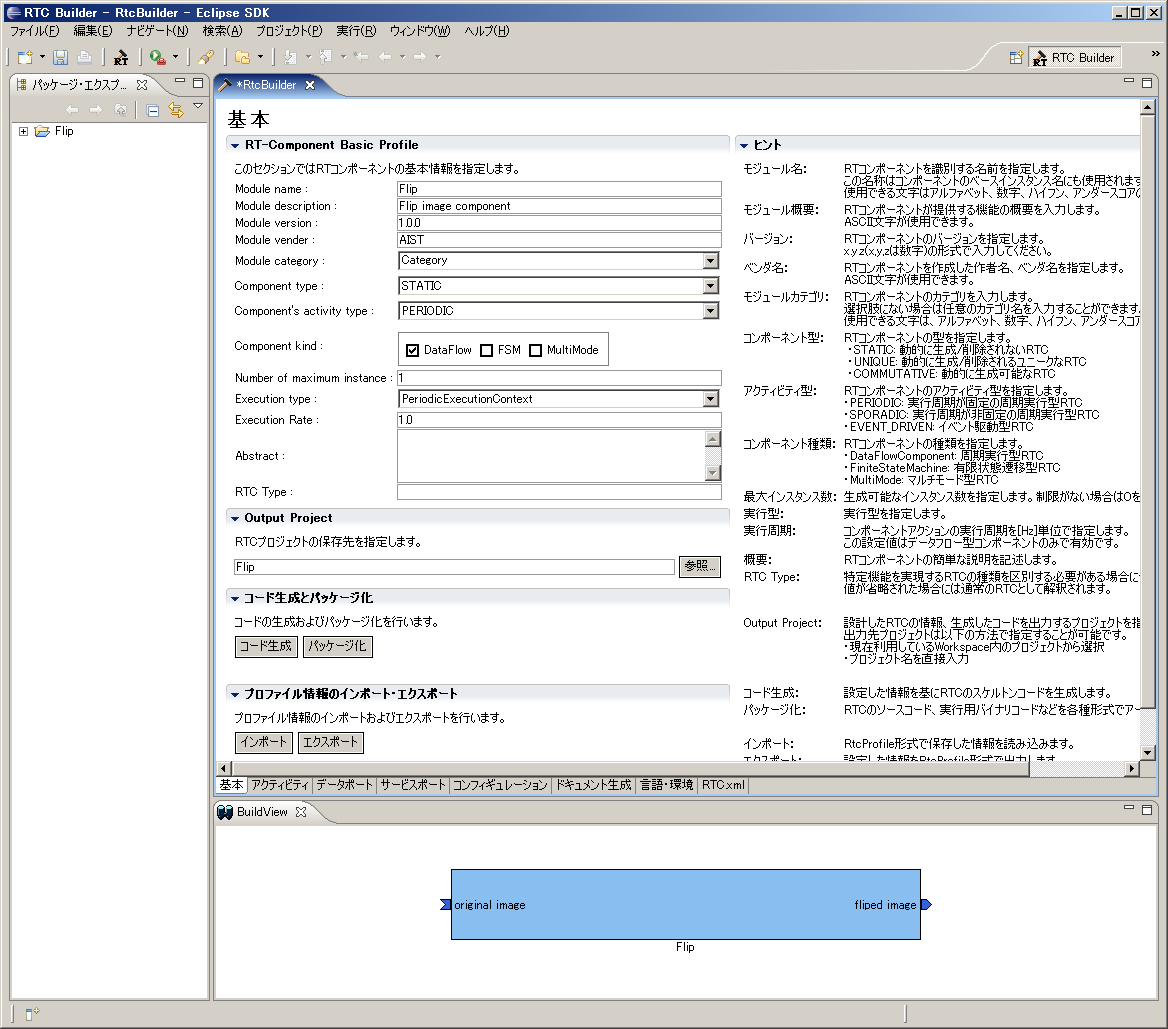

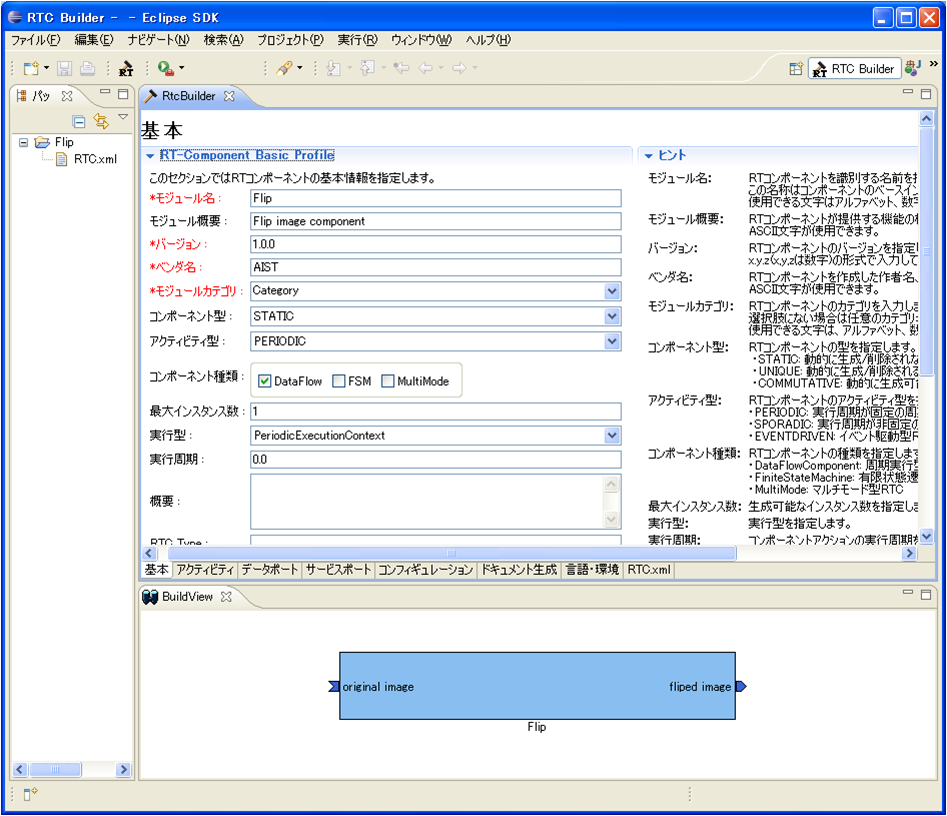

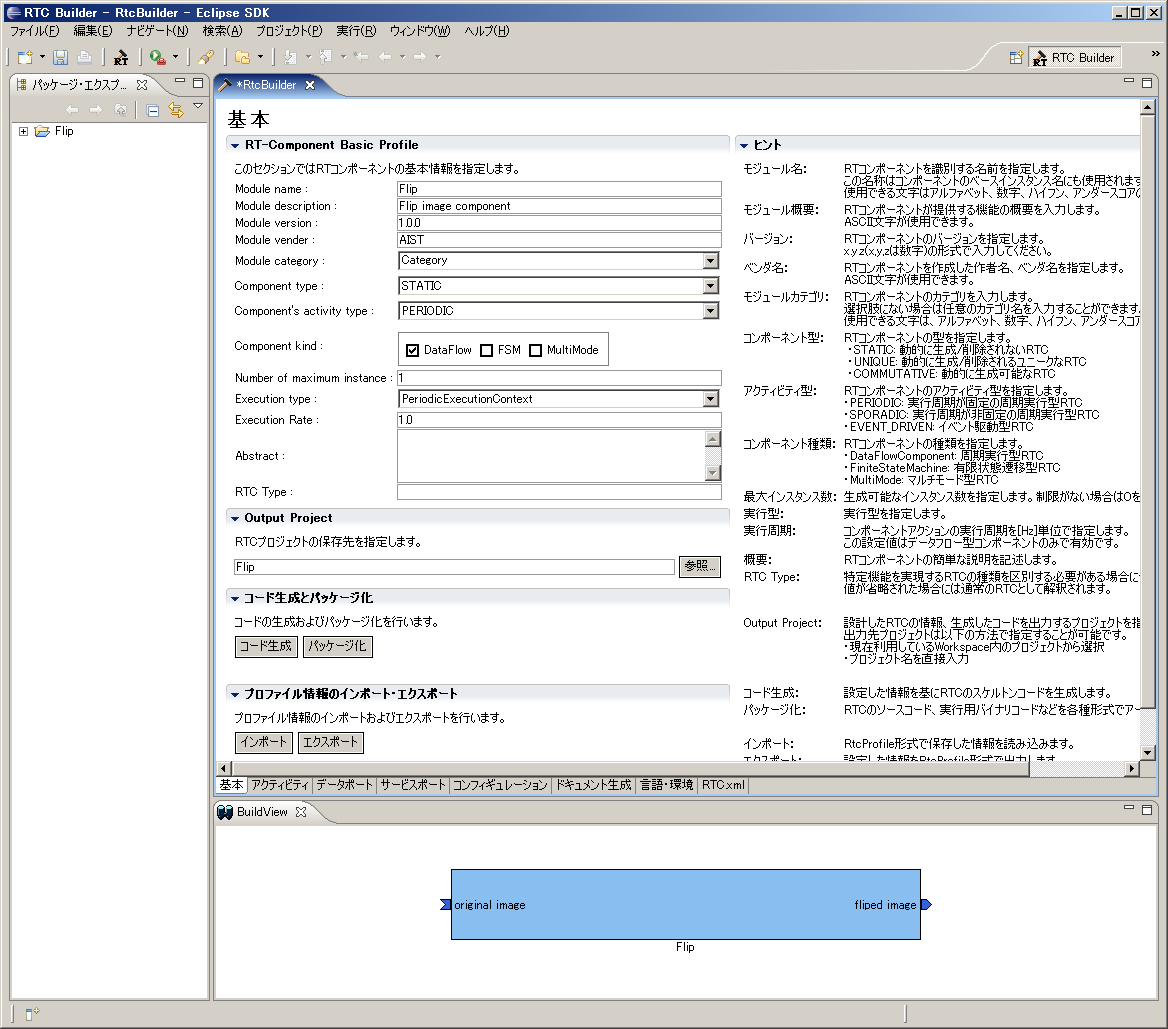

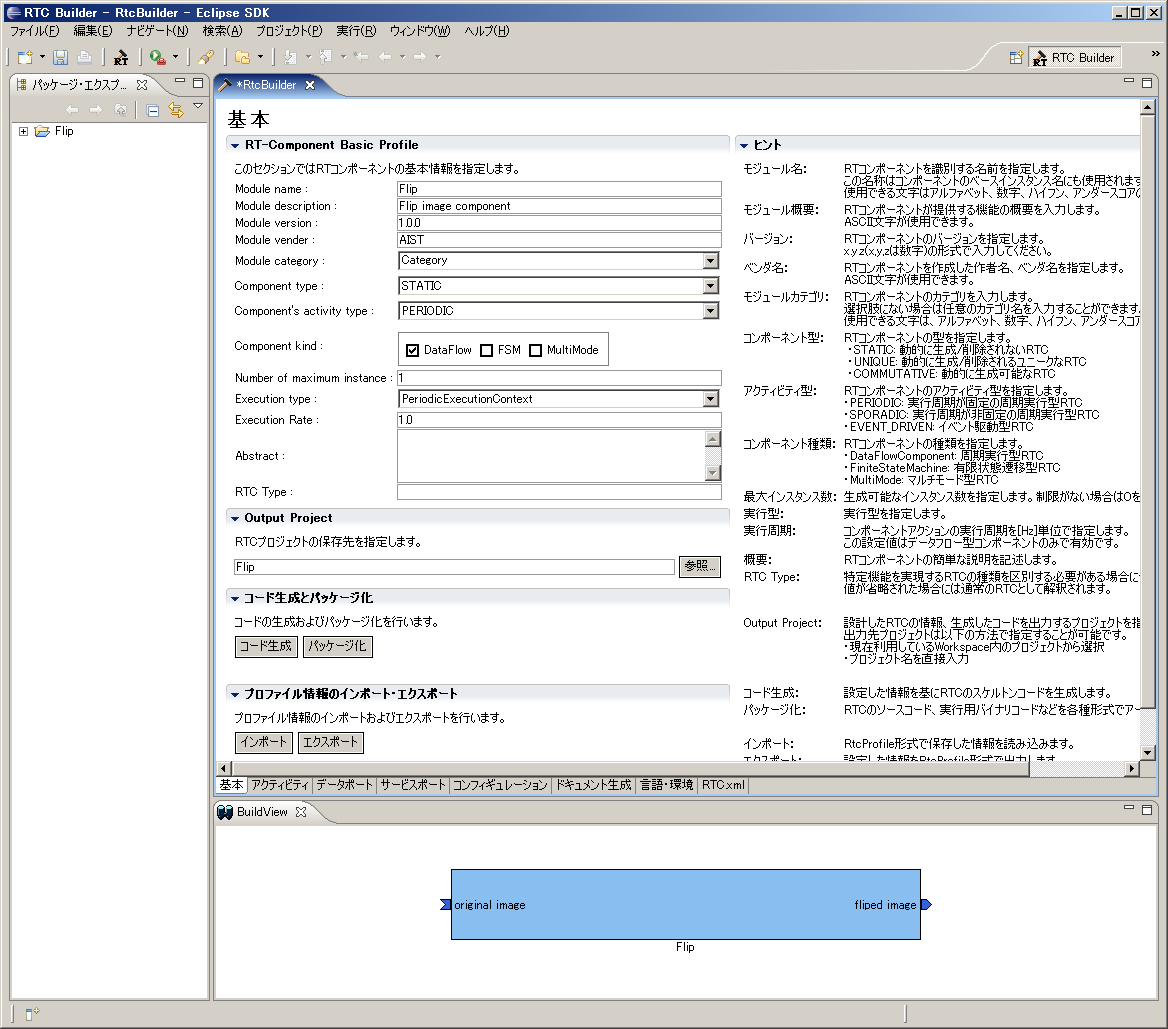

Entering the component profile and generating code

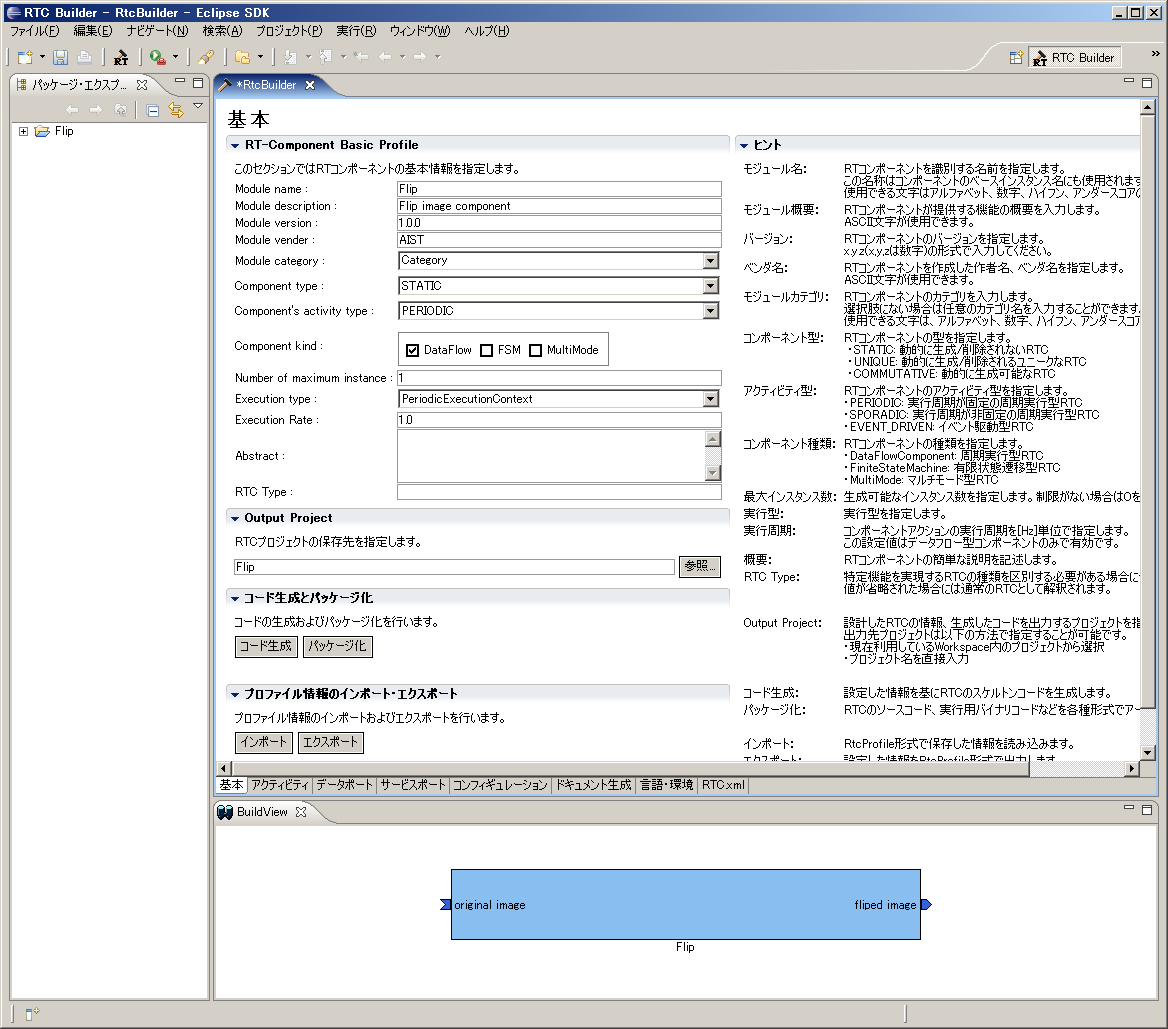

1. Select the "Basic" (基本) tab, and enter the basic component information as below.

-Module name: Flip

- Module description: Flip image component

- Module version: 1.0.0

- Module vender: AIST

- Module category: Category

- Component type: STATIC

- Component's activity type: PERIODIC

- Component kind: DataFlowComponent

- Number of maximum instance: 1

- Execution type: PeriodicExecutionContext

- Execution Rate: 1.0

-Output Project: Flip

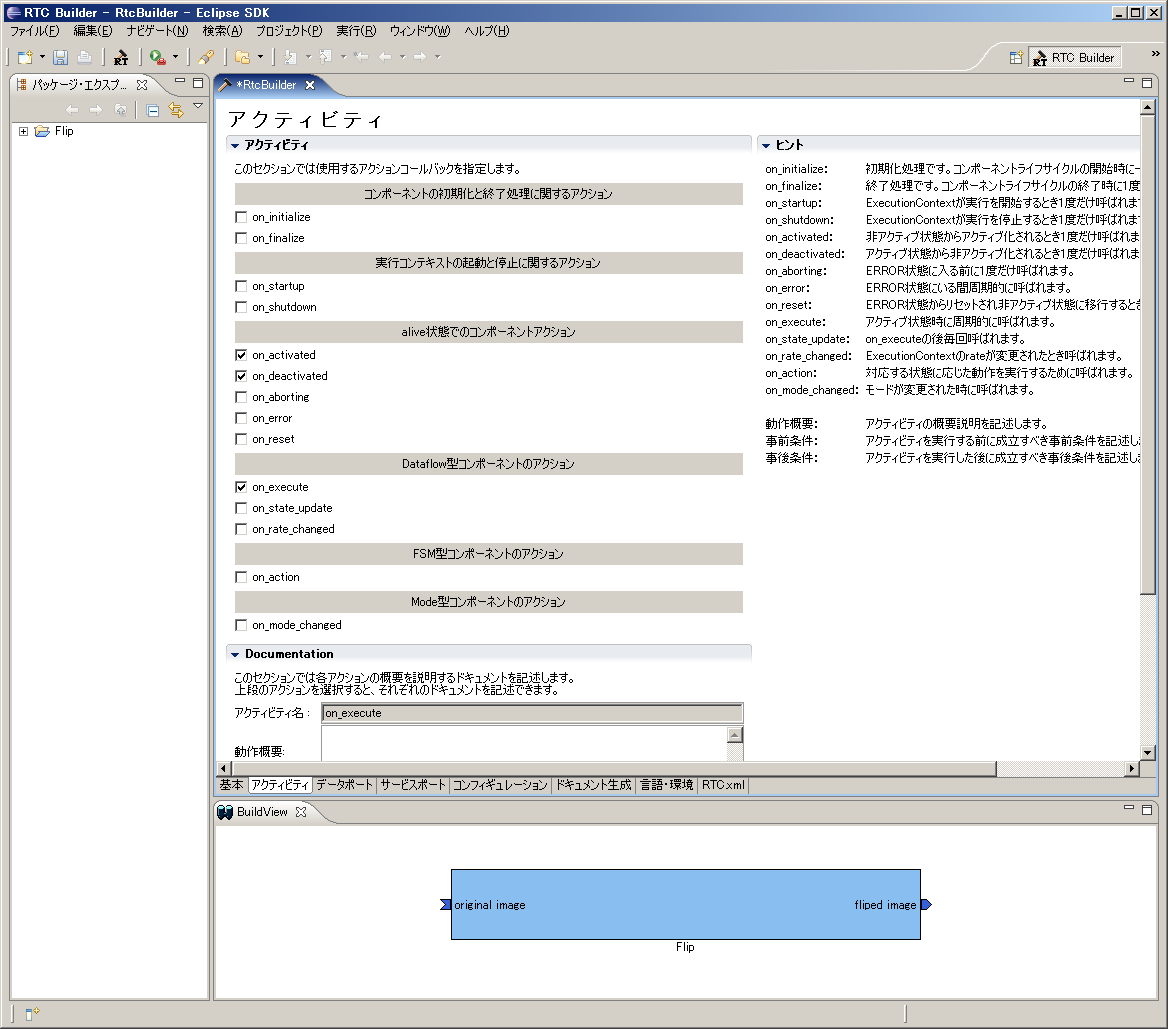

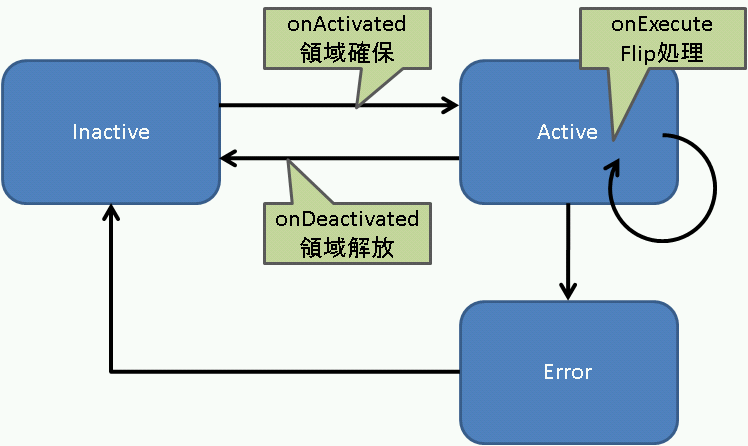

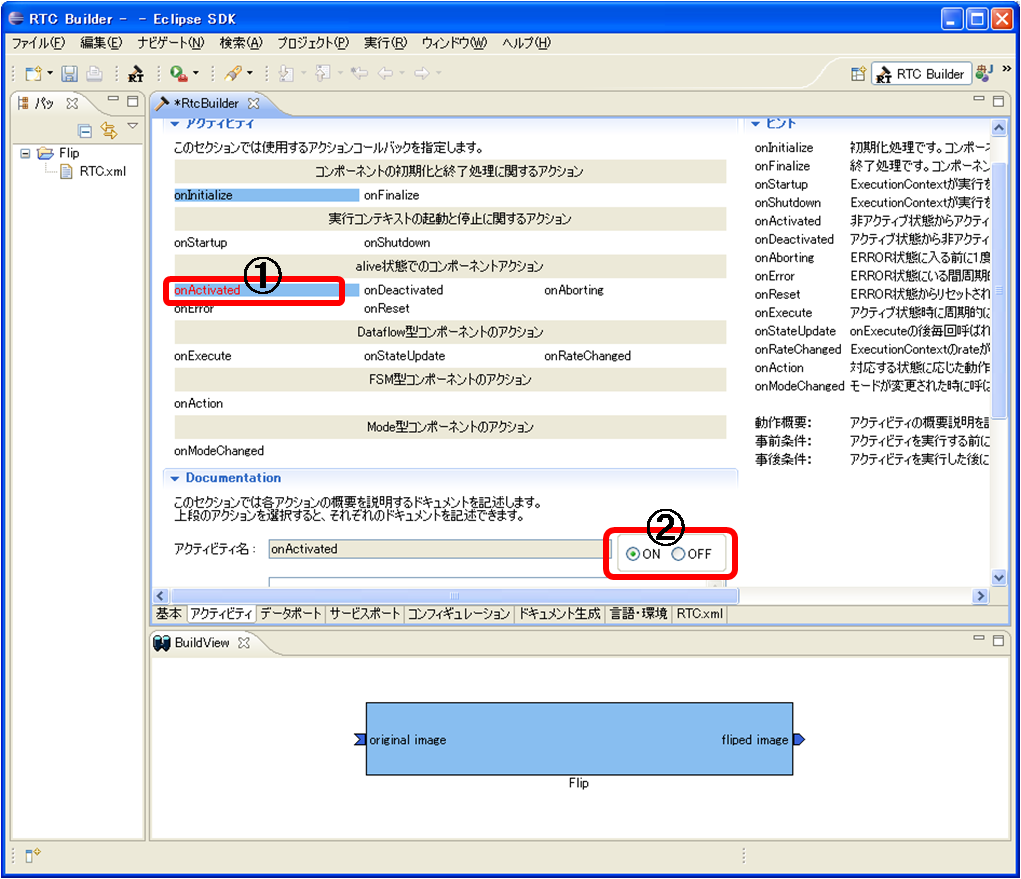

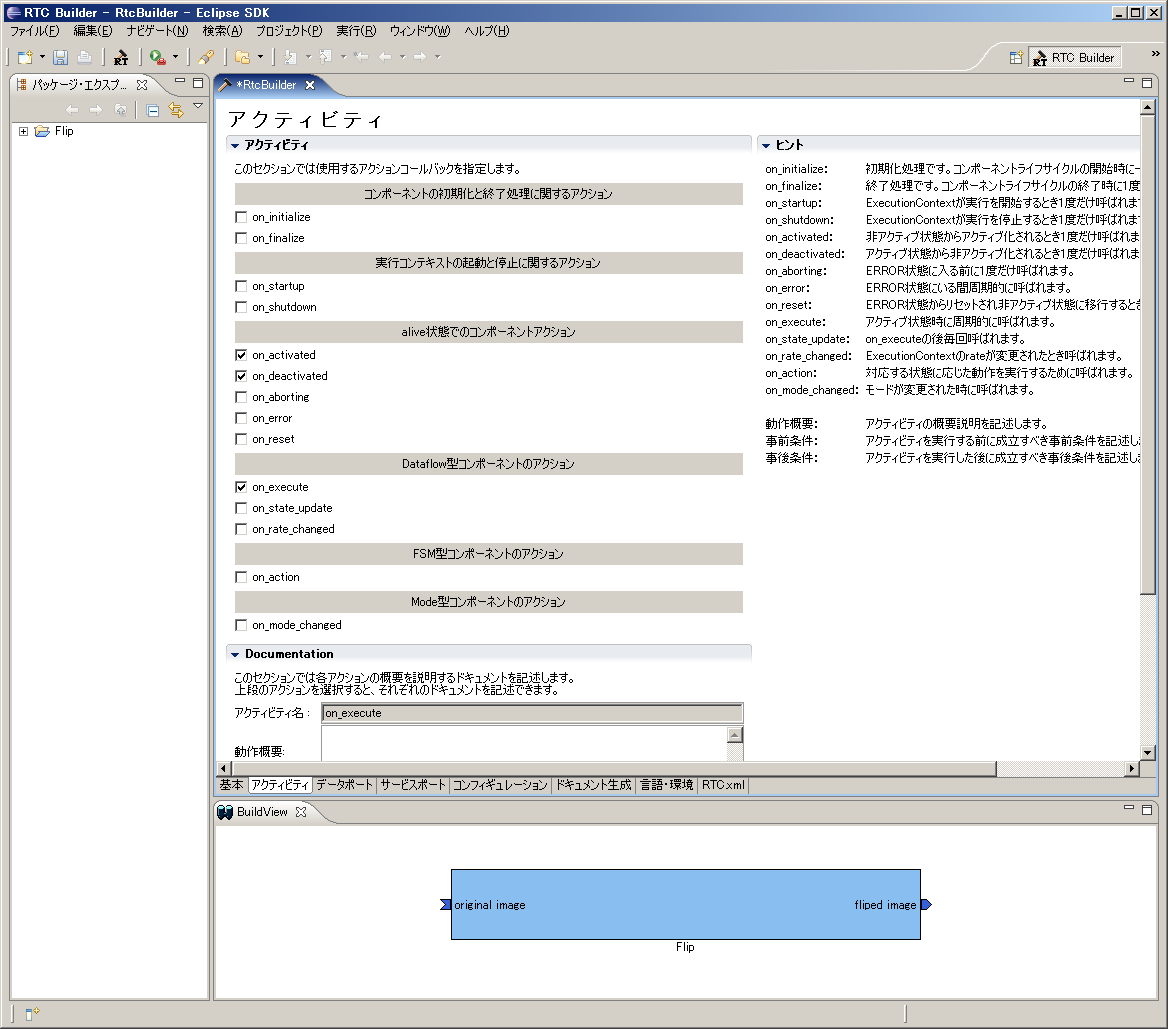

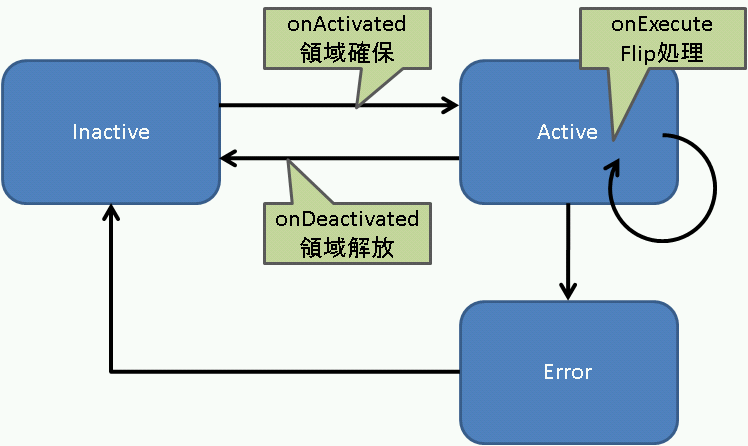

2. Select the "Activity" (アクティビティ) tab and select the action callbacks that will be used.

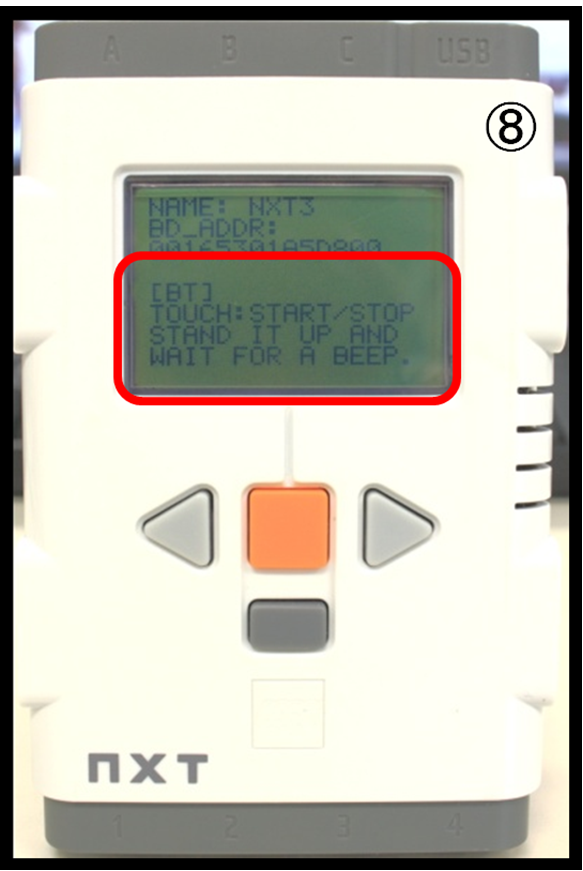

For the Flip component, the onActivated(), onDeactivated() and onExecute() callbacks will be used. Check them as in Figure 14.

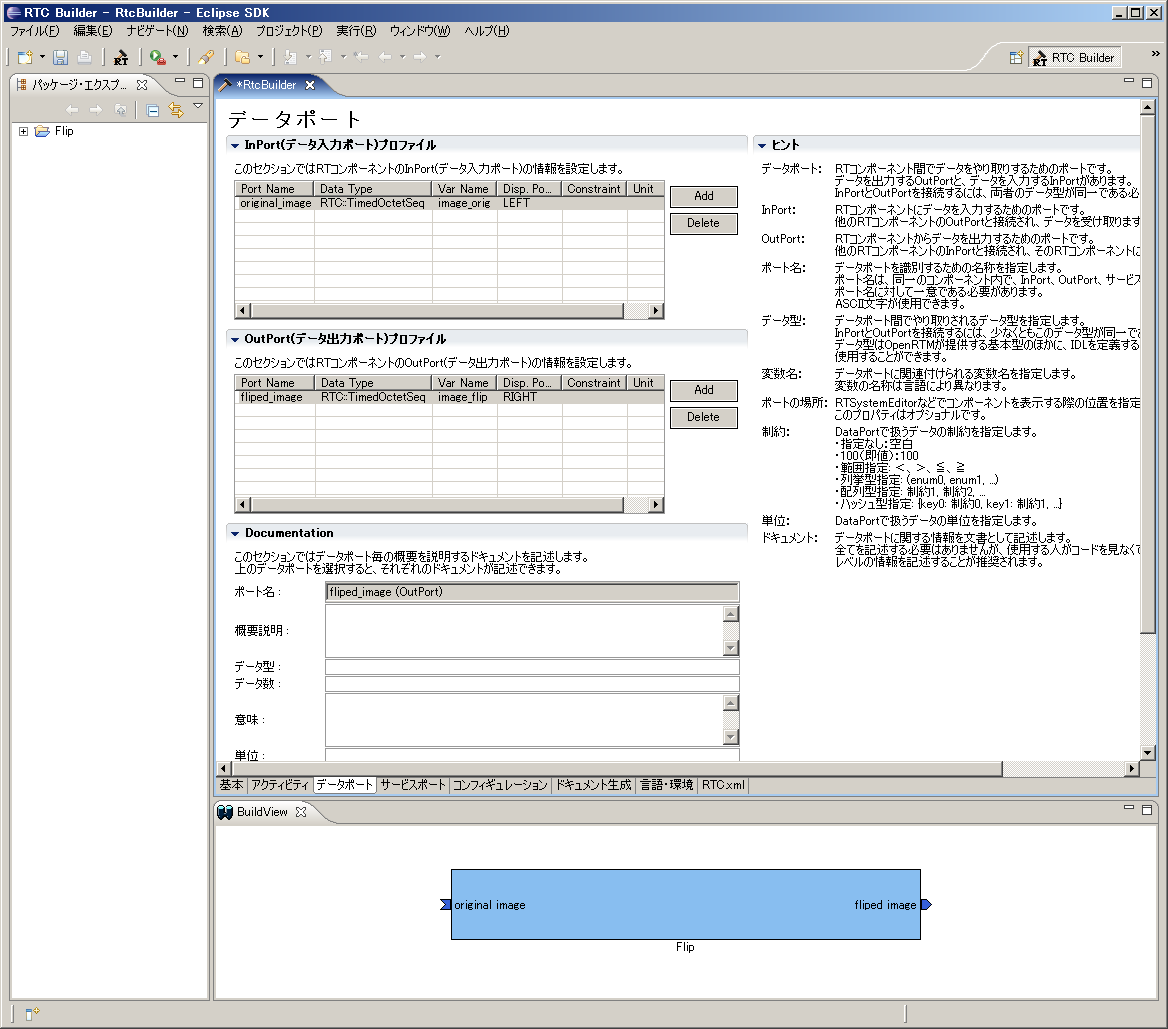

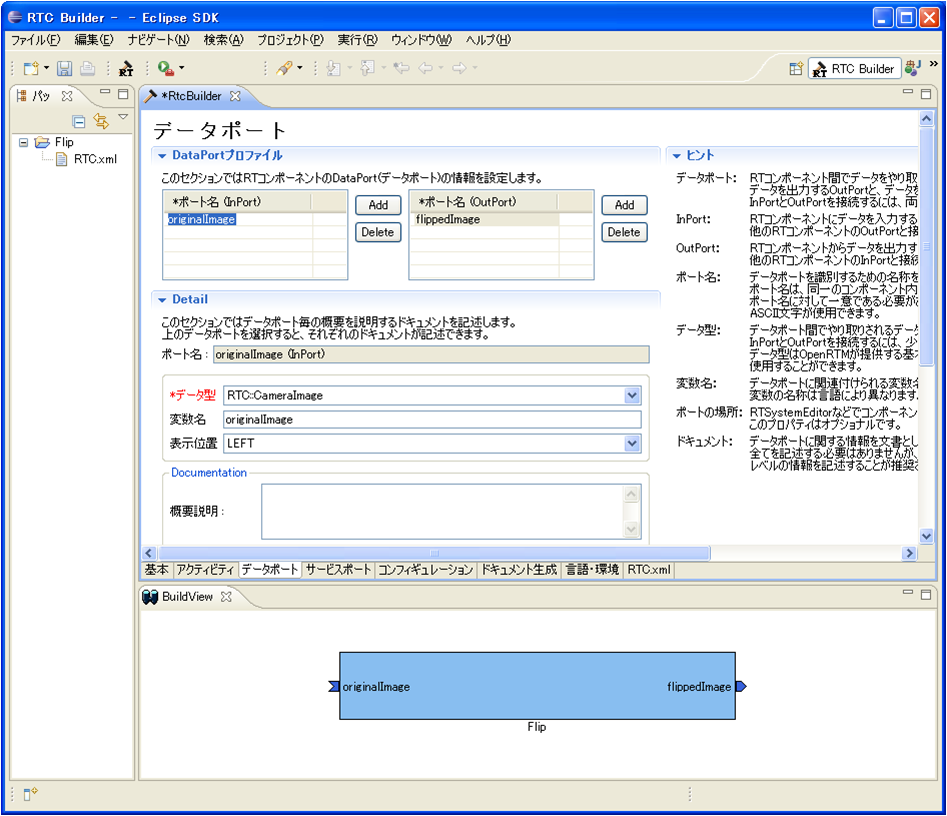

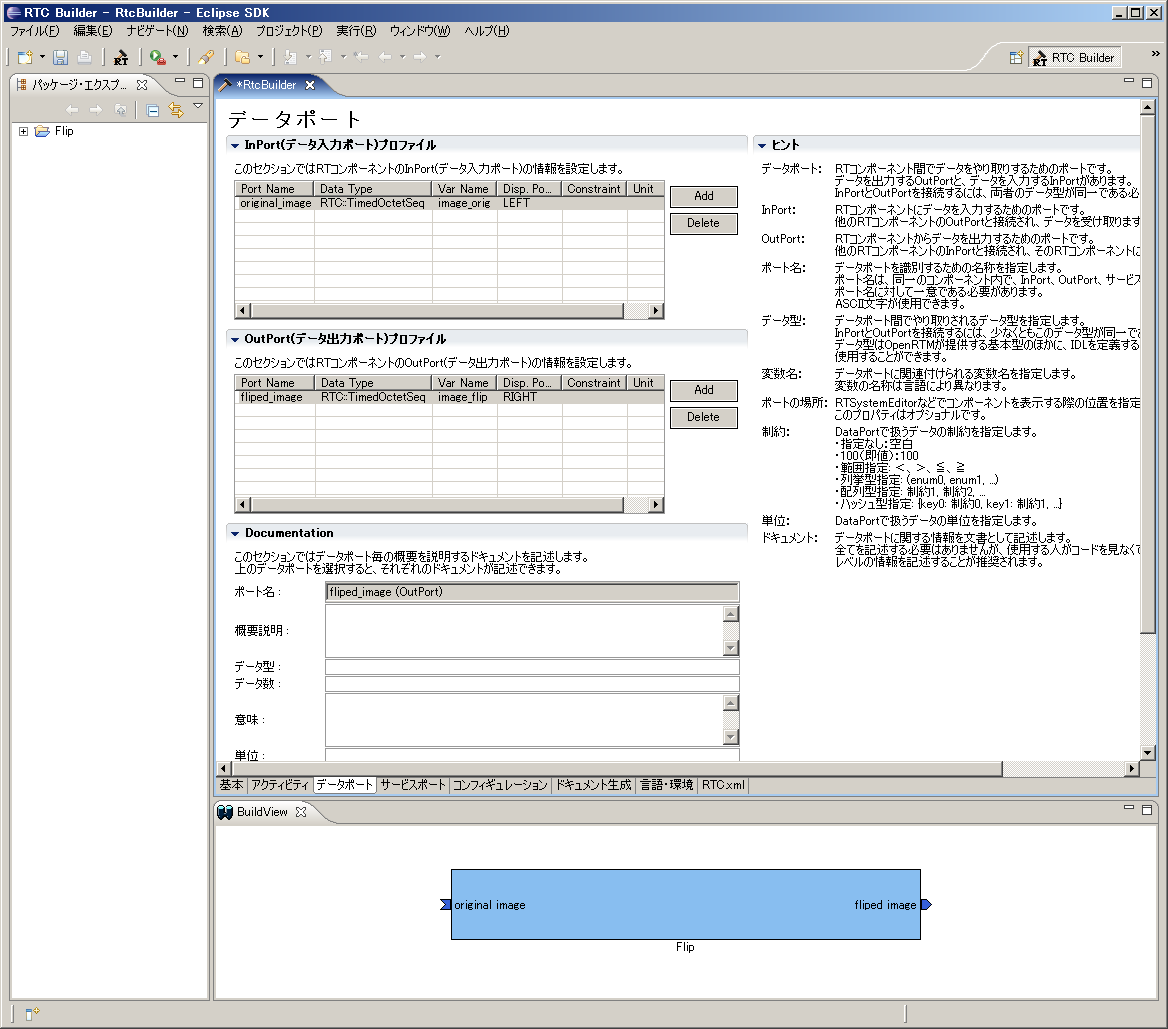

3. Select the ""Data port" (データポート) tab and enter the data port information.

-InPort Profile:

- Port Name: original_image

- Data Type: TimedOctetSeq

- Var Name: image_orig

- Disp. Position: left

-OutPort Profile: - Port Name: fliped_image

- Data Type: TimedOctetSeq

- Var Name: image_flip

- Disp. Position: right

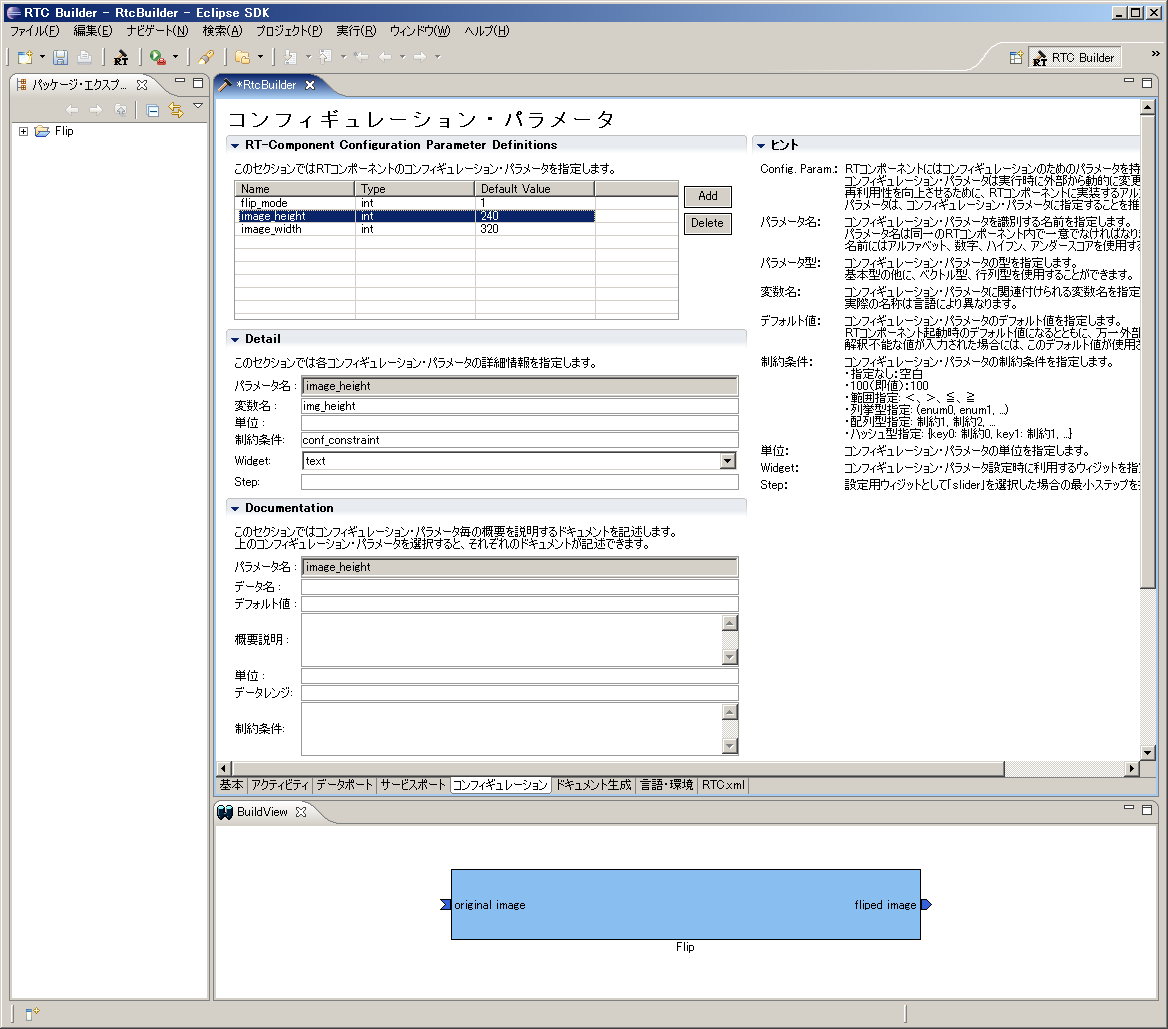

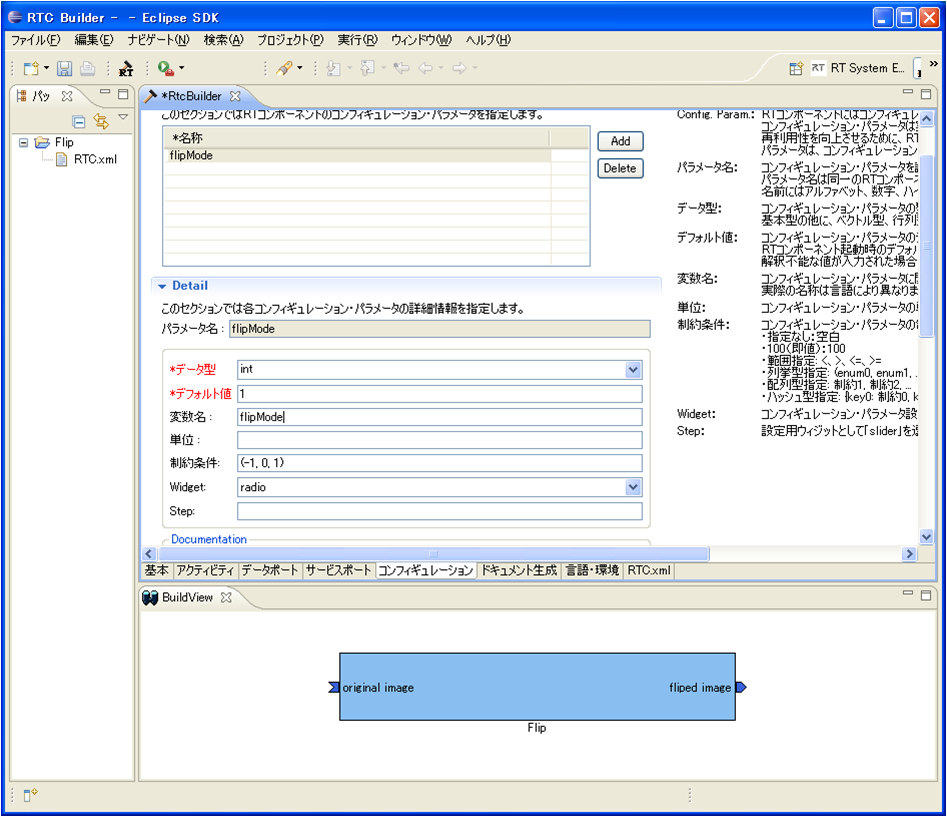

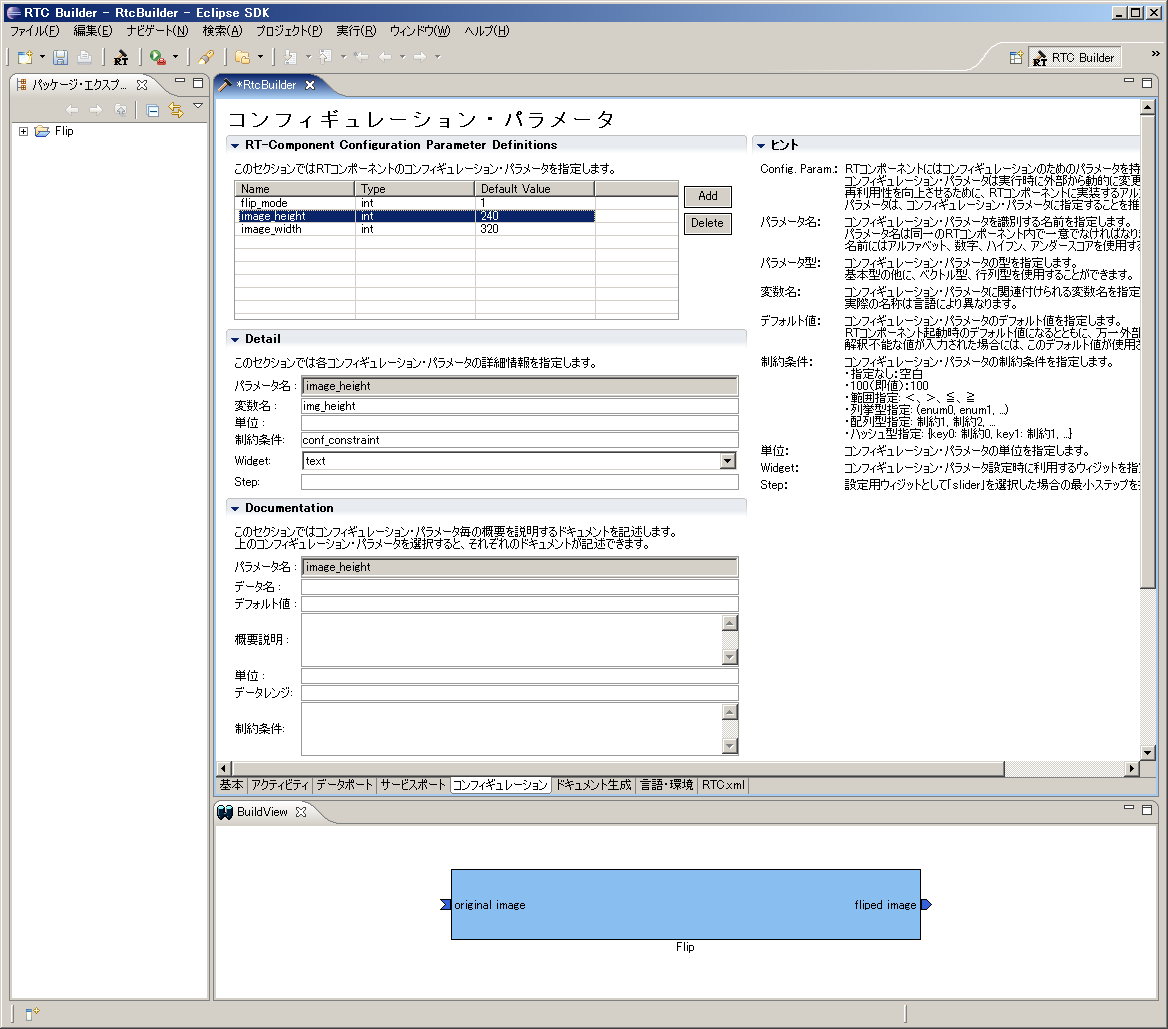

4. Select the "Configuration" (コンフィギュレーション) tab and enter the configuration parameters.

-flip_mode

- Name: flip_mode

- TYpe: int

- Default Value: 1

- Variable name: flip_mode

-image_height

- Name: image_height

- TYpe: int

- Default Value: 240

- Variable name: img_height

-image_width

- Name: image_width

- TYpe: int

- Default Value: 320

- Variable name: img_width

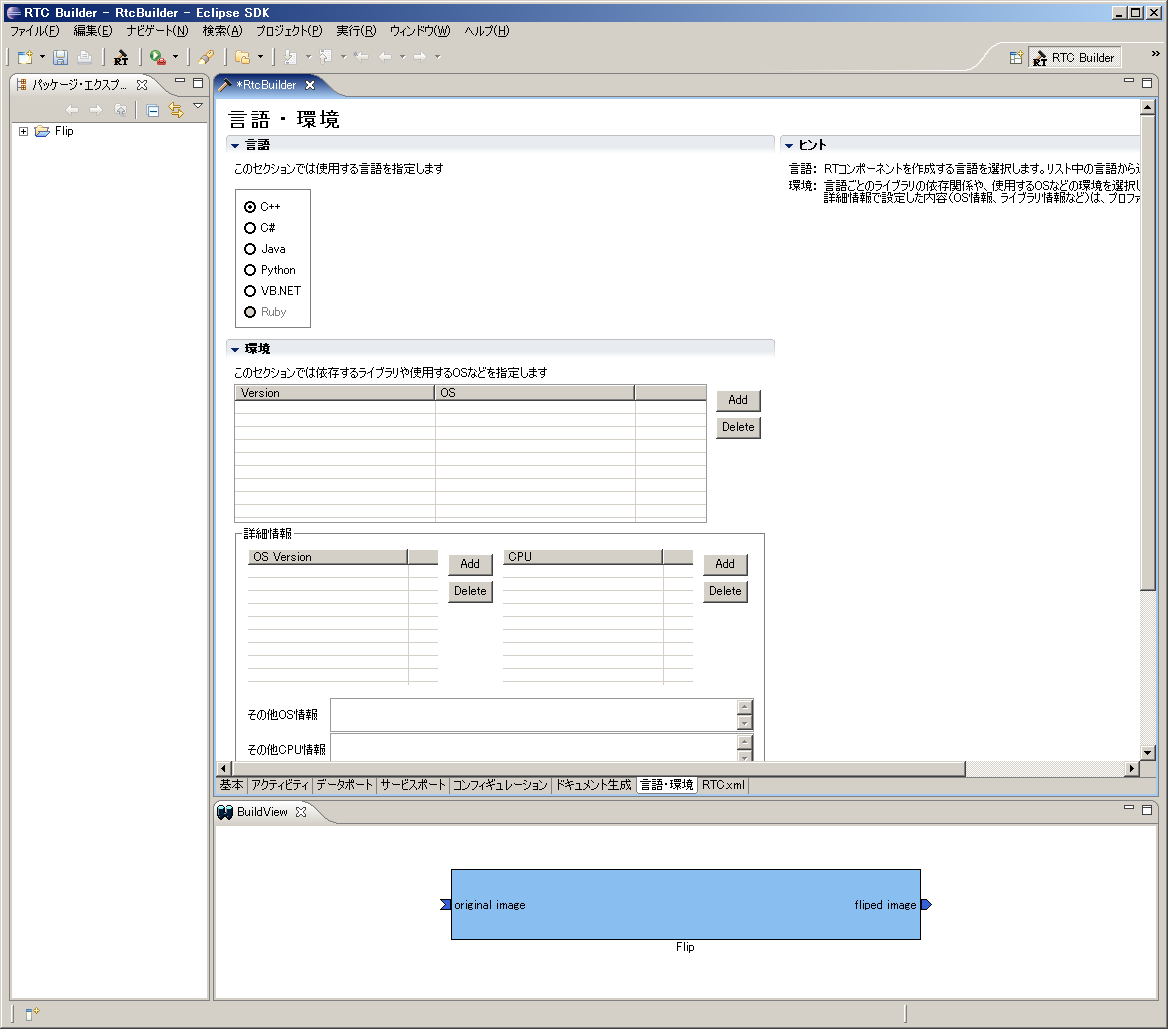

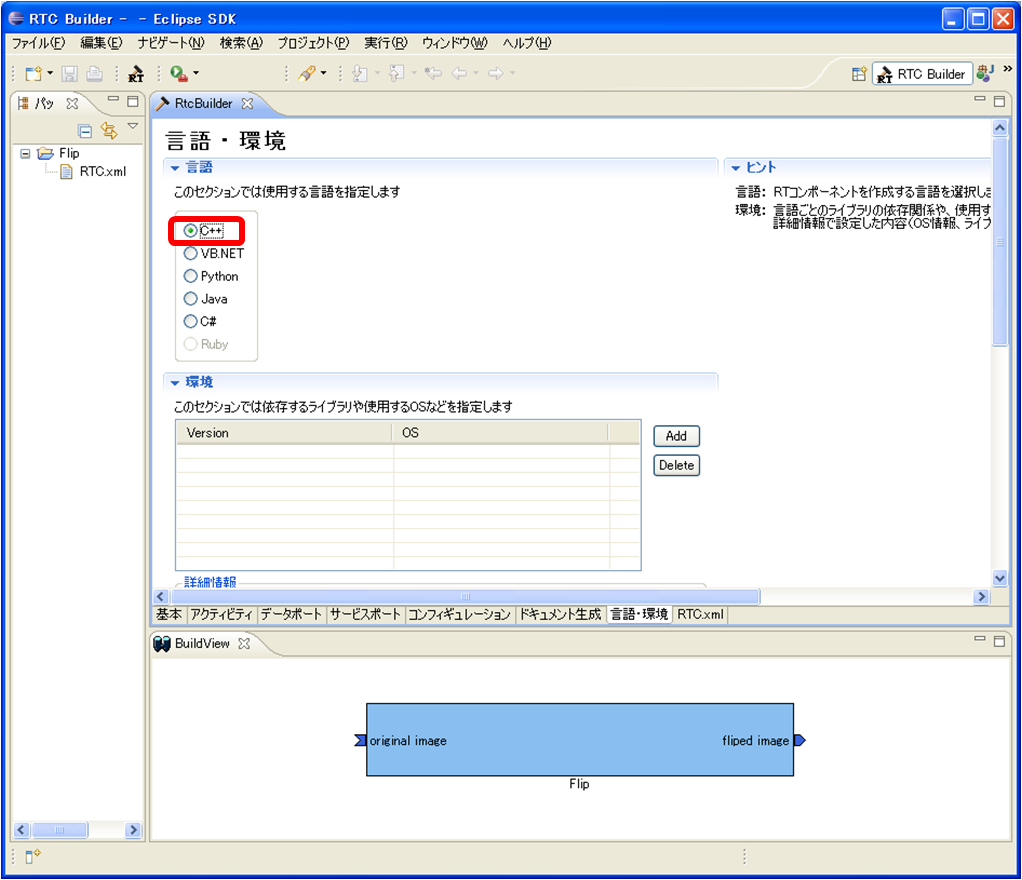

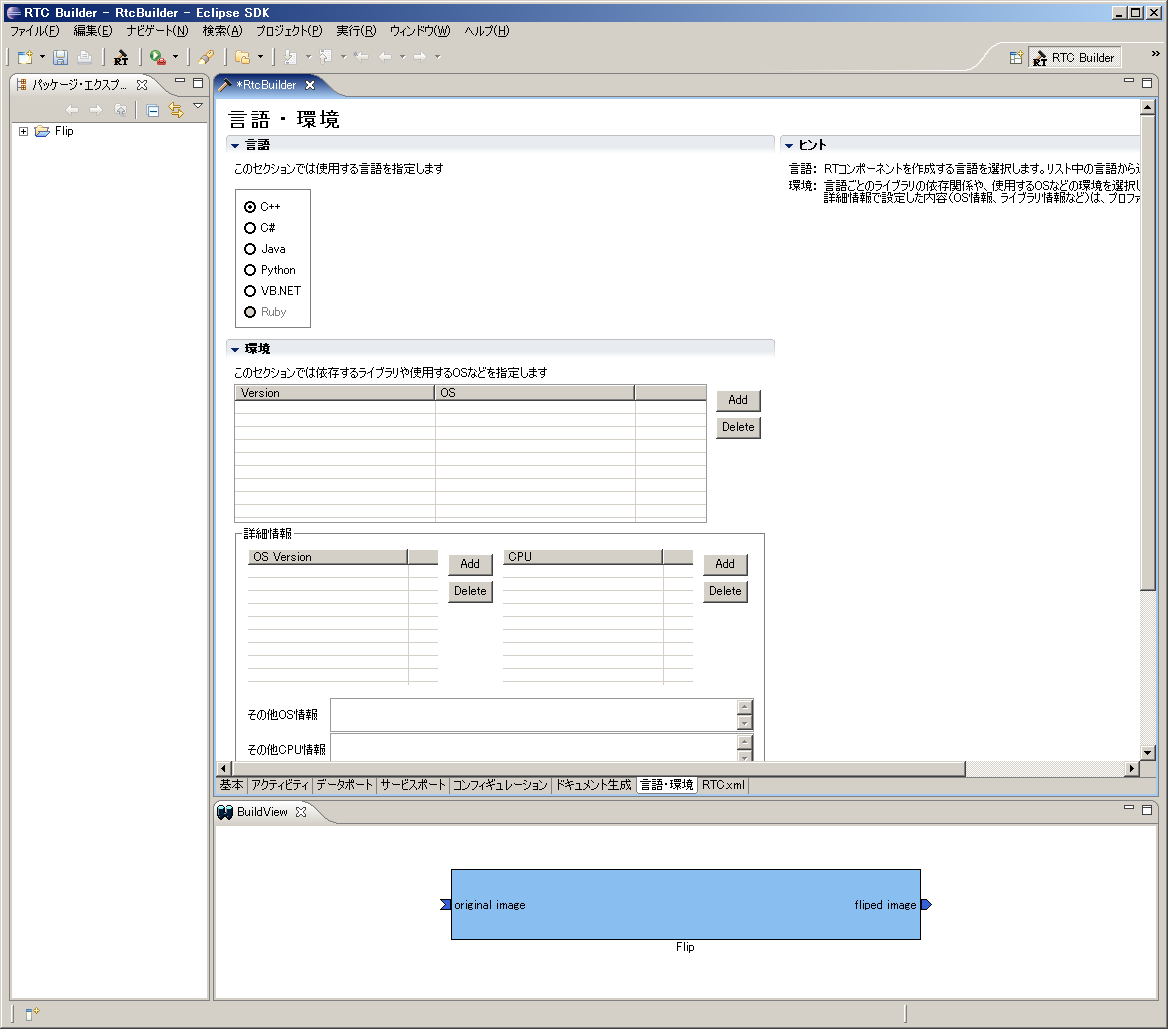

5. Select the "Language/Environment" (言語・環境) tab and choose a programming language. For the Flip component, choose C++.

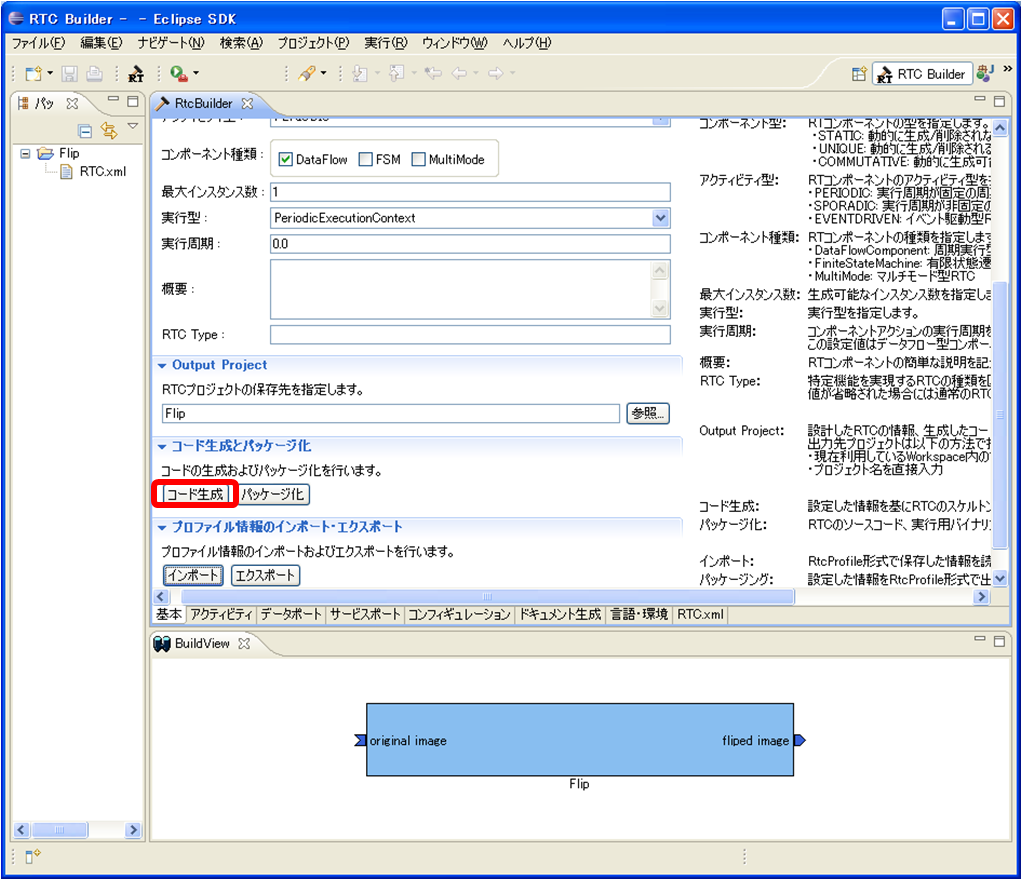

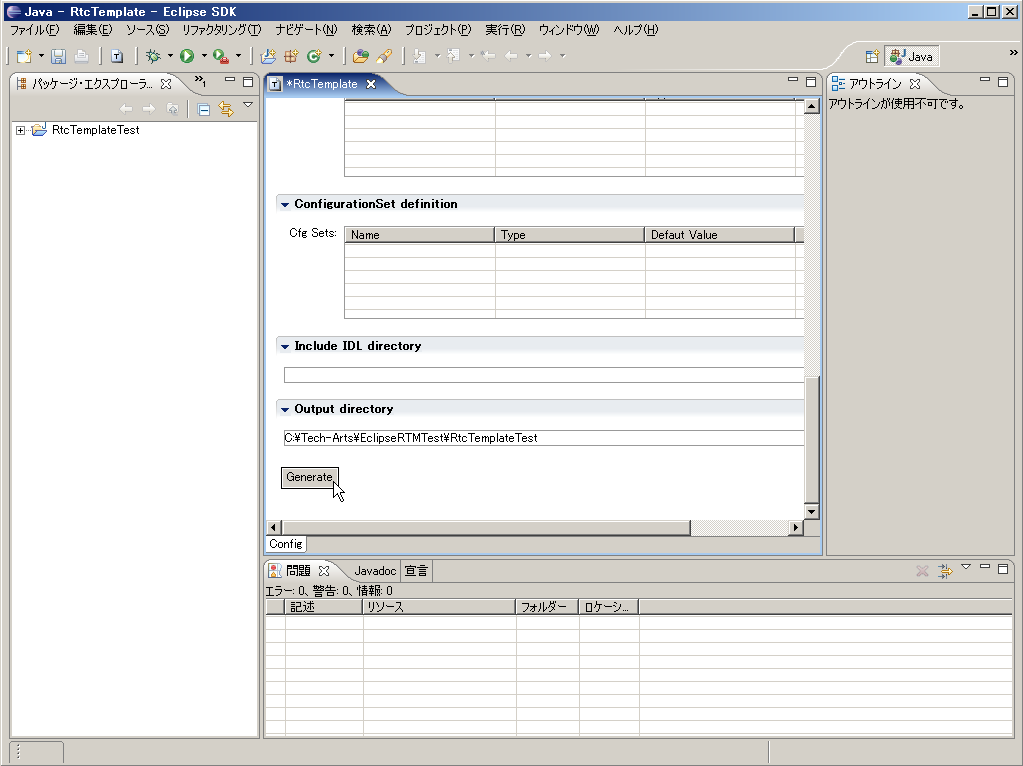

6. Click the "Generate code" (コード生成) button in the "Basic" tab to generate the component template.

※ The component template code will be generated in the currently-active Eclipse workspace directory. You can check this directory by selecting "Change workspace" from the File menu.

Basic RT Component Development

Components with Data Ports

In this sample, we will create two components with data ports, and try to send and receive data between two components. The specifications of the components that we will create are as follows.

- Component1

- It has one OutPort.

- Data type of OutPort is TimedLong.

- It outputs the values input via the console to its OutPort.

- Component2

- It has one InPort.

- Data type of InPort is TimedLong.

- It has one configuration parameter.

- The configuration parameter is int type.

- The default value of configuration parameter is 1.

- It reads the value calculated by multiplying the parameter in case of reading from the InPort variable.

- It outputs the values read from InPort to the console.

Generating Source Codes Using rtc-template

To create the components with above specifications, you will prepare the following shell script named gen.sh.

#!/bin/sh rtc-template -bcxx --module-name=ConsoleIn --module-type='DataFlowComponent' --module-desc='Console input component' --module-version=1.0 --module-vendor='MyName' --module-category=example --module-comp-type=DataFlowComponent --module-act-type=SPORADIC --module-max-inst=10 --outport=out:TimedLong rtc-template -bcxx --module-name=ConsoleOut --module-type='DataFlowComponent' --module-desc='Console output component' --module-version=1.0 --module-vendor='MyName' --module-category=example --module-comp-type=DataFlowComponent --module-act-type=SPORADIC --module-max-inst=10 --inport=in:TimedLong --config="multiply:int:1"

The component1 is created by the first execution of rtc-template, and then the component2 is created by the next.

> sh gen.sh File "ConsoleIn.h" was generated. File "ConsoleIn.cpp" was generated. File "ConsoleInComp.cpp" was generated. File "Makefile.ConsoleIn" was generated. File "README.ConsoleIn" was generated. File "ConsoleOut.h" was generated. File "ConsoleOut.cpp" was generated. File "ConsoleOutComp.cpp" was generated. File "Makefile.ConsoleOut" was generated. File "README.ConsoleOut" was generated.

Implementaion of ConsoleIn

The ConsoleIn component will be implemented by editing the generated source code.

ConsoleIn.h

This component waits for input and outputs the inputted value to its OutPort, when activated. Therefore, you need to implement only its onExecute member function, which is executed periodically during the active state, so uncomment the commented-out onExecute function in ConsoleIn.h:

:snip

// The execution action that is invoked periodically

// former rtc_active_do()

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

:snipThere is a declaration of the OutPort variables which is specified in rtc-template at the lower of ConsoleIn.h.

:snip // DataOutPort declaration // <rtc-template block="outport_declare"> TimedLong m_out; OutPort<TimedLong> m_outOut; // </rtc-template>

TimedLong m_out of declaration is the variable which is bound to OutPort.

OutPort<TimedLong> m_outOut of declaration is the instance of OutPort.

ConsoleIn.cpp

It is easy to implement ConsoleIn. Uncomment the commented-out onExecute function, and implement this way:

RTC::ReturnCode_t ConsoleIn::onExecute(RTC::UniqueId ec_id)

{

std::cout << "Please input number: ";

std::cin >> m_out.data;

std::cout << "Sending to subscriber: " << m_out.data << std::endl;

m_outOut.write();

return RTC::RTC_OK;

}- Wait for input from a user by cin >> m_out.data

- Store the inputted value to m_out.data(long type)

- Print the inputted value for confirmation

- Output the data to OutPort by m_outOut.write()

Implementation of ConsoleOut

It is a little complicated in ConsoleOut component. You must store the result value which the data from InPort is multiplied by the configuration parameter "multiply". It can be realized by the way you set a callback object to InPort.

Callback Object

Callback Object is an object in which operator() method is defined, which is invoked when an event is occurred at buffers of InPort or OutPort. Here, we use an OnWriteConvert as the callback object, which converts data when the data are written to a buffer of InPort.

Inherit RTC::OnWriteConvert and define the next class:

class Multiply

: public RTC::OnWriteConvert<RTC::TimedLong>

{

int& m_mul;

public:

Multiply(int& multiply) : m_mul(multiply) {};

RTC::TimedLong operator()(const RTC::TimedLong& value)

{

RTC::TimedLong ret(value);

ret.data = value.data * m_mul;

return ret;

};

};ConsoleOut.h

Insert this callback class just after the lines of include in ConsoleOut.h. Also, declare the instance of it as a member variable of ConsoleOut class. You may insert the declaration just after private:

private: Multiply m_owc; int dummy;

When activated, this component reads data from InPort and prints the data to the standard output. Therefore, you need to implement only its onExecute member function, which is executed periodically during the active state, so uncomment the commented-out onExecute function in the generated ConsoleOut.h:

:snip

// The execution action that is invoked periodically

// former rtc_active_do()

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

:snipThere are declarations of configuration variables and the InPort variables which is specified in rtc-template at the lower of ConsoleOut.h.

Since RingBuffer is used a buffer of InPort in ConsoleOut, you have to include RingBuffer.h. Around top of ConsoleIn.h, please include RingBuffer.h.

#include <rtm/Manager.h> #include <rtm/DataFlowComponentBase.h> #include <rtm/CorbaPort.h> #include <rtm/DataInPort.h> #include <rtm/DataOutPort.h> #include <rtm/idl/BasicDataTypeSkel.h> #include <rtm/RingBuffer.h> //add this

And, modify the part of InPort<TimedLong> m_inIn, which is the default declaration of InPort, to InPort<TimedLong, RTC::RingBuffer> m_inIn for the InPort to use a RingBuffer.

:snip

// Configuration variable declaration

// <rtc-template block="config_declare">

int m_multiply;

// </rtc-template>

// DataInPort declaration

// <rtc-template block="inport_declare">

TimedLong m_in;

InPort<TimedLong, RTC::RingBuffer> m_inIn;int m_multiply of declaration is the variable which is bound to the configuration "multiply".

TimedLong m_in of declaration is the variable which is bound to InPort.

InPort<TimedLong, RTC::RingBuffer> m_inIn of declaration is the instance of OutPort

ConsoleOut.cpp

Add an initialization of the instance of Multiply which you have defined before in the constructor of ConsoleOut class.

ConsoleOut::ConsoleOut(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

// <rtc-template block="initializer">

m_inIn("in", m_in),

// </rtc-template>

m_owc(m_multiply),

dummy(0)Also, describe the code to add the callback object to InPort in the constructor.

m_inIn.setOnWriteConvert(&m_owc); //add this

// Registration: InPort/OutPort/Service

// <rtc-template block="registration">

// Set InPort buffers

registerInPort("in", m_inIn);Uncomment the onExecute function, and implement this way:

RTC::ReturnCode_t ConsoleIn::onExecute(RTC::UniqueId ec_id)

{

if (m_inIn.isNew())

{

m_inIn.read();

std::cout << "Received: " << m_in.data << std::endl;

std::cout << "TimeStamp: " << m_in.tm.sec << "[s] ";

std::cout << m_in.tm.nsec << "[ns]" << std::endl;

}

usleep(1000);

return RTC::RTC_OK;

}- Check whether InPort has data by m_inIn.isNew()

- isNew() is a member function defined in RingBuffer

- If it has new data, load the data in the variable by m_inIn.read()

- Print the data(m_in.data)

Compile

Once you finished implementing, compile your sources as below:

> make -f Makefile.ConsoleIn > make -f Makefile.ConsoleOut

In case of compile errors, check whether there are misspellings or other mistakes, and compile again.

Execute

Prepare an appropriate rtc.conf and run ConsoleInComp and ConsoleOutComp, using two terminals.

Start up RtcLink, connect the two components, and activate them.

#imgr(./figs/Manual/ConsoleInConsoleOut2.png,center,nolink)

In the terminal running ConsoleIn, a prompt Please input number: is shown, so enter an appropriate number:

Please input number: 1 Sending to subscriber: 1 Please input number: 2 Sending to subscriber: 2 Please input number: 3 Sending to subscriber: 3

In the other terminal, which is running ConsoleOut, results should be printed like this:

Received: 1 TimeStamp: 0[s] 0[ns] Received: 2 TimeStamp: 0[s] 0[ns] Received: 3 TimeStamp: 0[s] 0[ns]

Next, on the configuration view of RtcLink, change the multiply value to 10. Then, values inputted in ConsoleIn should be multiplied by 10 and printed like this:

Received: 10 TimeStamp: 0[s] 0[ns] Received: 20 TimeStamp: 0[s] 0[ns] Received: 30 TimeStamp: 0[s] 0[ns]

Implement the component activities

Implement the component activities

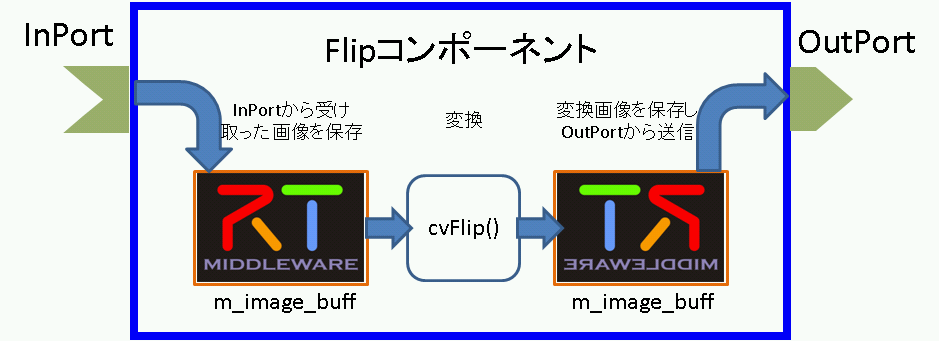

The Flip component will take image data received at its InPort, copy it into an image buffer, and use the cvFlip() function from OpenCV to transform it. The transformed data will be transmitted over the component's OutPort.

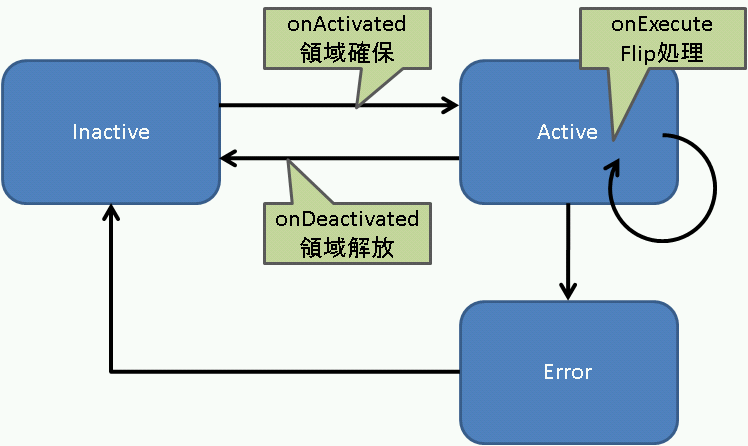

The process flow of onActivated(), onExecute() and onDeactivated() is illustrated in Figure 19.

The processing performed by onExecute() is illustrated in Figure 20.

Copy the user property sheet for OpenCV

A property sheet defines the various options (such as install path, library paths and extra link libraries) and macros necessary to compile using Visual Studio. Both RTCBuilder and rtc-template generate VC projects when they generate component templates. The generated VC project uses a property sheet to specify various options. It can also include a user-defined property sheet for any extra user-defined options.- rtm_config.vsprop: A property sheet that contains information relating to OpenRTM. Installed with OpenRTM-aist. Execute the "copyprops.bat" file in your generated project directory to copy it from the OpenRTM directory to the project directory.

- user_config.vsprops: A user-defined property sheet. The default sheet is empty. An example of its usage is given in the user_config.vsprops included with the OpenRTM USBCamera example (OpenRTM-aist/win32/OpenRTM-aist/example/USBCamera). This example sheet contains settings for OpenCV.

Copy the user_config.vsprops file given below into the Flip component's folder, or save the downloadable version into the component's folder.

※ The user_config.vsprops file that already exists in the Flip folder can be overwritten.

<?xml version="1.0" encoding="shift_jis"?>

<VisualStudioPropertySheet

ProjectType="Visual C++"

Version="8.00"

Name="OpenCV"

>

<Tool

Name="VCCLCompilerTool"

AdditionalIncludeDirectories="$(cv_includes)"

/>

<Tool

Name="VCLinkerTool"

AdditionalLibraryDirectories="$(cv_libdir)"

/>

<UserMacro

Name="user_lib"

Value="$(cv_lib)"

/>

<UserMacro

Name="user_libd"

Value="$(cv_libd)"

/>

<UserMacro

Name="cv_root"

Value="C:\Program Files\OpenCV"

/>

<UserMacro

Name="cv_includes"

Value=""$(cv_root)\cv\include";"$(cv_root)\cvaux\include";"$(cv_root)\cxcore\include";"$(cv_root)\otherlibs\highgui";"$(cv_root)\otherlibs\cvcam\include""

/>

<UserMacro

Name="cv_libdir"

Value=""$(cv_root)\lib""

/>

<UserMacro

Name="cv_bin"

Value="$(cv_root)\bin"

/>

<UserMacro

Name="cv_lib"

Value="cv.lib cvcam.lib highgui.lib cxcore.lib"

/>

<UserMacro

Name="cv_libd"

Value="cv.lib cvcam.lib highgui.lib cxcore.lib"

/>

</VisualStudioPropertySheet>Execute copyprops.bat

Upon executing copyprops.bat, the rtm_config.vsprops file will be copied to the component folder. The rtm_config.vsprops file contains settings such as the include path and extra link libraries necessary to compile an RT-Component using Visual C++.

Edit the header file

- In order to use the OpenCV library, the OpenCV include files must be added.

#include<cv.h> #include<cxcore.h> #include<highgui.h>

- The Flip component will allocate a region of image data, perform the flip processing, and release that data. This processing is carried out in in the onActivated(), onExecute() and onDeactivated callbacks, respectively. Ensure these three functions are not commented out.

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);- Add member variables for storing the image data.

IplImage* m_image_buff; IplImage* m_flip_image_buff;

Edit the source file

Implement onActivated(), onDeactivated() and onExecute() as below.

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// Image memory store allocation

m_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

m_flip_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

// Image memory store deallocation

cvReleaseImage(&m_image_buff);

cvReleaseImage(&m_flip_image_buff);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// Check for new data

if (m_image_origIn.isNew()) {

// Read data from the InPort

m_image_origIn.read();

// Copy the image data from the InPort to IplImage.imageData

memcpy(m_image_buff->imageData,(void *)&(m_image_orig.data[0]),m_image_orig.data.length());

// Flip the image data. m_flip_mode 0: flip on X, 1: flip on Y, -1: flip on both

cvFlip(m_image_buff, m_flip_image_buff, m_flip_mode);

// Get the image data size

int len = m_flip_image_buff->nChannels * m_flip_image_buff->width * m_flip_image_buff->height;

m_image_flip.data.length(len);

// Copy the flipped image data to the OutPort

memcpy((void *)&(m_image_flip.data[0]),m_flip_image_buff->imageData,len);

// Output the image data

m_image_flipOut.write();

}

return RTC::RTC_OK;

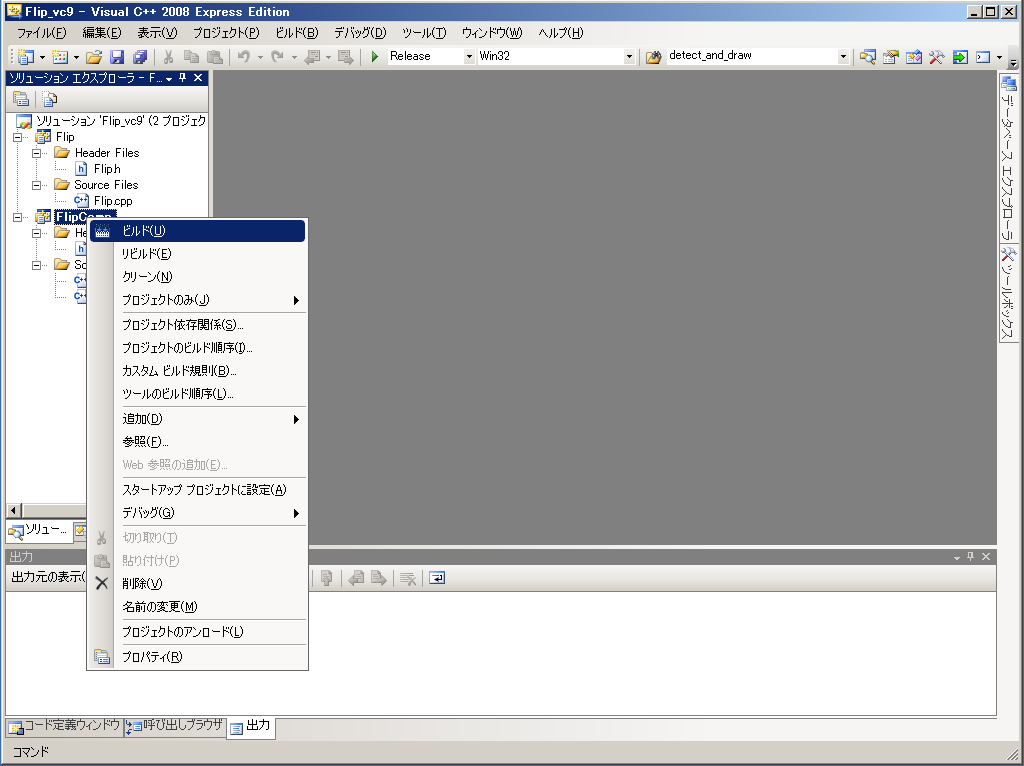

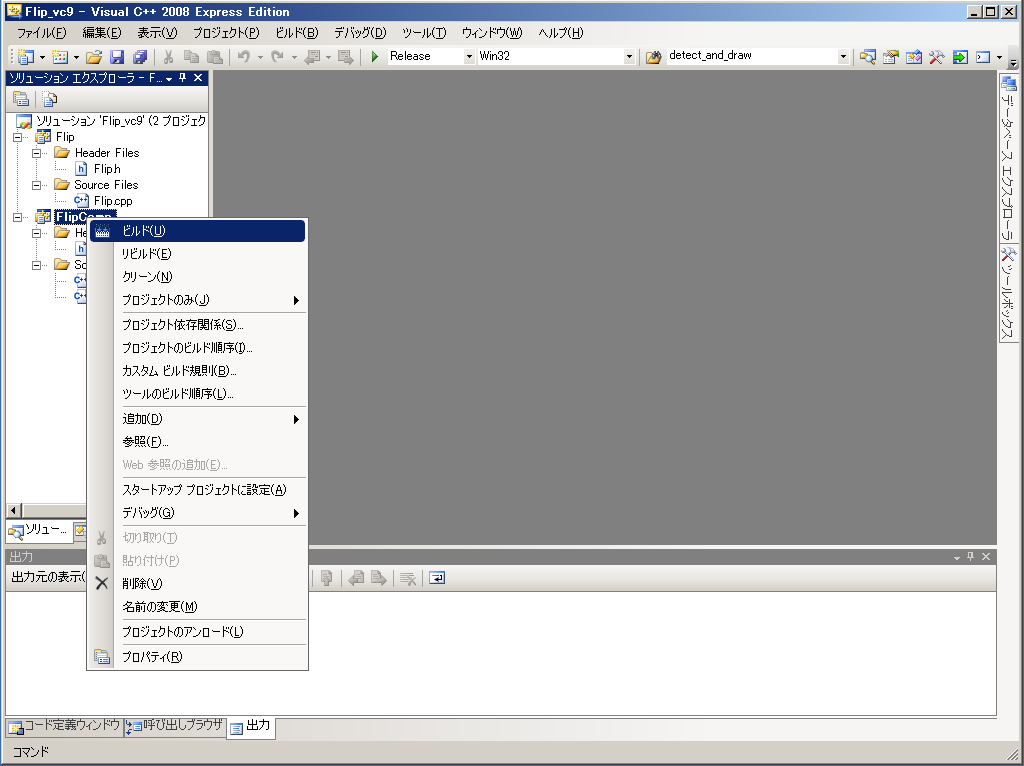

}Build the component

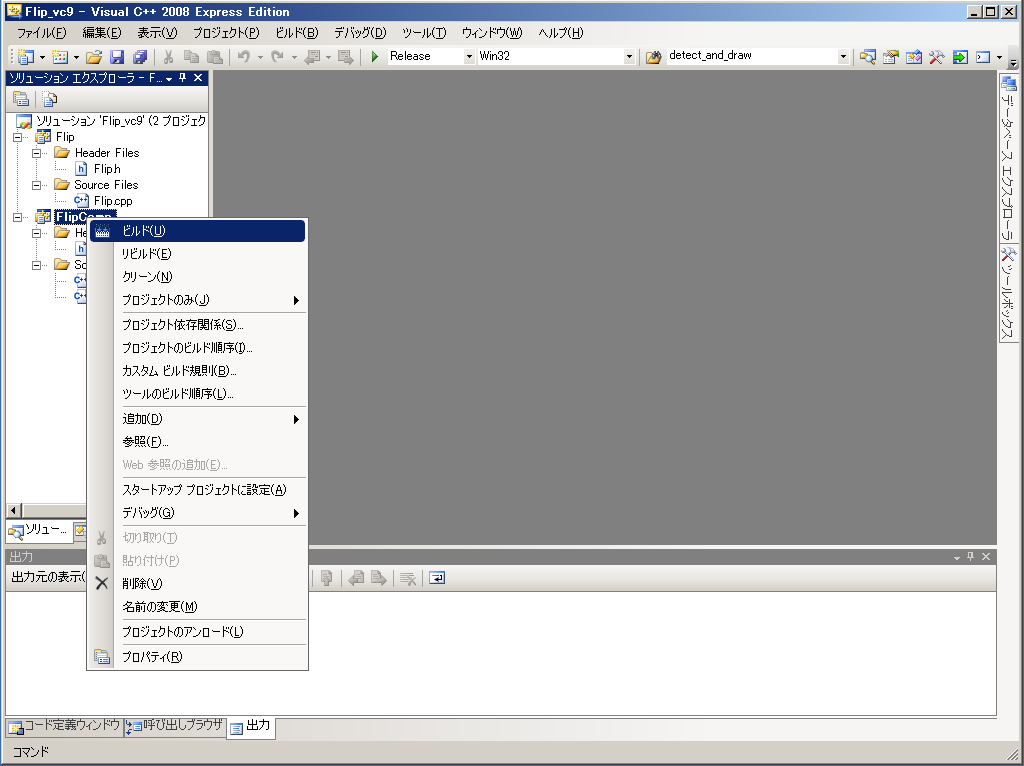

Build the component as in Figure 21.

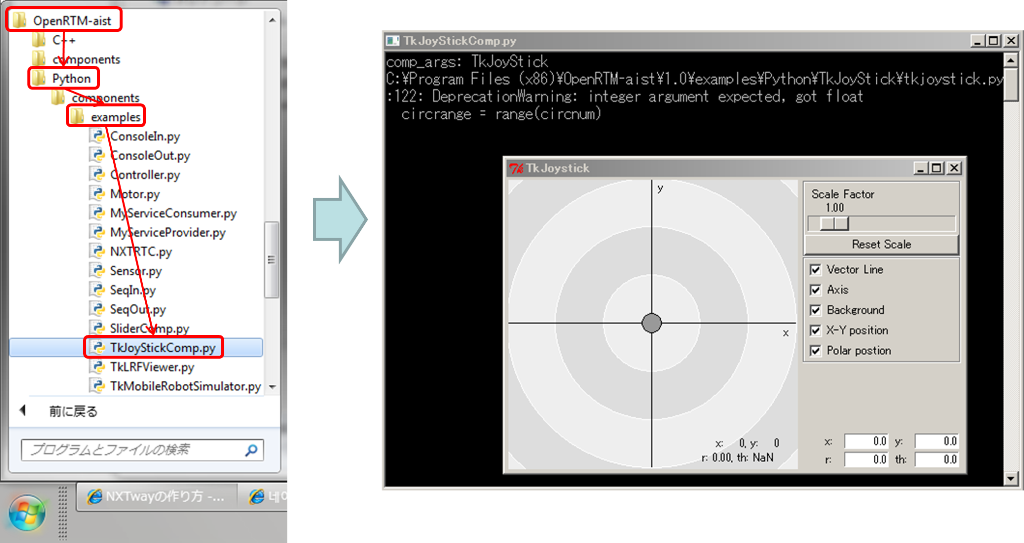

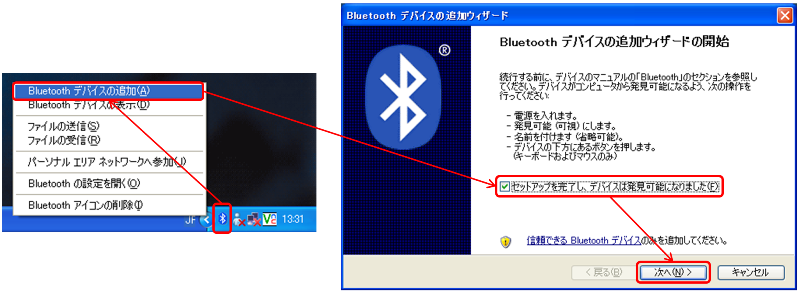

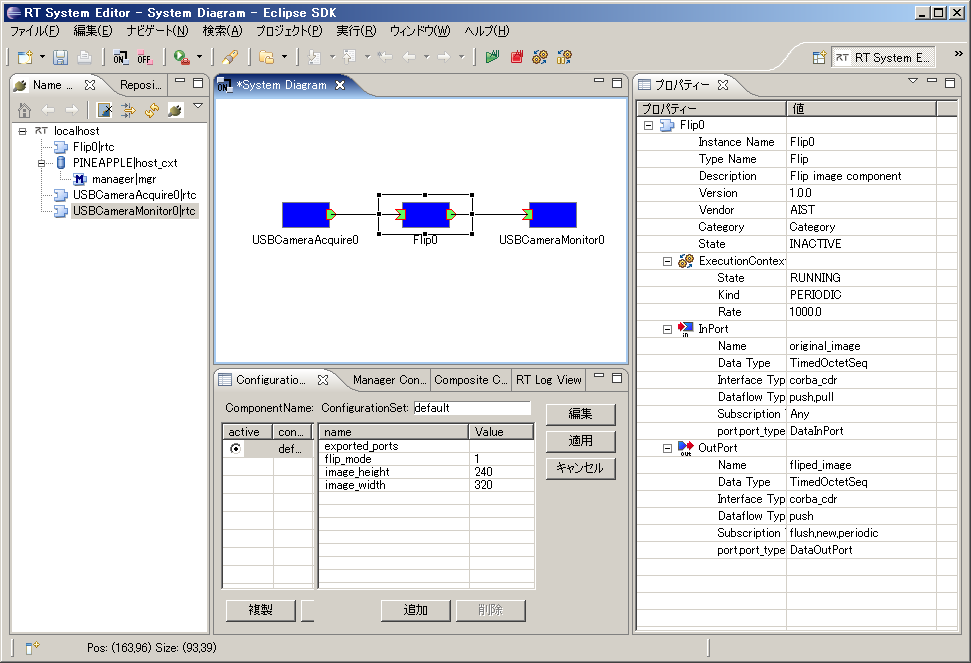

Test the component

For testing, the Flip component will be connected to the USBCameraAcquireComp and USBCameraMonitorComp sample components supplied with OpenRTM-aist.

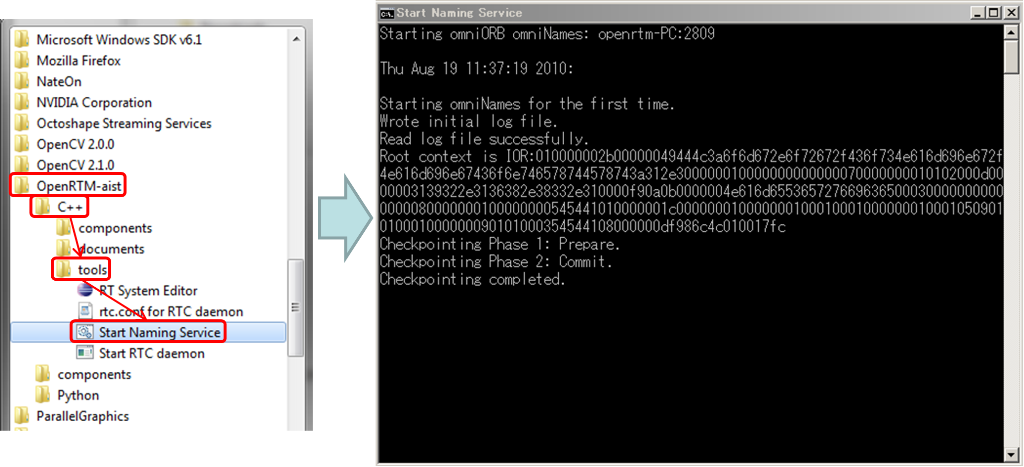

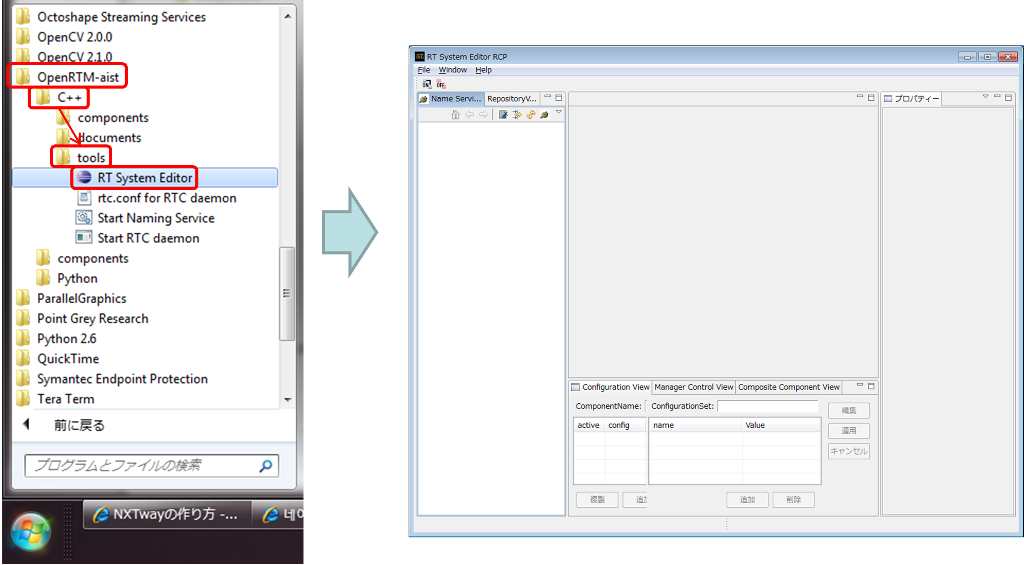

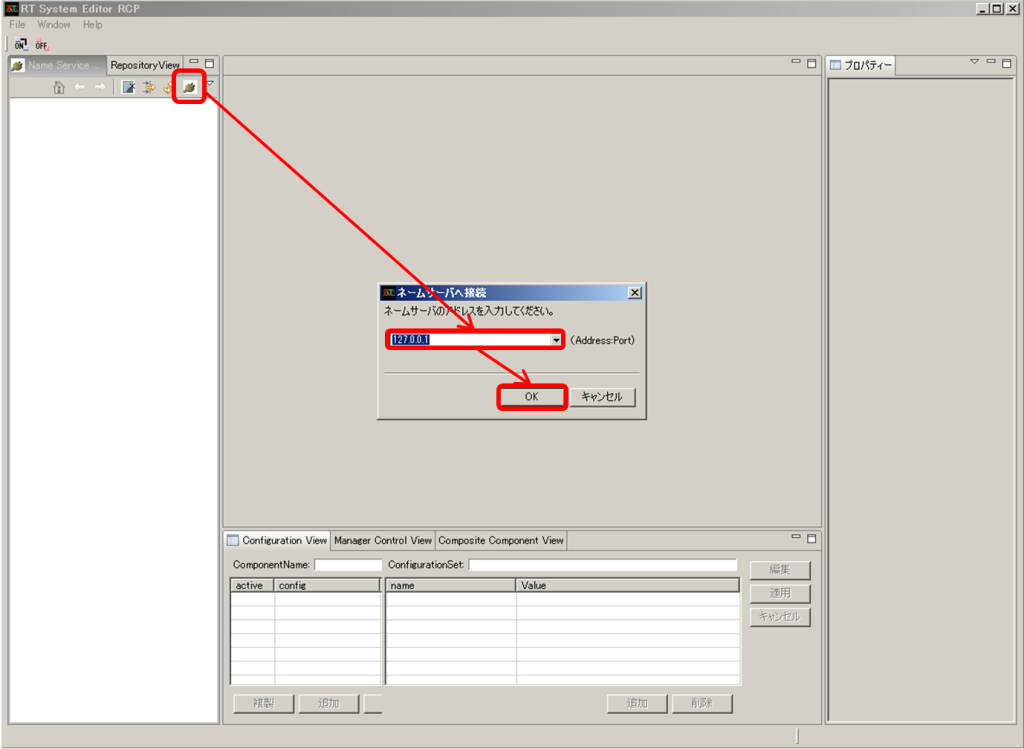

Start the name service

The omniORB name service must be started. From the Start menu, go to All Programs > OpenRTM-aist > C++ > examples > Start Naming Service.

Write rtc.conf

The rtc.conf file is used to tell an RT-Component such parameters as the address of the name server, the format to use when registering with the name server, etc. Copy the following lines into a file called "rtc.conf" and place that file in Flip\FlipComp\Debug or Flip\FlipComp\Release.

corba.nameservers: localhost naming.formats: %n.rtc

Start the Flip component

In the same folder that the rtc.conf file was placed, execute FlipComp.exe.

Start the USBCameraAqcuire and USBCameraMonitor components

The USBCameraAcquire component provides image data captured from a USB camera over its OutPort. The USBCameraMonitor component displays image data received over its InPort. Start them by selecting the following options from the Start menu:

Start > All Programs > OpenRTM-aist > C++ > examples > USBCameraAcquireComp / USBCameraMonitorCpomp

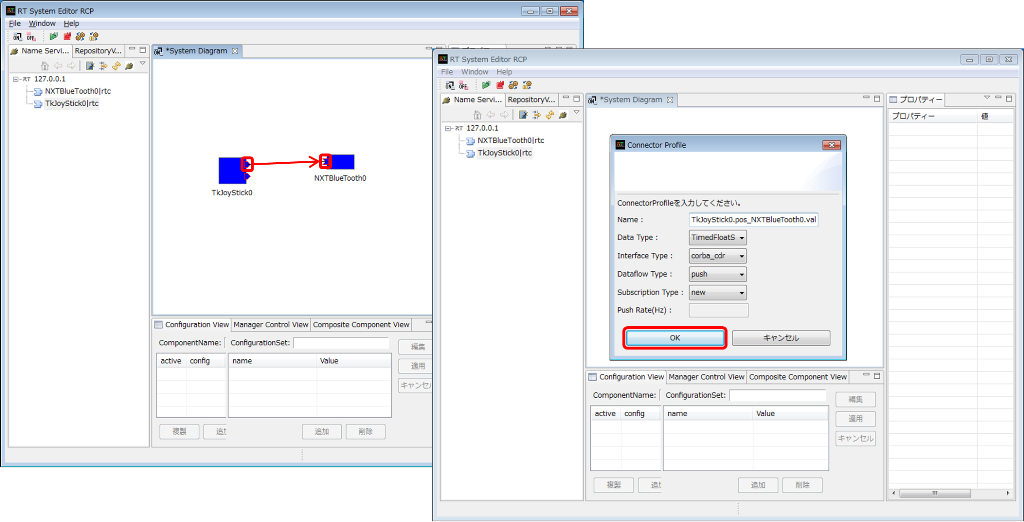

Connect the components

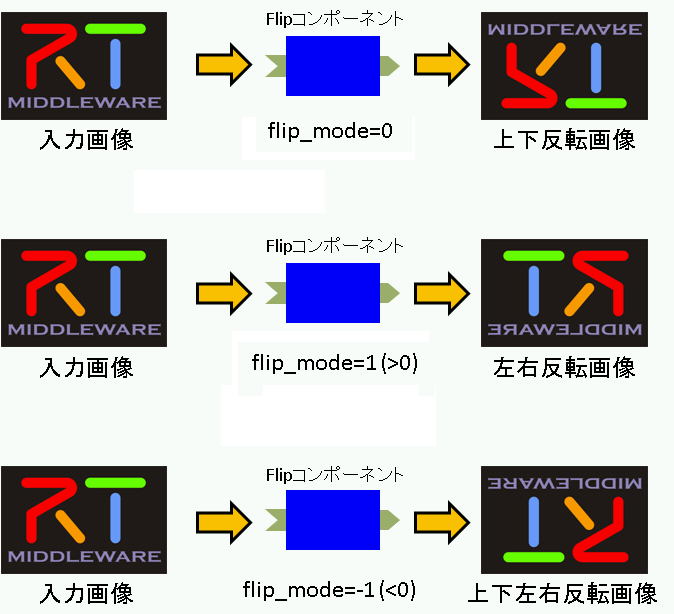

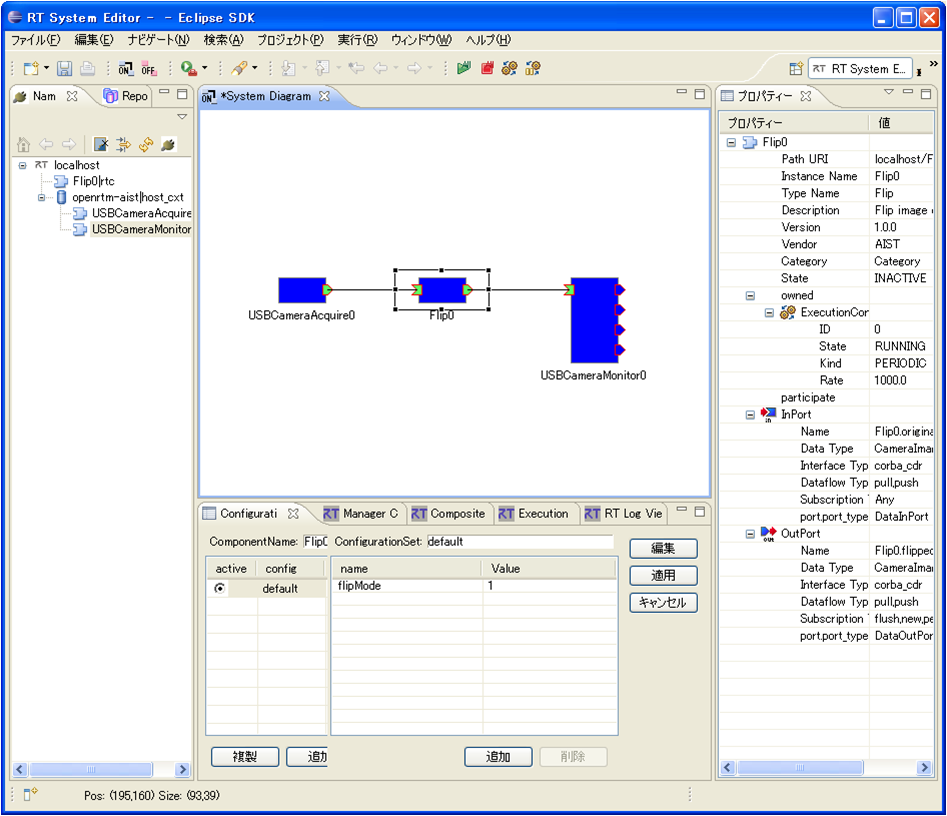

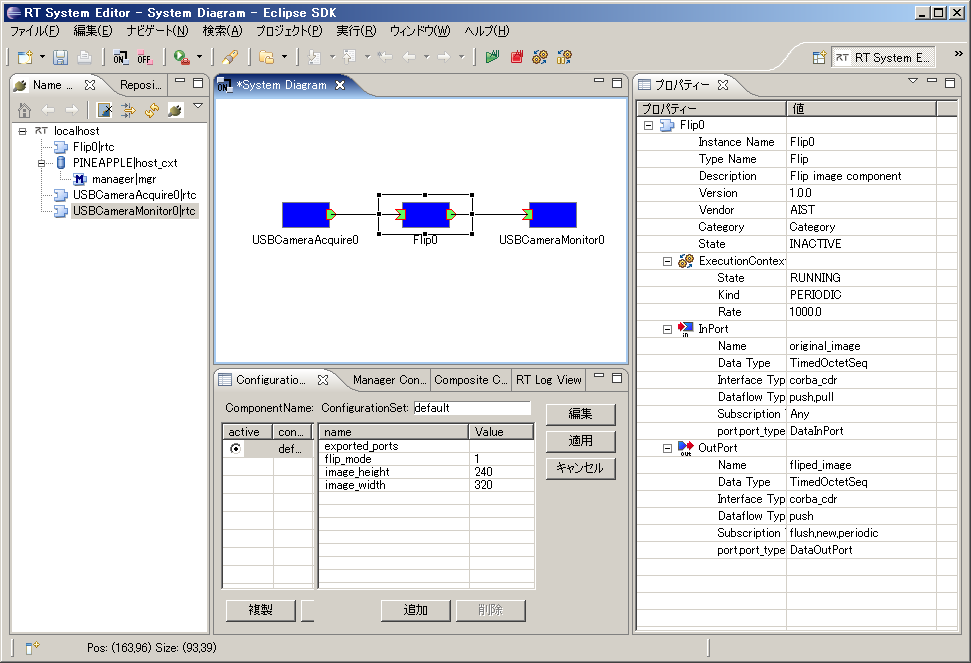

Using RTSystemEditor, connect the three components as in Figure 22.

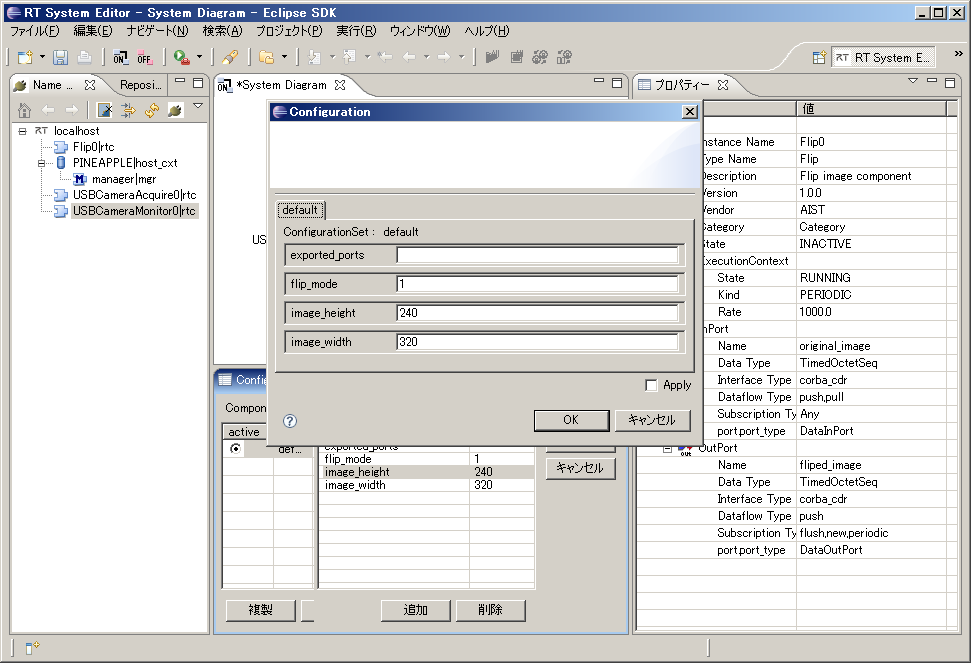

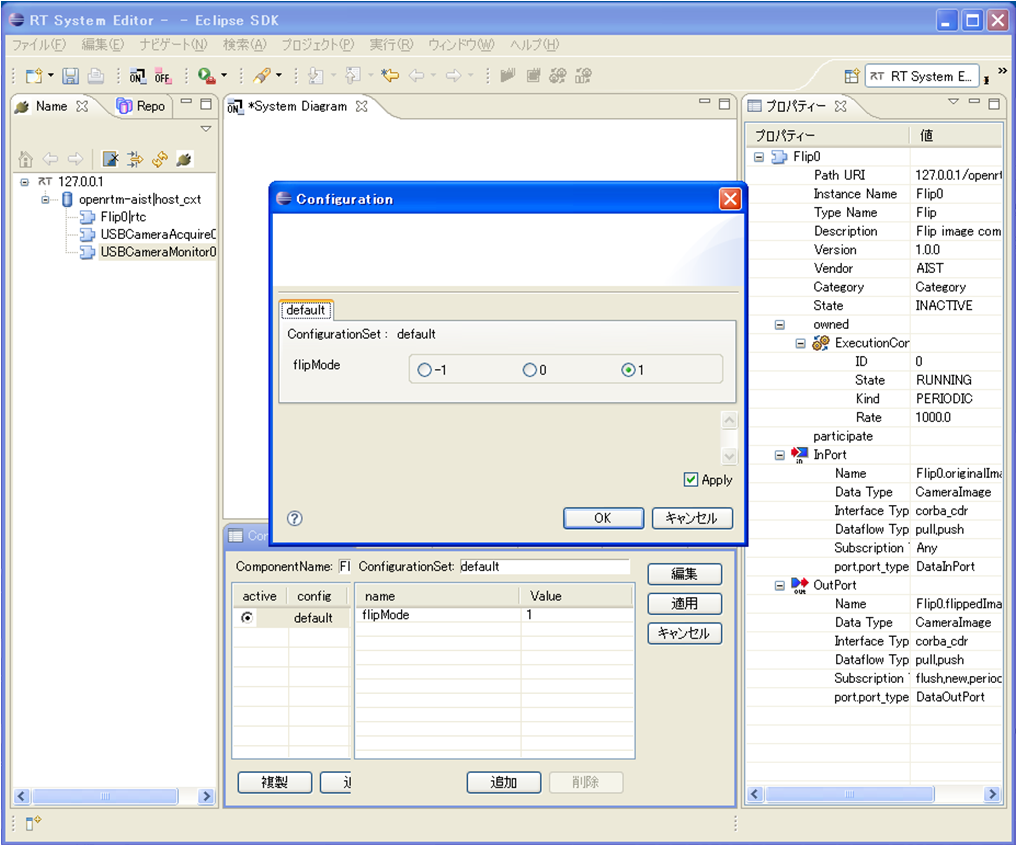

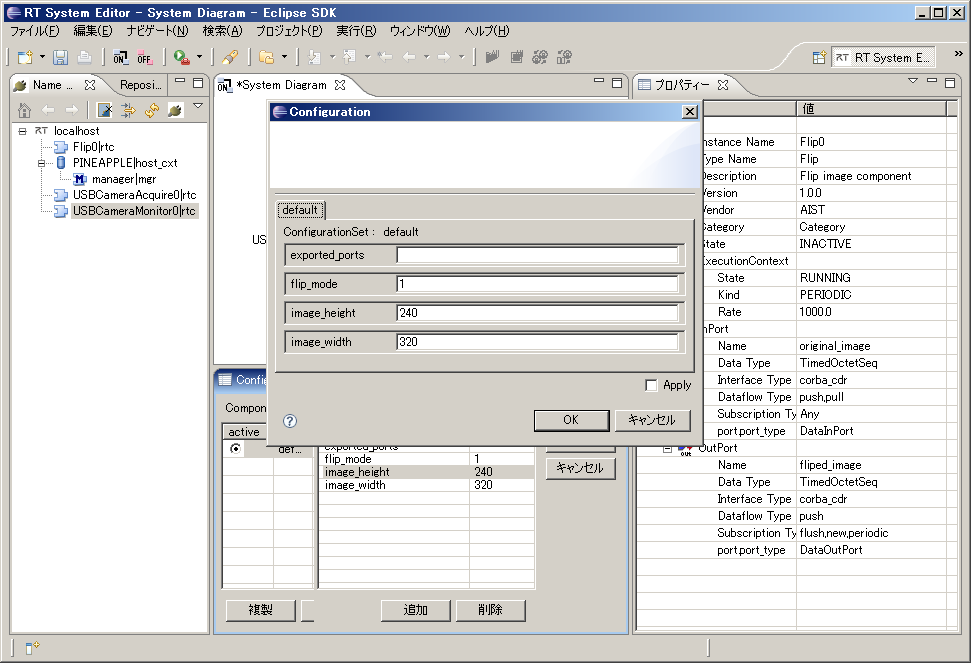

Changing the Flip component configuration parameters

The Flip component's configuration parameters can be changed as in Figure 23. For example, when using the Elecom UCAM-DLM 130HWH USB camera, set image_height and image_width as below.

image_height : 480 image_width : 640

Do the same for the USBCameraMonitor component.

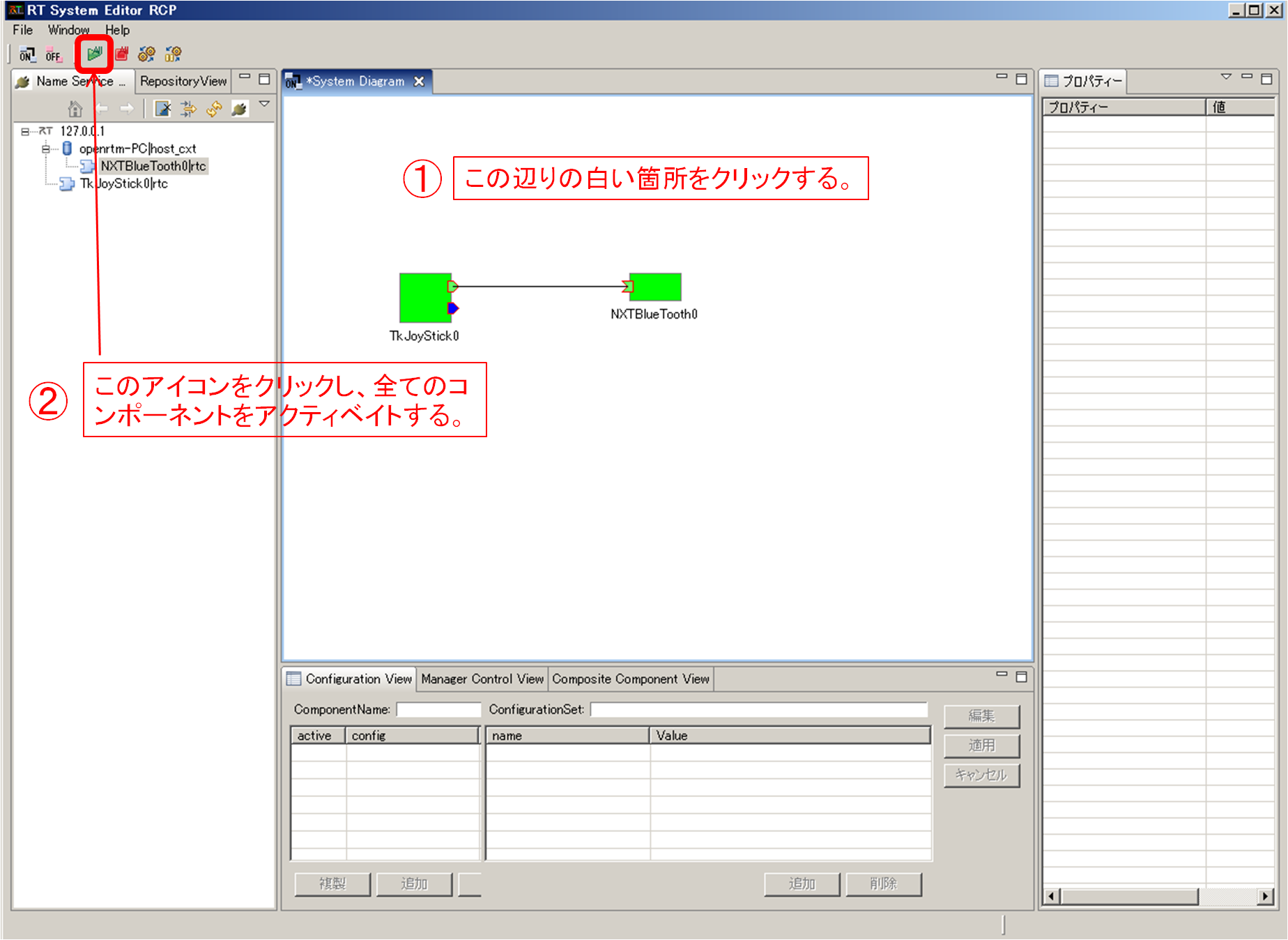

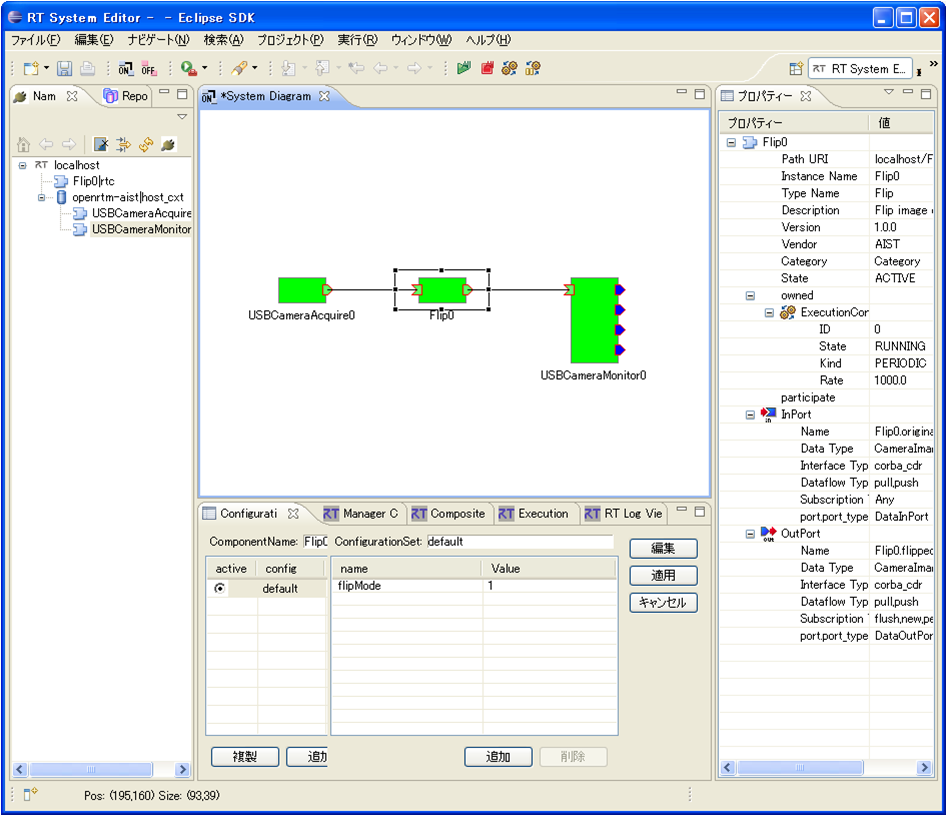

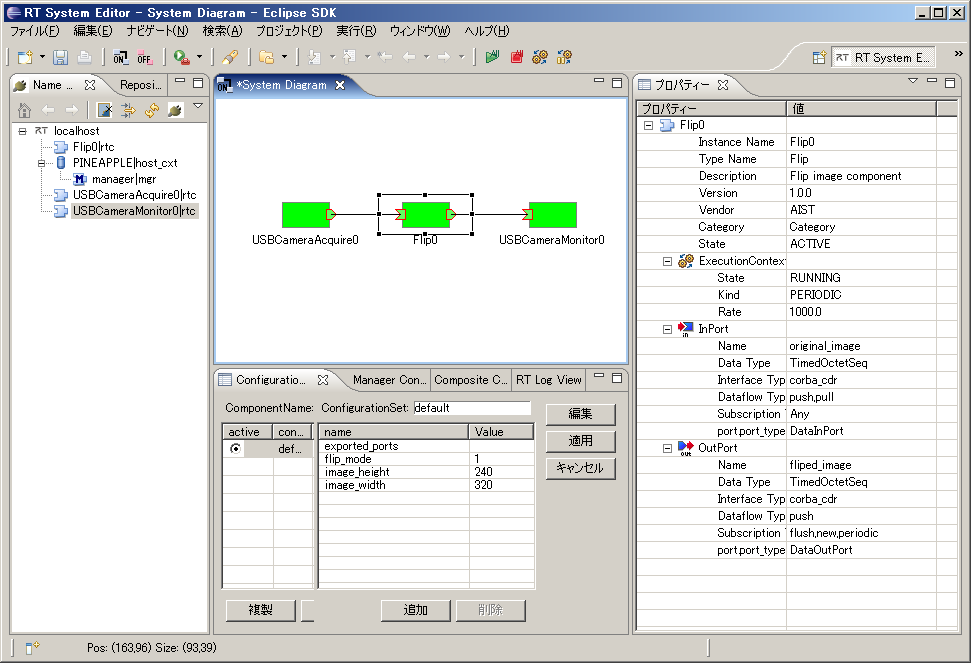

Activate the components

Click the "All" icon in the toolbar for RTSystemEditor. All the components will be activated. If all components started succesfully, RTSystemEditor should resemble Figure 24.

Test

Try changing the Flip component's "flip_mode" configuration parameter to different values of -1, 0 and 1. The displayed image should change accordingly.

Flip component source file

// -*- C++ -*-

/*!

* @file Flip.cpp

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#include "Flip.h"

// Module specification

static const char* flip_spec[] =

{

"implementation_id", "Flip",

"type_name", "Flip",

"description", "Flip image component",

"version", "1.0.0",

"vendor", "AIST",

"category", "Category",

"activity_type", "PERIODIC",

"kind", "DataFlowComponent",

"max_instance", "1",

"language", "C++",

"lang_type", "compile",

"exec_cxt.periodic.rate", "1.0",

// Configuration variables

"conf.default.flip_mode", "1",

"conf.default.image_height", "240",

"conf.default.image_width", "320",

""

};

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip::Flip(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

m_image_origIn("original_image", m_image_orig),

m_image_flipOut("fliped_image", m_image_flip),

dummy(0),

m_image_buff(0),

m_flip_image_buff(0)

{

// Registration: InPort/OutPort/Service

// Set InPort buffers

registerInPort("original_image", m_image_origIn);

// Set OutPort buffer

registerOutPort("fliped_image", m_image_flipOut);

}

/*!

* @brief destructor

*/

Flip::~Flip()

{

}

RTC::ReturnCode_t Flip::onInitialize()

{

// Bind variables and configuration variable

bindParameter("flip_mode", m_flip_mode, "1");

bindParameter("image_height", m_img_height, "240");

bindParameter("image_width", m_img_width, "320");

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// Image memory store allocation

m_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

m_flip_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

// Image memory store deallocation

cvReleaseImage(&m_image_buff);

cvReleaseImage(&m_flip_image_buff);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// Check for new data

if (m_image_origIn.isNew()) {

// Read data from the InPort

m_image_origIn.read();

// Copy the image data from the InPort to IplImage.imageData

memcpy(m_image_buff->imageData,(void *)&(m_image_orig.data[0]),m_image_orig.data.length());

// Flip the image data. m_flip_mode 0: flip on X, 1: flip on Y, -1: flip on both

cvFlip(m_image_buff, m_flip_image_buff, m_flip_mode);

// Get the image data size

int len = m_flip_image_buff->nChannels * m_flip_image_buff->width * m_flip_image_buff->height;

m_image_flip.data.length(len);

// Copy the flipped image data to the OutPort

memcpy((void *)&(m_image_flip.data[0]),m_flip_image_buff->imageData,len);

// Output the image data

m_image_flipOut.write();

}

return RTC::RTC_OK;

}

extern "C"

{

void FlipInit(RTC::Manager* manager)

{

RTC::Properties profile(flip_spec);

manager->registerFactory(profile,

RTC::Create<Flip>,

RTC::Delete<Flip>);

}

};Flip component header file

// -*- C++ -*-

/*!

* @file Flip.h

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#ifndef FLIP_H

#define FLIP_H

#include <rtm/Manager.h>

#include <rtm/DataFlowComponentBase.h>

#include <rtm/CorbaPort.h>

#include <rtm/DataInPort.h>

#include <rtm/DataOutPort.h>

#include <rtm/idl/BasicDataTypeSkel.h>

// (1) Include the OpenCV headers

#include<cv.h>

#include<cxcore.h>

#include<highgui.h>

using namespace RTC;

/*!

* @class Flip

* @brief Flip image component

*

*/

class Flip

: public RTC::DataFlowComponentBase

{

public:

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip(RTC::Manager* manager);

/*!

* @brief destructor

*/

~Flip();

/*!

*

* The initialize action (on CREATED->ALIVE transition)

* formaer rtc_init_entry()

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onInitialize();

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

protected:

// Configuration variable declaration

/*!

* flip_mode = 0: flipping around x-axis

* flip_mode > 1: flipping around y-axis

* flip_mode < 0: flipping around both axises

* - Name: flip_mode flip_mode

* - DefaultValue: 1

*/

int m_flip_mode;

/*!

*

* - Name: m_img_height

* - DefaultValue: 240

* - Image height

*/

int m_img_height;

/*!

*

* - Name: m_img_width

* - DefaultValue: 320

* - Image width

*/

int m_img_width;

// DataInPort declaration

TimedOctetSeq m_image_orig;

InPort<TimedOctetSeq> m_image_origIn;

// DataOutPort declaration

TimedOctetSeq m_image_flip;

OutPort<TimedOctetSeq> m_image_flipOut;

private:

int dummy;

IplImage* m_image_buff;

IplImage* m_flip_image_buff;

};

extern "C"

{

void FlipInit(RTC::Manager* manager);

};

#endif // FLIP_HFlip component prebuilt package

A prebuilt package of the component can be downloaded from here. Remove the underscore from the name and decompress the file.

Development of RTC (OpenCV: use of the type CameraImage )

- はじめに

- OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

はじめに

ここでは、OpenCV ライブラリを VC9 にて RTコンポーネント化する手順を紹介します。

OpenCV とは

OpenCV とはインテルが開発・公開しているオープンソースのコンピュータービジョン向けライブラリです。

Wikipedia より抜粋。

作成する RTコンポーネント

- Flip コンポーネント: OpenCV ライブラリのうち、cvFlip() 関数を用いて画像の反転を行う RTコンポーネント。

OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

ここでは、OpenCV ライブラリのうち、画像の反転を行う cvFlip() を VC9 にて RTコンポーネント化します。

以下は、作業の流れです。

- cvFlip 関数について

- コンポーネントの概要

- 動作環境・開発環境

- Flip コンポーネントの雛型の生成

- アクティビティ処理の実装

- コンポーネントの動作確認

cvFlip 関数について

cvFlip 関数は、2次元配列を垂直、水平、または両軸で反転します。

void cvFlip(IplImage* src, IplImage* dst=NULL, int flip_mode=0); #define cvMirror cvFlip src 入力配列 dst 出力配列。もし dst = NULL であれば、src が上書きされます。 flip_mode 配列の反転方法の指定内容: flip_mode = 0: X軸周りでの反転(上下反転) flip_mode > 0: Y軸周りでの反転(左右反転) flip_mode < 0: 両軸周りでの反転(上下左右反転)

コンポーネントの概要

InPort からの入力画像を反転し OutPort から出力するコンポーネント。

反転の対象軸は、RTC のコンフィギュレーション機能を使用して flipMode という名前のパラメーターで指定します。

flipMode は、反転したい方向に応じて下記のように指定してください。

- 上下反転したい場合、0

- 左右反転したい場合、1

- 上下左右反転したい場合、-1

作成する RTC の仕様は以下のとおりです。

- InPort

- キャプチャーされた画像データ (CameraImage)

- OutPort

- 反転した画像データ (CameraImage)

- Configuration

- 反転方法の指定 (int)

※ CameraImage型は、OpenRTM-aist の InterfaceDataTypes.idl にて下記のように定義されているデータ型です。

struct CameraImage

{

/// Time stamp.

Time tm;

/// Image pixel width.

unsigned short width;

/// Image pixel height.

unsigned short height;

/// Bits per pixel.

unsigned short bpp;

/// Image format (e.g. bitmap, jpeg, etc.).

string format;

/// Scale factor for images, such as disparity maps,

/// where the integer pixel value should be divided

/// by this factor to get the real pixel value.

double fDiv;

/// Raw pixel data.

sequence<octet> pixels;

};

図1は、それぞれの flipMode での画像処理のイメージ図です。

動作環境・開発環境

- OS: Windows XP SP3

- コンパイラ: Visual C++ 2008 Express Edition 日本語版

- RTSystemEditor 1.0

- RTCBuilder 1.0

Flip コンポーネントの雛型の生成

Flip コンポーネントの雛型の生成は、RTCBuilder を用いて行います。

RTCBuilder の起動

新規ワークスペースを指定して Eclipse を起動すると、以下のような「ようこそ」画面が表示されます。

この「ようこそ」画面左上の「X」をクリックして画面を閉じると、以下の画面が表示されます。 右上の [Open Perspective] ボタンをクリックし、プルダウンの「Other…」を選択します。

「RTC Builder」を選択し、[OK] ボタンをクリックします。

RTCBuilder が起動します。

RTCBuilder用 プロジェクトの作成

まず最初に,RT コンポーネントを作成するための Eclipse プロジェクトを作成します。 画面上部のメニューから [ファイル] > [新規] > [プロジェクト] を選択します。

表示された「新規プロジェクト」画面において、[その他] > [RTC ビルダ] を選択し、[次へ] をクリックします。

「プロジェクト名」欄に作成するプロジェクト名を入力して [完了] をクリックします。

指定した名称のプロジェクトが生成され、パッケージエクスプローラー内に追加されます。

生成したプロジェクト内には、デフォルト値が設定された RTC プロファイル XML(RTC.xml) が自動的に生成されます。

RTC プロファイルエディタの起動

RTC プロファイルエディタを開くには、ツールバーの「 [Open New RtcBuilder Editor] ボタンをクリックするか、メニューから [ファイル] > [Open New Builder Editor] を選択します。

コンポーネントのプロファイル情報入力とコードの生成

1. 「基本」タブを選択し、基本情報を入力します。

-モジュール名: Flip

- モジュール概要: Flip image component

- バージョン: 1.0.0

- ベンダ名: AIST

- モジュールカテゴリ: Category

- コンポーネント型: STATIC

- アクティビティ型: PERIODIC

- コンポーネント種類: DataFlowComponent

- 最大インスタンス数: 1

- 実行型: PeriodicExecutionContext

- 実行周期: 0.0 (図13では1.0となってますが,0.0として下さい.)

-Output Project: Flip

2. 「アクティビティ」タブを選択し、使用するアクションコールバックを指定します。

Flip コンポーネントでは、onActivated()、onDeactivated()、onExecute()コ ールバックを使用します。 図14のように①の onAtivated をクリック後に ②のラジオボタンの [ON] にチェックを入れます。onDeactivated、onExecute についても同様の操作を行います。

3. 「データポート」タブを選択し、データポートの情報を入力します。

-InPort Profile:

- ポート名: originalImage

- データ型: CameraImage

- 変数名: originalImage

- 表示位置: left

-OutPort Profile: - ポート名: flippedImage

- データ型: CameraImage

- 変数名: flippedImage

- 表示位置: right

4. 「コンフィギュレーション」タブを選択し、Configuration の情報を入力します。

ラジオボタンでコンフィギュレーションの変更を行います。

-flipMode

- 名称: flipMode

- データ型: int

- デフォルト値: 1

- 変数名: flipMode

- 制約条件: (-1, 0, 1) ※ (-1: 上下左右反転, 0: 上下反転, 1: 左右反転)

- Widget: radio

5. 「言語・環境」タブを選択し、プログラミング言語を選択します。

今回は、C++(言語)を選択します。

6. 「基本」タブにある [コード生成] ボタンをクリックし、コンポーネントの雛型を生成します。

※ 生成されるコード群は、Eclipse 起動時に指定したワークスペースフォルダーの中に生成されます。現在のワークスペースは、[ファイル] > [ワークスペースの切り替え] で確認することができます。

アクティビティ処理の実装

Flip コンポーネントでは、InPort から受け取った画像を画像保存用バッファに保存し、その保存した画像を OpenCV の cvFlip() 関数にて変換します。その後、変換された画像を OutPort から送信します。

onActivated()、onExecute()、onDeactivated() での処理内容を図19に示します。

onExecute() での処理を図20に示します。

OpenCV用 ユーザープロパティシートのコピー

プロパティシートとは、コンパイルに必要な種々のオプション(インクルードパス、ライブラリロードバス、ライブラリ)やマクロを記述した VC の設定ファイルの一種です。 RTCBuilder や rtc-template で生成した VC用のプロジェクトでは、VC のプロパティシートを使用して各種オプションを与えています。また、ユーザーが追加でオプションを追加できるように、ユーザー定義のプロパティシートもインクルードするようになっています。- rtm_config.vsprop:OpenRTM に関する情報を含むプロパティシート。インストールされている OpenRTM-aist に依存するファイルであるため、copyprops.bat を使用して OpenRTM のシステムディレクトリーからカレントのプロジェクトへコピーします。

- user_config.vsprops:ユーザー定義のプロパティシート。デフォルトは空です。使い方は、ソースコード:OpenRTM-aist/win32/OpenRTM-aist/example/USBCamera の中に入っているuser_config.vsprops (OpenCV用の設定)を参考にしてください。

以下の内容を user_config.vsprops というファイル名で保存し、Flip フォルダーにコピーしてください。

もしくは、下記より vsprops ファイルをダウンロードし、Flip フォルダーに保存してください。

※ 既に Flip フォルダーには user_config.vsprops ファイルが存在していますが、上書きして構いません。

<?xml version="1.0" encoding="shift_jis"?>

<VisualStudioPropertySheet

ProjectType="Visual C++"

Version="8.00"

Name="OpenCV21"

>

<Tool

Name="VCCLCompilerTool"

AdditionalIncludeDirectories="$(cv_includes)"

/>

<Tool

Name="VCLinkerTool"

AdditionalLibraryDirectories="$(cv_libdir)"

/>

<UserMacro

Name="user_lib"

Value="$(cv_lib)"

/>

<UserMacro

Name="user_libd"

Value="$(cv_libd)"

/>

<UserMacro

Name="cv_root"

Value="C:\OpenCV2.1"

/>

<UserMacro

Name="cv_includes"

Value=""$(cv_root)\include\opencv""

/>

<UserMacro

Name="cv_libdir"

Value=""$(cv_root)\lib""

/>

<UserMacro

Name="cv_bin"

Value="$(cv_root)\bin"

/>

<UserMacro

Name="cv_lib"

Value="cv210.lib cvaux210.lib highgui210.lib cxcore210.lib"

/>

<UserMacro

Name="cv_libd"

Value="cv210d.lib cvaux210d.lib highgui210d.lib cxcore210d.lib"

/>

</VisualStudioPropertySheet>copyprops.bat の実行

copyprops.batというファイルを実行することで、rtm_config.vspropsというファイルがコピーされます。

rtm_config.vspropsファイルは、RTコンポーネントをVC++でビルドするために必要なインクルードパスやリンクするライブラリ等が記述されたファイルです。

ヘッダファイルの編集

- OpenCV のライブラリを使用するため、OpenCV のインクルードファイルをインクルードします。

//OpenCV 用インクルードファイルのインクルード #include<cv.h> #include<cxcore.h> #include<highgui.h>

- この cvFlip コンポーネントでは、画像領域の確保、Flip 処理、確保した画像領域の解放のそれぞれの処理を行います。これらの処理は、それぞれ onActivated()、onDeactivated()、onExecute() のコールバック関数にて行います。

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);- 反転した画像の保存用にメンバー変数を追加します。

IplImage* m_imageBuff; IplImage* m_flipImageBuff;

ソースファイルの編集

下記のように、onActivated()、onDeactivated()、onExecute() を実装します。

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの初期化

m_imageBuff = NULL;

m_flipImageBuff = NULL;

// OutPort の画面サイズの初期化

m_flippedImage.width = 0;

m_flippedImage.height = 0;

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

if(m_imageBuff != NULL)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_originalImageIn.isNew()) {

// InPort データの読み込み

m_originalImageIn.read();

// InPort と OutPort の画面サイズ処理およびイメージ用メモリーの確保

if( m_originalImage.width != m_flippedImage.width || m_originalImage.height != m_flippedImage.height)

{

m_flippedImage.width = m_originalImage.width;

m_flippedImage.height = m_originalImage.height;

// InPort のイメージサイズが変更された場合

if(m_imageBuff != NULL)

{

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

// イメージ用メモリーの確保

m_imageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

m_flipImageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

}

// InPort の画像データを IplImage の imageData にコピー

memcpy(m_imageBuff->imageData,(void *)&(m_originalImage.pixels[0]),m_originalImage.pixels.length());

// InPort からの画像データを反転する。 m_flipMode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_imageBuff, m_flipImageBuff, m_flipMode);

// 画像データのサイズ取得

int len = m_flipImageBuff->nChannels * m_flipImageBuff->width * m_flipImageBuff->height;

m_flippedImage.pixels.length(len);

// 反転した画像データを OutPort にコピー

memcpy((void *)&(m_flippedImage.pixels[0]),m_flipImageBuff->imageData,len);

// 反転した画像データを OutPort から出力する。

m_flippedImageOut.write();

}

return RTC::RTC_OK;

}ビルドの実行

Flip_vc9.sln ファイルをダブルクリックし、Visual C++ 2008 を起動します。

Visual C++ 2008 の起動後、図21のようにし、コンポーネントのビルドを行います。

Flip コンポーネントの動作確認

ここでは、「OpenCV用RTC群 (Win32用インストーラ)」にてインストールした USBCameraAqcuireComp コンポーネントと、USBCameraMonitorCom コンポーネント、それと、今回作成した Flip コンポーネントを接続し動作確認を行います。

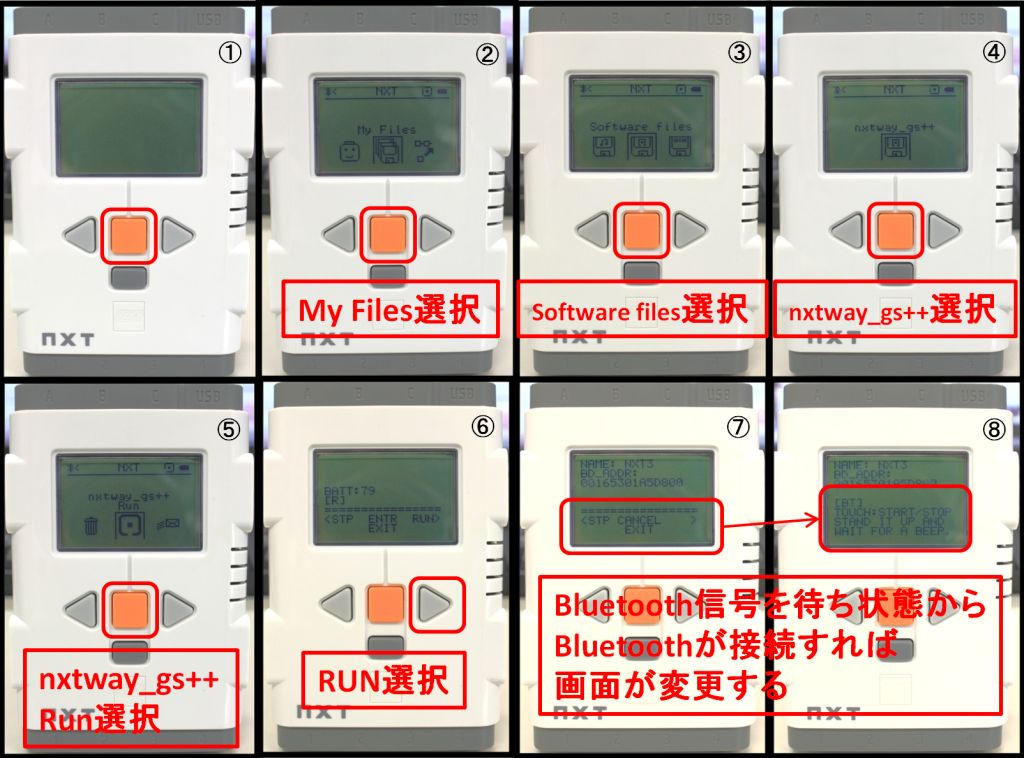

NameService の起動

omniORB のネームサービスを起動します。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [C++] > [tools] の順に辿り、「Start Naming Service」をクリックしてください。

&color(RED){※ 「Star Naming Service」をクリックしても omniNames が起動されない場合は、フルコンピューター名が14文字以内に設定されているかを確認してください。

rtc.confの作成

RTコンポーネントでは、ネームサーバーのアドレスやネームサーバーへの登録フォーマットなどの情報を rtc.conf というファイルで指定する必要があります。

下記の内容を rtc.conf というファイル名で保存し、Flip\FlipComp\Debug(もしくは、Release)フォルダーに置いて下さい。

※ Eclipse 起動時に workspace をデフォルトのままにしていた場合、Flip フォルダーのパスは、

C:\Documents and Settings\<ログインユーザー名>\workspace となります。

corba.nameservers: localhost naming.formats: %n.rtc

Flip コンポーネントの起動

Flip コンポーネントを起動します。

先程 rtc.conf ファイルを置いたフォルダーにある、FlipComp.exe ファイルを実行して下さい。

USBCameraAqcuire、USBCameraMonitor コンポーネントの起動

USB カメラのキャプチャ画像を OutPort から出力する USBCameraAqcuireComp コンポーネントと、InPort で受け取った画像を画面に表示する USBCameraMonitorComp コンポーネントを起動します。

これら2つのコンポーネントは、下記の手順にて起動できます。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [components] > [C++] > [OpenCV] を選択し、「USBCameraAqcuireComp」と「USBCameraMonitorComp」をそれぞれクリックして実行します。

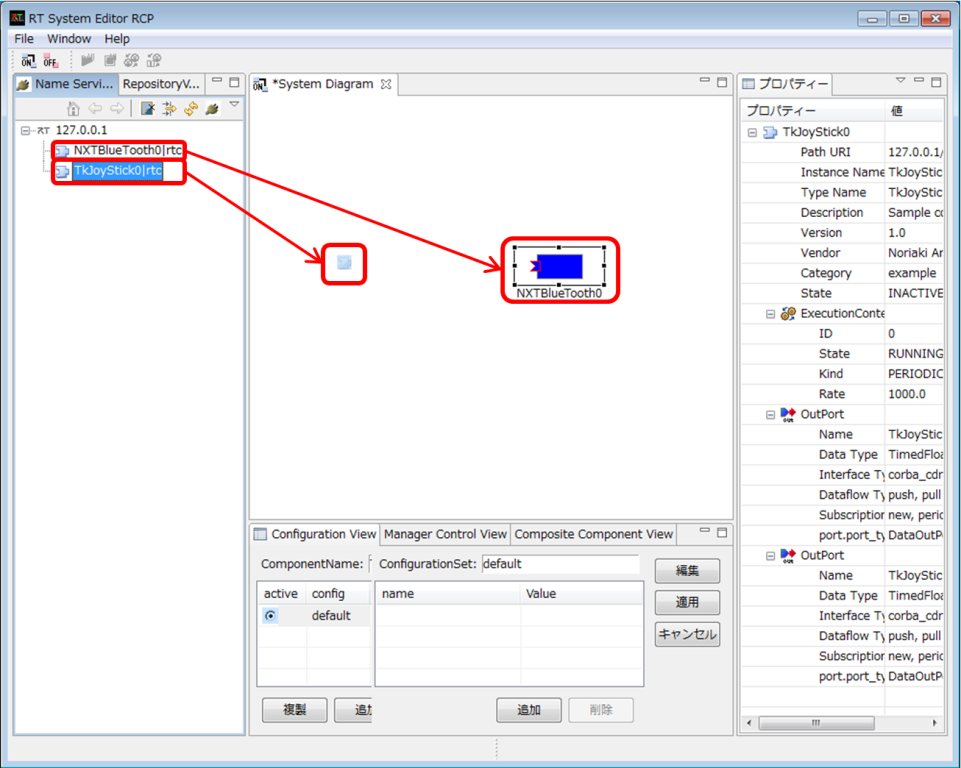

コンポーネントの接続

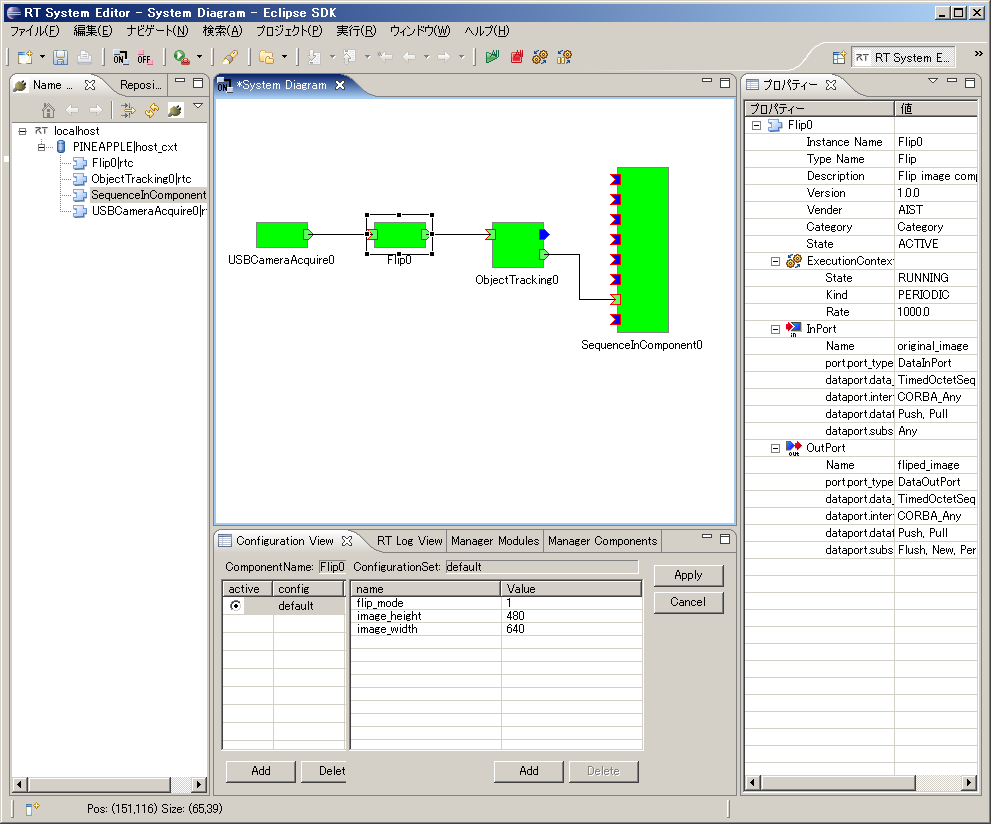

図22のように、RTSystemEditor にて USBCameraAqcuireComp、Flip、USBCameraMonitorComp コンポーネントを接続します。

コンポーネントの Activate

RTSystemEditor の上部にあります「ALL」というアイコンをクリックし、全てのコンポーネントをアクティベートします。

正常にアクティベートされた場合、図23のように黄緑色でコンポーネントが表示されます。

動作確認

図24のようにコンフィギュレーションビューにてコンフィギュレーションを変更することができます。

Flip コンポーネントのコンフィギュレーションパラメーター「flipMode」を「0」や「-1」などに変更し、画像の反転が行われるかを確認してください。

Flip コンポーネントのソースファイル

// -*- C++ -*-

/*!

* @file Flip.cpp

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#include "Flip.h"

// Module specification

static const char* flip_spec[] =

{

"implementation_id", "Flip",

"type_name", "Flip",

"description", "Flip image component",

"version", "1.0.0",

"vendor", "AIST",

"category", "Category",

"activity_type", "PERIODIC",

"kind", "DataFlowComponent",

"max_instance", "1",

"language", "C++",

"lang_type", "compile",

// Configuration variables

"conf.default.flipMode", "1",

// Widget

"conf.__widget__.flipMode", "radio",

// Constraints

"conf.__constraints__.flip_mode", "(-1,0,1)",

""

};

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip::Flip(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

m_originalImageIn("originalImage", m_originalImage),

m_flippedImageOut("flippedImage", m_flippedImage)

{

}

/*!

* @brief destructor

*/

Flip::~Flip()

{

}

RTC::ReturnCode_t Flip::onInitialize()

{

// Registration: InPort/OutPort/Service

// Set InPort buffers

addInPort("originalImage", m_originalImageIn);

// Set OutPort buffer

addOutPort("flippedImage", m_flippedImageOut);

// Bind variables and configuration variable

bindParameter("flipMode", m_flipMode, "1");

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの初期化

m_imageBuff = NULL;

m_flipImageBuff = NULL;

// OutPort の画面サイズの初期化

m_flippedImage.width = 0;

m_flippedImage.height = 0;

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

if(m_imageBuff != NULL)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_originalImageIn.isNew()) {

// InPort データの読み込み

m_originalImageIn.read();

// InPort と OutPort の画面サイズ処理およびイメージ用メモリーの確保

if( m_originalImage.width != m_flippedImage.width || m_originalImage.height != m_flippedImage.height)

{

m_flippedImage.width = m_originalImage.width;

m_flippedImage.height = m_originalImage.height;

// InPort のイメージサイズが変更された場合

if(m_imageBuff != NULL)

{

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

// イメージ用メモリーの確保

m_imageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

m_flipImageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

}

// InPort の画像データを IplImage の imageData にコピー

memcpy(m_imageBuff->imageData,(void *)&(m_originalImage.pixels[0]),m_originalImage.pixels.length());

// InPort からの画像データを反転する。 m_flipMode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_imageBuff, m_flipImageBuff, m_flipMode);

// 画像データのサイズ取得

int len = m_flipImageBuff->nChannels * m_flipImageBuff->width * m_flipImageBuff->height;

m_flippedImage.pixels.length(len);

// 反転した画像データを OutPortにコピー

memcpy((void *)&(m_flippedImage.pixels[0]),m_flipImageBuff->imageData,len);

// 反転した画像データを OutPortから出力する。

m_flippedImageOut.write();

}

return RTC::RTC_OK;

}

extern "C"

{

void FlipInit(RTC::Manager* manager)

{

coil::Properties profile(flip_spec);

manager->registerFactory(profile,

RTC::Create<Flip>,

RTC::Delete<Flip>);

}

};Flip コンポーネントのヘッダファイル

// -*- C++ -*-

/*!

* @file Flip.h

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#ifndef FLIP_H

#define FLIP_H

#include <rtm/Manager.h>

#include <rtm/DataFlowComponentBase.h>

#include <rtm/CorbaPort.h>

#include <rtm/DataInPort.h>

#include <rtm/DataOutPort.h>

#include <rtm/idl/BasicDataTypeSkel.h>

#include <rtm/idl/ExtendedDataTypesSkel.h>

#include <rtm/idl/InterfaceDataTypesSkel.h>

//OpenCV 用インクルードファイルのインクルード

#include<cv.h>

#include<cxcore.h>

#include<highgui.h>

using namespace RTC;

/*!

* @class Flip

* @brief Flip image component

*

*/

class Flip

: public RTC::DataFlowComponentBase

{

public:

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip(RTC::Manager* manager);

/*!

* @brief destructor

*/

~Flip();

/***

*

* The initialize action (on CREATED->ALIVE transition)

* formaer rtc_init_entry()

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onInitialize();

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

protected:

// Configuration variable declaration

/*!

*

* - Name: flipMode

* - DefaultValue: 1

*/

int m_flipMode;

// DataInPort declaration

CameraImage m_originalImage;

/*!

*/

InPort<CameraImage> m_originalImageIn;

// DataOutPort declaration

CameraImage m_flippedImage;

/*!

*/

OutPort<CameraImage> m_flippedImageOut;

private:

// 処理画像用バッファ

IplImage* m_imageBuff;

IplImage* m_flipImageBuff;

};

extern "C"

{

DLL_EXPORT void FlipInit(RTC::Manager* manager);

};

#endif // FLIP_HFlip コンポーネントのビルド済みパッケージ

ビルド済みパッケージを下記からダウンロードできます。

拡張子を"zip_"としてますので、"zip"にリネームしてから解凍してください。

Create RT Component (VC++ version)

- RT-Component with DataPorts

RT-Component with DataPorts

Here, how to develop RT-Component(MRCConverter) with DataPort would be shown.

Overview of the RTC

This RTC converts x-y value from input device (ex. joystick) to the wheel velocity of differential drive mobile robot.

The specification of the RTC is the following.

- InPort

- Input values of x-y from joystick (TimedFloatSeq)

- OutPort

- Wheel velocity to the mobile robot (TimedFloatSeq)

Creating template codes of MRCConverter

Here, how to create template codes by using RtcTemplate would be shown.

Creating working folder

Create working directory in any place. In the following, the directory name is MRCConverter.

- Double-click "My Computer"

- Move to working folder

- Create new folder on the target folder

Using rtc-template (CUI version)

Create the following batch file (ex. gen.bat) on the working folder to run the rtc-template easily.

rtc-template.py -bcxx^ --module-name=MRCConvertor --module-desc="Convertor component for MobileRobot component"^ --module-version=1.0.0 --module-vendor=AIST --module-category=Category^ --module-comp-type=DataFlowComponent --module-act-type=PERIODIC^ --module-max-inst=1^ --inport=velFromInput:TimedFloatSeq^ --outport=velToWheel:TimedFloatSeq

Running rtc-template (with gen.bat)

Run the gen.bat, and the result will be the following.

>gen.bat rtc-template.py -bcxx --module-name=MRCConvertor --module-desc="Convertor component for MobileRobot component" --module-version=1.0.0 --module-vendor=AIST --module-category=Category --module-comp-type=DataFlowComponent --module-act-type=PERIODIC --module-max-inst=1 --inport=velFromInput:TimedFloatSeq --outport=velToWheel:TimedFloatSeq File "MRCConvertor.h" was generated. File "MRCConvertor.cpp" was generated. File "MRCConvertorComp.cpp" was generated. File "Makefile.MRCConvertor" was generated. File "MRCConvertorComp_vc8.vcproj" was generated. File "MRCConvertor_vc8.vcproj" was generated. File "MRCConvertorComp_vc9.vcproj" was generated. File "MRCConvertor_vc9.vcproj" was generated. File "MRCConvertor_vc8.sln" was generated. File "MRCConvertor_vc9.sln" was generated. File "copyprops.bat" was generated. File "user_config.vsprops" was generated. File "README.MRCConvertor" was generated. File "MRCConvertor.yaml" was generated.

Some source codes and other files would be generated in the woking diretory.

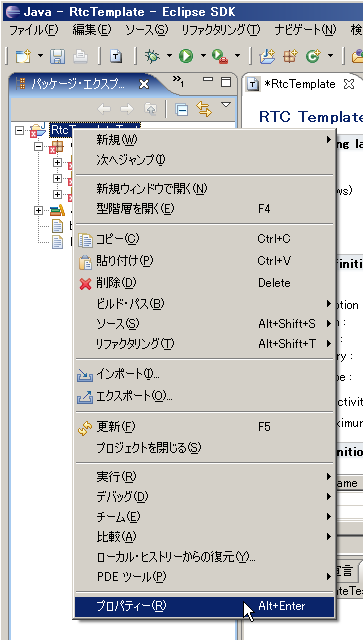

RtcTemplate on Eclipse (GUI version)

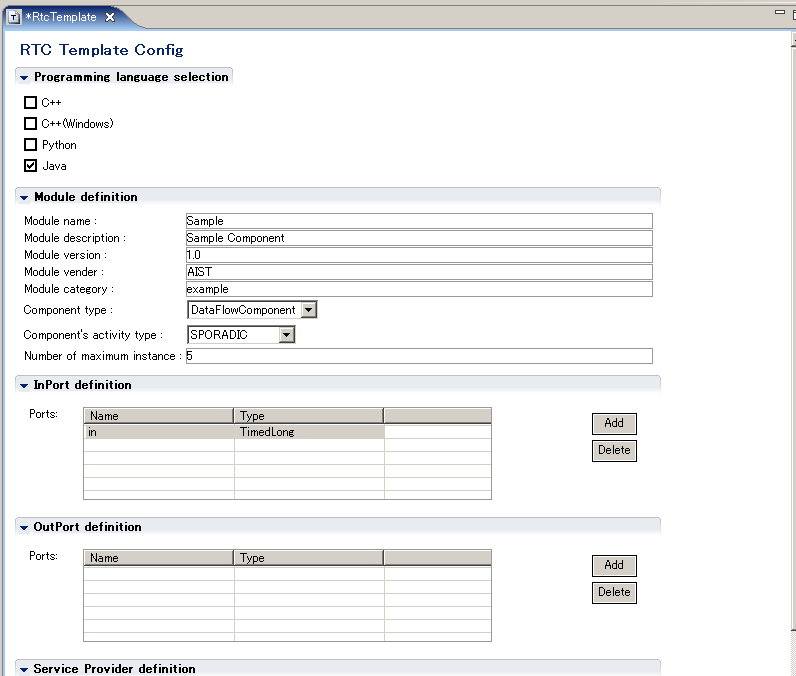

Input the following profiles in the RtcTempalte's editor window.

- Programing language selection: C++

- Module definition

- Module name: MRCConvertor

- Module decription: Convertor component for MobileRobot component

- Module version: 1.0.0

- Module vender: AIST

- Module category: Category

- Component type: DataFlowComponent

- Component's activity type: PERIODIC

- Number of maximum instance: 1

- InPort definition

- Ports: Name:velFromInput Type:TimedFloatSeq

- OutPort definition

- Ports: Name:velToWheel, Type:TimedFloatSeq

After input the component profile, push "Generate" button. Some source codes and other files would be generated in the working folder.

Running copyprops.bat

As the result of the above mentioned operation, copyprops.bat would be generated in the working folder. The copyprops.bat copies rtm_config.vsprops (Visual Studio Property Sheet) from installed OpenRTM-aist folder to current working folder. This file is necessary to build RTC on Visual C++.

Double-click te copyprops.bat.

Implementing MRCConvertor

Launching Visual Studio

Double-click MRCConvertorComp_vc?.sln and launch Visual Studio. XXX_vc8.sln is a solution file for VC2005, XXX_vc9.sln is a solution file for VC2008. Please select an appropriate solution file for your development environment.

Implementing Header File

Open the MRCConverter.h in "MRCConverterComp" -> "Header Files" from Solution Explorer.

- Including other header files

Since this RTC uses STL vector and math library, include these two header files.

#include <vector> // To use Math::M_PI in VC8 #define _USE_MATH_DEFINES #include <math.h>

- Uncomment "virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);"

- Declaration of member variable and member function

Declare a "convert()" function and its coefficient value "m_k" converting from input value to output wheel velocity.

private: float m_k;

/*!

* @brief This function converts input data from joystick to velocity of

* differential drive mobile robot.

* Only m_velFromInput.data[0 and 1] would be used.

*/

std::vector<float> convert(float x, float y) {

float th = atan2(y,x);

float v = m_k * hypot(x,y);

std::vector<float> ret_val;

ret_val.push_back(v * cos(th - (M_PI/4.0))); // left vel

ret_val.push_back(v * sin(th - (M_PI/4.0))); // right vel

return ret_val;

}Implementing Source File

Open the MRCConverter.cpp in "MRCConverterComp" -> "Source Files" from Solution Explorer.

- Implementing onExecute()

Uncomment "onExecute()" function and implement it as follows.

/*!

* @brief This function converts input data from joystick to velocity of

* differential drive mobile robot.

*/

RTC::ReturnCode_t MRCConvertor::onExecute(RTC::UniqueId ec_id)

{

if (m_velFromInputIn.isNew()) {

m_velFromInputIn.read();

if (m_velFromInput.data.length() > 2) {

std::vector<float> con_val = this->convert(m_velFromInput.data[0],m_velFromInput.data[1]);

for (int i = 0; i < 2; i++)

m_velToWheel.data[i] = con_val[i];

m_velToWheelOut.write();

}

}

return RTC::RTC_OK;

}This function does the following.

- Checking if a new data is coming by using m_velFromInputIn.isNew() function.

- Reading the data by m_velFromInputIn.read() function, if a new data is coming.

- Converting input data to a velocity of wheels by convert() function.

- Setting converted data to the OutPort variable, and write to OutPort buffer.

Running Build Proces

Click "Build" menu button and build the project.

Creating rtc.conf

Create new file and input the following lines in it. Copy this file to Debug and Release folders.

corba.nameservers: localhost naming.formats: %n.rtc

Running Component

Starting CORBA Name Server

Before running an RT-Component, launch CORBA name server. You can find the name server launching batch file from "Start"->"Program"->"OpenRTM-aist"->"C++"->"Example"->"NameService.bat"

Running MRCConvertorComp.exe

Go to "Debug" or "Release" folder and run MRCConverter.exe.

Development of RT Component (Java version)

- Overview

- Development of RT-Component for Java

- Details on RT-Components for Java

- Others

Overview

OpenRTM-aist Java Overview

OpenRTM-aist is a reference implementation of RT-Middleware which The National Institute of Advanced Industrial Science and Technology - Intelligent Systems Research Institute - Task Intelligence Research Group, has been implementing, distributing, maintaining. The RT-Middleware as well as OpenRTM-aist are the software platforms which divide the various functional components of the robot into the part unit called RT-Component and support the construction of various robotic systems by the integration of various these elements. Currently, in OMG(Object Management Group), these are conformed to the Robotic Technology Component Specification which have been decided.

OpenRTM-aist Java is that OpenRTM-aist for C++ has been ported to Java. OpenRTM-aist Java which has OpenRTM-aist compatible interfaces for C++ enable to use both RT-Component developed using Java and RT-Component developed using C++.

Target

This manual provides procedures for development of RT-Components for Java using OpenRTM-aist Java. This manual targets those who have the basic knowledge of Java.

Prerequisites

Here is a list of environments that are required to run OpenRTM-aist Java.

| Environment | Notes |

| Java Development Kit 5.0 (JDK 5) (http://java.sun.com/products/archive/j2se/5.0_12/index.html ) |

Java1.4 is not supported. |

For more details on the installation procedures, refer to "OpenRTM-aist Java Installation manual. Please check the following before moving on to the development procedures

---The version when running "java -version" matches the version of JDK above (Table1-1).

- Tha path for above JDK installation folder is specified the environment variable JAVA_HOME.

- OpenRTM-aist-0.4.x.jar and commons-cli-1.1.jar are under <JAVA_HOME>\jre\lib\ext\.

- References

- JDK 5 installation instruction Windows,UNIX

- How to set the JAVA_HOME environment variable Windows,UNIX

- Installing OpenRTM-aist-Java-0.4.x Windows,UNIX

- FAQ:"java -version" shows a different version which I have installed.

Development of RT-Component for Java

Here we explain on procedures to develop RT-Components for Java. We will use a component with the following specifications as a sample.

| Basic profile | |

| Component Name | sample |

| Discription | SampleComponent |

| Version | 1.0 |

| Vendor | AIST |

| Category | example |

| Component Type | DataFlowComponent |

| Activity Type | SPORADIC |

| Maximum number of instances | 5 |

| Data InPort | |

| Name | in |

| Type | TimedLong |

| ServiceProvider | |

| IDLPath | IDLs/MyService.idl See Note |

| Port Name | MySvcPort |

| Service Name | myservice0 |

| Service Type | MyService |

| Configuration parameter | |

| Name | multiply |

| Parameter Type | int |

| Default value | 1 |

Note: MyService.idl creates the following IDL file using the appropriate editor. Also, the "IDL Path" in above table is specified to the MyService.idl Path. On Windows, this "IDL Path" must be the full path to MyService.idl.

typedef sequence<string> EchoList;

typedef sequence<float> ValueList;

interface MyService

{

string echo(in string msg);

EchoList get_echo_history();

void set_value(in float value);

float get_value();

ValueList get_value_history();

};The above MyService.idl is the same as the sample one in the folder of Examples/RTMExamples/SimpleService included in OpenRTM-aist-0.4 Java.

Development Procedure of RT-Component with CUI

Generating Skeleton Code with rtc-template

First, you generate the skeleton of RT-Component which you would like to develop using rtc-template. The rtc-templates which have used on CUI as well as GUI are distinguished as rtc-template (for CUI) and RtcTmplate (for GUI). (Otherwise, when rtc-template is described simply, it means that it is used as general term of CUI edition and GUI edition.)

-rtc-template for CUI

When RT-Component which has the following specifications described in Table3-2 is generated using rtc-template for CUI, run this command.

rtc-template -bjava --module-name=Sample --desc= 'Sample Component' --module-version=1.0 --module-vendor=AIST --module-category=example --module-comp-type=DataFlowComponent --module-act-type=SPORADIC --module-max-inst=5 --inport=in:TimedLong --service=MySvcPort:myservice0:MyService --service-idl=IDLs/MyService.idl --config="multiply:int:1"

Note:When rtc-template is executed in the windows environment, you must enclose in double quotation (") such as "Sample component". When enclose in single quotation ('), the options can't work. Also, the line continuous symbols are need to be modified from (\) to (^).

:By this operation, these files are generated in the current directory.|

- Sample.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Classes to define Component Profile, Initialization etc

- Sampleimpl.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Main class for a RT-Component

- SampleComp.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Class for launching RT-Component

- MyServiceSVC_impl.java ・・・・・・・・・・・・ Service implementation class

- build_Sample.xml ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Build file for the RT-Component

- README.Sample ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Read Me file

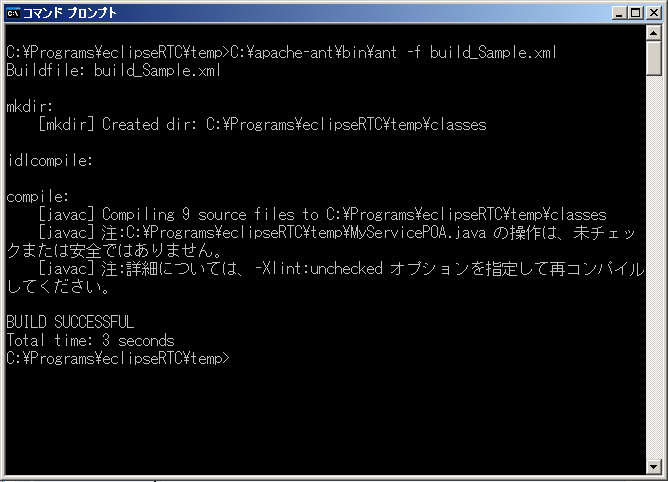

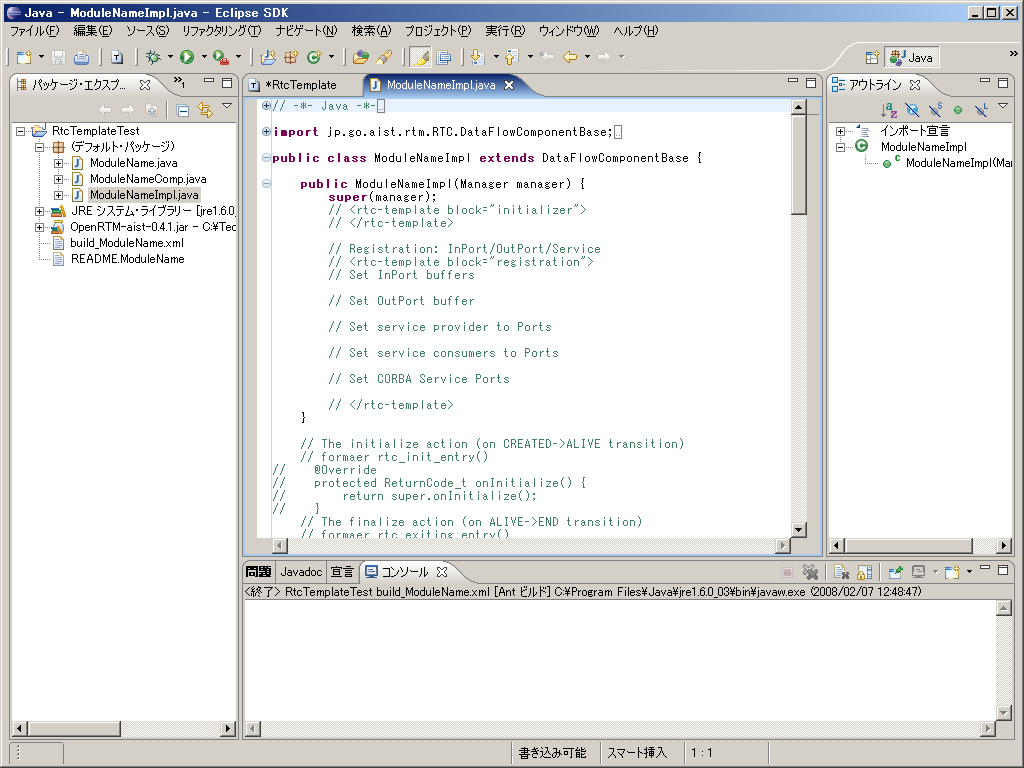

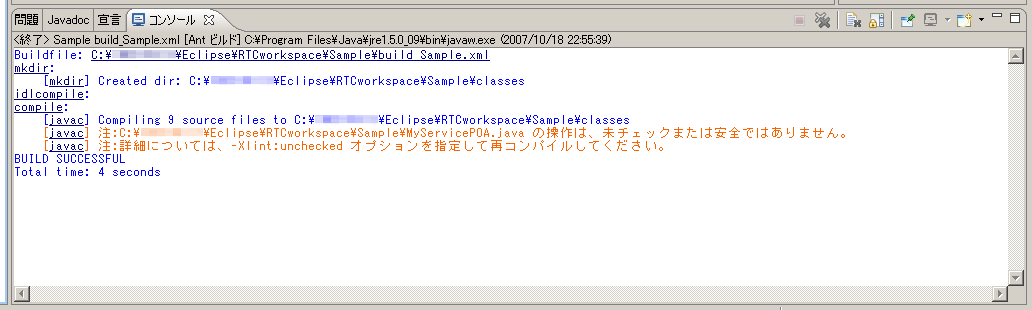

Building RT-Component which was created

We will imprement the target RT-Component for development based on the skeleton code which was generated with rtc-template. After implementing, buid RT-Component. In OpenRTM-aist Java, the component can be build on both CUI and GUI. In this section, we will explain how to build on CUI.- Build using Apache Ant

RT-Component is built using Apache Ant of the build tool via the console. You can download Apache Ant from the following URL. (For more details on the installation procedures for Apache Ant, refer to it, too.)

http://ant.apache.org/

After installing Apache Ant, move the directory which the build target exists and build it with this command.

> $ANT_HOME$bin\ant -f build_Sample.xml

:After the build has completed successfully, the file class will be generated in the directory "classes" under the directory which the build executed. This is the sample screen for the build below.|

Development Procedure of RT-Component with GUI

Collaboration between RtcTemplate and JDT

- Open "New" on Eclipse

It is also possible to develop RT-Component via Project on Eclipse which is Integrated Development Environment. Specify a new workspace and launch Eclipse. (Although you see a "Welcome" screen at that time, close this.)

Fig.3-6 Specify a New Workspace

Fig.3-6 Specify a New Workspace

- Create the Java project file

Select [File]-[New]-[Project] in the upper menu bar.

Fig.3-7 Create the project to build (1)

Fig.3-7 Create the project to build (1)

- Select "Java Project" in "New Project" wizard and Press [Next] button.

:On the next step of "New Project" wizard, enter "project name" in the dialog box. Check setting of "Compiler compliance level" in "JDK Compliance" is over "5.0" (or over 1.5) and press [Next] button.|

- Set each setting of the creating project in "New Java Project" screen and click on [Finish] button.

- The specified project is generated and displayed in the "Package Explorer" view.

Note: For more details on the options, setting on Eclipse when creating the project, refer to Eclipse website(http://www.eclipse.org/).

Generating Skeleton Code with RtcTemplate

- Launch of RtcTemplate editor for GUI

Open the editor window of RtcTemplate -> See Launching RtcTemplate directly

Note: please refer RtcTemplate manuals about how to use RtcTemplate and other topics.

- Editing configuration items using RtcTemplate editor

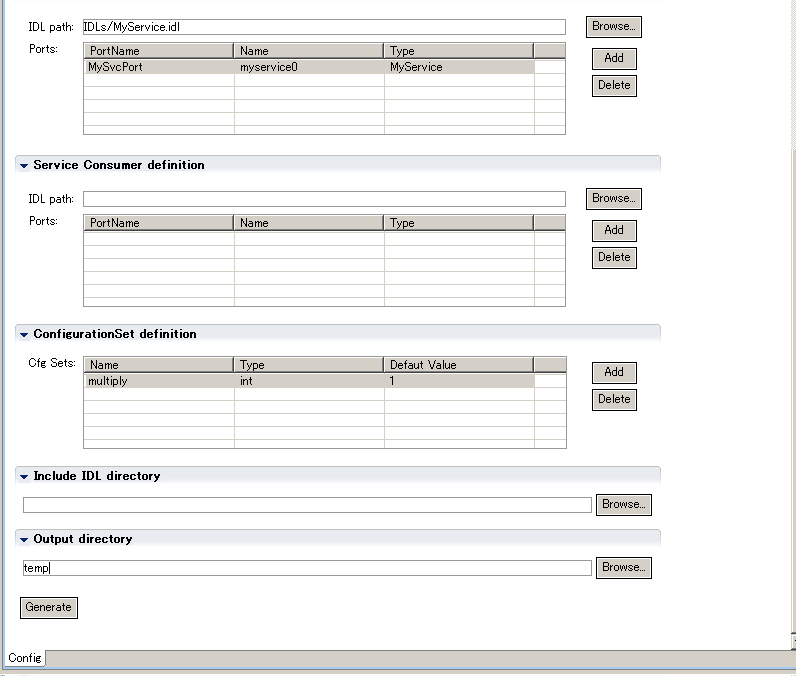

Here is the configurations when you generate skeleton codes for RT-Component which have the specification of Table 3-2, using RtcTemplate for GUI.

Fig.3-12 Settings of GUI RtcTemplate

Fig.3-12 Settings of GUI RtcTemplate

:Note:On Windows you must specify a full path for "Output directory", "IDL path:", and so on.|

- Generating codes by [Generate] button

Press [Generate] button to perform code generations. When you generate, make sure to specify the project directory which has been generated before, as "Output directory" field existing bottom of RtcTemplate editor.(Note: "temp" is specified in the figure.) Fig.3-13 Generate Codes

Fig.3-13 Generate Codes

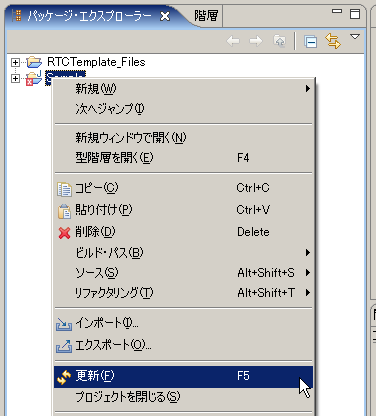

- Adding a variety of generated files to the project

These files are generated in the directory you specified as "Output directory".- Sample.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Class to define Component Profile, initialization process, and so on

- Sampleimpl.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Main class for a RT-Component

- SampleComp.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Class to launch the RT-Component

- MyServiceSVC_impl.java ・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Service implementation class

- build_Sample.xml ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Build file for the RT-Component

- README.Sample ・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・・ Read Me file

: By specifying the project directory as "Output directory" field, a variety of generated files are to be added to the project (automatically).|

Note In the case of RT-Components which define service ports, errors occur when there are only files generated by Rtctemplate. It is because some of generated files use classes which are generated from IDL files. These required classes will be generated automatically when you build the component.

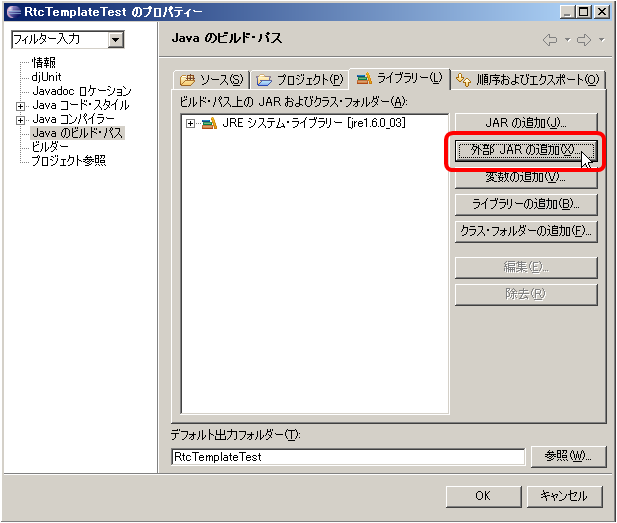

Note:If OpenRTM-aist Java is not installed on a location which the classpath of the project refers, errors occur, In this case, modify Java Build Path properly of the project, and include the install folder(directory) of OpenRTM-aist Java in the classpath.

Building RT-Component with Eclipse

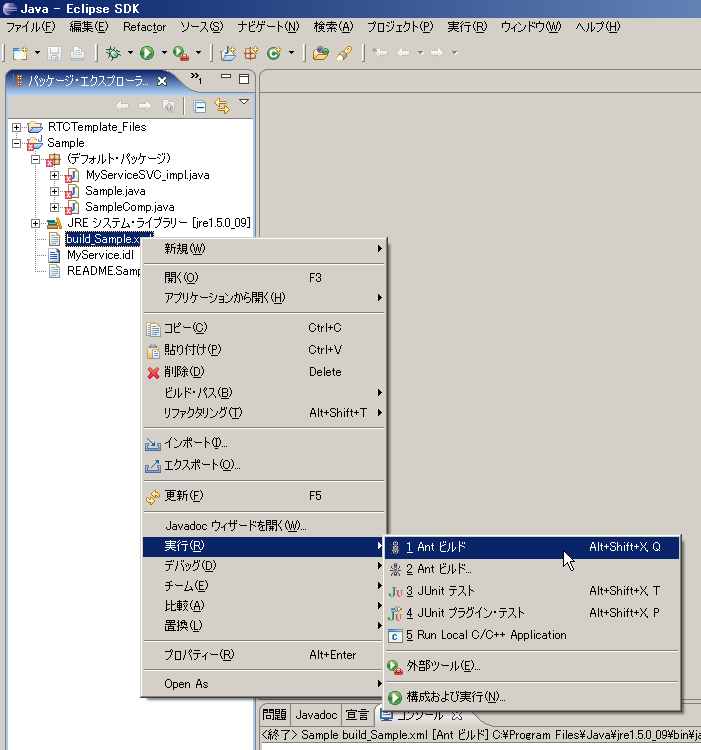

- Ant Build

You can build a target RT-Component by right-click build_Sample.xml in Package Explorer, then select [Execute]-[Ant Build].

Fig.3-18 Build of the project

Fig.3-18 Build of the project

- If the build has completed successfully, the class file will be generated in the directory "classes" in project.

Running RT-Component which was created

- Create rtc.conf

Create the file rtc.conf included the following contents in "classes" within the project.corba.nameservers: localhost naming.formats: %n.rtc

rtc.conf

The above rtc.conf is the same as the sample in the folder of "Examples/RTMExamples/SimpleService" included in OpenRTM-aist-0.4 Java.

-Start the Name Server and RtcLink

Double-click start-orbd.bat in the folder "Examples" of samples included in OpenRTM-aist-0.4 Java (Windows), or execute start-orbd.sh (UNIX) to start the Name Server. In addition, launch RtcLink .

- References

- Start Name Server

- Starting RtcLink

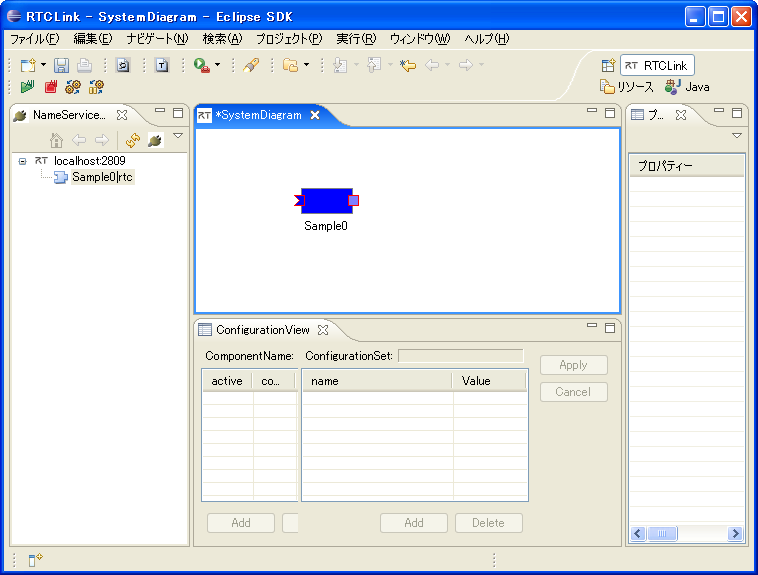

-Execution of RT-Component

Open a command prompt or terminal, and set the "classes" directory as current directory. If type likeRT-Component will be shown on RtcLink.> java SampleComp

Fig.3-20 State of RtcLink when Sample component succeeds to execute

Fig.3-20 State of RtcLink when Sample component succeeds to execute

Details on RT-Components for Java

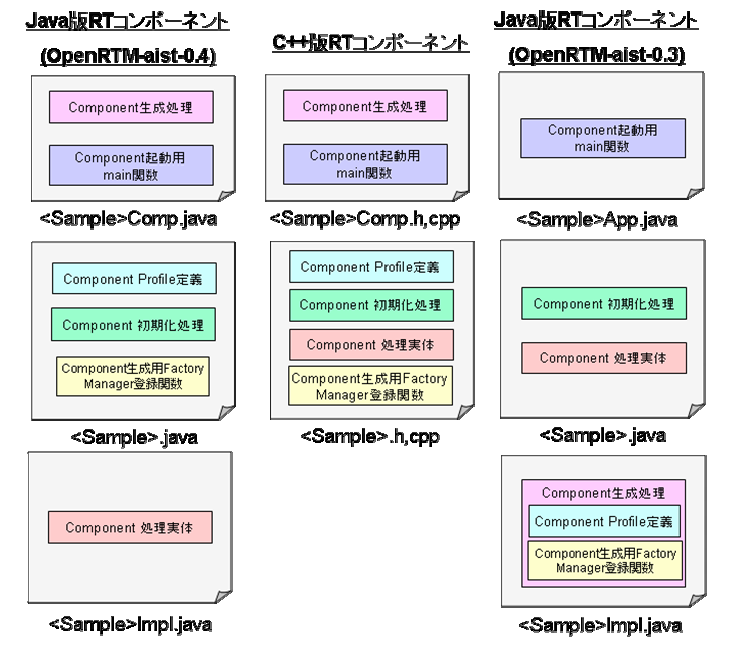

Structure of RT-Components for Java

The relation between source files of RT-Components for Java, and general functions included in each file is shown in Fig.3-21. For comparison, RT-Components for C++ and RT-Components Java for OpenRTM-aist-0.3 are also shown.

There are these differences between existing RT-Components for C++ and RT-Components for Java.

- Separation of main body of RT-Components functions

In RT-Components for Java, issues about launching and others moved main body of RT-Components functions to XXXImpl classes (In Fig.3-21, <Sample>Impl.java). This makes original RT-Component classes (In Fig.3-21, <Sample>.java) consist of only Component Profile definitions and generating operations to generate a variety of components.

- Changing callback functions to interfaces

Parts defined as callback functions in RT-Components for C++ are interfaces in those for Java.

- ModuleInitProc: Interface for classes to launch components

- RtcNewFunc: Interface to create RT-Components

- RtcDeleteFunc: Interface to destruct RT-Components

This change make it mandatory for component launch classes to implement those interfaces.

Point of Difference between RT-Components for Java and RT-Components for C++

Data Ports

In OpenRTM-aist Java, Holder class (DataRef Class) is added to pass data. This changes on how to define and use data ports as follows:

| RT-Components for Java | RT-Components for C++ |

| //Definition of InPort protected TimedShort m_in_val protected DataRef<TimedLong> m_in; protected InPort<TimedLong> m_inIn; //Registration of InPort m_in_val = new TimedLong(); m_in = new DataRef<TimedLong>(m_in_val); m_inIn = new InPort<TimedLong>("in",m_in); registerInPort(TimedLong.class,"in",m_inIn); //Reading data from InPort m_inIn.read(); Input Data = m_in.v.data; |

//Definition of InPort TimedShort m_in; InPort<TimedShort> m_inIn; //Registration of InPort m_inIn = new InPort<TimedLong>("in",m_in); registerInPort("in",m_inIn); //Reading data from InPort m_inIn.read(); Input Data = m_in.data; |

| //Definition of OutPort protected TimedFloat m_out_val; protected DataRef<TimedFloat> m_out; protected OutPort<TimedFloat> m_outOut; //Registration of OutPort m_out_val = new TimedFloat(); m_out = new DataRef<TimedFloat>(m_out_val); m_outOut = new OutPort<TimedLong>("out",m_out); registerOutPort(TimedLong.class,"out",m_outOut); //Writing data to OutPort m_out_val.data = Output Data; m_outOut.write(); |

//Definition of OutPort TimedFloat m_out; OutPort<TimedFLoat> m_outOut; //Registration of OutPort m_outOut = new OutPort<TimedFloat>("out",m_out); registerOutPort("out",m_outOut); //Writing data to OutPort m_out.data = Output Data; m_outOut.write(); |

For more detail on how to use Data Ports, refer to the samples of "SeqIO" and "SimpleIO".

Service Ports

In OpenRTM-aist Java, the auxiliary variables (<Service Name>Base) for using service ports are added. This changes on how to define and use service ports as follows. For more detail, refer to the samples of "SimpleService".

| RT-Components for Java | RT-Components for C++ |

| //Definition of Consumer protected CorbaPort m_MyServicePort; protected CorbaConsumer<MyService> m_myservice0Base = new CorbaConsumer<MyService>(MyService.class); protected MyService m_myservice0; //Registration of Consumer m_MyServiceRef = new CorbaPort("MyService"); m_MyServicePort.registerConsumer ("myservice0","MyService",m_myservice0Base); registerPort(m_MyServicePort); //Use of Consumer m_myservice0 = m_myservice0Base._ptr(); m_myservice0.echo(argv[1]); |

//Definition of Consumer RTC::CorbaPort m_MyServicePort; RTC::CorbaConsumer<MyService> m_myservice0; //Registration of Consumer m_MyServicePort = new RTC::CorbaPort("MyService"); m_MyServicePort.registerConsumer ("myservice0","MyService", m_myservice0); registerPort(m_MyServicePort); //Use of Consumer m_myservice0->echo(argv[1].c_str()); |

| //Definition of Provider protected CorbaPort m_MyServicePort; protected MyServiceSVC_impl m_myservice0 = new MyServiceSVC_impl(); //Registration of Provider m_MyServiceRef = new CorbaPort("MyService"); m_MyServicePort.registerProvider ("myservice0","MyService",m_myservice0); registerPort(m_MyServicePort); |

//Definition of Provider RTC::CorbaPort m_MyServicePort; MyServiceSVC_impl m_myservice0; //Registration of Provider m_MyServicePort = new RTC::CorbaPort("MyService"); m_MyServicePort.registerProvider ("myservice0","MyService",m_myservice0); registerPort(m_MyServicePort); |

Configuration

Holder classes are used for configurations as well as data ports. This changes the way how to define and use configuration data as follows:

| RT-Components for Java | RT-Components for C++ |

| //Definition of Configuration Variable protected IntegerHolder m_int_param0 = new IntegerHolder(); protected StringHolder m_str_param0 = new StringHolder(); protected VectorHolder m_vector_param0= new VectorHolder(); //Bind parameters bindParameter("int_param0",m_int_param_0,"0"); bindParameter("str_param0",m_str_param_0,"sample"); bindParameter("vector_param0",m_vector_param_0,"0.0,1.0,2.0,3.0,4.0"); |

//Definition of Configuration Variable int m_int_param0; str::string m_str_param0; str::vector<double> m_vector_param0; //Bind parameters bindParameter("int_param0",m_int_param_0,"0"); bindParameter("str_param0",m_str_param_0,"sample"); bindParameter("vector_param0",m_vector_param_0,"0.0,1.0,2.0,3.0,4.0"); |

Please refer to samples of "ConfigSample", about how to use configuration data.

Table 3-3 shows kinds of holder classes provided in OpenRTM-aist Java to hold configuration data, and their releations with their data types.

| Data type | Holder class |

| short | jp.go.aist.rtm.RTC.util.ShortHolder |

| int | jp.go.aist.rtm.RTC.util.IntegerHolder |

| long | jp.go.aist.rtm.RTC.util.LongHolder |

| float | jp.go.aist.rtm.RTC.util.FloatHolder |

| double | jp.go.aist.rtm.RTC.util.DoubleHolder |

| byte | jp.go.aist.rtm.RTC.util.ByteHolder |

| String | jp.go.aist.rtm.RTC.util.StringHolder |

As well OpenRTM-aist for C++, users can create any holder for configuration data which corresponds with any type they define, in OpenRTM-aist Java.

To implement a holder for configuration data, implement stringFrom method of jp.go.aist.rtm.RTC.util.ValueHolder and declare the holder implements Serializable interface in its implements clause.

"stringFrom" method of jp.go.aist.rtm.RTC.util.ValueHolder is a method to convert a string passed by its argument to its targeted data type.

Please refer to VectorHolder class in "ConfigSample" sample, about holders for configuration data.

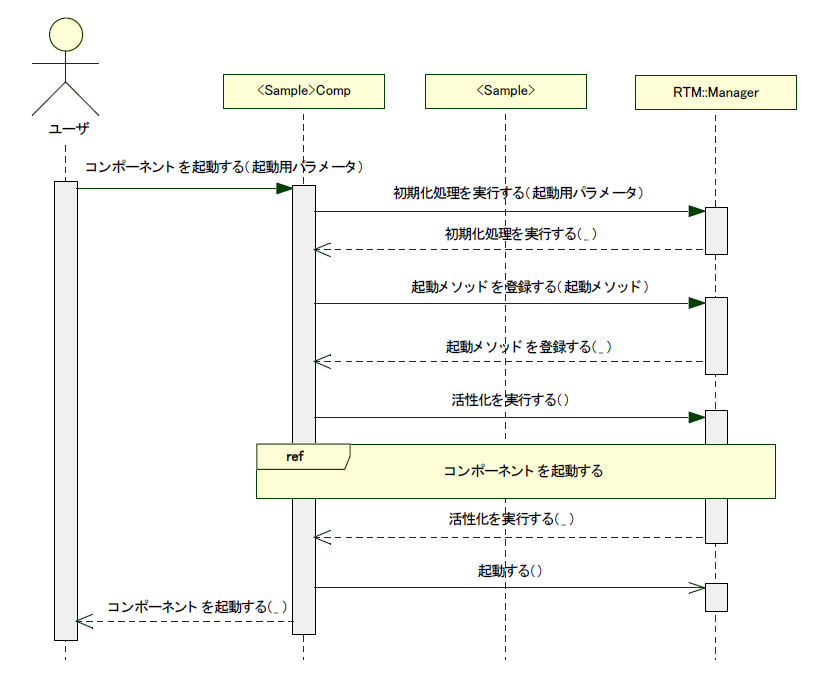

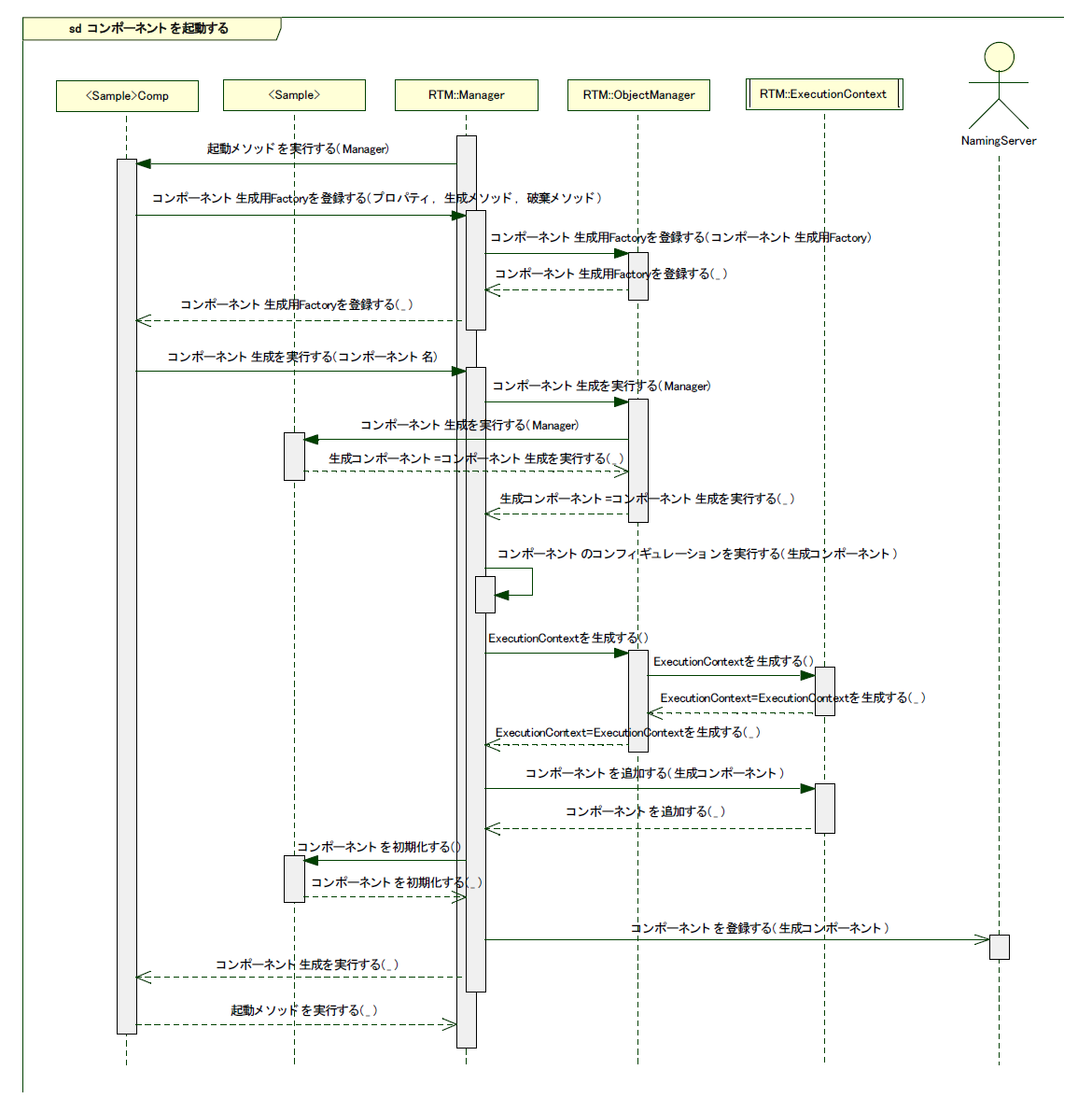

Behavior when RT-Components for Java start

Here is the behavior when RT-Components for C++ start. This is basically same as the behavior when RT-Components for Java start, however separation of main body of RT-Components for to XXXImpl classes change receivers of message which are sent when components are created and when components are initialized, to XXX classes.

Relationship between IDL data types and Java language data types

Table 3-4 shows the relationship between CORBA IDL data types and Java language data types.

| CORBA IDL | Java language |

| short | short |

| long | int |

| float | float |

| double | double |

| long long | long |

| long double | double |

| char | char |

| wchar | char |

| octet | byte |

| unsigned short | short |

| unsigned long | int |

| unsigned long long | long |

| boolean | boolean |

| string | String |

| wstring | String |

| any | org.omg.CORBA.Any |

| void | void |

Others

Tips

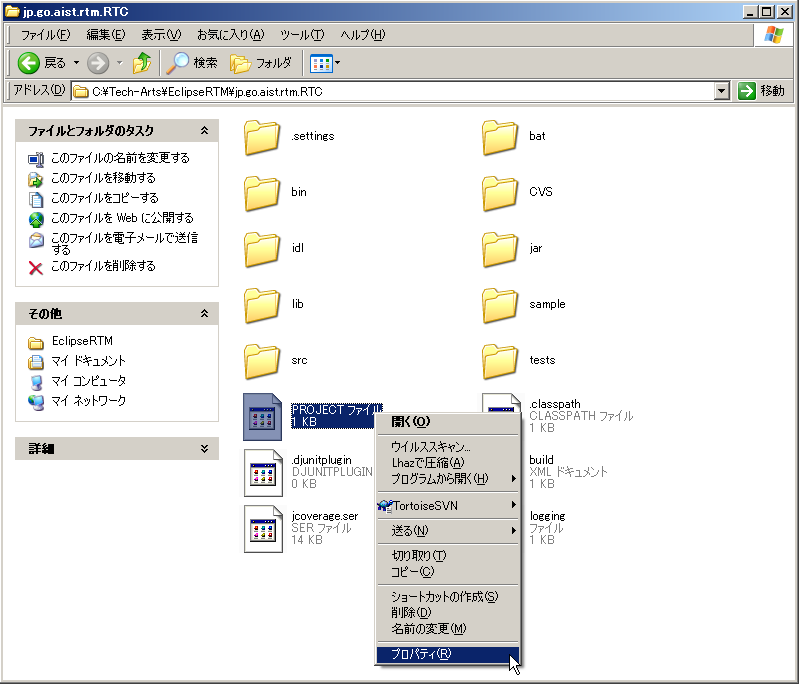

Configuration to Start up Eclipse automatically

- On Windows

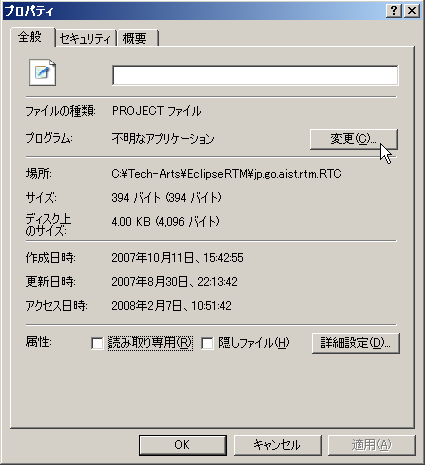

- 1. Select a ".project" file from the directory of Eclipse project, and right-click to select [Properties]from the shown context menu.

Note: you can select any Eclipse project. Fig.3-22 Selecting a ".project" file

Fig.3-22 Selecting a ".project" file

- 1. Select a ".project" file from the directory of Eclipse project, and right-click to select [Properties]from the shown context menu.

- 2. Click [Change] button which is in the right of "Program" line center at "General" tab in the displayed "Properties" dialog.

Fig.3-23 Changing an association with an application

Fig.3-23 Changing an association with an application

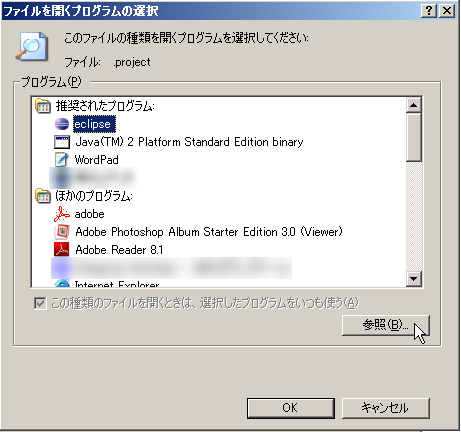

- 3. Click [Browse] button lower in "Open With" dialog.

Fig.3-24 Selecting Eclipse

Fig.3-24 Selecting Eclipse

- 4. A dialog to select a file is shown, Go to the directory in which Eclipse you want to start up automatically existes, and select "Eclipse.exe".

- 5. Press [OK] to close "Open With" dialog and "Properties" dialog.

::Once you set up as above, you can double-click a ".project" file to run the version of Eclipse you specified automatically.

|

::Note You must notice that the version you specified is always started up, even if several versions of Eclipse are installed.

|- Note When the project you clicked is not included in the workspace set up for the starting Eclipse, the project does not appear in Package Explorer of the Eclipse. In this case, you need to import the target project to the workspace, or switch to another workspace.

--On Linux

You can specify a workspace with a data option when you start up Eclipse.> eclipse ?data /home/devel/OpenRTM/workspace

- Please specify the workspace which contains the target project.

Acknowledgments

OpenRTM-aist Java was developed using the following libraries. We would like to extend out thanks to anyone who was involved in the designing and developing of these projects.

Apache Commons CLI 1.1

This product includes software developed by The Apache Software Foundation (http://www.apache.org/ ).

Development of RT Component(OpenCV Components for RTCB-RC1)

はじめに

ここでは、OpenCV ライブラリを VC9 にて RTコンポーネント化する手順を紹介します。

OpenCVとは

OpenCVとはインテルが開発・公開しているオープンソースのコンピュータービジョン向けライブラリです。

Wikipediaより抜粋。

作成する RTコンポーネント

- Flip コンポーネント: OpenCV ライブラリのうち、cvFlip() 関数を用いて画像の反転を行う RTコンポーネント。

- ObjectTracking コンポーネント: OpenCV ライブラリを使用し、マウスで選択した対象物を追跡するコンポーネント。 追跡中の画像表示、追跡画像を OutPort から出力、追跡対象の移動量を OutPort から出力などの機能を持つ。

OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

ここでは、OpenCV ライブラリのうち、画像の反転を行う cvFlip() を VC9 にて RTコンポーネント化します。

以下は、作業の流れです。

- cvFlip 関数について

- コンポーネントの概要

- 動作環境・開発環境

- Flip コンポーネントの雛型の生成

- アクティビティ処理の実装

- コンポーネントの動作確認

cvFlip 関数について

cvFlip 関数は、2次元配列を垂直、水平、または両軸で反転します。

void cvFlip(IplImage* src, IplImage* dst=NULL, int flip_mode=0); #define cvMirror cvFlip src 入力配列 dst 出力配列。もし dst=NULL であれば、src が上書きされます。 flip_mode 配列の反転方法の指定内容: flip_mode = 0: X軸周りでの反転(上下反転) flip_mode > 0: Y軸周りでの反転(左右反転) flip_mode < 0: 両軸周りでの反転(上下左右反転)

コンポーネントの概要

InPort からの入力画像を反転し OutPort から出力するコンポーネント。

反転の対象軸は、RTCのコンフィギュレーション機能を使用して flip_mode という名前のパラメーターで指定します。

flip_mode は、反転したい方向に応じて下記のように指定してください。

- 上下反転したい場合、0

- 左右反転したい場合、1