RTコンポーネントの作成

RTコンポーネント作成の基本

データポートのあるコンポーネント

ここでは、データポートのあるコンポーネントを二つ作成し、二つのコンポーネント間でデータの送受信を行ってみます。 作成するコンポーネントの仕様は以下の通りです。

- コンポーネント1

- OutPort を一つもつ

- OutPort のデータ型は TimedLong

- コンソールから入力した値を OutPort から出力

- コンポーネント2

- InPort を一つ持つ

- InPort のデータ型は TimeLong

- コンフィギュレーションパラメーターを一つ持つ

- コンフィギュレーションパラーメーターは int型

- コンフィギュレーションパラーメーターのデフォルト値は1

- InPort 変数から読み出すときはパラメーターを掛けた値を読み出す

- InPort から読み出した値をコンソールへ出力

rtc-template によるソース生成

上記の仕様を持つコンポーネントを作成する為に以下のようなシェルスクリプトを gen.sh という名前で用意します。

#!/bin/sh rtc-template -bcxx --module-name=ConsoleIn --module-type='DataFlowComponent' --module-desc='Console input component' --module-version=1.0 --module-vendor='MyName' --module-category=example --module-comp-type=DataFlowComponent --module-act-type=SPORADIC --module-max-inst=10 --outport=out:TimedLong rtc-template -bcxx --module-name=ConsoleOut --module-type='DataFlowComponent' --module-desc='Console output component' --module-version=1.0 --module-vendor='MyName' --module-category=example --module-comp-type=DataFlowComponent --module-act-type=SPORADIC --module-max-inst=10 --inport=in:TimedLong --config="multiply:int:1"

最初の rtc-template の実行でコンポーネント1:ConsoleInComp、次の rtc-template の実行でコンポーネント2:ConsoleOutComp が作成されます。

> sh gen.sh File "ConsoleIn.h" was generated. File "ConsoleIn.cpp" was generated. File "ConsoleInComp.cpp" was generated. File "Makefile.ConsoleIn" was generated. File "ConsoleInComp_vc8.vcproj" was generated. File "ConsoleIn_vc8.vcproj" was generated. File "ConsoleInComp_vc9.vcproj" was generated. File "ConsoleIn_vc9.vcproj" was generated. File "ConsoleIn_vc8.sln" was generated. File "ConsoleIn_vc9.sln" was generated. File "copyprops.bat" was generated. File "user_config.vsprops" was generated. File "README.ConsoleIn" was generated. File "ConsoleIn.yaml" was generated. File "ConsoleOut.h" was generated. File "ConsoleOut.cpp" was generated. File "ConsoleOutComp.cpp" was generated. File "Makefile.ConsoleOut" was generated. File "ConsoleOutComp_vc8.vcproj" was generated. File "ConsoleOut_vc8.vcproj" was generated. File "ConsoleOutComp_vc9.vcproj" was generated. File "ConsoleOut_vc9.vcproj" was generated. File "ConsoleOut_vc8.sln" was generated. File "ConsoleOut_vc9.sln" was generated. "copyprops.bat" already exists. Overwrite? (y/n)y File "copyprops.bat" was generated. "user_config.vsprops" already exists. Overwrite? (y/n)y File "user_config.vsprops" was generated. File "README.ConsoleOut" was generated. File "ConsoleOut.yaml" was generated.

ConsoleIn の実装

生成されたソースを編集して、ConsoleIn コンポーネントを実装していきます。

ConsoleIn.h

このコンポーネントはアクティブ化されたときに、入力待ちを行い入力された値を OutPort から出力するコンポーネントです。 従って、アクティブ状態の時にループ実行される onExecute メンバ関数のみ実装すればよいので、生成された ConsoleIn.h を以下のようにコメントアウトされている onExecute 関数のコメントをはずします。

:略

// The execution action that is invoked periodically

// former rtc_active_do()

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

:略また、ConsoleIn.h の下の方に、rtc-template で指定した OutPort の変数宣言があります。

:略 // DataOutPort declaration // <rtc-template block="outport_declare"> TimedLong m_out; OutPort<TimedLong> m_outOut; // </rtc-template>

TimedLong m_out と宣言されているのが、OutPort にバインドされる変数。

OutPort<TimedLong> m_outOut と宣言されているのが、OutPort のインスタンスです。

ConsoleIn.cpp

ConsoleInの 実装は簡単です。 コメントアウトされている onExecute のコメントをはずし、以下のように実装します。

RTC::ReturnCode_t ConsoleIn::onExecute(RTC::UniqueId ec_id)

{

std::cout << "Please input number: ";

std::cin >> m_out.data;

std::cout << "Sending to subscriber: " << m_out.data << std::endl;

m_outOut.write();

return RTC::RTC_OK;

}- cin >> m_out.data でユーザーからの入力待ちをする。

- 入力された値を、m_out.data(long型) へ格納

- 入力された値を確認の為表示

- m_outOut.write() で OutPort からデータを出力。

ConsoleOut の実装

ConsoleOut コンポーネントは少し複雑です。 InPort に入ってきたデータにコンフィギュレーションパラメーター multiply を掛けた値を格納しなければなりません。 これは、InPort にコールバックオブジェクトをセットするという方法で実現できます。

コールバックオブジェクト

コールバックオブジェクトとは、InPort や OutPort のバッファにあるイベントが発生したときに呼ばれるoperator()が定義されたオブジェクトです。 今回は、InPort のバッファに書き込まれるときに値を変換する為のコールバック OnWriteConvert を使用します。

RTC::OnWriteConvert を継承して以下のようなクラスを定義します。

class Multiply

: public RTC::OnWriteConvert<RTC::TimedLong>

{

int& m_mul;

public:

Multiply(int& multiply) : m_mul(multiply) {};

RTC::TimedLong operator()(const RTC::TimedLong& value)

{

RTC::TimedLong ret(value);

ret.data = value.data * m_mul;

return ret;

};

};ConsoleOut.h

上記のコールバッククラスを ConsoleOut.h の include の行の直後に挿入します。 さらに、このコールバッククラスのインスタンスを ConsoleOut クラスのメンバ変数として宣言します。 場所は、private のすぐ下辺りでよいでしょう。

private: Multiply m_owc; int dummy;

このコンポーネントはアクティブ化されたときに、InPort からデータを読み込み標準出力にデータを表示するコンポーネントです。 従って、アクティブ状態の時にループ実行される onExecute メンバ関数のみ実装すればよいので、生成された ConsoleOut.h を以下のようにコメントアウトされている onExecute 関数のコメントをはずします。

:略

// The execution action that is invoked periodically

// former rtc_active_do()

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

:略また、ConsoleOut.h の下の方に、rtc-template で指定したコンフィギュレーション変数の宣言と InPort の変数宣言があります。

ConsoleOut では InPort のバッファとして RingBuffer を使用するので、RingBuffer.h をインクルードする必要があります。 ConsoleOut.h の先頭部分をで以下のように RingBuffer.h をインクルードしてください。

#include <rtm/idl/BasicDataTypeSkel.h> #include <rtm/Manager.h> #include <rtm/DataFlowComponentBase.h> #include <rtm/CorbaPort.h> #include <rtm/DataInPort.h> #include <rtm/DataOutPort.h> #include <rtm/RingBuffer.h> //これを追加する

また、InPort の宣言部分でデフォルトでは InPort<TimedLong> m_inIn となっているところを InPort<TimedLong, RTC::RingBuffer> m_inIn のように書き換えて、InPort が RingBuffer を使用するように変更してください。

:略

// Configuration variable declaration

// <rtc-template block="config_declare">

int m_multiply;

// </rtc-template>

// DataInPort declaration

// <rtc-template block="inport_declare">

TimedLong m_in;

InPort<TimedLong, RTC::RingBuffer> m_inIn;int m_multiplyと宣言されているのが、コンフィギュレーション「multiply」にバインドされる変数。

TimedLong m_in と宣言されているのが、InPort にバインドされる変数。

InPort<TimedLong> m_inIn と宣言されているのが、InPort のインスタンスです。ConsoleOut.cpp

ConsoleOutクラスのコンストラクタで、先ほど定義した Multiply のインスタンスの初期化を追加します。

ConsoleOut::ConsoleOut(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

// <rtc-template block="initializer">

m_inIn("in", m_in),

// </rtc-template>

m_owc(m_multiply),

dummy(0)「m_owc(m_multiply),dummy(0)」 の部分を追加するだけでなく、「m_inIn("in", m_in)」を「m_inIn("in", m_in),」と変更することも忘れずに(カンマ「,」の追加もれに注意)。

さらに、コールバックオブジェクトを InPort に追加する為、コンストラクタ内で以下のように記述します。

m_inIn.setOnWriteConvert(&m_owc); //これを追加

// Registration: InPort/OutPort/Service

// <rtc-template block="registration">

// Set InPort buffers

registerInPort("in", m_inIn);コメントアウトされている onExecute のコメントをはずし、以下のように実装します。

RTC::ReturnCode_t ConsoleOut::onExecute(RTC::UniqueId ec_id)

{

if (m_inIn.isNew())

{

m_inIn.read();

std::cout << "Received: " << m_in.data << std::endl;

std::cout << "TimeStamp: " << m_in.tm.sec << "[s] ";

std::cout << m_in.tm.nsec << "[ns]" << std::endl;

}

usleep(1000);

return RTC::RTC_OK;

}- m_inIn.isNew() で InPort にデータが入ってきているかチェックする。

- isNew() というメンバ関数は RingBuffer に定義されている関数です。

- 新しいデータが入っていたら、m_inIn.read() で変数にデータを読み込む。

- そのデータ (m_in.data) を表示する。

コンパイル

実装が終わったら以下のようにソースをコンパイルします。

> make -f Makefile.ConsoleIn > make -f Makefile.ConsoleOut

コンパイルエラーが出た場合はスペルミスなどがないかどうかチェックして再度コンパイルを行ってください。

実行

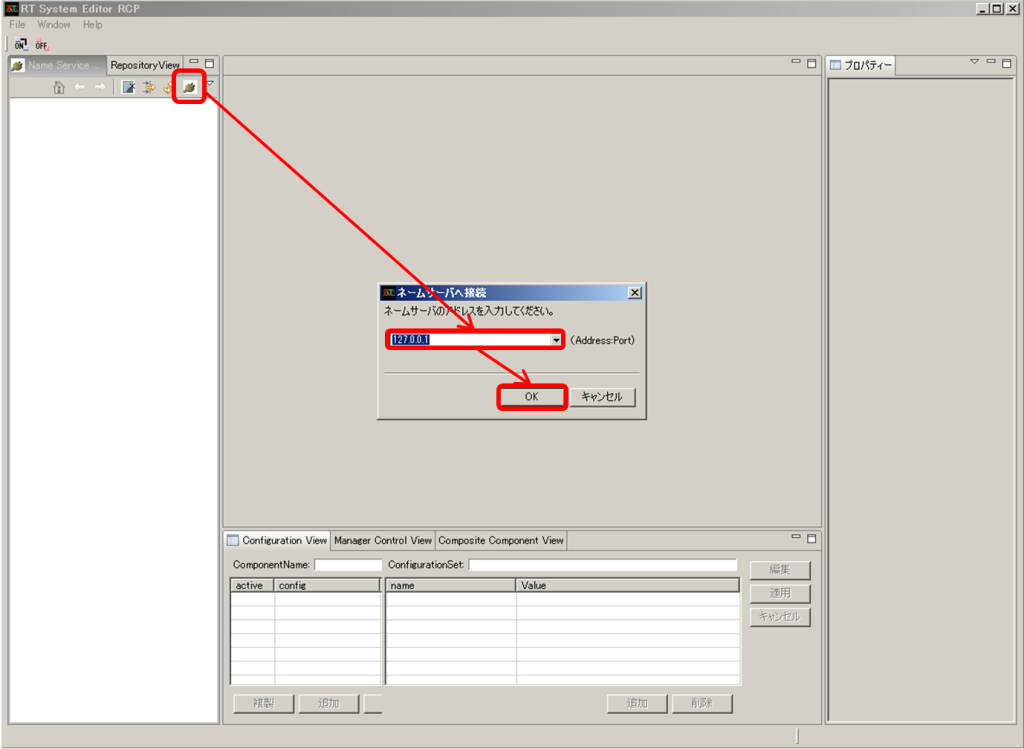

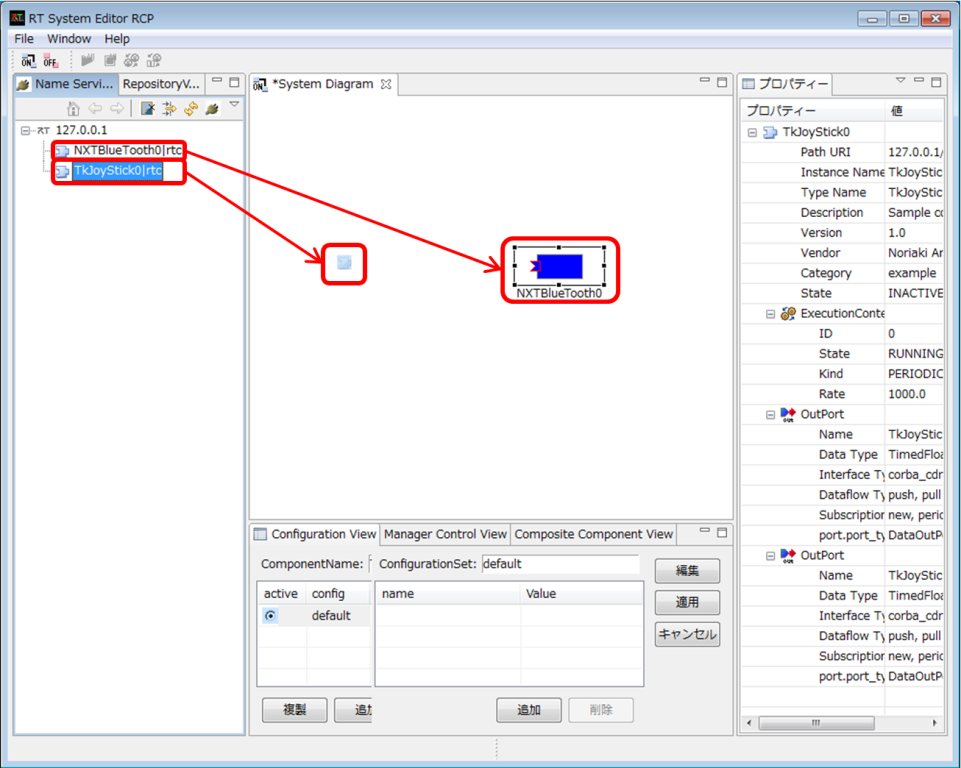

- ネームサーバ起動していることを確認します。

- 適切な rtc.conf * を作成しておきます。

* 適切な rtc.conf とは… 次に一例をしめします。corba.nameservers: localhost naming.formats: %h.host_cxt/%n.rtc

- 二つのターミナルから、ConsoleInComp および ConsoleOutComp を実行します。

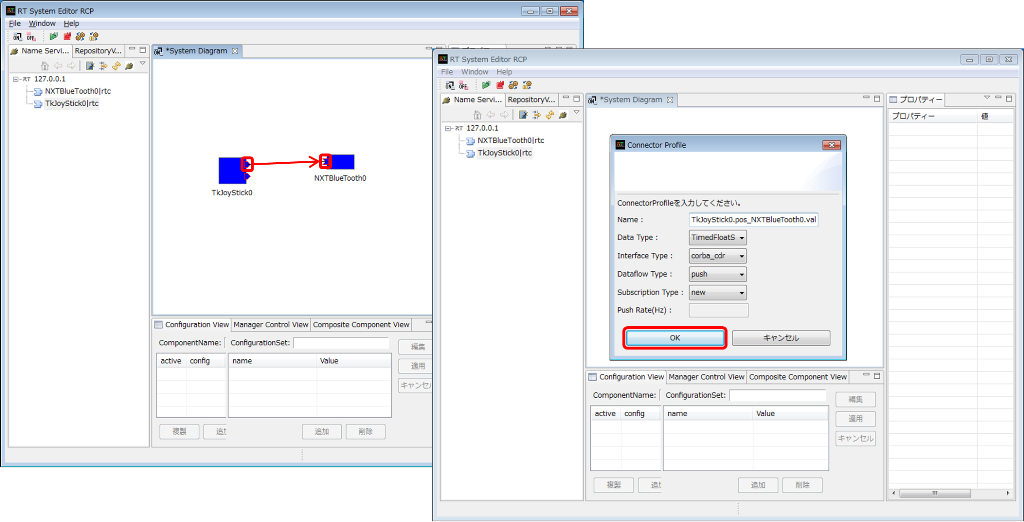

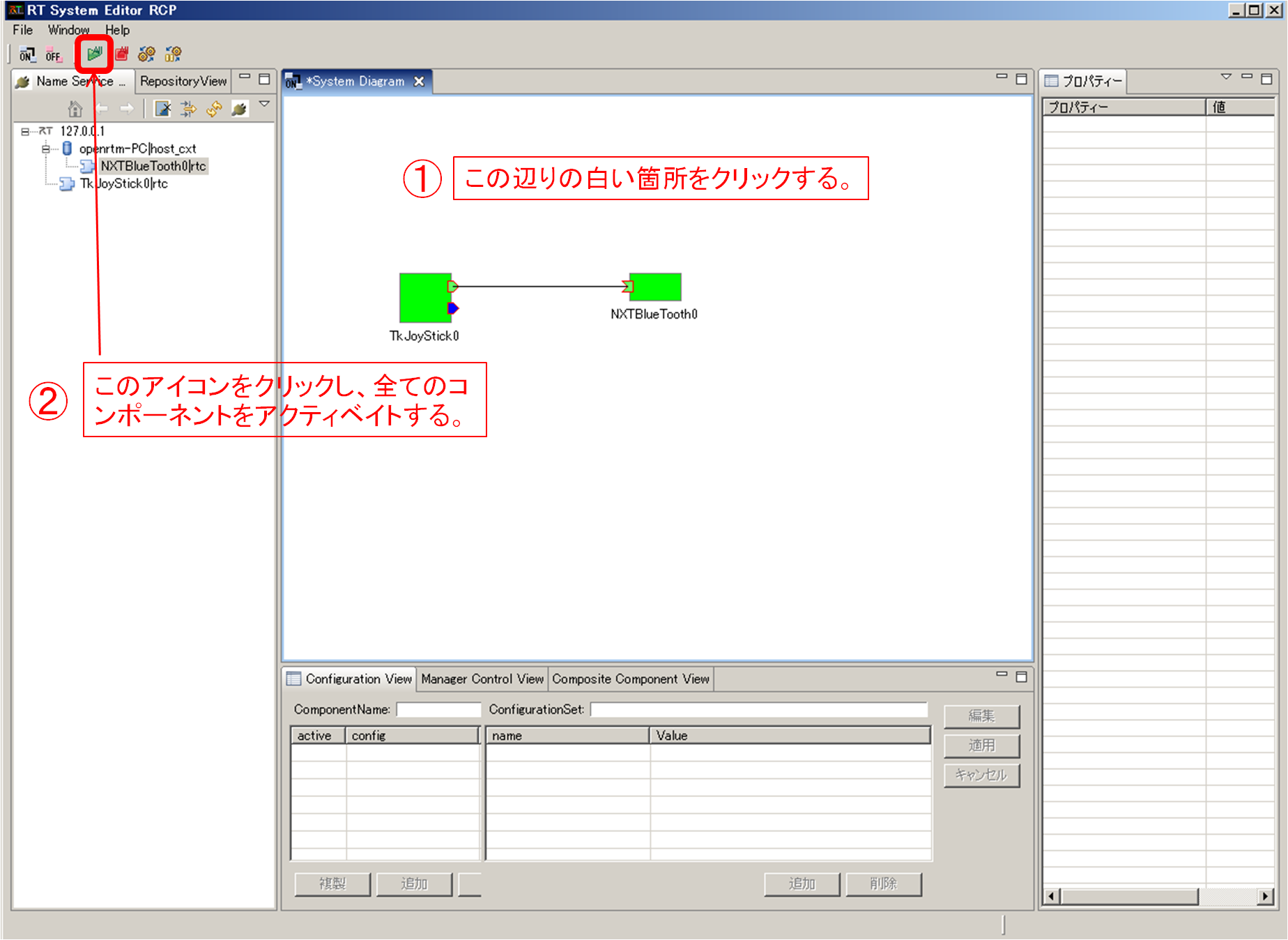

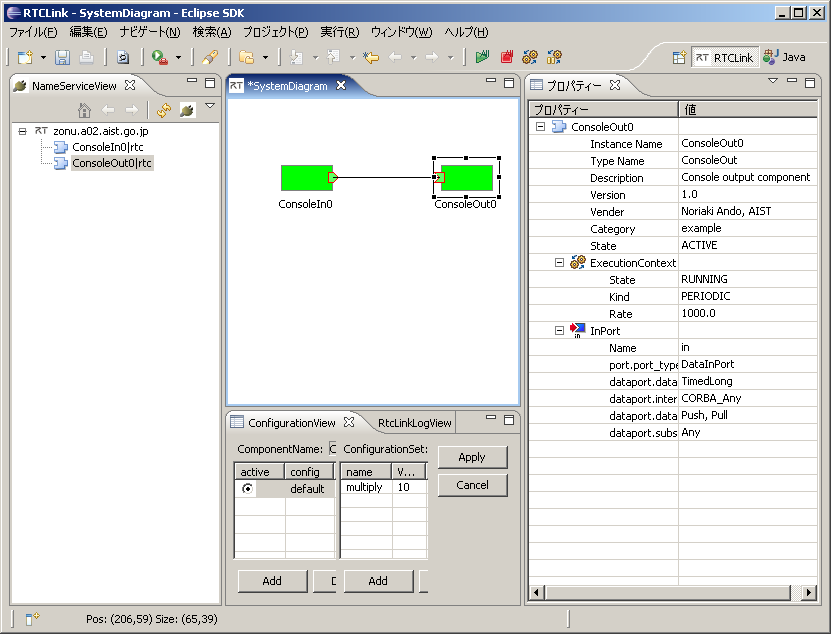

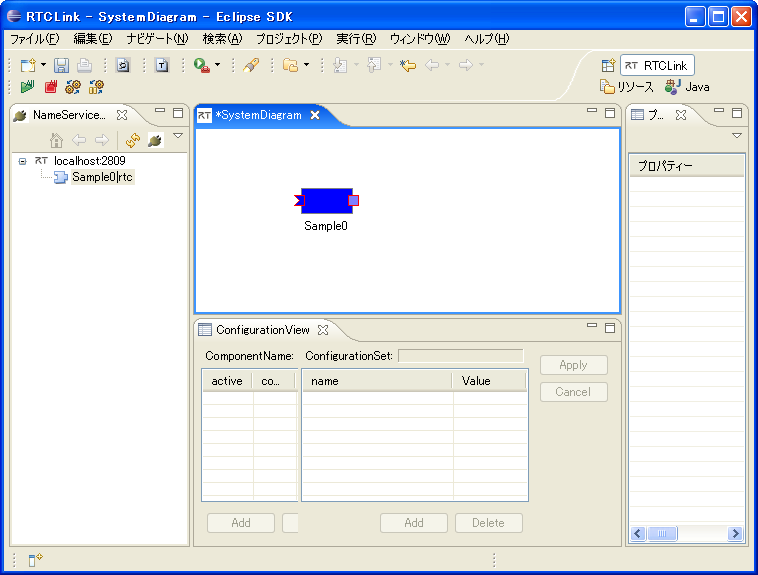

- RtcLink を起動して、二つのコンポーネントを接続し、アクティブ化します。

ConsoleIn を実行したターミナルで、入力を促す Please input number: という表示が出るので、適当な数字を入力します。

Please input number: 1 Sending to subscriber: 1 Please input number: 2 Sending to subscriber: 2 Please input number: 3 Sending to subscriber: 3

ConsoleOut を実行したターミナルでは、以下のように表示されるはずです。

Received: 1 TimeStamp: 0[s] 0[ns] Received: 2 TimeStamp: 0[s] 0[ns] Received: 3 TimeStamp: 0[s] 0[ns]

次に RtcLink のコンフィギュレーションビューで multiply の値を10に変更してみましょう。すると、ConsoleIn から上記のように入力すると、以下のようにそれぞれ10倍された値が出力されるはずです。

Received: 10 TimeStamp: 0[s] 0[ns] Received: 20 TimeStamp: 0[s] 0[ns] Received: 30 TimeStamp: 0[s] 0[ns]

RTコンポーネント作成(OpenCV編 CameraImage型の使用)

- はじめに

- OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

はじめに

ここでは、OpenCV ライブラリを VC9 にて RTコンポーネント化する手順を紹介します。

OpenCV とは

OpenCV とはインテルが開発・公開しているオープンソースのコンピュータービジョン向けライブラリです。

Wikipedia より抜粋。

作成する RTコンポーネント

- Flip コンポーネント: OpenCV ライブラリのうち、cvFlip() 関数を用いて画像の反転を行う RTコンポーネント。

OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

ここでは、OpenCV ライブラリのうち、画像の反転を行う cvFlip() を VC9 にて RTコンポーネント化します。

以下は、作業の流れです。

- cvFlip 関数について

- コンポーネントの概要

- 動作環境・開発環境

- Flip コンポーネントの雛型の生成

- アクティビティ処理の実装

- コンポーネントの動作確認

cvFlip 関数について

cvFlip 関数は、2次元配列を垂直、水平、または両軸で反転します。

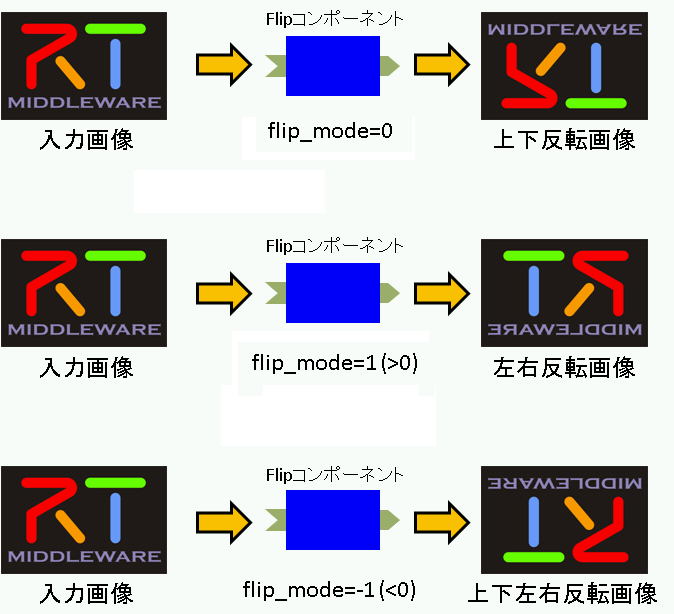

void cvFlip(IplImage* src, IplImage* dst=NULL, int flip_mode=0); #define cvMirror cvFlip src 入力配列 dst 出力配列。もし dst = NULL であれば、src が上書きされます。 flip_mode 配列の反転方法の指定内容: flip_mode = 0: X軸周りでの反転(上下反転) flip_mode > 0: Y軸周りでの反転(左右反転) flip_mode < 0: 両軸周りでの反転(上下左右反転)

コンポーネントの概要

InPort からの入力画像を反転し OutPort から出力するコンポーネント。

反転の対象軸は、RTC のコンフィギュレーション機能を使用して flipMode という名前のパラメーターで指定します。

flipMode は、反転したい方向に応じて下記のように指定してください。

- 上下反転したい場合、0

- 左右反転したい場合、1

- 上下左右反転したい場合、-1

作成する RTC の仕様は以下のとおりです。

- InPort

- キャプチャーされた画像データ (CameraImage)

- OutPort

- 反転した画像データ (CameraImage)

- Configuration

- 反転方法の指定 (int)

※ CameraImage型は、OpenRTM-aist の InterfaceDataTypes.idl にて下記のように定義されているデータ型です。

struct CameraImage

{

/// Time stamp.

Time tm;

/// Image pixel width.

unsigned short width;

/// Image pixel height.

unsigned short height;

/// Bits per pixel.

unsigned short bpp;

/// Image format (e.g. bitmap, jpeg, etc.).

string format;

/// Scale factor for images, such as disparity maps,

/// where the integer pixel value should be divided

/// by this factor to get the real pixel value.

double fDiv;

/// Raw pixel data.

sequence<octet> pixels;

};

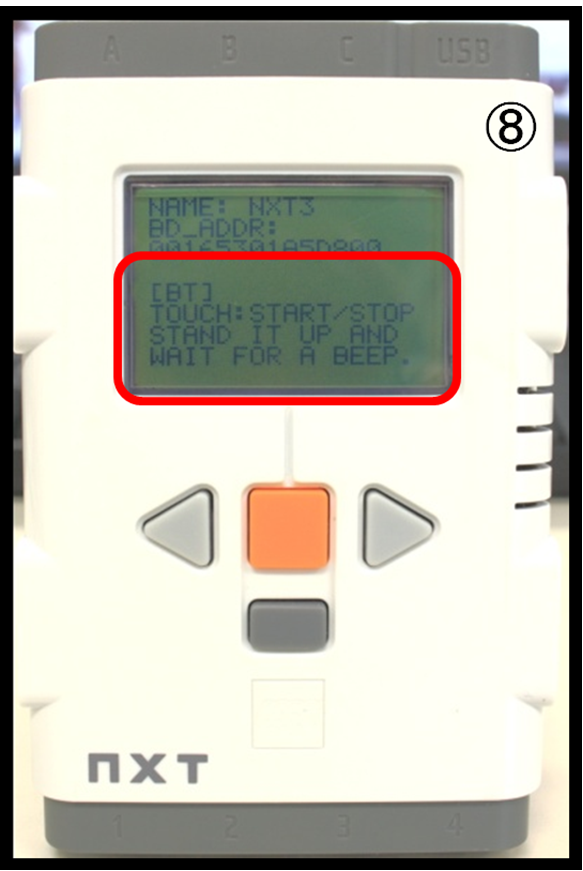

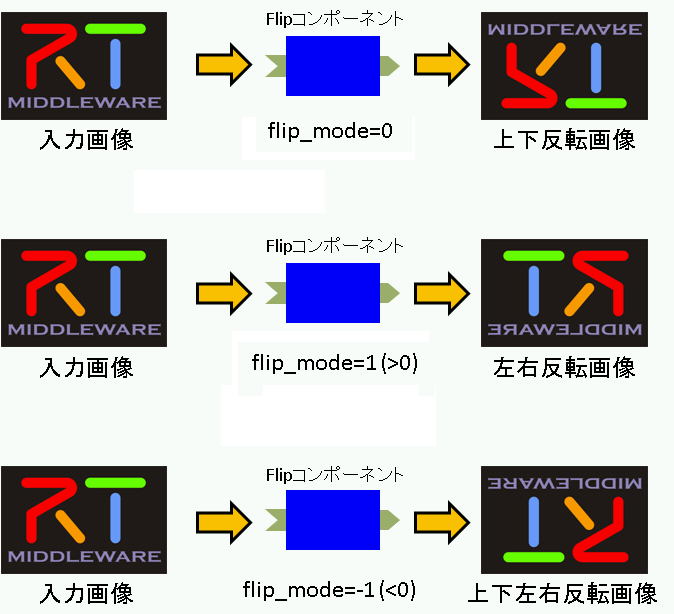

図1は、それぞれの flipMode での画像処理のイメージ図です。

動作環境・開発環境

- OS: Windows XP SP3

- コンパイラ: Visual C++ 2008 Express Edition 日本語版

- RTSystemEditor 1.0

- RTCBuilder 1.0

Flip コンポーネントの雛型の生成

Flip コンポーネントの雛型の生成は、RTCBuilder を用いて行います。

RTCBuilder の起動

新規ワークスペースを指定して Eclipse を起動すると、以下のような「ようこそ」画面が表示されます。

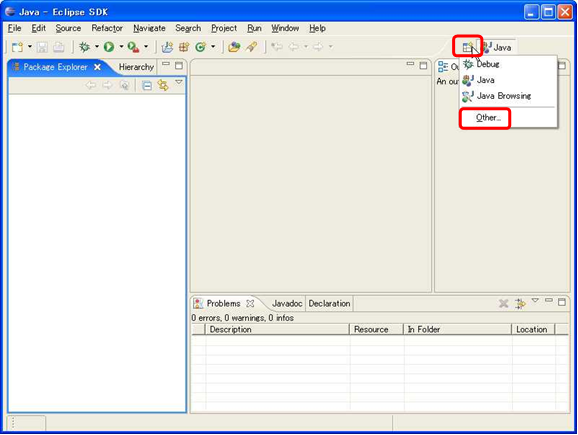

この「ようこそ」画面左上の「X」をクリックして画面を閉じると、以下の画面が表示されます。 右上の [Open Perspective] ボタンをクリックし、プルダウンの「Other…」を選択します。

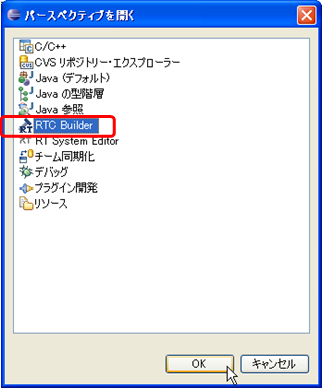

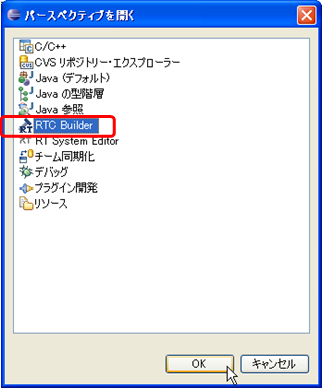

「RTC Builder」を選択し、[OK] ボタンをクリックします。

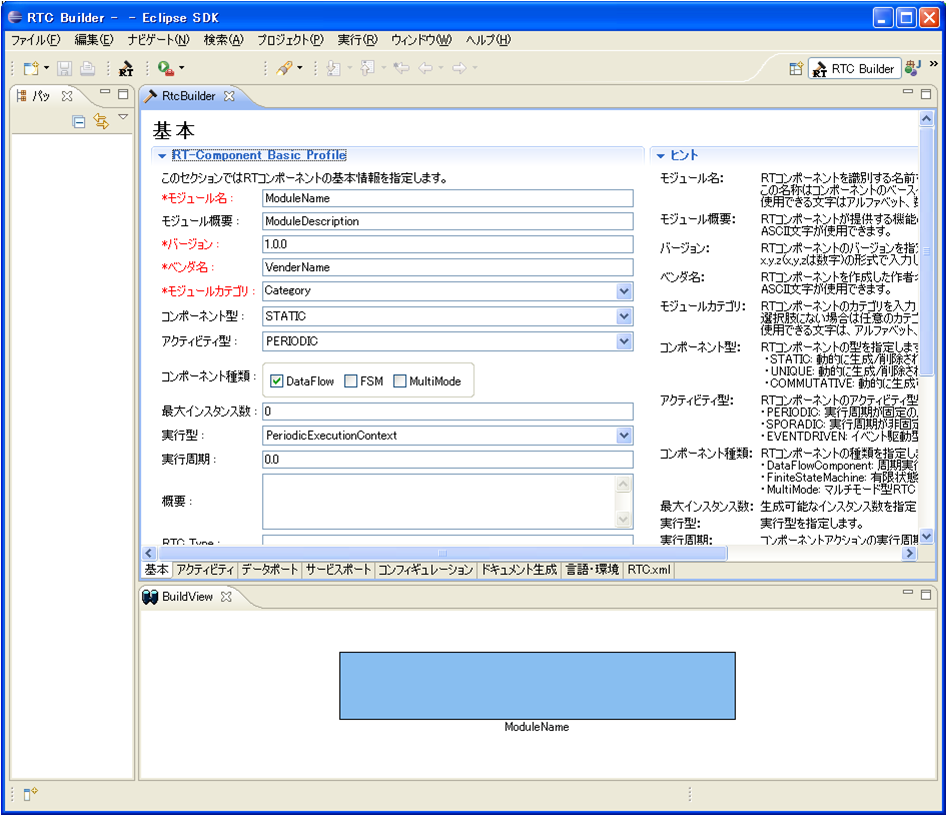

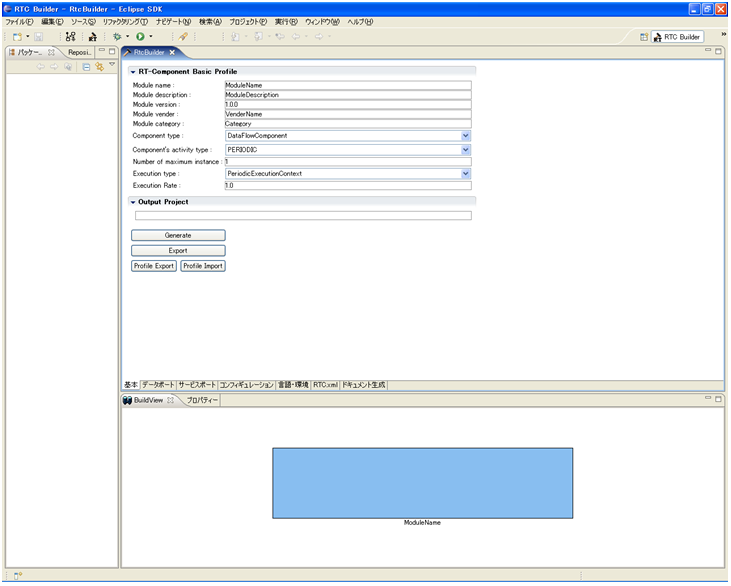

RTCBuilder が起動します。

RTCBuilder用 プロジェクトの作成

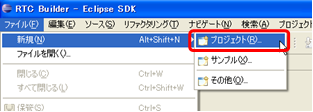

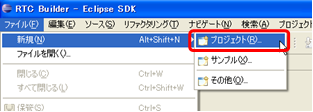

まず最初に,RT コンポーネントを作成するための Eclipse プロジェクトを作成します。 画面上部のメニューから [ファイル] > [新規] > [プロジェクト] を選択します。

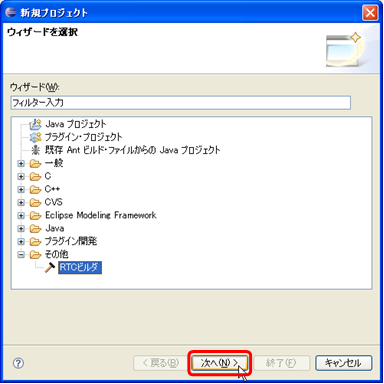

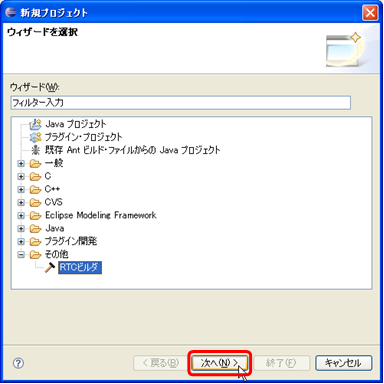

表示された「新規プロジェクト」画面において、[その他] > [RTC ビルダ] を選択し、[次へ] をクリックします。

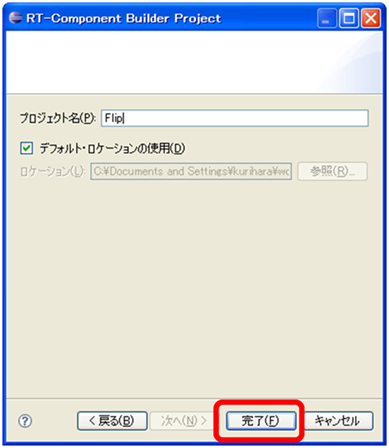

「プロジェクト名」欄に作成するプロジェクト名を入力して [完了] をクリックします。

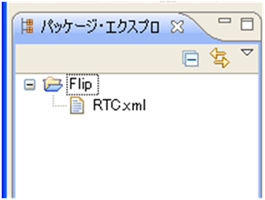

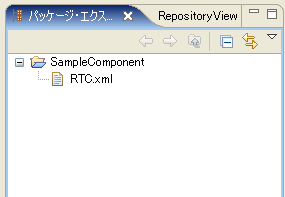

指定した名称のプロジェクトが生成され、パッケージエクスプローラー内に追加されます。

生成したプロジェクト内には、デフォルト値が設定された RTC プロファイル XML(RTC.xml) が自動的に生成されます。

RTC プロファイルエディタの起動

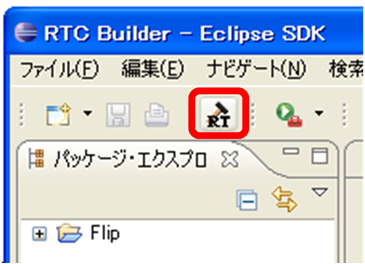

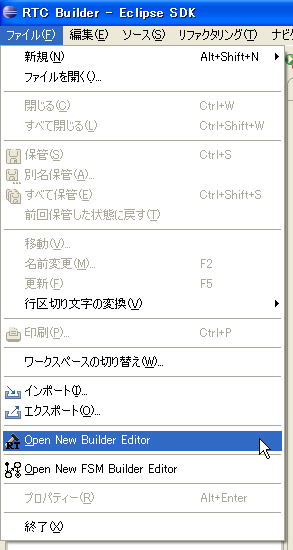

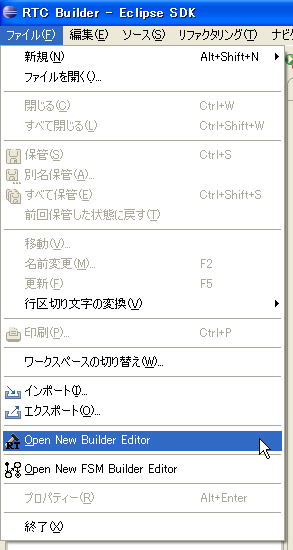

RTC プロファイルエディタを開くには、ツールバーの「 [Open New RtcBuilder Editor] ボタンをクリックするか、メニューから [ファイル] > [Open New Builder Editor] を選択します。

コンポーネントのプロファイル情報入力とコードの生成

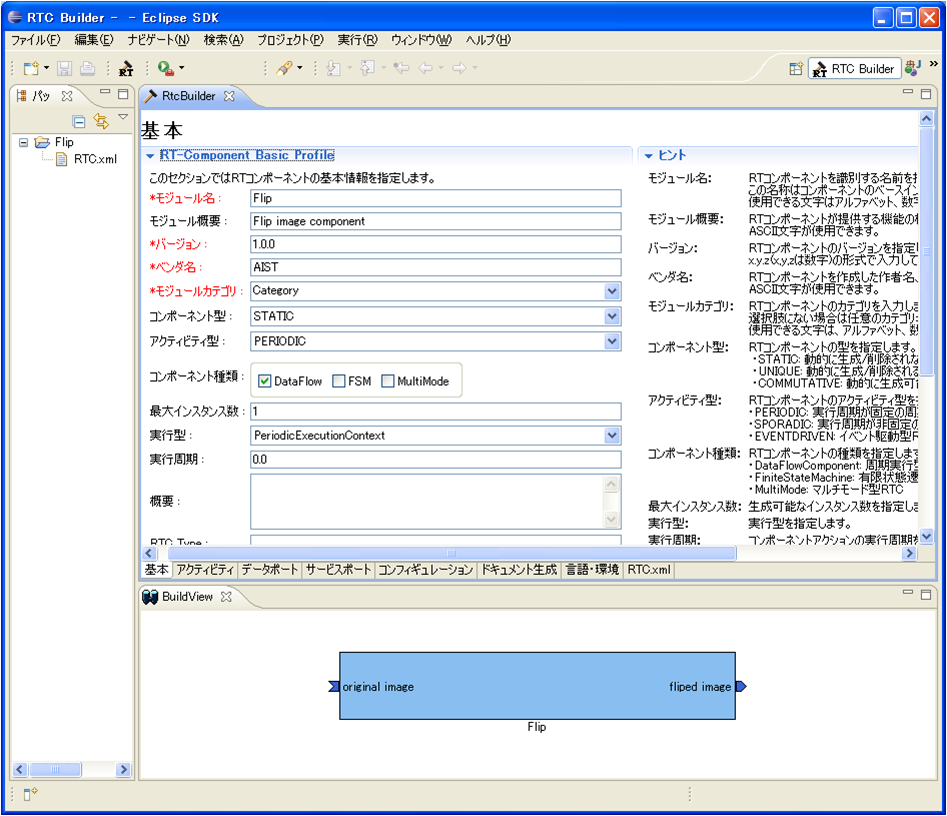

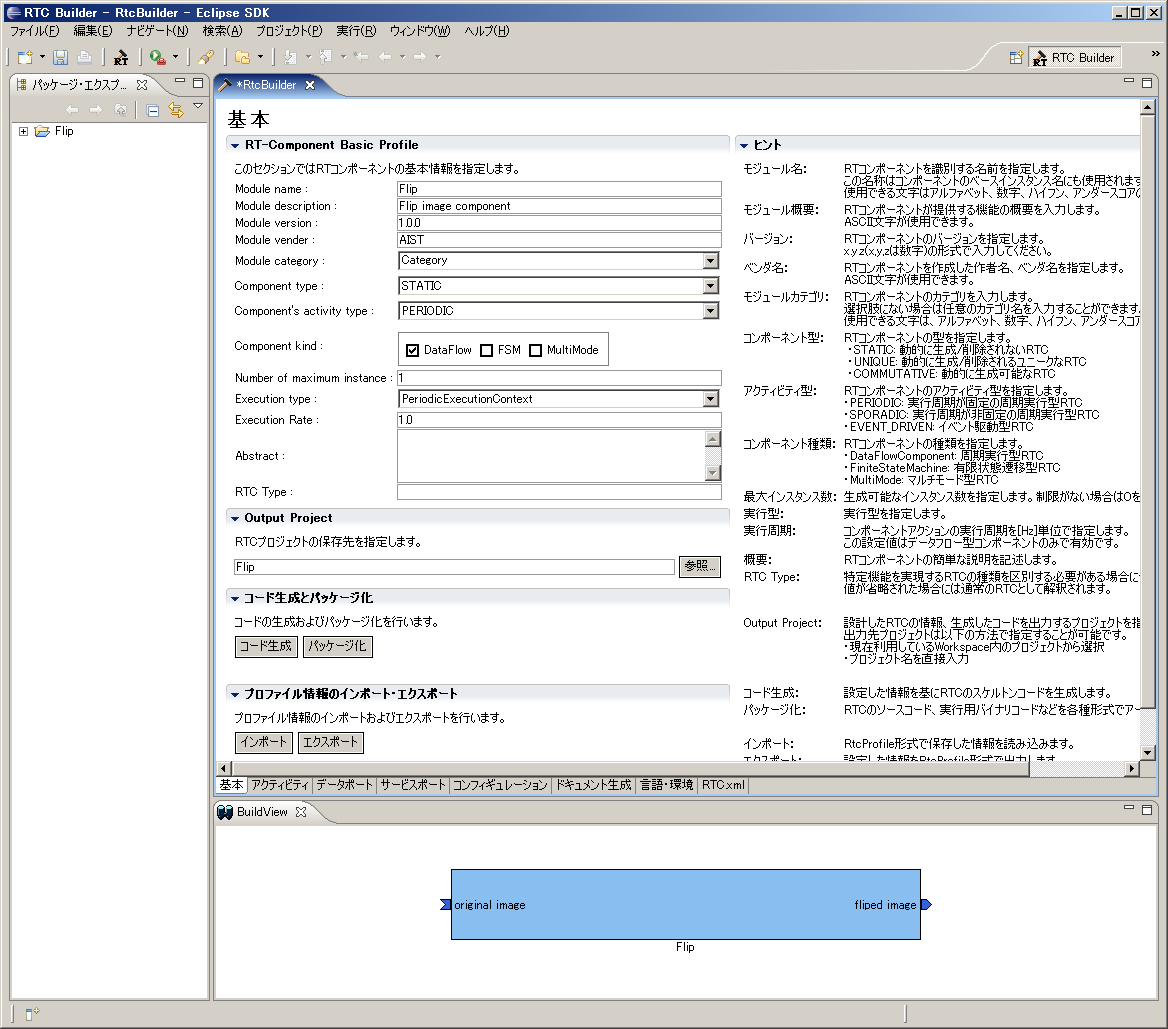

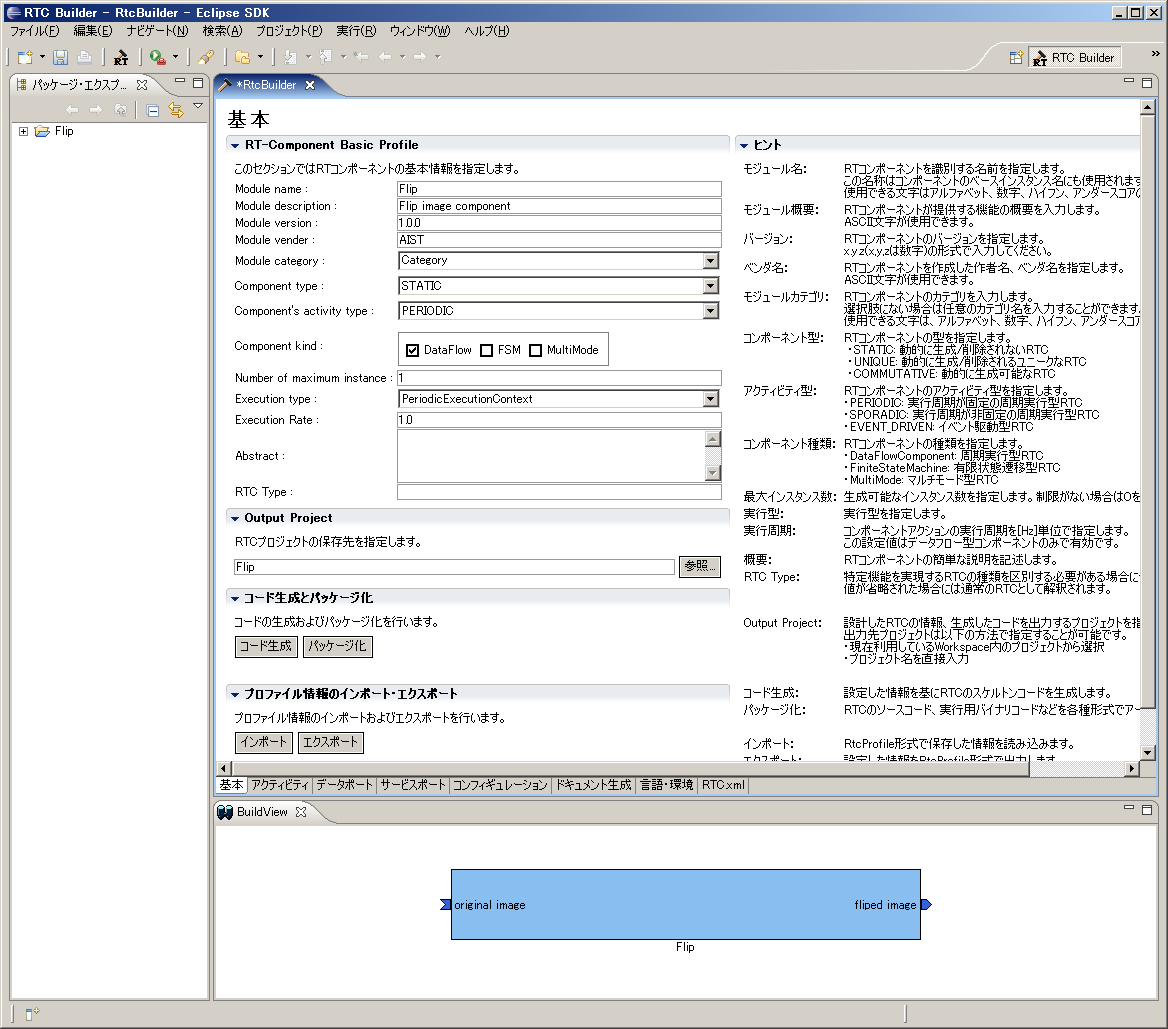

1. 「基本」タブを選択し、基本情報を入力します。

-モジュール名: Flip

- モジュール概要: Flip image component

- バージョン: 1.0.0

- ベンダ名: AIST

- モジュールカテゴリ: Category

- コンポーネント型: STATIC

- アクティビティ型: PERIODIC

- コンポーネント種類: DataFlowComponent

- 最大インスタンス数: 1

- 実行型: PeriodicExecutionContext

- 実行周期: 0.0 (図13では1.0となってますが,0.0として下さい.)

-Output Project: Flip

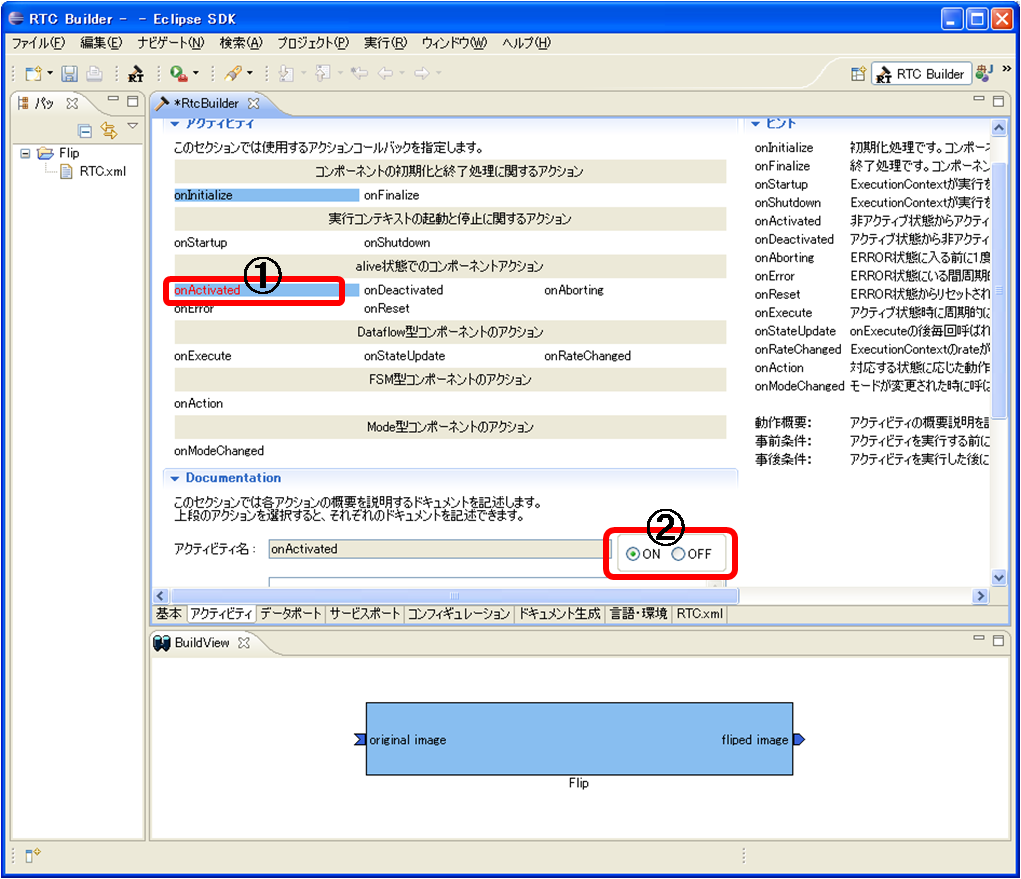

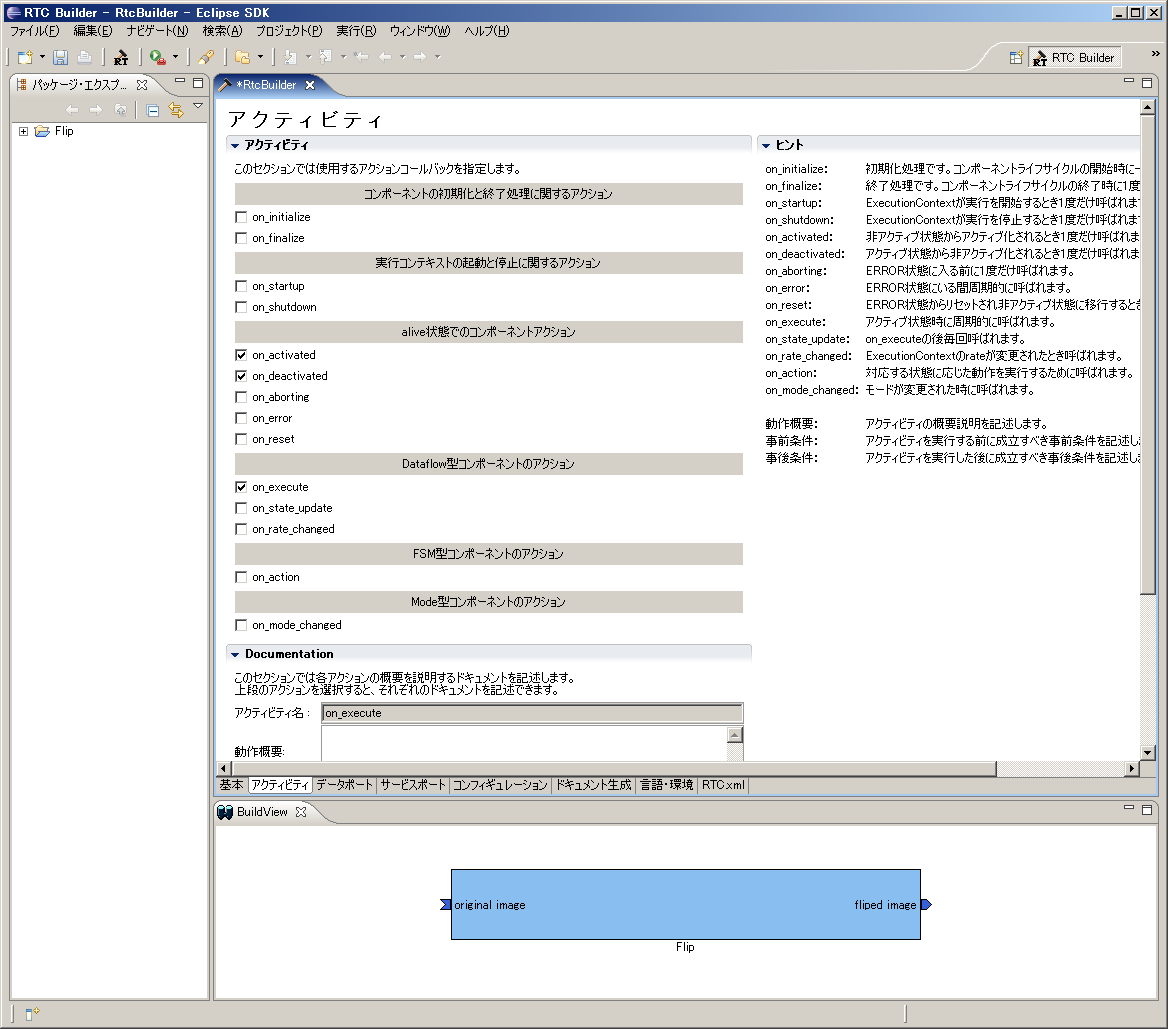

2. 「アクティビティ」タブを選択し、使用するアクションコールバックを指定します。

Flip コンポーネントでは、onActivated()、onDeactivated()、onExecute()コ ールバックを使用します。 図14のように①の onAtivated をクリック後に ②のラジオボタンの [ON] にチェックを入れます。onDeactivated、onExecute についても同様の操作を行います。

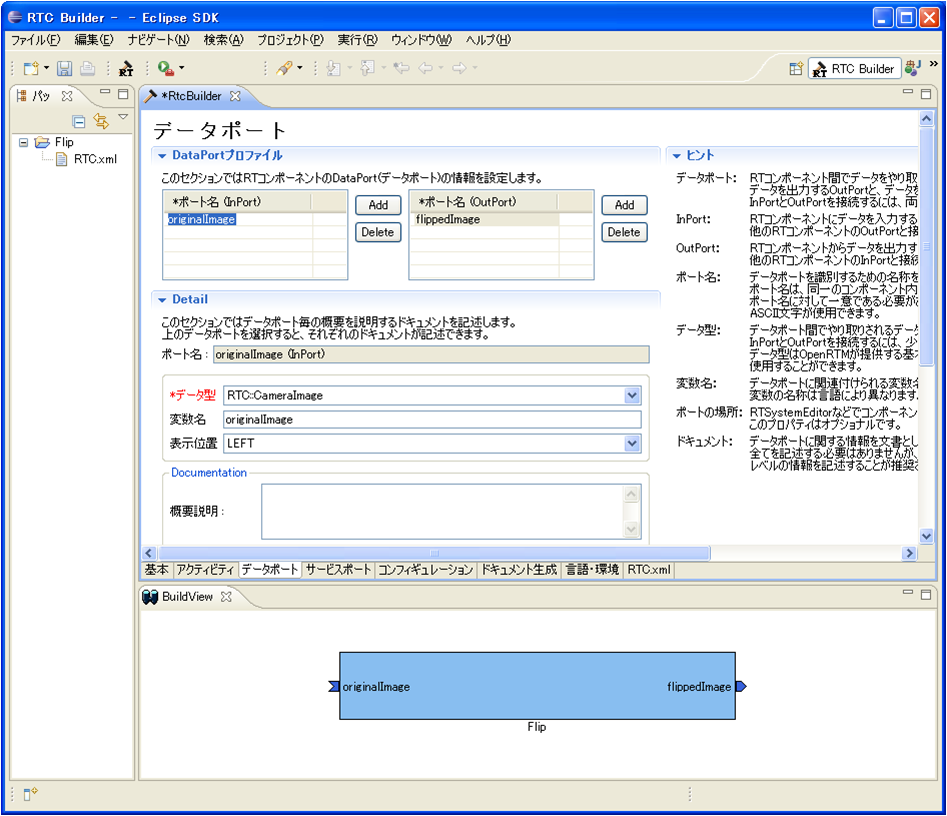

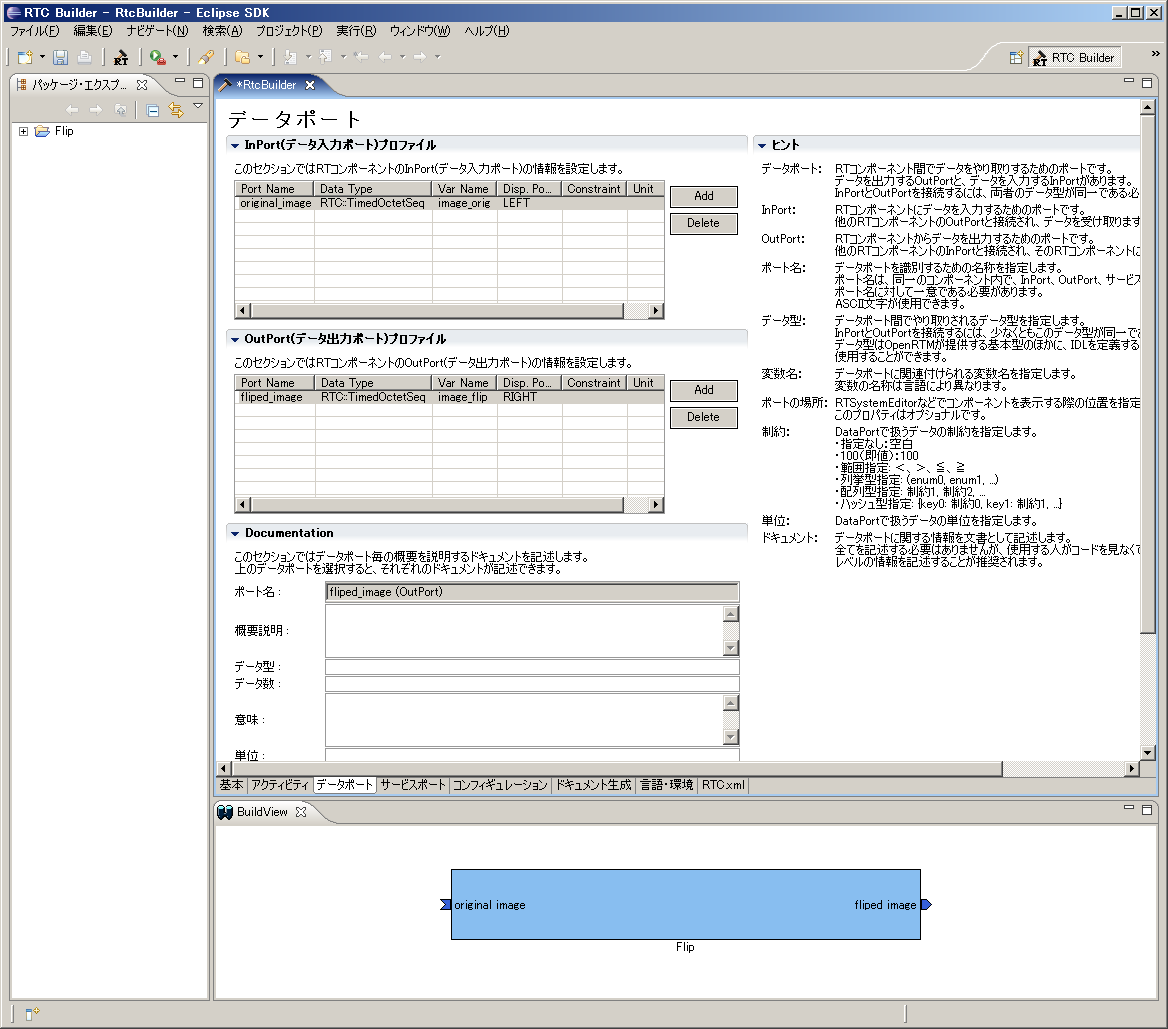

3. 「データポート」タブを選択し、データポートの情報を入力します。

-InPort Profile:

- ポート名: originalImage

- データ型: CameraImage

- 変数名: originalImage

- 表示位置: left

-OutPort Profile: - ポート名: flippedImage

- データ型: CameraImage

- 変数名: flippedImage

- 表示位置: right

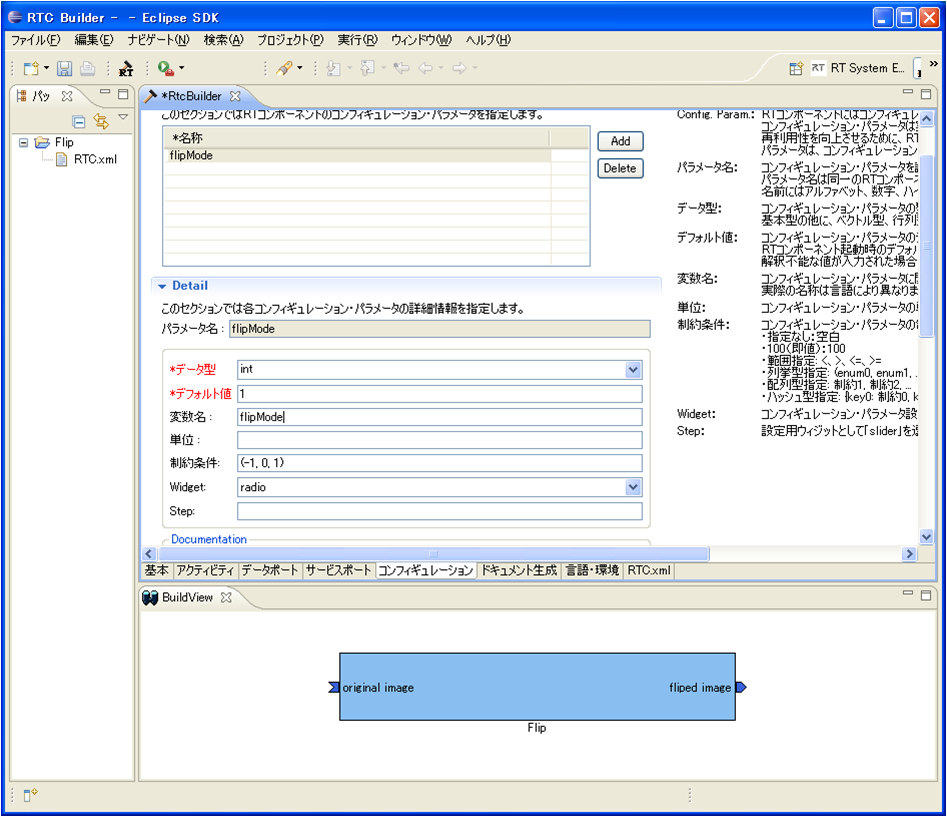

4. 「コンフィギュレーション」タブを選択し、Configuration の情報を入力します。

ラジオボタンでコンフィギュレーションの変更を行います。

-flipMode

- 名称: flipMode

- データ型: int

- デフォルト値: 1

- 変数名: flipMode

- 制約条件: (-1, 0, 1) ※ (-1: 上下左右反転, 0: 上下反転, 1: 左右反転)

- Widget: radio

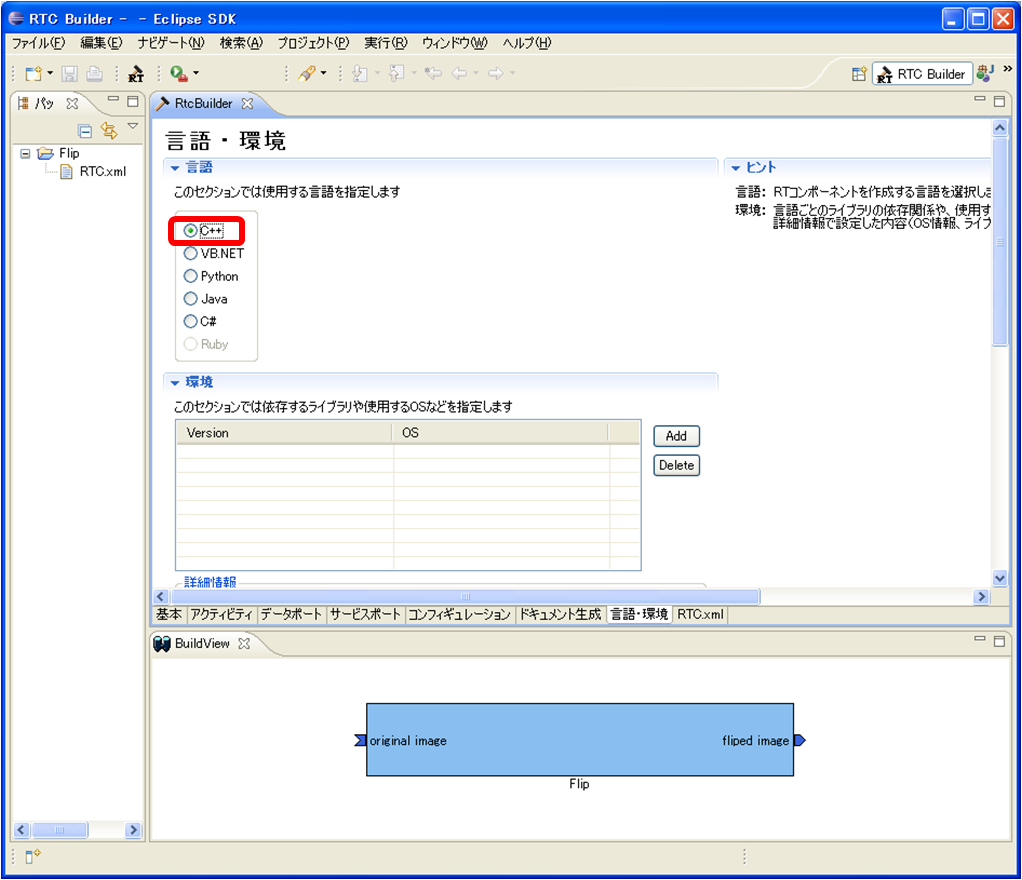

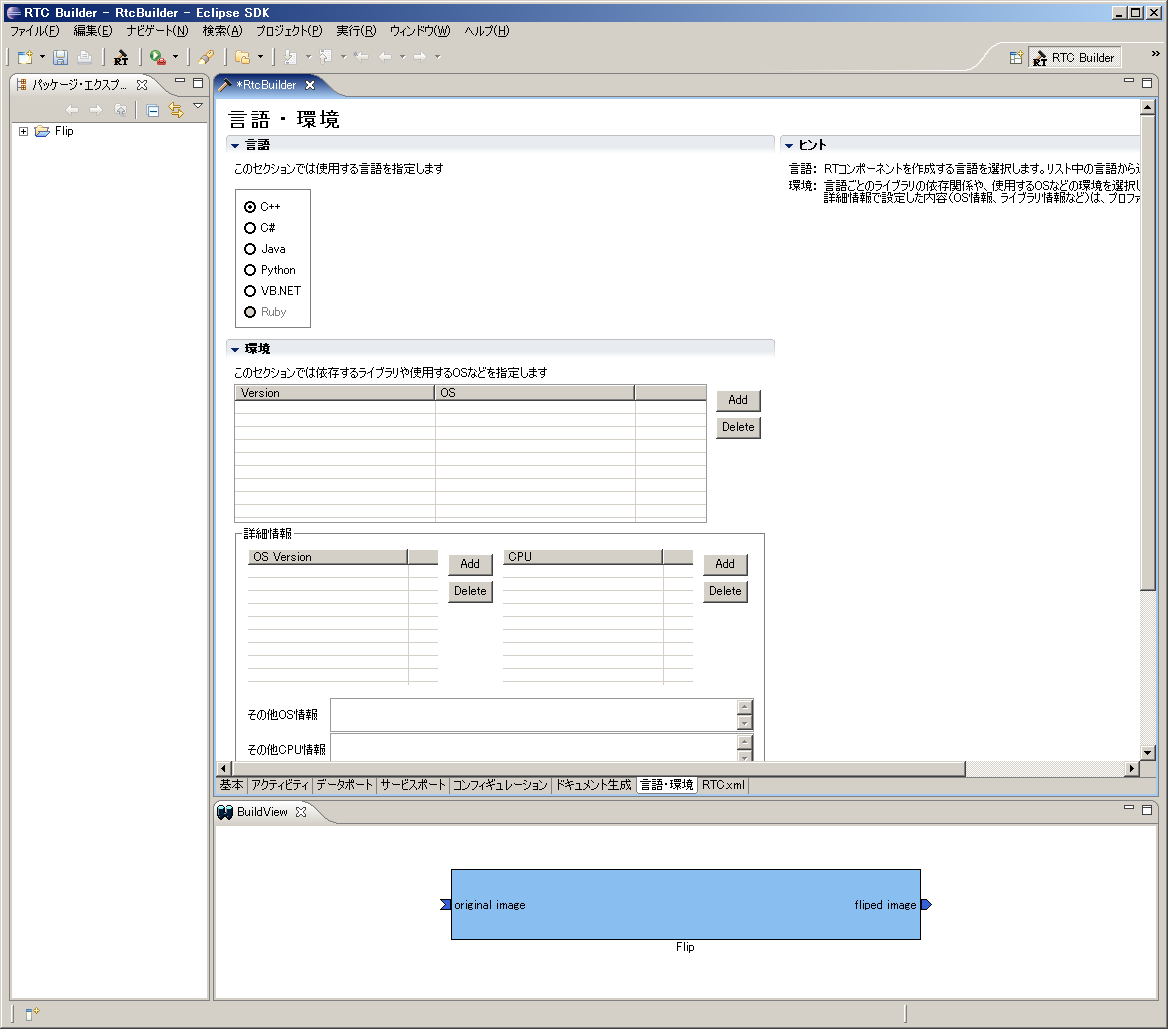

5. 「言語・環境」タブを選択し、プログラミング言語を選択します。

今回は、C++(言語)を選択します。

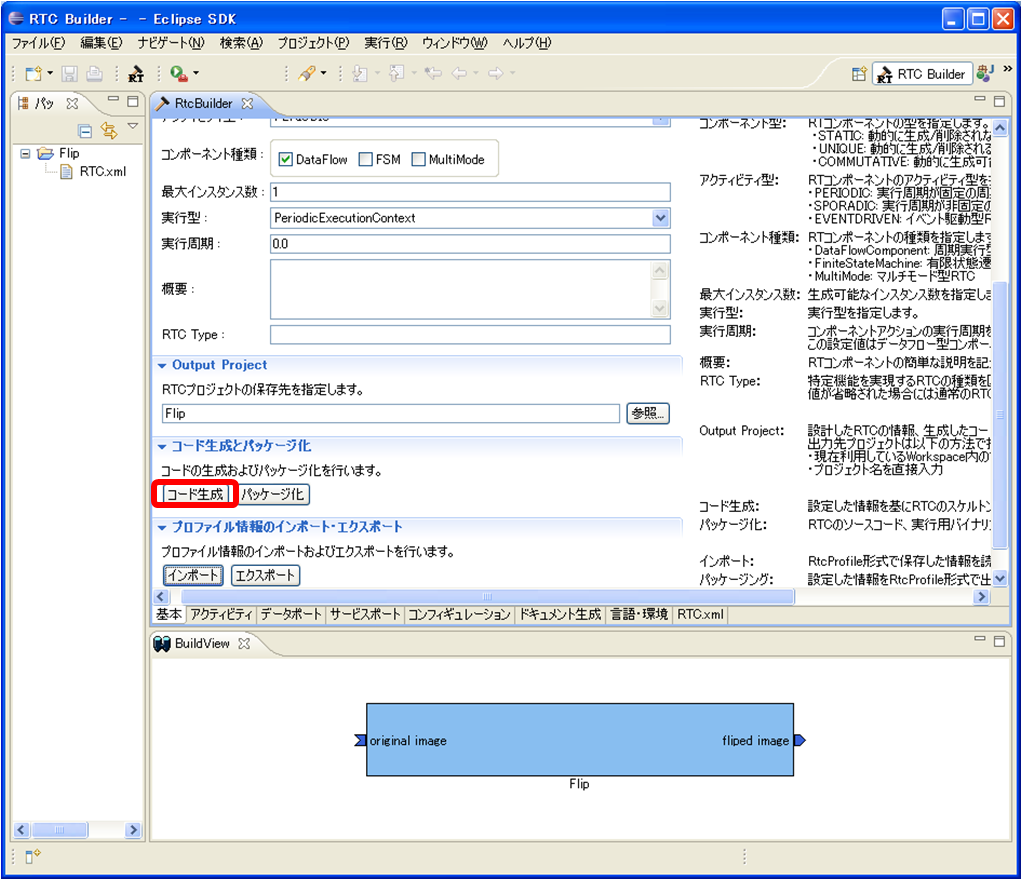

6. 「基本」タブにある [コード生成] ボタンをクリックし、コンポーネントの雛型を生成します。

※ 生成されるコード群は、Eclipse 起動時に指定したワークスペースフォルダーの中に生成されます。現在のワークスペースは、[ファイル] > [ワークスペースの切り替え] で確認することができます。

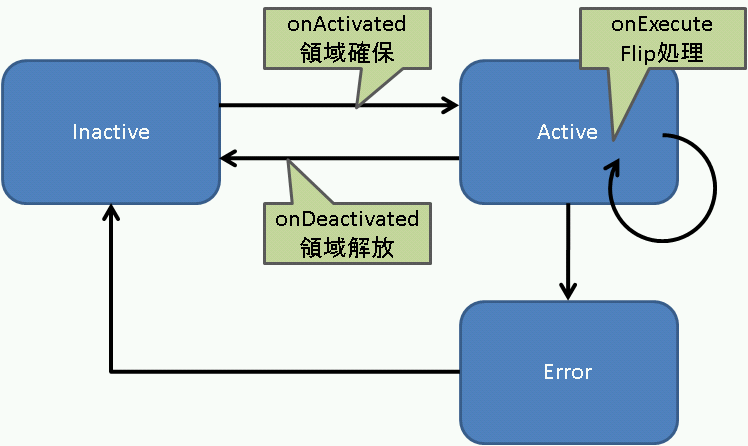

アクティビティ処理の実装

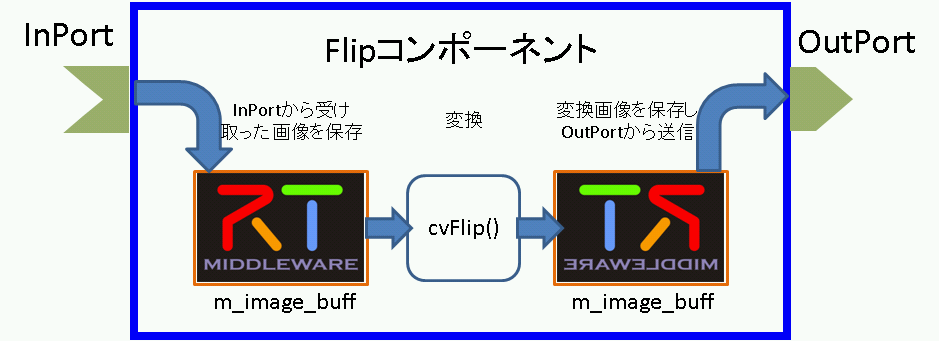

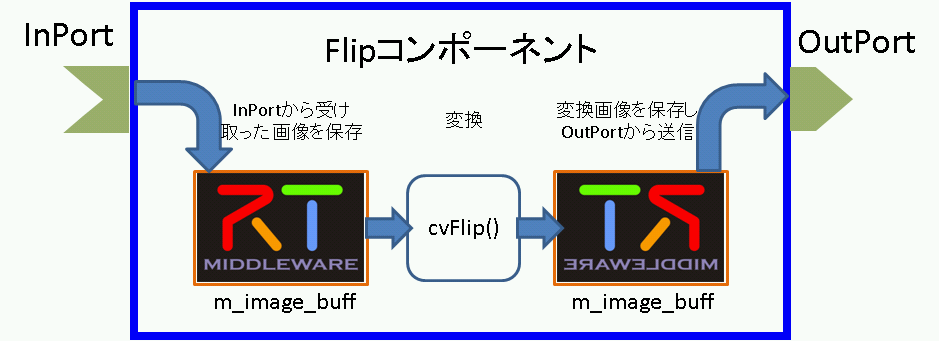

Flip コンポーネントでは、InPort から受け取った画像を画像保存用バッファに保存し、その保存した画像を OpenCV の cvFlip() 関数にて変換します。その後、変換された画像を OutPort から送信します。

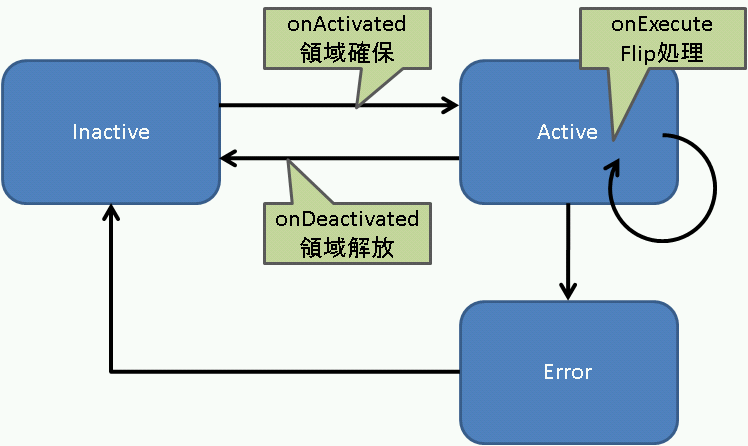

onActivated()、onExecute()、onDeactivated() での処理内容を図19に示します。

onExecute() での処理を図20に示します。

OpenCV用 ユーザープロパティシートのコピー

プロパティシートとは、コンパイルに必要な種々のオプション(インクルードパス、ライブラリロードバス、ライブラリ)やマクロを記述した VC の設定ファイルの一種です。 RTCBuilder や rtc-template で生成した VC用のプロジェクトでは、VC のプロパティシートを使用して各種オプションを与えています。また、ユーザーが追加でオプションを追加できるように、ユーザー定義のプロパティシートもインクルードするようになっています。- rtm_config.vsprop:OpenRTM に関する情報を含むプロパティシート。インストールされている OpenRTM-aist に依存するファイルであるため、copyprops.bat を使用して OpenRTM のシステムディレクトリーからカレントのプロジェクトへコピーします。

- user_config.vsprops:ユーザー定義のプロパティシート。デフォルトは空です。使い方は、ソースコード:OpenRTM-aist/win32/OpenRTM-aist/example/USBCamera の中に入っているuser_config.vsprops (OpenCV用の設定)を参考にしてください。

以下の内容を user_config.vsprops というファイル名で保存し、Flip フォルダーにコピーしてください。

もしくは、下記より vsprops ファイルをダウンロードし、Flip フォルダーに保存してください。

※ 既に Flip フォルダーには user_config.vsprops ファイルが存在していますが、上書きして構いません。

<?xml version="1.0" encoding="shift_jis"?>

<VisualStudioPropertySheet

ProjectType="Visual C++"

Version="8.00"

Name="OpenCV21"

>

<Tool

Name="VCCLCompilerTool"

AdditionalIncludeDirectories="$(cv_includes)"

/>

<Tool

Name="VCLinkerTool"

AdditionalLibraryDirectories="$(cv_libdir)"

/>

<UserMacro

Name="user_lib"

Value="$(cv_lib)"

/>

<UserMacro

Name="user_libd"

Value="$(cv_libd)"

/>

<UserMacro

Name="cv_root"

Value="C:\OpenCV2.1"

/>

<UserMacro

Name="cv_includes"

Value=""$(cv_root)\include\opencv""

/>

<UserMacro

Name="cv_libdir"

Value=""$(cv_root)\lib""

/>

<UserMacro

Name="cv_bin"

Value="$(cv_root)\bin"

/>

<UserMacro

Name="cv_lib"

Value="cv210.lib cvaux210.lib highgui210.lib cxcore210.lib"

/>

<UserMacro

Name="cv_libd"

Value="cv210d.lib cvaux210d.lib highgui210d.lib cxcore210d.lib"

/>

</VisualStudioPropertySheet>copyprops.bat の実行

copyprops.batというファイルを実行することで、rtm_config.vspropsというファイルがコピーされます。

rtm_config.vspropsファイルは、RTコンポーネントをVC++でビルドするために必要なインクルードパスやリンクするライブラリ等が記述されたファイルです。

ヘッダファイルの編集

- OpenCV のライブラリを使用するため、OpenCV のインクルードファイルをインクルードします。

//OpenCV 用インクルードファイルのインクルード #include<cv.h> #include<cxcore.h> #include<highgui.h>

- この cvFlip コンポーネントでは、画像領域の確保、Flip 処理、確保した画像領域の解放のそれぞれの処理を行います。これらの処理は、それぞれ onActivated()、onDeactivated()、onExecute() のコールバック関数にて行います。

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);- 反転した画像の保存用にメンバー変数を追加します。

IplImage* m_imageBuff; IplImage* m_flipImageBuff;

ソースファイルの編集

下記のように、onActivated()、onDeactivated()、onExecute() を実装します。

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの初期化

m_imageBuff = NULL;

m_flipImageBuff = NULL;

// OutPort の画面サイズの初期化

m_flippedImage.width = 0;

m_flippedImage.height = 0;

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

if(m_imageBuff != NULL)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_originalImageIn.isNew()) {

// InPort データの読み込み

m_originalImageIn.read();

// InPort と OutPort の画面サイズ処理およびイメージ用メモリーの確保

if( m_originalImage.width != m_flippedImage.width || m_originalImage.height != m_flippedImage.height)

{

m_flippedImage.width = m_originalImage.width;

m_flippedImage.height = m_originalImage.height;

// InPort のイメージサイズが変更された場合

if(m_imageBuff != NULL)

{

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

// イメージ用メモリーの確保

m_imageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

m_flipImageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

}

// InPort の画像データを IplImage の imageData にコピー

memcpy(m_imageBuff->imageData,(void *)&(m_originalImage.pixels[0]),m_originalImage.pixels.length());

// InPort からの画像データを反転する。 m_flipMode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_imageBuff, m_flipImageBuff, m_flipMode);

// 画像データのサイズ取得

int len = m_flipImageBuff->nChannels * m_flipImageBuff->width * m_flipImageBuff->height;

m_flippedImage.pixels.length(len);

// 反転した画像データを OutPort にコピー

memcpy((void *)&(m_flippedImage.pixels[0]),m_flipImageBuff->imageData,len);

// 反転した画像データを OutPort から出力する。

m_flippedImageOut.write();

}

return RTC::RTC_OK;

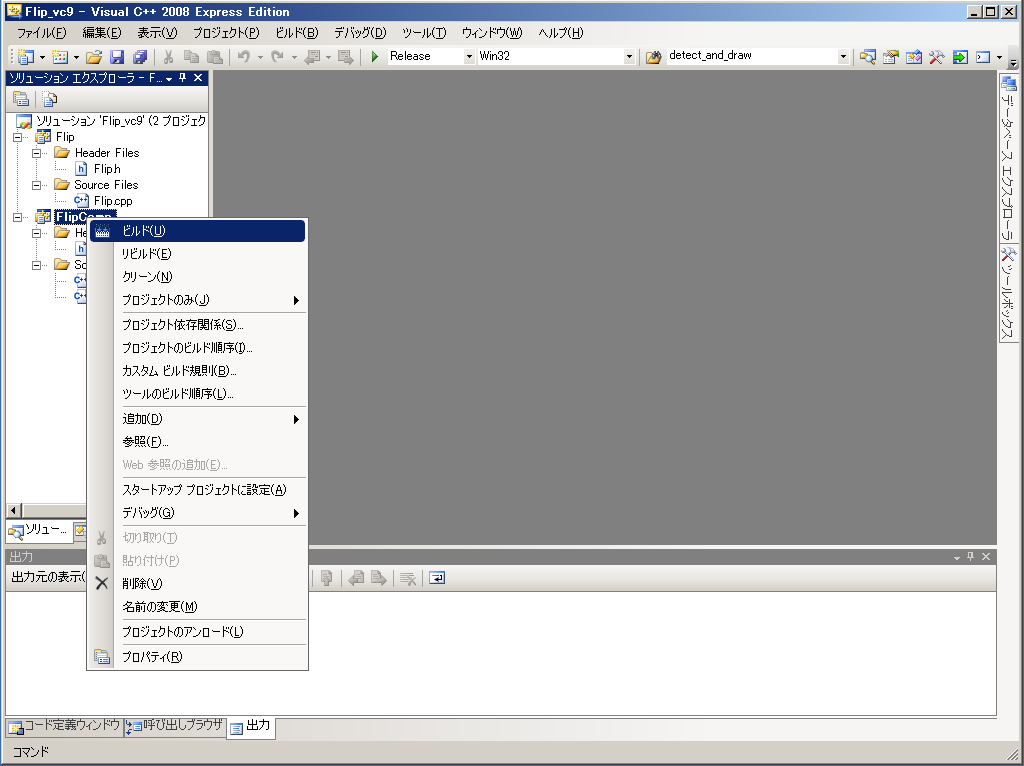

}ビルドの実行

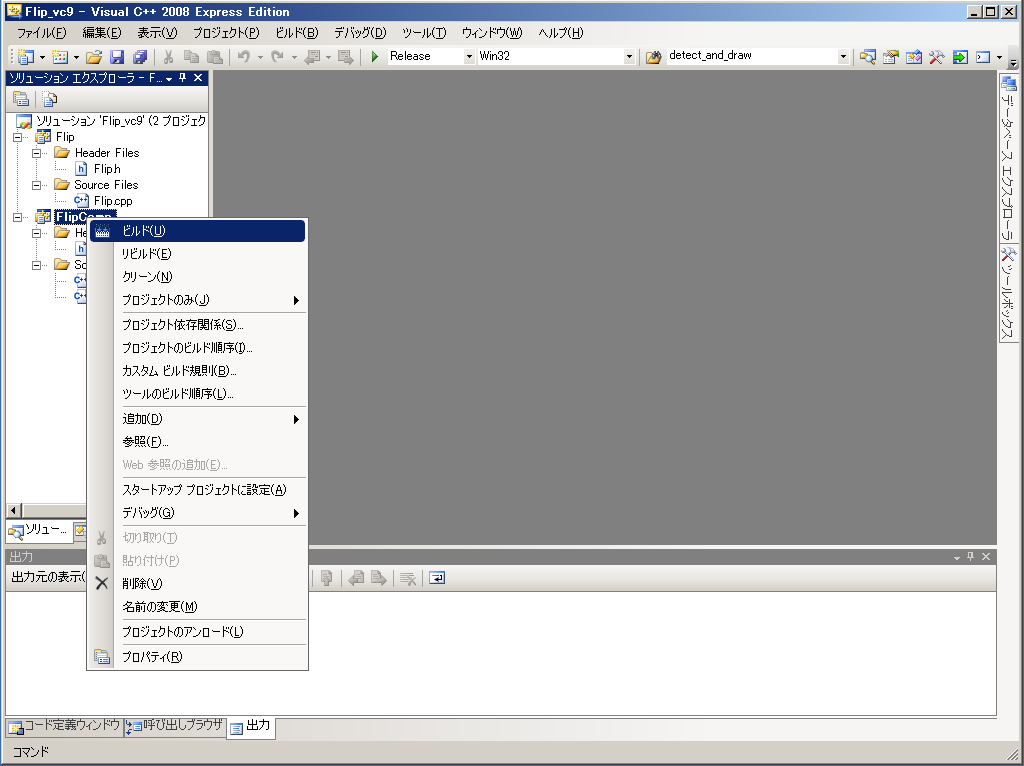

Flip_vc9.sln ファイルをダブルクリックし、Visual C++ 2008 を起動します。

Visual C++ 2008 の起動後、図21のようにし、コンポーネントのビルドを行います。

Flip コンポーネントの動作確認

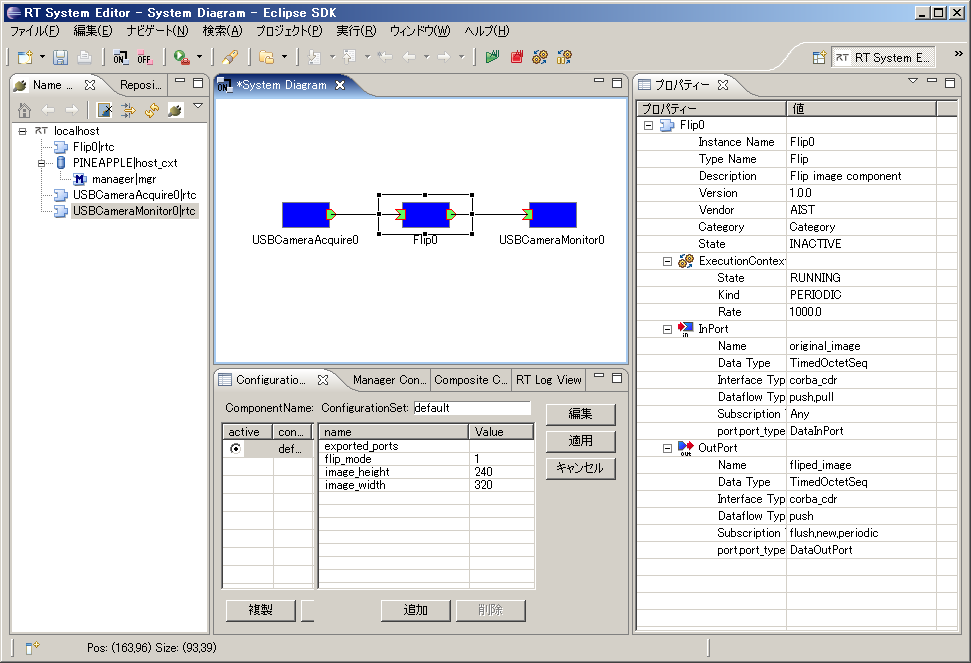

ここでは、「OpenCV用RTC群 (Win32用インストーラ)」にてインストールした USBCameraAqcuireComp コンポーネントと、USBCameraMonitorCom コンポーネント、それと、今回作成した Flip コンポーネントを接続し動作確認を行います。

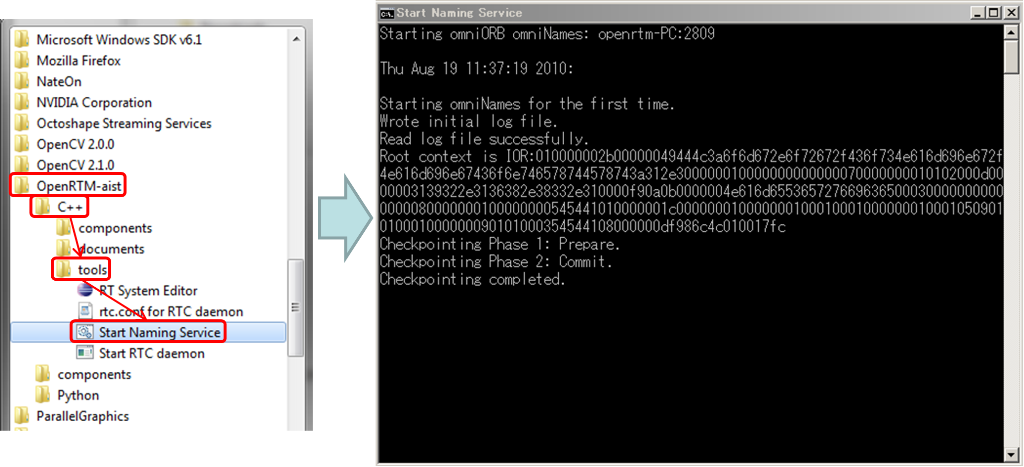

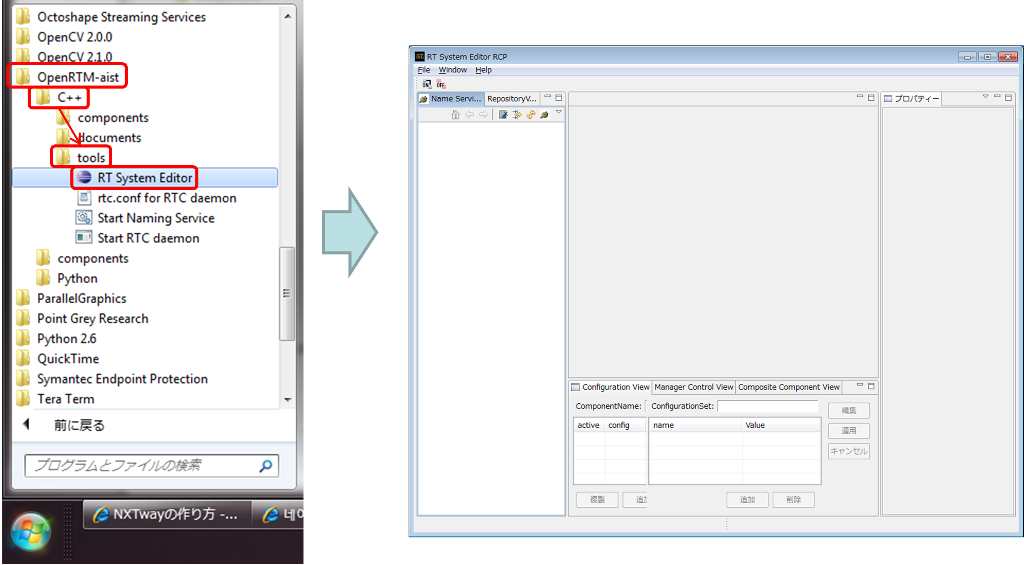

NameService の起動

omniORB のネームサービスを起動します。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [C++] > [tools] の順に辿り、「Start Naming Service」をクリックしてください。

&color(RED){※ 「Star Naming Service」をクリックしても omniNames が起動されない場合は、フルコンピューター名が14文字以内に設定されているかを確認してください。

rtc.confの作成

RTコンポーネントでは、ネームサーバーのアドレスやネームサーバーへの登録フォーマットなどの情報を rtc.conf というファイルで指定する必要があります。

下記の内容を rtc.conf というファイル名で保存し、Flip\FlipComp\Debug(もしくは、Release)フォルダーに置いて下さい。

※ Eclipse 起動時に workspace をデフォルトのままにしていた場合、Flip フォルダーのパスは、

C:\Documents and Settings\<ログインユーザー名>\workspace となります。

corba.nameservers: localhost naming.formats: %n.rtc

Flip コンポーネントの起動

Flip コンポーネントを起動します。

先程 rtc.conf ファイルを置いたフォルダーにある、FlipComp.exe ファイルを実行して下さい。

USBCameraAqcuire、USBCameraMonitor コンポーネントの起動

USB カメラのキャプチャ画像を OutPort から出力する USBCameraAqcuireComp コンポーネントと、InPort で受け取った画像を画面に表示する USBCameraMonitorComp コンポーネントを起動します。

これら2つのコンポーネントは、下記の手順にて起動できます。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [components] > [C++] > [OpenCV] を選択し、「USBCameraAqcuireComp」と「USBCameraMonitorComp」をそれぞれクリックして実行します。

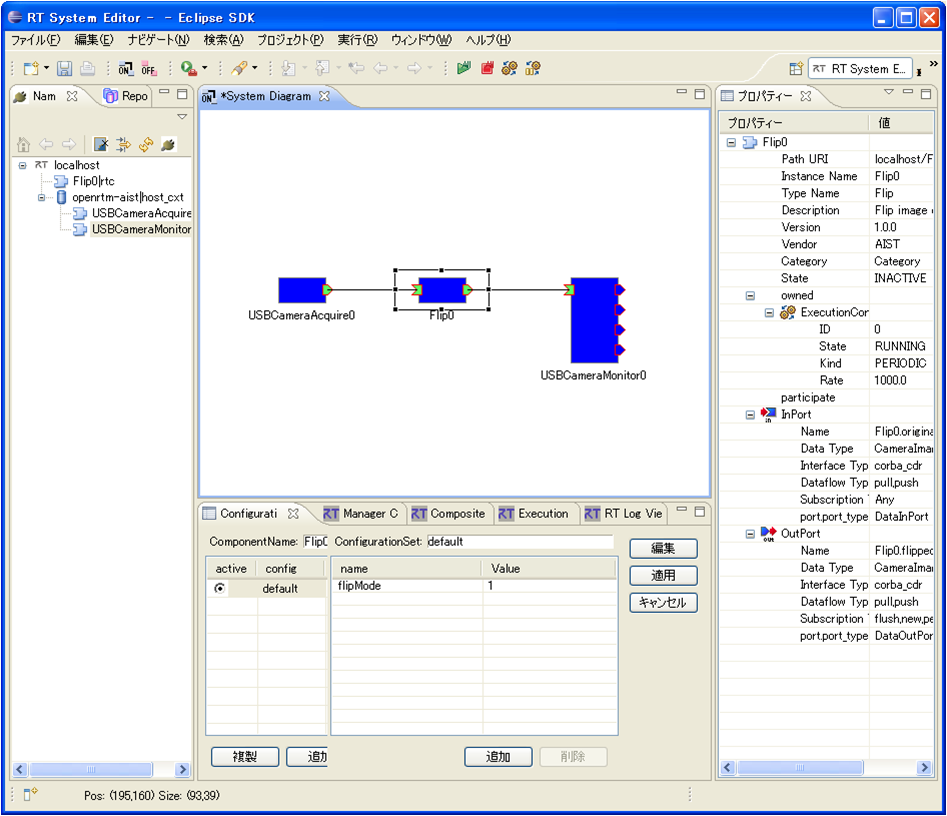

コンポーネントの接続

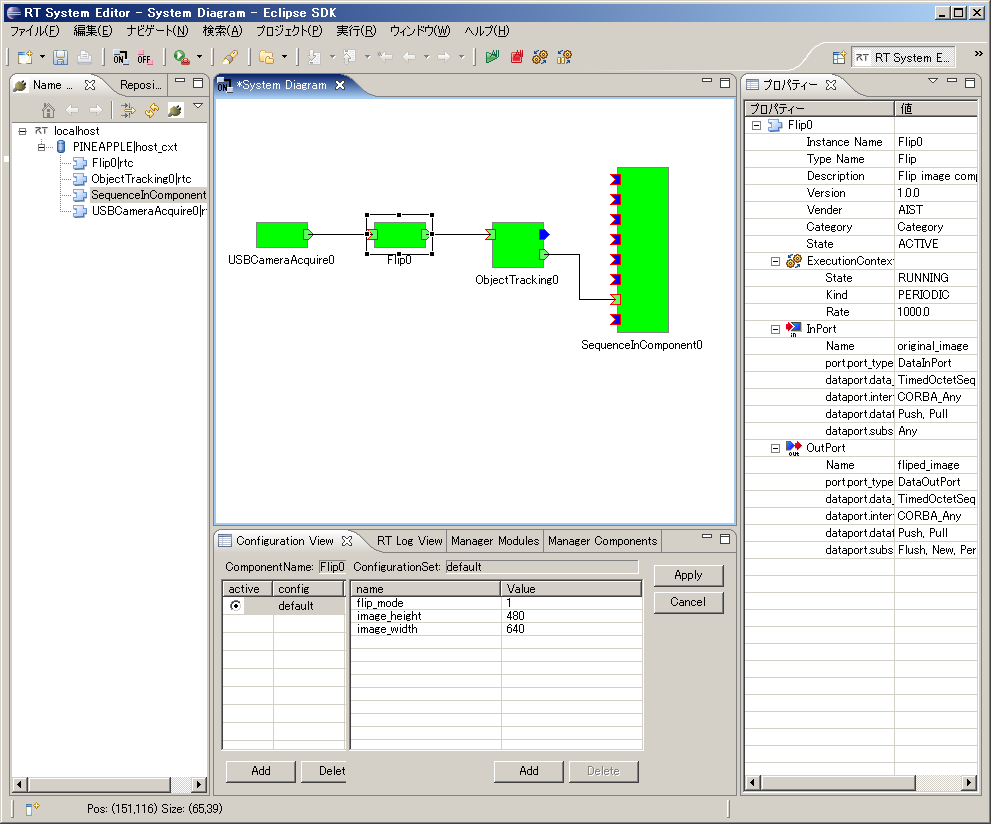

図22のように、RTSystemEditor にて USBCameraAqcuireComp、Flip、USBCameraMonitorComp コンポーネントを接続します。

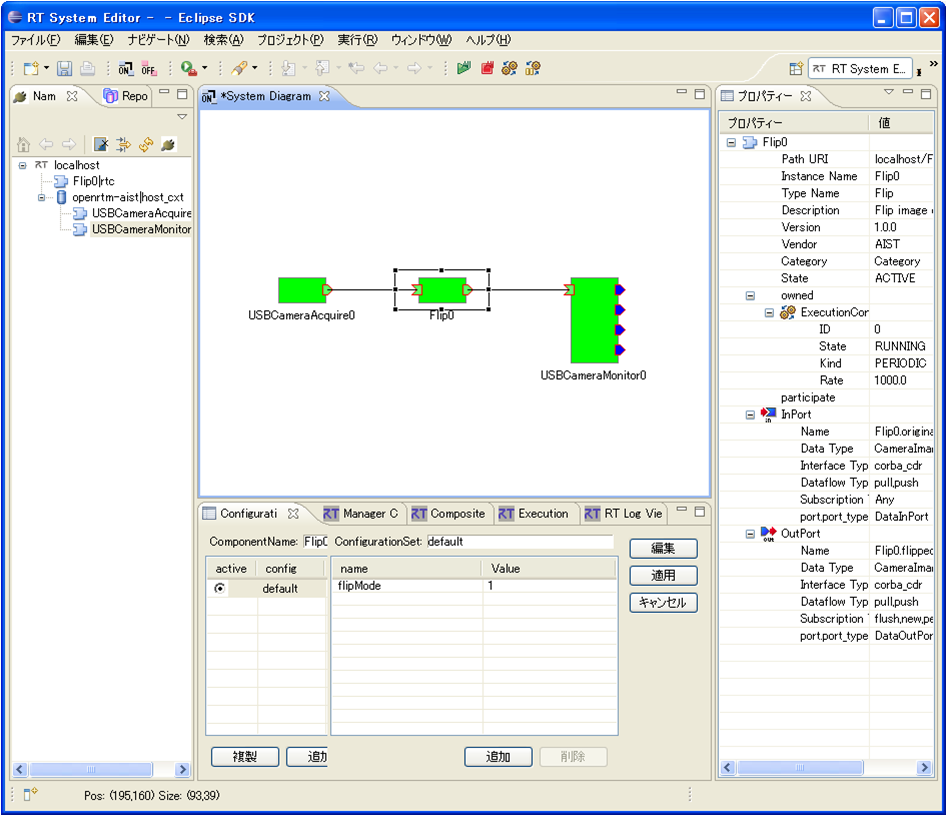

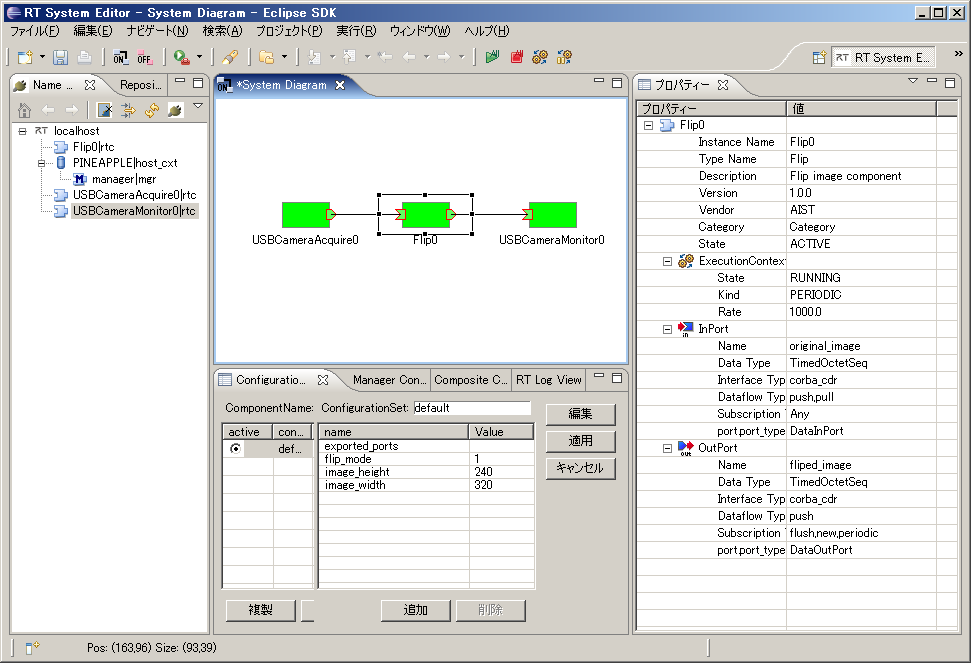

コンポーネントの Activate

RTSystemEditor の上部にあります「ALL」というアイコンをクリックし、全てのコンポーネントをアクティベートします。

正常にアクティベートされた場合、図23のように黄緑色でコンポーネントが表示されます。

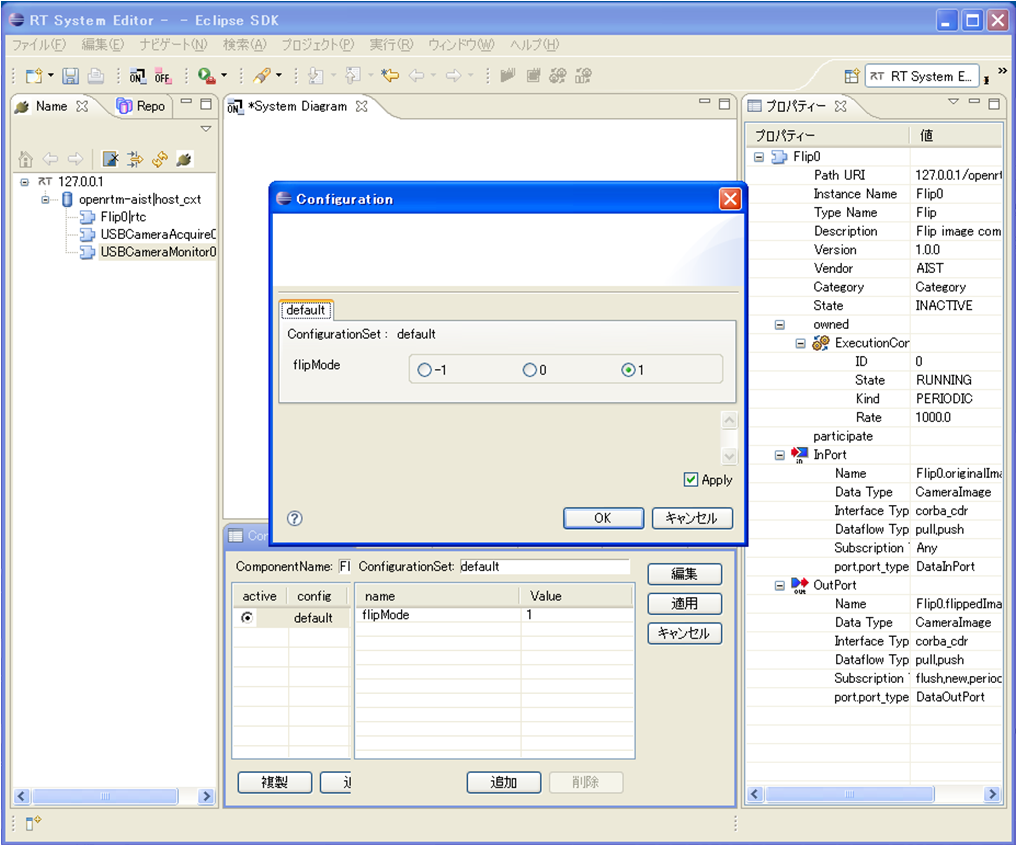

動作確認

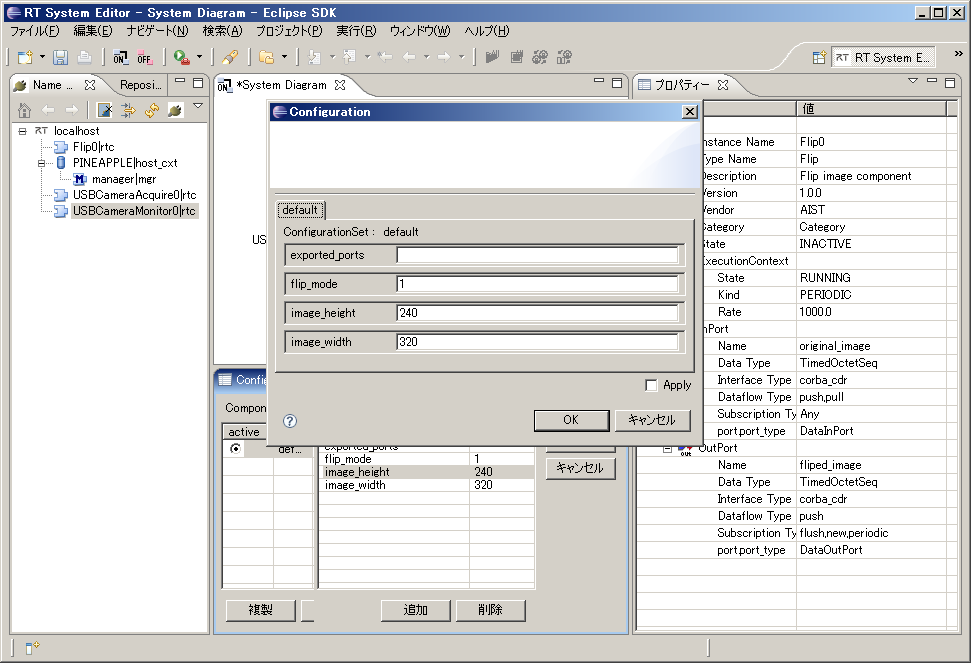

図24のようにコンフィギュレーションビューにてコンフィギュレーションを変更することができます。

Flip コンポーネントのコンフィギュレーションパラメーター「flipMode」を「0」や「-1」などに変更し、画像の反転が行われるかを確認してください。

Flip コンポーネントのソースファイル

// -*- C++ -*-

/*!

* @file Flip.cpp

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#include "Flip.h"

// Module specification

static const char* flip_spec[] =

{

"implementation_id", "Flip",

"type_name", "Flip",

"description", "Flip image component",

"version", "1.0.0",

"vendor", "AIST",

"category", "Category",

"activity_type", "PERIODIC",

"kind", "DataFlowComponent",

"max_instance", "1",

"language", "C++",

"lang_type", "compile",

// Configuration variables

"conf.default.flipMode", "1",

// Widget

"conf.__widget__.flipMode", "radio",

// Constraints

"conf.__constraints__.flip_mode", "(-1,0,1)",

""

};

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip::Flip(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

m_originalImageIn("originalImage", m_originalImage),

m_flippedImageOut("flippedImage", m_flippedImage)

{

}

/*!

* @brief destructor

*/

Flip::~Flip()

{

}

RTC::ReturnCode_t Flip::onInitialize()

{

// Registration: InPort/OutPort/Service

// Set InPort buffers

addInPort("originalImage", m_originalImageIn);

// Set OutPort buffer

addOutPort("flippedImage", m_flippedImageOut);

// Bind variables and configuration variable

bindParameter("flipMode", m_flipMode, "1");

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの初期化

m_imageBuff = NULL;

m_flipImageBuff = NULL;

// OutPort の画面サイズの初期化

m_flippedImage.width = 0;

m_flippedImage.height = 0;

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

if(m_imageBuff != NULL)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_originalImageIn.isNew()) {

// InPort データの読み込み

m_originalImageIn.read();

// InPort と OutPort の画面サイズ処理およびイメージ用メモリーの確保

if( m_originalImage.width != m_flippedImage.width || m_originalImage.height != m_flippedImage.height)

{

m_flippedImage.width = m_originalImage.width;

m_flippedImage.height = m_originalImage.height;

// InPort のイメージサイズが変更された場合

if(m_imageBuff != NULL)

{

cvReleaseImage(&m_imageBuff);

cvReleaseImage(&m_flipImageBuff);

}

// イメージ用メモリーの確保

m_imageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

m_flipImageBuff = cvCreateImage(cvSize(m_originalImage.width, m_originalImage.height), IPL_DEPTH_8U, 3);

}

// InPort の画像データを IplImage の imageData にコピー

memcpy(m_imageBuff->imageData,(void *)&(m_originalImage.pixels[0]),m_originalImage.pixels.length());

// InPort からの画像データを反転する。 m_flipMode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_imageBuff, m_flipImageBuff, m_flipMode);

// 画像データのサイズ取得

int len = m_flipImageBuff->nChannels * m_flipImageBuff->width * m_flipImageBuff->height;

m_flippedImage.pixels.length(len);

// 反転した画像データを OutPortにコピー

memcpy((void *)&(m_flippedImage.pixels[0]),m_flipImageBuff->imageData,len);

// 反転した画像データを OutPortから出力する。

m_flippedImageOut.write();

}

return RTC::RTC_OK;

}

extern "C"

{

void FlipInit(RTC::Manager* manager)

{

coil::Properties profile(flip_spec);

manager->registerFactory(profile,

RTC::Create<Flip>,

RTC::Delete<Flip>);

}

};Flip コンポーネントのヘッダファイル

// -*- C++ -*-

/*!

* @file Flip.h

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#ifndef FLIP_H

#define FLIP_H

#include <rtm/Manager.h>

#include <rtm/DataFlowComponentBase.h>

#include <rtm/CorbaPort.h>

#include <rtm/DataInPort.h>

#include <rtm/DataOutPort.h>

#include <rtm/idl/BasicDataTypeSkel.h>

#include <rtm/idl/ExtendedDataTypesSkel.h>

#include <rtm/idl/InterfaceDataTypesSkel.h>

//OpenCV 用インクルードファイルのインクルード

#include<cv.h>

#include<cxcore.h>

#include<highgui.h>

using namespace RTC;

/*!

* @class Flip

* @brief Flip image component

*

*/

class Flip

: public RTC::DataFlowComponentBase

{

public:

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip(RTC::Manager* manager);

/*!

* @brief destructor

*/

~Flip();

/***

*

* The initialize action (on CREATED->ALIVE transition)

* formaer rtc_init_entry()

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onInitialize();

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

protected:

// Configuration variable declaration

/*!

*

* - Name: flipMode

* - DefaultValue: 1

*/

int m_flipMode;

// DataInPort declaration

CameraImage m_originalImage;

/*!

*/

InPort<CameraImage> m_originalImageIn;

// DataOutPort declaration

CameraImage m_flippedImage;

/*!

*/

OutPort<CameraImage> m_flippedImageOut;

private:

// 処理画像用バッファ

IplImage* m_imageBuff;

IplImage* m_flipImageBuff;

};

extern "C"

{

DLL_EXPORT void FlipInit(RTC::Manager* manager);

};

#endif // FLIP_HFlip コンポーネントのビルド済みパッケージ

ビルド済みパッケージを下記からダウンロードできます。

拡張子を"zip_"としてますので、"zip"にリネームしてから解凍してください。

RTコンポーネント作成(VC++編)

データポートのあるコンポーネント

ここでは、データポートを2つ持つコンポーネント (MRCConvertor) を VC8 にて作成します。

コンポーネントの概要

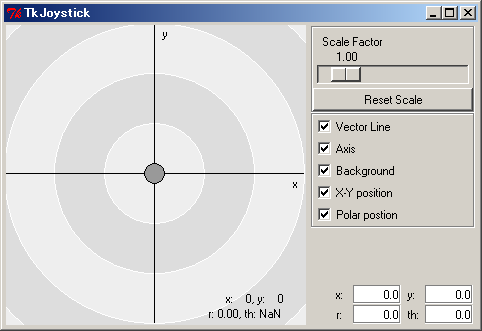

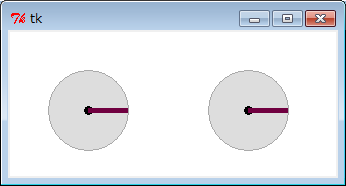

入力デバイスからのデータを車輪2つの速度に変換し、OutPort から出力するコンポーネント。

Joystick等の入力デバイスにて移動ロボット(前輪2、後輪1、前輪だけが駆動)を操作する際に、使用することができる。

作成する RTC の仕様は以下のとおりです。

- InPort

- 移動ロボットに対する速度 (TimedFloatSeq)

- OutPort

- 移動ロボットの車輪の速度 (TimedFloatSeq)

MRCConvertor の雛型を生成

RtcTemplate にて雛型を生成します。

作業用フォルダーの作成

適当な場所に作業用フォルダーを作成します。

今回は、フォルダー名をコンポーネント名 (MRCConvertor) と同じにします。

- "マイコンピューター"をダブルクリック

- 作業用フォルダーを作成したいフォルダーへ移動

- 右クリックして [新規作成] > [フォルダー] でフォルダーを作成

CUI版 rtc-template 編 (gen.bat)

rtc-template の実行を簡単にするために、下記のようなバッチファイルを先ほど作成した作業用フォルダーに作成します。

rtc-template.py -bcxx^ --module-name=MRCConvertor --module-desc="Convertor component for MobileRobot component"^ --module-version=1.0.0 --module-vendor=AIST --module-category=Category^ --module-comp-type=DataFlowComponent --module-act-type=PERIODIC^ --module-max-inst=1^ --inport=velFromInput:TimedFloatSeq^ --outport=velToWheel:TimedFloatSeq

rtc-template (gen.bat) の実行

下記のように gen.bat ファイルを実行します。

>gen.bat rtc-template.py -bcxx --module-name=MRCConvertor --module-desc="Convertor component for MobileRobot component" --module-version=1.0.0 --module-vendor=AIST --module-category=Category --module-comp-type=DataFlowComponent --module-act-type=PERIODIC --module-max-inst=1 --inport=velFromInput:TimedFloatSeq --outport=velToWheel:TimedFloatSeq File "MRCConvertor.h" was generated. File "MRCConvertor.cpp" was generated. File "MRCConvertorComp.cpp" was generated. File "Makefile.MRCConvertor" was generated. File "MRCConvertorComp_vc8.vcproj" was generated. File "MRCConvertor_vc8.vcproj" was generated. File "MRCConvertorComp_vc9.vcproj" was generated. File "MRCConvertor_vc9.vcproj" was generated. File "MRCConvertor_vc8.sln" was generated. File "MRCConvertor_vc9.sln" was generated. File "copyprops.bat" was generated. File "user_config.vsprops" was generated. File "README.MRCConvertor" was generated. File "MRCConvertor.yaml" was generated.

Eclipse版 RtcTemplate 編

Eclipse版 RtcTemplate での対応は下記のようになります。

- Programing language selection: C++

- Module definition

- Module name: MRCConvertor

- Module decription: Convertor component for MobileRobot component

- Module version: 1.0.0

- Module vender: AIST

- Module category: Category

- Component type: DataFlowComponent

- Component's activity type: PERIODIC

- Number of maximum instance: 1

- InPort definition

- Ports: Name:velFromInput Type:TimedFloatSeq

- OutPort definition

- Ports: Name:velToWheel, Type:TimedFloatSeq

copyprops.bat の実行

RtcTemplate 実行により、copyprops.bat ファイルが作業用フォルダーに生成されます。

この copyprops.bat ファイルを用い、コンポーネントのビルドに必要な rtm_config.vsprops を作業フォルダーにコピーします。

copyprops.bat ファイルをダブルクリックしてください。

MRCConvertor の実装

Visual Studio の起動

MRCConvertorComp_vc8.vcproj をダブルクリックし、Visual Studio を起動します。

ヘッダファイルの編集

Visual Studio のソリューションエクスプローラーにて、MRCConvertorComp > Header Files の順にクリックし、 MRCConvertor.h をダブルクリックします。

- ヘッダファイルのインクルード

今回は、std::vector と math ライブラリを使用しますので、2つのヘッダファイルをインクルードします。

#include <vector> // VC8 にて Math::M_PI を使用するため #define _USE_MATH_DEFINES #include <math.h>

- "virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);"関数のコメントをはずします。

- メンバー変数とメソッドの宣言

今回は、MobileRobot (前輪2、後輪1、前輪だけが駆動) の移動ベクトルを車輪速度に変換するためのメソッド convert()、変換に必要な係数 m_k を宣言します。

private: float m_k;

/*!

* @brief InPortからのデータ(X、Y) をMobileRobot用の車輪速度データに変換する。

* m_velFromInput.data[0]とm_velFromInput.data[1]だけを使用する。

*/

std::vector<float> convert(float x, float y) {

float th = atan2(y,x);

float v = m_k * hypot(x,y);

std::vector<float> ret_val;

ret_val.push_back(v * cos(th - (M_PI/4.0))); // left vel

ret_val.push_back(v * sin(th - (M_PI/4.0))); // right vel

return ret_val;

}ソースファイルの編集

Visual Studio のソリューションエクスプローラーにて、MRCConvertorComp > Source Files の順にクリックし、 MRCConvertor.cpp をダブルクリックします。

- onExecute() の実装

onExecute() のコメントをはずし、以下のように実装します。

/*!

* @brief InPort からのデータ (X、Y) を MobileRobot用の車輪速度データに変換し、

* OutPort から出力する。

*/

RTC::ReturnCode_t MRCConvertor::onExecute(RTC::UniqueId ec_id)

{

if (m_velFromInputIn.isNew()) {

m_velFromInputIn.read();

if (m_velFromInput.data.length() > 2) {

std::vector<float> con_val = this->convert(m_velFromInput.data[0],m_velFromInput.data[1]);

for (int i = 0; i < 2; i++)

m_velToWheel.data[i] = con_val[i];

m_velToWheelOut.write();

}

}

return RTC::RTC_OK;

}ここで行われていることは、

- m_velFromInputIn.isNew() にて InPort にデータが届いているかをチェックする。

- 新しいデータが届いていたら、m_velFromInputIn.read() で変数にデータを読み込む。

- 読み込んだデータを convert() にて車輪速度に変換する。

- 変換したデータを OutPort の変数にセットし、OutPort のバッファに書き込む。

ビルド

Visual Studio のメニューから [ビルド] > [ソリューションのビルド] をクリックしコンポーネントのビルドを行います。

rtc.conf の作成

エディタにて以下の内容を記述し、rtc.conf というファイル名で Debug あるいは Release フォルダーに保存します。

corba.nameservers: localhost naming.formats: %n.rtc

実行

ビルドにてエラーが無かった場合、Debug あるいは Release フォルダーに rtc.conf を作成し、MRCConvertorComp.exe を実行します。

MRCConvertorComp.exe を実行する前に NamingService を起動してください。ネームサーバーの起動

<OpenRTM-aist インストールフォルダー>\bin\rtm-naming.batをダブルクリックしCORBAネームサーバーを起動します。

MRCConvertorComp.exe の実行

Debug あるいは Release フォルダーに移動し、MRCConvertorComp.exe を実行します。

RTコンポーネント作成(Java版)

概要

OpenRTM-aist-Java 概要

OpenRTM-aist とは、独立行政法人産業技術総合研究所・知能システム研究部門・タスクインテリジェンス研究グループが実装・配布・メンテナンスを行っている RTミドルウェアの実装例です。RTミドルウェアおよび OpenRTM-aist は、ロボットの様々な機能要素を RTコンポーネントと呼ばれる部品単位に分割し、これらを自由に組み合わせることで多様なロボットシステムの構築を可能にするためのソフトウェアプラットフォームです。現在 OMG (Object Management Group) にて仕様策定中のロボット用ミドルウェア仕様(The Robotic Technology Component Specification)にも準拠しています。OpenRTM-aist-Java は、これまで C++言語向けに提供されていた OpenRTM-aist を Java言語に移植したものです。C++版 OpenRTM-aist互換のインターフェースを有し、Java言語を使用して開発した RTコンポーネントと C++言語を利用して開発した RTコンポーネントの相互運用が可能としています。

対象

本ドキュメントは、OpenRTM-aist-Java を利用して、Java言語版 RTコンポーネントを開発する方法について説明しています。なお、本ドキュメントでは Java言語については基本知識を既に持っている方を対象としています。動作環境

OpenRTM-aist-Java の動作に必要な環境は以下のとおりです。

| 環境 | 備考 |

| Java Development Kit 5.0 (JDK 5) (http://java.sun.com/products/archive/j2se/5.0_14/index.html ) |

注意:Java1.4 では動作しません. |

OpenRTM-aist-Java のインストール方法の詳細につきましては、「OpenRTM-aist-Java インストールマニュアル(UNIX)」あるいは「OpenRTM-aist-Java インストールマニュアル(Windows)」を参照してください。特に、次のことを確認してから以下の作業に移ってください。

- 「java -version」を実行したときのバージョンが上記 JDKと一致すること

- 環境変数 RTM_JAVA_ROOT に OpenRTM-aist-Java のライブラリへのパス(ベースパス)が設定されていること

- <RTM_JAVA_ROOT>で設定されるパスの直下のディレクトリー「jar」内にライブラリファイル OpenRTM-aist-0.4.x.jar と commons-cli-1.1.jar が存在すること(クラスパスとして設定するため)※

- ※ こちら を参考に独自のクラスパスの設定も可能です。

◆参考:

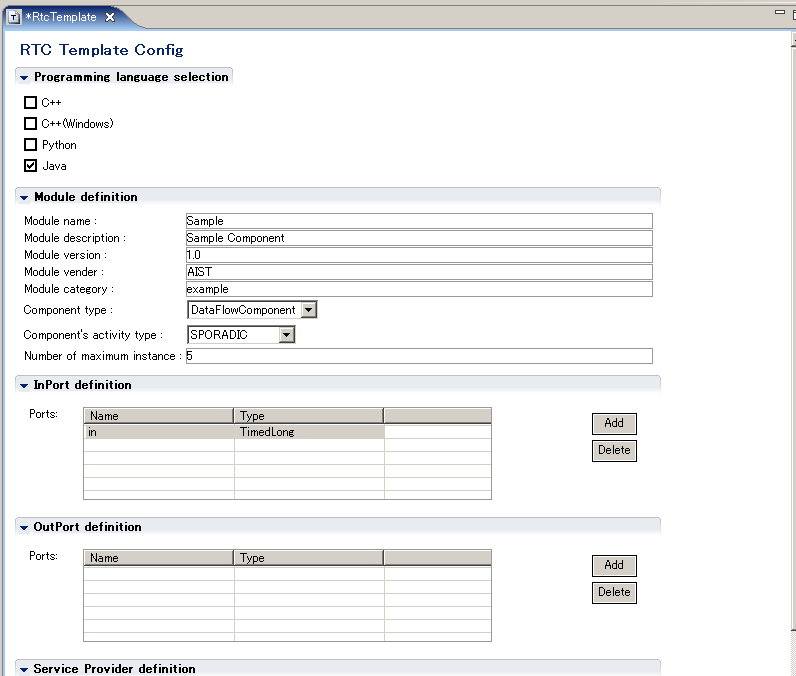

ここでは、Java版 RTコンポーネントの開発を行う場合の手順をご紹介します。サンプルとして以下のような仕様のコンポーネントを取り上げます。

| 基本プロファイル | |

| コンポーネント名 | sample |

| 説明 | SampleComponent |

| バージョン | 1.0 |

| ベンダ | AIST |

| カテゴリ | example |

| コンポーネントの型 | DataFlowComponent |

| アクティビティタイプ | SPORADIC |

| 最大インスタンス数 | 5 |

| データInPort | |

| 名称 | in |

| 型 | TimedLong |

| サービスProvider | |

| IDLパス | IDLs/MyService.idl ※ |

| ポート名 | MySvcPort |

| サービス名 | myservice0 |

| サービス型 | MyService |

| コンフィギュレーションパラメーター | |

| 名称 | multiply |

| 型 | int |

| デフォルト値 | 1 |

※ MyService.idl は適当なエディタを用いて以下のような IDL ファイルを作成します。また、上の表中の「IDLパス」はMyService.idl のパスを記述します。Windowsの場合は、この「IDLパス」が MyService.idl へのフルパスでなければなりません。

typedef sequence<string> EchoList;

typedef sequence<float> ValueList;

interface MyService

{

string echo(in string msg);

EchoList get_echo_history();

void set_value(in float value);

float get_value();

ValueList get_value_history();

};なお、上記 MyService.idl は OpenRTM-aist-0.4-Java に付属するサンプルの「examples/Java/RTMExamples/SimpleService」ディレクトリー内にあるものと同一です。

GUI を用いた場合の RTコンポーネントの開発手順

GUI ツールである RtcTemlate を用いて、RTコンポーネントを開発手順を説明します。RtcTemplate の詳細についてはRtcLink・RtcTemplateのインストールおよびRtcTemplateを参照してください。RtcTemplate と JDT の連携

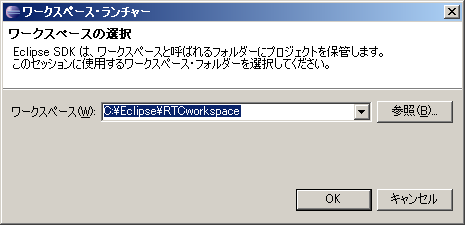

- Eclipse を「新規」に開く RTコンポーネントの開発は、統合開発環境 Eclipse のプロジェクトから行うことも可能です。新しいワークスペースを指定して [OK] ボタンをクリックします。Eclipse が起動します。(このとき「ようこそ」という画面が表示される場合がありますが、これは閉じます。)

図 2-2 新規の Workspace を指定

図 2-2 新規の Workspace を指定

- Java プロジェクトファイルの作成

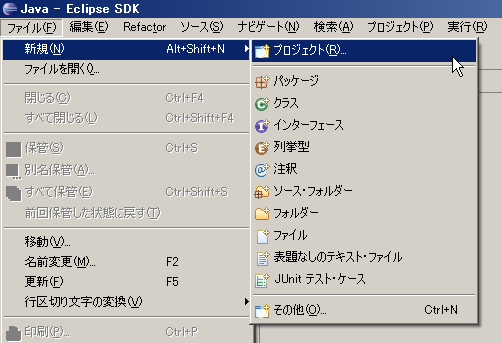

上部メニューから [ファイル] > [新規] > [プロジェクト] を選択します。

図 2-3 ビルド用プロジェクトの作成 1

図 2-3 ビルド用プロジェクトの作成 1

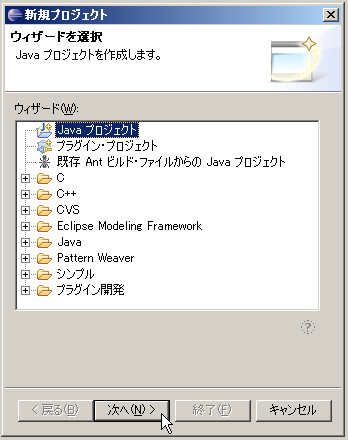

- 「新規プロジェクト」ウィザード内で「Javaプロジェクト」を選択し、[次へ] ボタンをクリックします。

図 2-4 ビルド用プロジェクトの作成 2

図 2-4 ビルド用プロジェクトの作成 2

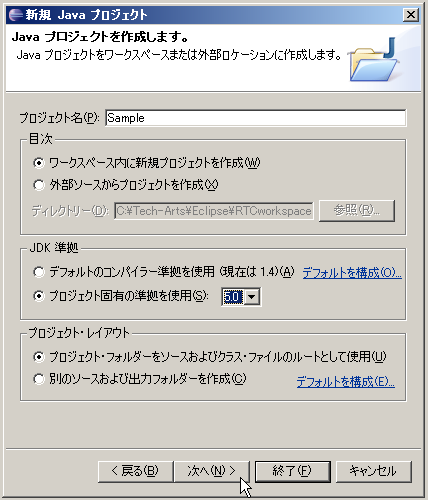

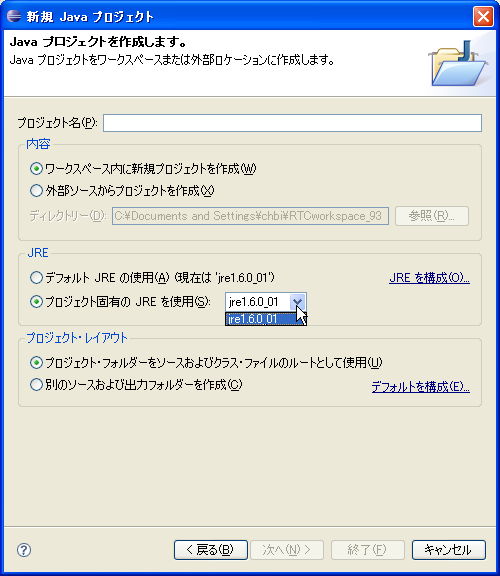

- 「新規プロジェクト」ウィザードの次のステップで、作成する「プロジェクト名」を入力します。「JDK準拠」グループ内の設定が「5.0」以上(あるいは1.5以上)となっていることを確認した上で、[次へ] ボタンをクリックします(図 2-5)。一方、環境によっては「JDK準拠」フレームであるところが「JRE」フレームとなっており、プルダウンメニューから JDK5(あるいはJDK1.5)が選択できない場合があります(図 2-5')。その場合は、こちら を参照してJDKを選択できるようにします。

図 2-5 ビルド用プロジェクトの作成 3

図 2-5 ビルド用プロジェクトの作成 3

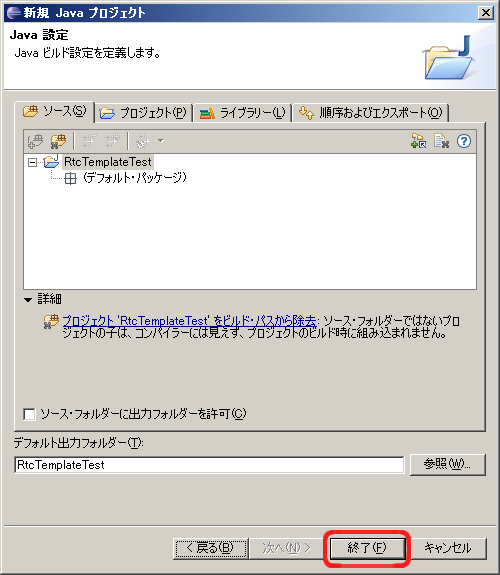

- 表示された「新規 Java プロジェクト」画面において、生成するプロジェクトの各種設定を行い [終了] ボタンをクリックします。

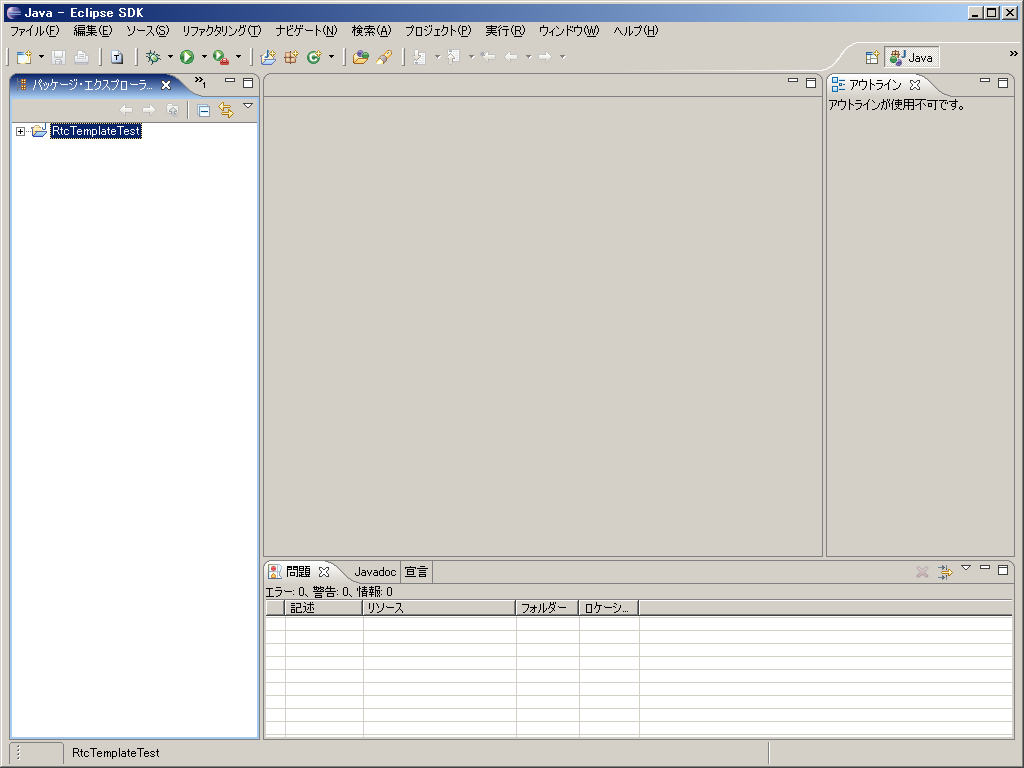

- 指定したプロジェクトが生成され、「パッケージ・エクスプローラービュー」内に表示されます。

-自動ビルドを無効に

Eclipse のメニューバーの [プロジェクト] > [自動的にビルド] がオンになっている場合は、チェックをはずし無効にしておいた方がいいでしょう。

※ プロジェクトの作成時の各種オプション、設定など Eclipse に関する詳細は、Eclipse のサイト(http://www.eclipse.org/ )などを参照してください。

RtcTemplate を利用したスケルトン・コードの生成

- GUI版RtcTemplate エディタの起動

RtcTemplate のエディタ画面を起動します。

- 参考:

- → RtcTemplate を直接起動する

- ※ RtcTemplate の使用方法等につきましては、RtcTemplateを参照してください。

- RtcTemplate エディタで設定項目を編集

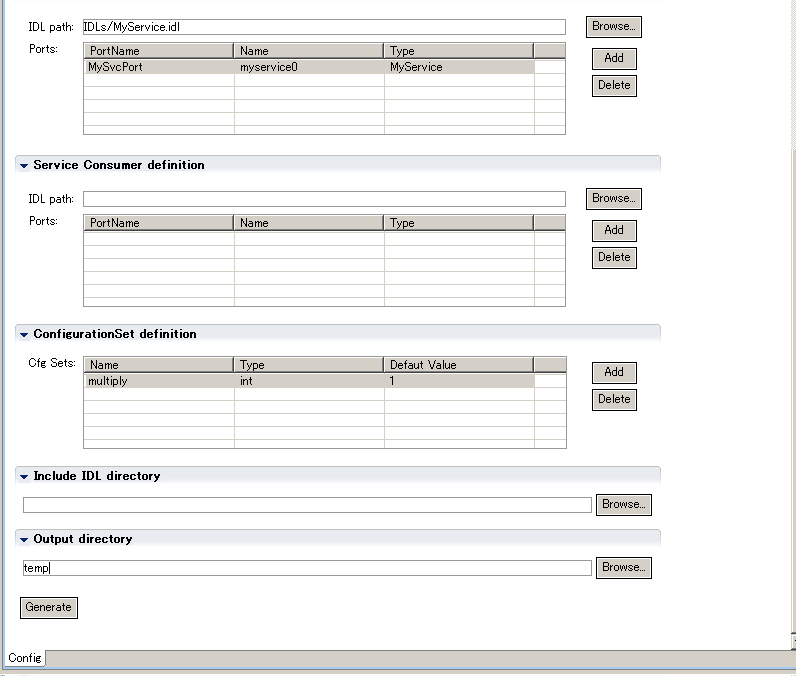

GUI版の RtcTemplate を使用して''表2-1'' の仕様を持つ RTコンポーネントのスケルトン・コードを生成させる場合の設定を以下に示します。

図 2-8 GUI RtcTemplateの設定

図 2-8 GUI RtcTemplateの設定

:注:Windowsの場合、上記 「Output directory」 や「IDL path:」などはフルパスで記述すること。|

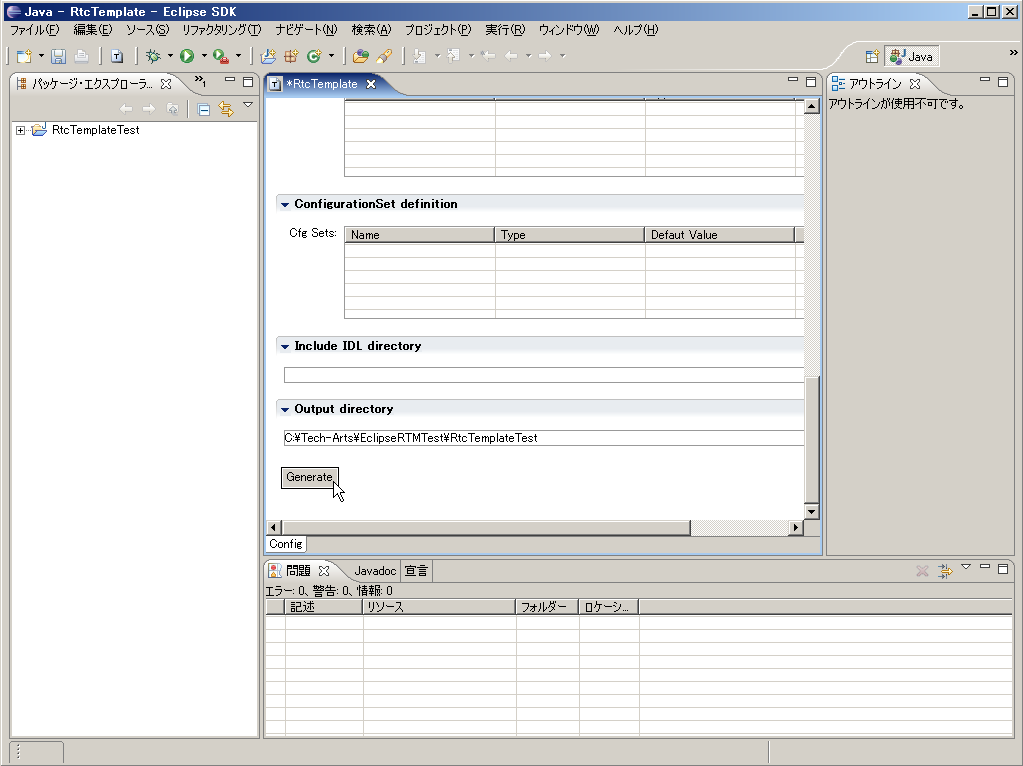

- [Generate] ボタンでコードを生成

[Generate] ボタンをクリックし、コード生成を実行する。このとき必ず、RtcTemplate エディタ最下段の 「Output directory」 欄に、先に生成したプロジェクトのディレクトリーを指定すること(※ 図 2-8では「temp」となっている)。

- 生成された各種ファイルがプロジェクトに追加

「Output directory」として指定したディレクトリーに以下のファイルが生成されます。- Sample.java ・・・・・・・・・・・・・・・・・・・ Component Profile、初期化処理などを定義したクラス

- Sampleimpl.java ・・・・・・・・・・・・・・・ RTコンポーネント本体クラス

- SampleComp.java ・・・・・・・・・・・・・ RTコンポーネント起動用クラス

- MyServiceSVC_impl.java ・・・・・・・ サービス実装クラス

- build_Sample.xml ・・・・・・・・・・・・・・ RTコンポーネント ビルドファイル

- README.Sample ・・・・・・・・・・・・・・ Read Meファイル

: 「Output directory」欄にプロジェクトのディレクトリーを指定することにより、生成された各種ファイルがプロジェクトへ(自動的に)追加されることになります。|

※ サービスポートを定義している RTコンポーネントの場合、Rtctemplate が生成したファイルだけではエラーが表示されます。これは該当するファイルが、IDL ファイルから自動生成されるクラスを利用しているためです。これらのクラスはビルド実行時に自動生成されます。

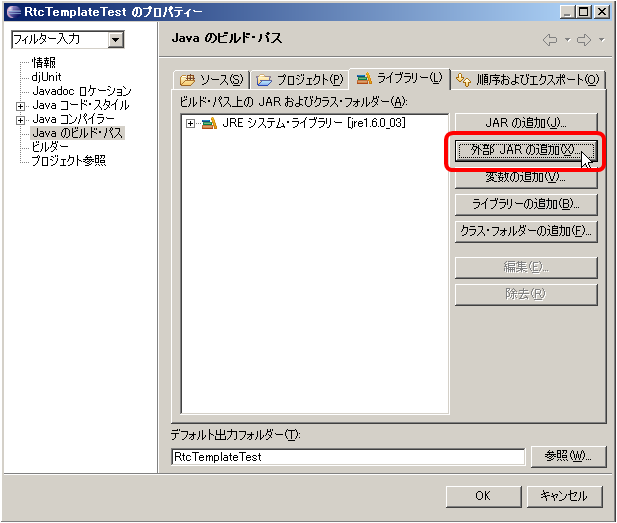

※クラスパスが有効となる場所に、OpenRTM-aist-Java がインストールされていない場合、エラーが表示されます。この場合、プロジェクトのプロパティから OpenRTM-aist-Java のインストールフォルダー(ディレクトリー)を指定してください。

- IDLファイルを「Output directory」に追加

RtcTemplate エディタ上の「IDL path:」で指定したIDLファイルを、生成されたJavaソースコードが配置される「Output directory」に手動でコピーします。

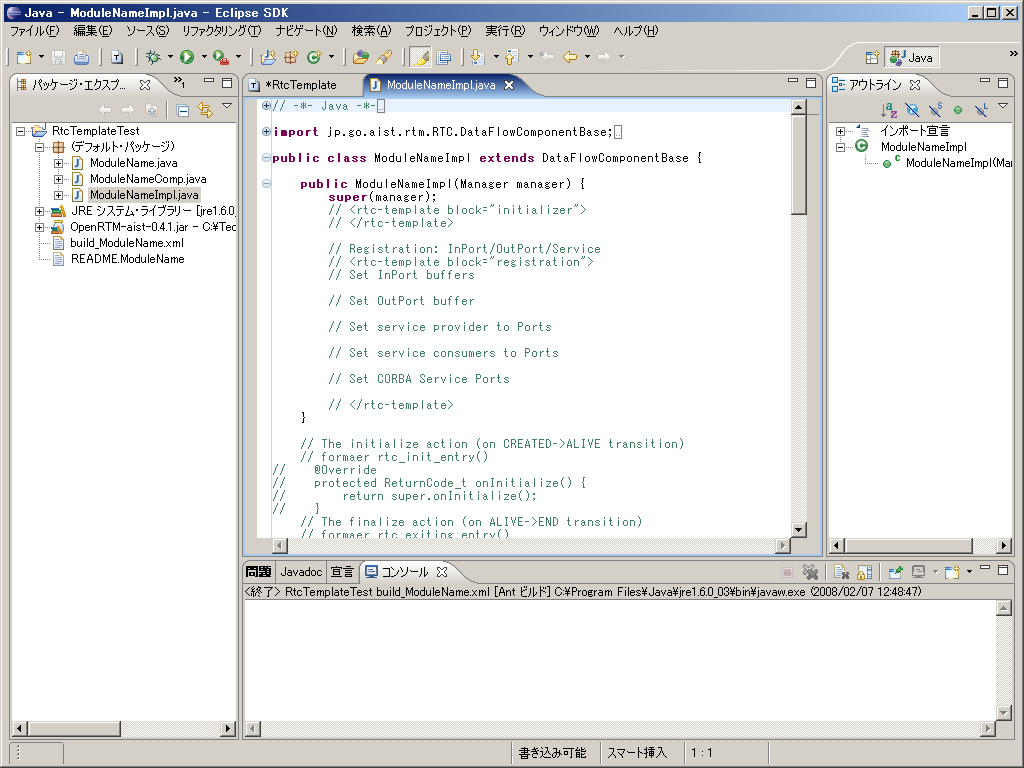

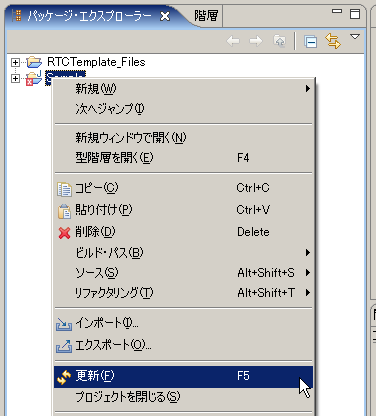

Eclipseを用いたビルド

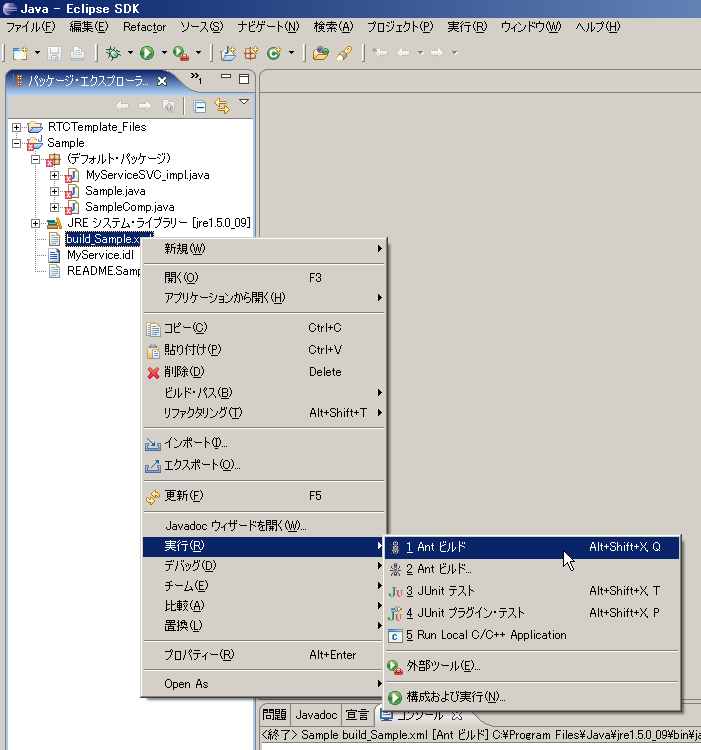

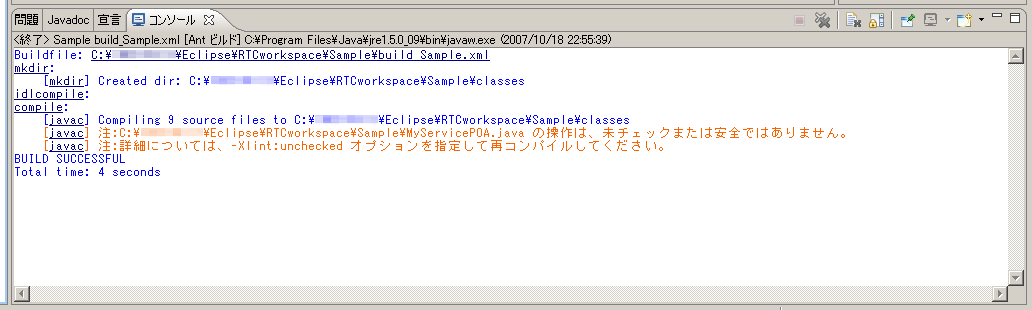

- Antビルド

パッケージ・エクスプローラー内の build_Sample.xml を右クリックし、表示されるコンテキストメニュー中から [実行] > [Antビルド] を選択することで、対象 RTコンポーネントのビルドを行うことが可能です。自作の jar ライブラリ等を使う必要があったり、OpenRTM-aist を違う場所にインストールしたなどの事情でクラスパスを任意の場所に設定してビルドするにはこちら を参照してください。

図 2-14 プロジェクトのビルド

図 2-14 プロジェクトのビルド

- ビルドが成功すると、プロジェクト内の「classes」ディレクトリーに classファイルが生成されます。

:参考:|

作成した RTコンポーネントの実行

- rtc.confの作成

プロジェクト内の「classes」に以下のような内容のファイル rtc.conf を作成しておきます。

corba.nameservers: localhost naming.formats: %n.rtc

- なお、上記 rtc.conf は OpenRTM-aist-0.4-Java に付属しているサンプルの「examples/Java/RTMExamples/SimpleService」ディレクトリー内にあるものと同一です。

-ネームサーバーと RtcLink の起動

OpenRTM-aist-0.4-Java に付属のツールで「bin」ディレクトリー内にある start-orbd.vbs をダブルクリック(Windows)し、あるいは、start-orbd.sh を実行(UNIX)し、ネームサーバーを起動しておきます。また、RtcLinkを起動しておきます。

- 参考:

- ネームサーバの起動(UNIX) 、 ネームサーバの起動(Windows)

- RtcLink の起動

-RTコンポーネントの実行

コマンドプロンプトあるいはターミナルを起動して、前述「classes」ディレクトリーをカレントとします。

--UNIX系システムの場合$ java -classpath .:$RTM_JAVA_ROOT/jar/OpenRTM-aist-0.4.1.jar:$RTM_JAVA_ROOT/jar/commons-cli-1.1.jar SampleComp あるいは、たとえば bash の場合などは、上記コマンドを分割して、 $ export CLASSPATH=.:$RTM_JAVA_ROOT/jar/OpenRTM-aist-0.4.1.jar:$RTM_JAVA_ROOT/jar/commons-cli-1.1.jar $ java SampleComp

- Windows系システムの場合

> java -classpath ".;%RTM_JAVA_ROOT%\jar\OpenRTM-aist-0.4.1.jar;%RTM_JAVA_ROOT%\jar\commons-cli-1.1.jar" SampleComp あるいは、上記コマンドを分割して、 > set CLASSPATH=.;%RTM_JAVA_ROOT%\jar\OpenRTM-aist-0.4.1.jar;%RTM_JAVA_ROOT%\jar\commons-cli-1.1.jar > java SampleComp

- というコマンドを実行すれば、RtcLink上に RTコンポーネントがあらわれます。

Java版 RTコンポーネントの詳細

Java版 RTコンポーネントの構成

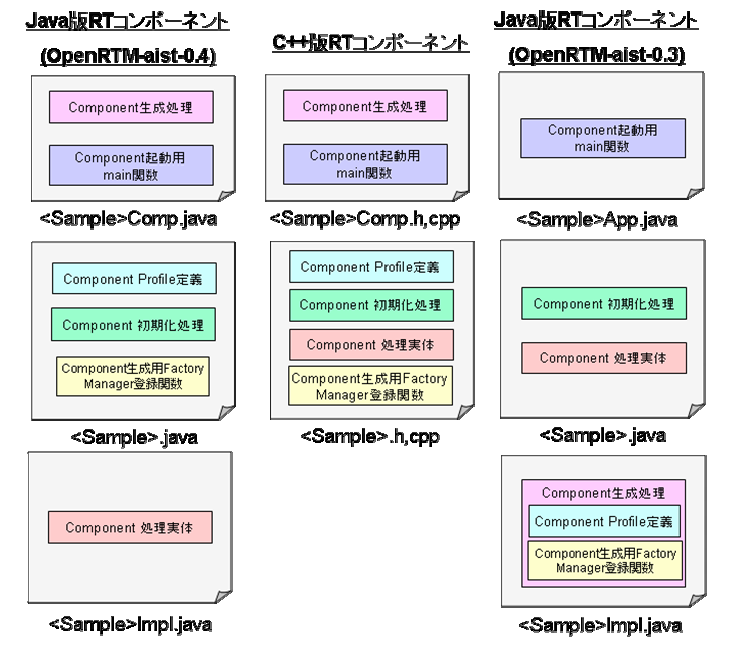

Java版 RTコンポーネントのソースファイルと、各ファイル内で実行している概略機能との関係を図3-1に示します。また、比較のために C++版 RTコンポーネントおよび OpenRTM-aist-0.3用 Java版 RTコンポーネントの構成も併せて示します。

既存の C++版 RTコンポーネントと Java版 RTコンポーネントを比較した場合、以下の点が異なります。

- RTコンポーネント機能の実体の分離 Java版 RTコンポーネントでは、起動処理の関係などから、RTコンポーネント機能の実体をXXXImplクラス (図3-1中では<Sample>Impl.java) 側へ移動しております。これに伴い、元々の RTコンポーネントクラス(図3-1中では<Sample>.java)側では Component Profile 定義と、各種コンポーネント生成用処理のみが残った形となっております。

- コールバック関数のインターフェース化 C++版 RTコンポーネントにてコールバック関数として定義されていた部分が、Java版 RTコンポーネントではインターフェース化されています。

- ModuleInitProc:コンポーネント起動クラス起動用インターフェース

- RtcNewFunc:RTコンポーネント生成用インターフェース

- RtcDeleteFunc:RTコンポーネント破棄用インターフェース

Java版 RTコンポーネントと C++版コンポーネントの相違点

データポート

OpenRTM-aist-Java では、データの受け渡しを行うためにホルダクラス(DataRefクラス)を追加しています。そのため、データポートの定義および利用方法が以下のように変更されております。

| Java版RTコンポーネント | C++版RT コンポーネント |

| //InPort の定義 protected TimedShort m_in_val; protected DataRef<TimedLong> m_in; protected InPort<TimedLong> m_inIn; //InPort の登録 m_in_val = new TimedLong(); m_in = new DataRef<TimedLong>(m_in_val); m_inIn = new InPort<TimedLong>(“in”,m_in); registerInPort(TimedLong.class,“in”,m_inIn); //InPort からのデータ読み込み m_inIn.read(); 入力データ = m_in.v.data; |

//InPort の定義 TimedShort m_in; InPort<TimedShort> m_inIn; //InPort の登録 m_inIn = new InPort<TimedLong>(“in”,m_in); registerInPort(“in”,m_inIn); //InPort からのデータ読み込み m_inIn.read(); 入力データ = m_in.data; |

| //OutPort の定義 protected TimedFloat m_out_val; protected DataRef<TimedFloat> m_out; protected OutPort<TimedFloat> m_outOut; //OutPort の登録 m_out_val = new TimedFloat(); m_out = new DataRef<TimedFloat>(m_out_val); m_outOut = new OutPort<TimedLong>(“out”,m_out); registerOutPort(TimedLong.class,“out”,m_outOut); //OutPort へのデータの書き出し m_out_val.data = 出力データ; m_outOut.write(); |

//OutPort の定義 TimedFloat m_out; OutPort<TimedFLoat> m_outOut; //OutPort の登録 m_outOut = new OutPort<TimedFloat>(“out”,m_out); registerOutPort(“out”,m_outOut); //OutPort へのデータの書き出し m_out.data = 出力データ; m_outOut.write(); |

データポート使用方法につきましては、「SeqIO」「SimpleIO」のサンプルをご参照ください。

サービスポート

OpenRTM-aist-Java では、サービスポートを使用するための補助変数(<サービス名>Base)を追加しております。このため、サービスポートの定義、利用方法が以下のように変更されております。詳細につきましては、「SimpleService」のサンプルをご覧ください。

| Java版RTコンポーネント | C++版RTコンポーネント |

| //Consumer の定義 protected CorbaPort m_MyServicePort; protected CorbaConsumer<MyService> m_myservice0Base = new CorbaConsumer<MyService>(MyService.class); protected MyService m_myservice0; //Consumer の登録 m_MyServiceRef = new CorbaPort(“MyService”); m_MyServicePort.registerConsumer (“myservice0”,”MyService”,m_myservice0Base); registerPort(m_MyServicePort); //Consumer の利用 m_myservice0 = m_myservice0Base._ptr(); m_myservice0.echo(argv[1]); |

//Consumer の定義 RTC::CorbaPort m_MyServicePort; RTC::CorbaConsumer<MyService> m_myservice0; //Consumer の登録 m_MyServicePort = new RTC::CorbaPort(“MyService”); m_MyServicePort.registerConsumer (“myservice0”,“MyService”, m_myservice0); registerPort(m_MyServicePort); //Consumer の利用 m_myservice0->echo(argv[1].c_str()); |

| //Provider の定義 protected CorbaPort m_MyServicePort; protected MyServiceSVC_impl m_myservice0 = new MyServiceSVC_impl(); //Provider の登録 m_MyServiceRef = new CorbaPort(“MyService”); m_MyServicePort.registerProvider (“myservice0”,”MyService”,m_myservice0); registerPort(m_MyServicePort); |

//Provider の定義 RTC::CorbaPort m_MyServicePort; MyServiceSVC_impl m_myservice0; //Provider の登録 m_MyServicePort = new RTC::CorbaPort(“MyService”); m_MyServicePort.registerProvider (“myservice0”,“MyService”,m_myservice0); registerPort(m_MyServicePort); |

コンフィギュレーション

データポートの場合と同様、コンフィギュレーションを利用する場合もデータの受け渡しのためにホルダクラスを利用しています。このため、コンフィギュレーション・データの定義、利用方法が以下のように変更されております。

| Java版RTコンポーネント | C++版RTコンポーネント |

| //Configuration Variable の定義 protected IntegerHolder m_int_param0 = new IntegerHolder(); protected StringHolder m_str_param0 = new StringHolder(); protected VectorHolder m_vector_param0= new VectorHolder(); //パラメーターのバインド bindParameter(“int_param0”,m_int_param_0,“0”); bindParameter(“str_param0”,m_str_param_0,“sample”); bindParameter(“vector_param0”,m_vector_param_0,“0.0,1.0,2.0,3.0,4.0”); |

//Configuration Variable の定義 int m_int_param0; str::string m_str_param0; str::vector<double> m_vector_param0; //パラメーターのバインド bindParameter(“int_param0”,m_int_param_0,“0”); bindParameter(“str_param0”,m_str_param_0,“sample”); bindParameter(“vector_param0”,m_vector_param_0,“0.0,1.0,2.0,3.0,4.0”); |

コンフィギュレーション・データの使用方法につきましては、「ConfigSample」のサンプルをご参照ください。

OpenRTM-aist-Javaで、コンフィギュレーション・データ用ホルダとして用意しているホルダクラスの種類とデータ型の関係を表3-1に示します。

| データ型 | ホルダ・クラス |

| short | jp.go.aist.rtm.RTC.util.ShortHolder |

| int | jp.go.aist.rtm.RTC.util.IntegerHolder |

| long | jp.go.aist.rtm.RTC.util.LongHolder |

| float | jp.go.aist.rtm.RTC.util.FloatHolder |

| double | jp.go.aist.rtm.RTC.util.DoubleHolder |

| byte | jp.go.aist.rtm.RTC.util.ByteHolder |

| String | jp.go.aist.rtm.RTC.util.StringHolder |

C++版 OpenRTM-aist と同様に、OpenRTM-aist-Java におきましてもユーザーが定義した任意の型についてコンフィグレーション・データ用ホルダを作成することができます。

コンフィギュレーション・データ用のホルダを実装する場合は、jp.go.aist.rtm.RTC.util.ValueHolder の stringFrom メソッドを実装し、implements節に Serializable インターフェースを追加する必要があります。

jp.go.aist.rtm.RTC.util.ValueHolder の stringFrom メソッドは、引数で渡された文字列から対象データ型に変換するためのメソッドです。

コンフィグレーション・データ用ホルダにつきましては「ConfigSample」サンプル内の VectorHolder クラスをご参照ください。

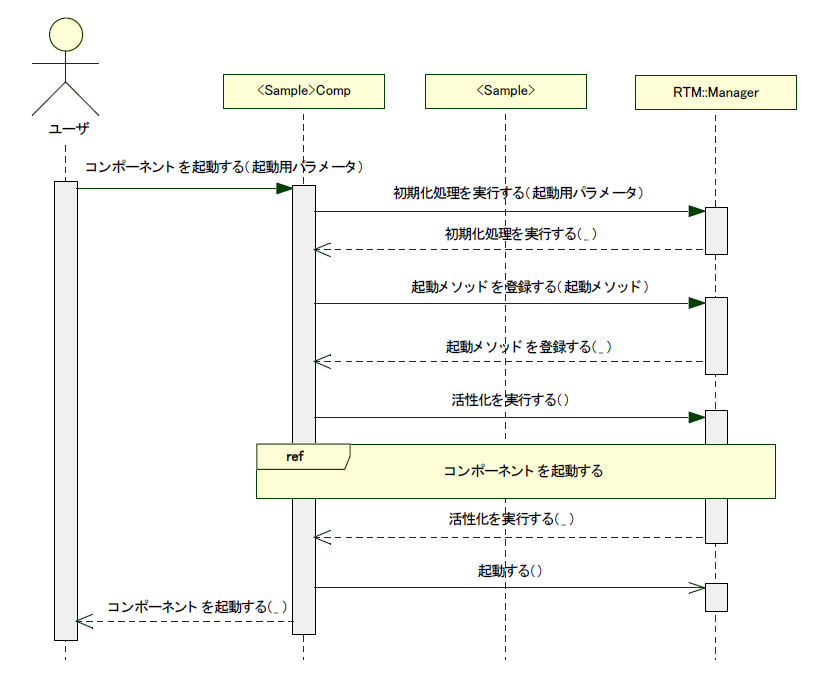

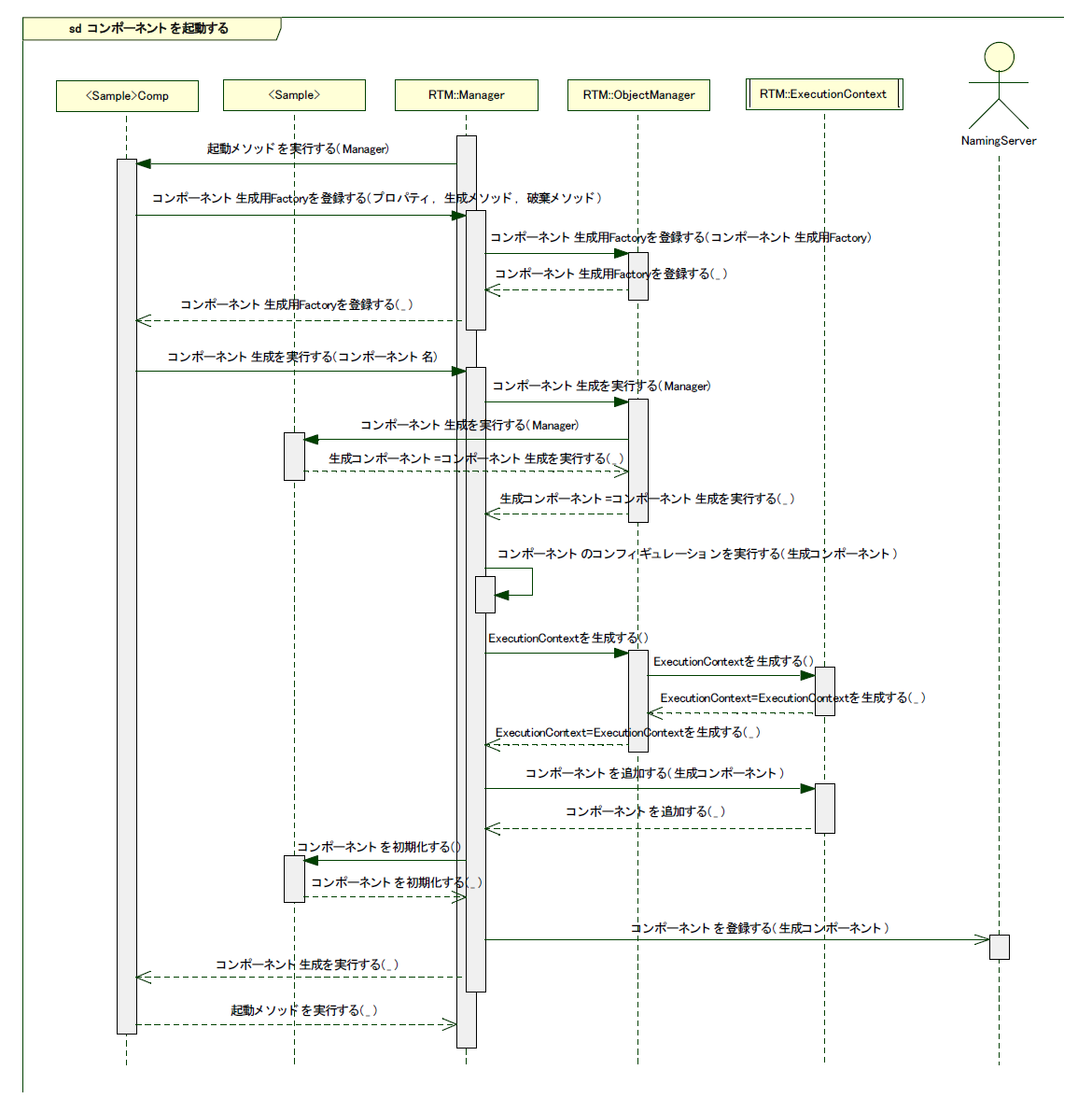

Java版 RTコンポーネントの起動時の振る舞い

C++版 RTコンポーネントの起動時の振る舞いを以下に示します。コンポーネント起動時の振る舞いについては、Java版 RTコンポーネントも基本的には同様な振る舞いとなっておりますが、RTコンポーネント機能の実体が XXXImpl クラスに分離された関係から、コンポーネント生成時、コンポーネント初期化時のメッセージの送信先はXXXクラスへと変更となっております。

IDL用データ型と Java言語データ型の対応関係

CORBA IDL用データ型と Java言語データ型の対応関係を表3-2に示します。

| CORBA IDL | Java言語 |

| short | short |

| long | int |

| float | float |

| double | double |

| long long | long |

| long double | double |

| char | char |

| wchar | char |

| octet | byte |

| unsigned short | short |

| unsigned long | int |

| unsigned long long | long |

| boolean | boolean |

| string | String |

| wstring | String |

| any | org.omg.CORBA.Any |

| void | void |

その他

Tips

Eclipse の自動起動の設定方法について

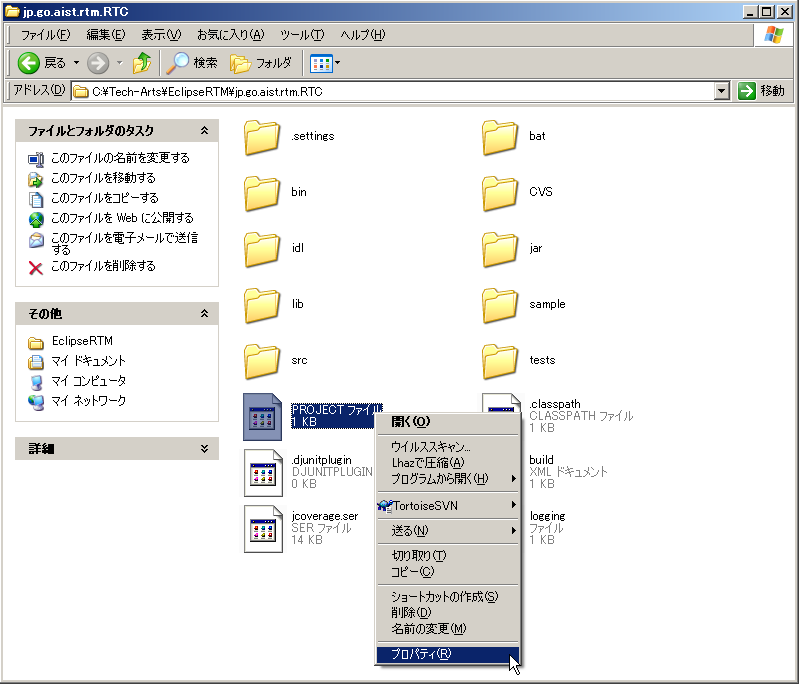

- Windows の場合

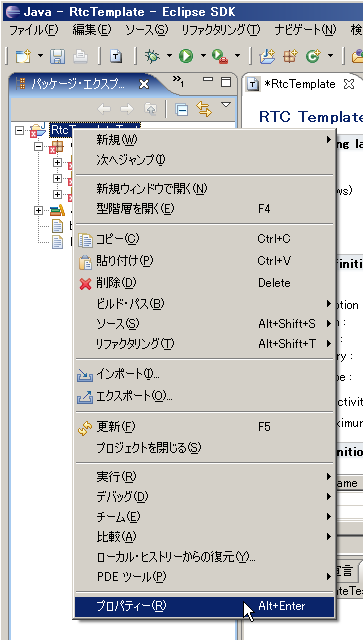

- 1.Eclipse プロジェクトのディレクトリーの中から「.project」ファイルを選択して右クリックします。表示されたコンテキストメニュー内から [プロパティ] を選択します。

※選択する Eclipse プロジェクトは任意のプロジェクトで構いません。

- 1.Eclipse プロジェクトのディレクトリーの中から「.project」ファイルを選択して右クリックします。表示されたコンテキストメニュー内から [プロパティ] を選択します。

- 2.表示された「プロパティ」画面の「全般」タブ内、中段にある「プログラム」行右側の [変更] ボタンをクリックします。

アプリケーションの関連付けの変更

アプリケーションの関連付けの変更

- 3.表示された「ファイルを開くプログラムの選択」画面下側にある [参照] ボタンをクリックします。

Eclipseを選択

Eclipseを選択

- 4.ファイル選択画面が表示されるので、自動起動を行う Eclipse がインストールされているディレクトリー内から「eclipse.exe」を選択します。

- 5.「ファイルを開くプログラムの選択」画面、「プロパティ」 を [OK] ボタンをクリックして閉じます。

::以上の設定を行うことで、「.project」ファイルをダブルクリックすることで指定した Eclipse を自動起動することが可能となります。

|

::※ 複数の Eclipse をインストールしている場合、ダブルクリック動作では上記操作で指定したバージョンの Eclipse が常に起動されますのでご注意ください。

|- ※ ダブルクリックを行ったプロジェクトが、起動対象 Eclipse に設定された workspace 内に含まれない場合、起動された Eclipse のパッケージ・エクスプローラー内に表示されません。この場合は、対象プロジェクトを workspace 内にインポートするか、workspace の設定を変更してください。

--Linuxの場合

data オプションにて workspace を指定して Eclipse を起動することが可能です。> eclipse -data /home/devel/OpenRTM/workspace

- 対象プロジェクトが含まれている workspace を指定してください。

謝辞

- Apache Commons CLI 1.1

This product includes software developed by The Apache Software Foundation (http://www.apache.org/ ).

RTコンポーネント作成(OpenCV編 for RTCB-RC1)

はじめに

ここでは、OpenCV ライブラリを VC9 にて RTコンポーネント化する手順を紹介します。

OpenCVとは

OpenCVとはインテルが開発・公開しているオープンソースのコンピュータービジョン向けライブラリです。

Wikipediaより抜粋。

作成する RTコンポーネント

- Flip コンポーネント: OpenCV ライブラリのうち、cvFlip() 関数を用いて画像の反転を行う RTコンポーネント。

- ObjectTracking コンポーネント: OpenCV ライブラリを使用し、マウスで選択した対象物を追跡するコンポーネント。 追跡中の画像表示、追跡画像を OutPort から出力、追跡対象の移動量を OutPort から出力などの機能を持つ。

OpenCV ライブリの RTコンポーネント化 (Flipコンポーネント)

ここでは、OpenCV ライブラリのうち、画像の反転を行う cvFlip() を VC9 にて RTコンポーネント化します。

以下は、作業の流れです。

- cvFlip 関数について

- コンポーネントの概要

- 動作環境・開発環境

- Flip コンポーネントの雛型の生成

- アクティビティ処理の実装

- コンポーネントの動作確認

cvFlip 関数について

cvFlip 関数は、2次元配列を垂直、水平、または両軸で反転します。

void cvFlip(IplImage* src, IplImage* dst=NULL, int flip_mode=0); #define cvMirror cvFlip src 入力配列 dst 出力配列。もし dst=NULL であれば、src が上書きされます。 flip_mode 配列の反転方法の指定内容: flip_mode = 0: X軸周りでの反転(上下反転) flip_mode > 0: Y軸周りでの反転(左右反転) flip_mode < 0: 両軸周りでの反転(上下左右反転)

コンポーネントの概要

InPort からの入力画像を反転し OutPort から出力するコンポーネント。

反転の対象軸は、RTCのコンフィギュレーション機能を使用して flip_mode という名前のパラメーターで指定します。

flip_mode は、反転したい方向に応じて下記のように指定してください。

- 上下反転したい場合、0

- 左右反転したい場合、1

- 上下左右反転したい場合、-1

作成する RTC の仕様は以下のとおりです。

- InPort

- キャプチャされた画像データ (TimedOctetSeq)

- OutPort

- 反転した画像データ (TimedOctetSeq)

- Configuration

- 反転方法の指定 (int)

※ TimedOctetSeq型は、OpenRTM-aist の BasicDataType.idl にて下記のように定義されているデータ型です。

※ octet型とは、CORBA IDL の基本型で、転送時にいかなるデータ変換も施されないことが保証されている8ビット値です。

struct Time

{

unsigned long sec; // sec

unsigned long nsec; // nano sec

};

struct TimedOctetSeq

{

Time tm;

sequence<octet> data;

};

図1は、それぞれのflip_mode での画像処理のイメージ図です。

動作環境・開発環境

- OS: Windows XP SP2

- コンパイラ: Visual C++ 2008 Express Edition 日本語版

- omniORB: version 4.1.2

- OpenCV: version 1.0

- OpenRTM-aist: version 1.0.0-RC1

- RTSystemEditor 1.0

- RTCBuilder 1.0

Flip コンポーネントの雛型の生成

Flip コンポーネントの雛型の生成は、RTCBuilder を用いて行います。

RTCBuilder の起動

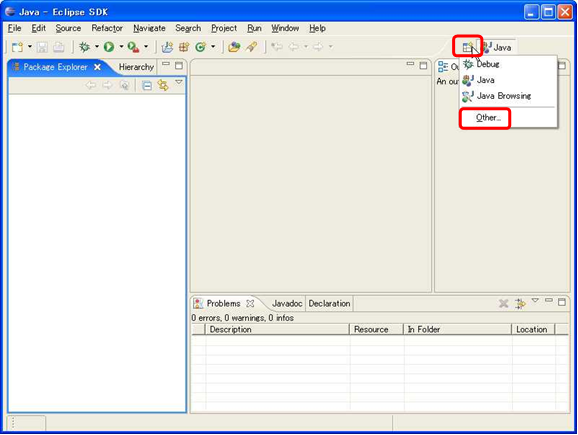

新規ワークスペースを指定して Eclipse を起動すると、以下の「ようこそ」画面が表示されます。 この 「ようこそ」画面の左上の「X」をクリックすると以下の画面が表示されます。

右上の [Open Perspective] ボタンをクリックし、プルダウンの「Other…」を選択します。

「RTC Builder」を選択し、[OK] ボタンをクリックします。

RTCBuilder が起動します。

RTCBuilder 用プロジェクトの作成

まず最初に、RT コンポーネントを作成するための Eclipse プロジェクトを作成します。 画面上部のメニューから[ファイル] > [新規] > [プロジェクト] を選択します。

表示された「新規プロジェクト」画面において、[その他] > [RTC ビルダ] を選択し、[次へ] をクリックします。

「プロジェクト名」欄に作成するプロジェクト名を入力して [完了] をクリックします。

指定した名称のプロジェクトが生成され、パッケージエクスプローラー内に追加されます。

生成したプロジェクト内には、デフォルト値が設定された RTC プロファイル XML(RTC.xml) が自動的に生成されます。

データポートで使用するデータタイプ定義ファイルの在り処の設定

データポートやサービスポートで使用するデータ型が定義された IDL ファイルが置いてある場所を予め設定しておく必要があります。

※ ここでの設定内容は、ワークスペースを変更しない限り有効ですので、プロジェクト毎に設定する必要はありません。

下記の手順にて、データ型が定義されている IDL ファイルの在り処を設定して下さい。

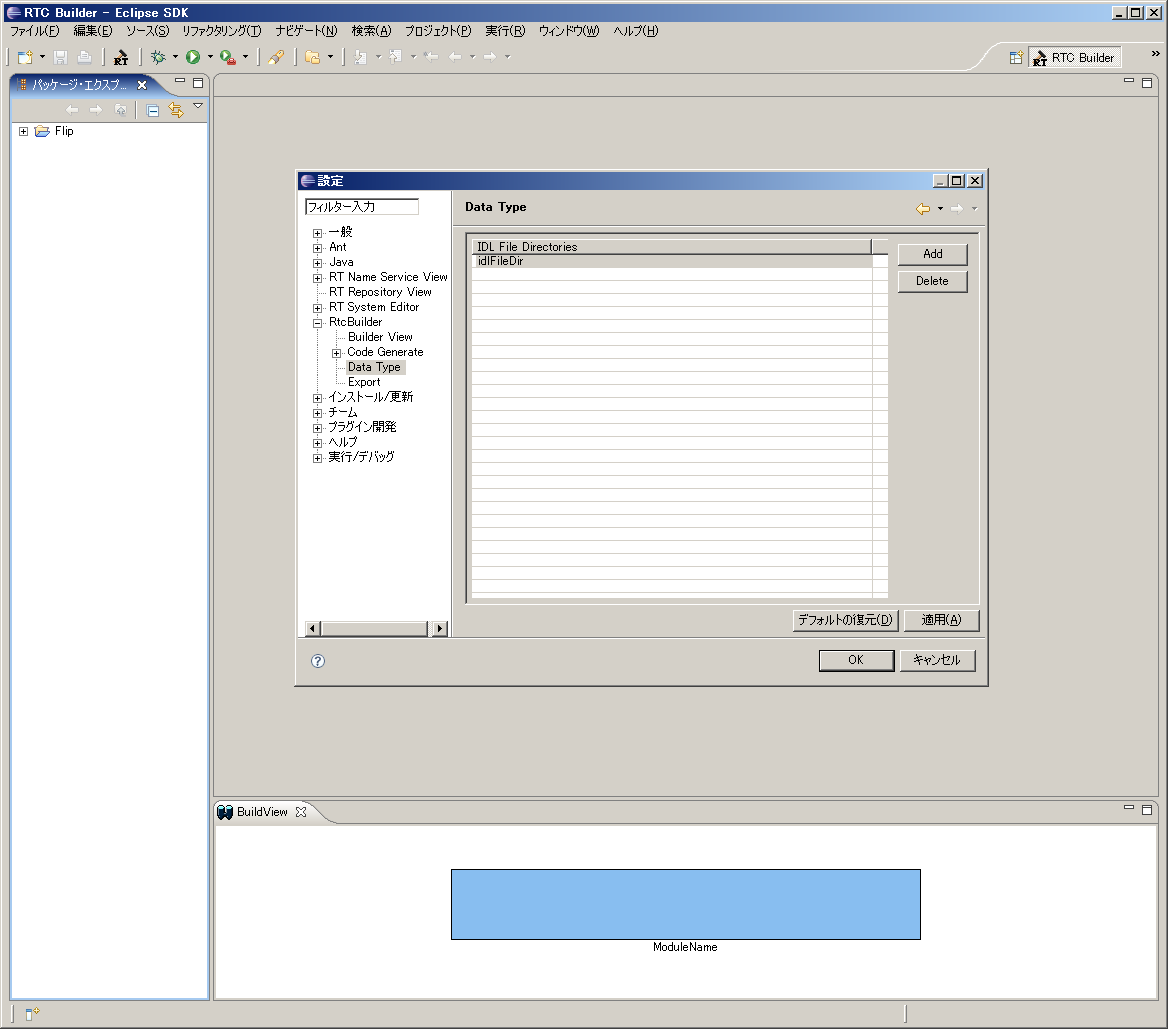

1. メニューバーの [ウィンドウ] > [設定] をクリックし、設定ダイアログを表示させます。

2. [RtcBuilder] > [Data Type] をクリックし、図12の Data Type 入力画面を出します。

3. Data Type入力画面の [Add] ボタンをクリックし、"IDL File Directories"を入力します。

OpenRTM-aist で定義されているデータ型の IDL ファイルはデフォルトでは下記にインストールされます。

C:\Program Files\OpenRTM-aist\1.0\rtm\idl

4. [OK] ボタンをクリックし、設定を終了します。

RTC プロファイルエディタの起動

RTC プロファイルエディタを開くには、ツールバーの [Open New RtcBuilder Editor] ボタンをクリックするか、メニューの [ファイル] > [Open New Builder Editor] を選択します。

コンポーネントのプロファイル情報入力とコードの生成

1. 「基本」タブを選択し、基本情報を入力します。

-Module name: Flip

- Module description: Flip image component

- Module version: 1.0.0

- Module vender: AIST

- Module category: Category

- Component type: STATIC

- Component's activity type: PERIODIC

- Component kind: DataFlowComponent

- Number of maximum instance: 1

- Execution type: PeriodicExecutionContext

- Execution Rate: 1.0

-Output Project: Flip

2. 「アクティビティ」タブを選択し、使用するアクションコールバックを指定します。

Flipコンポーネントでは、onActivated()、onDeactivated()、onExecute() コールバックを使用しますので、 図14のようにon_activated、on_deactivated、on_executeの3つにチェックを入れます。

3. 「データポート」タブを選択し、データポートの情報を入力します。

- InPort Profile:

- Port Name: original_image

- Data Type: TimedOctetSeq

- Var Name: image_orig

- Disp. Position: left

- OutPort Profile:

- Port Name: fliped_image

- Data Type: TimedOctetSeq

- Var Name: image_flip

- Disp. Position: right

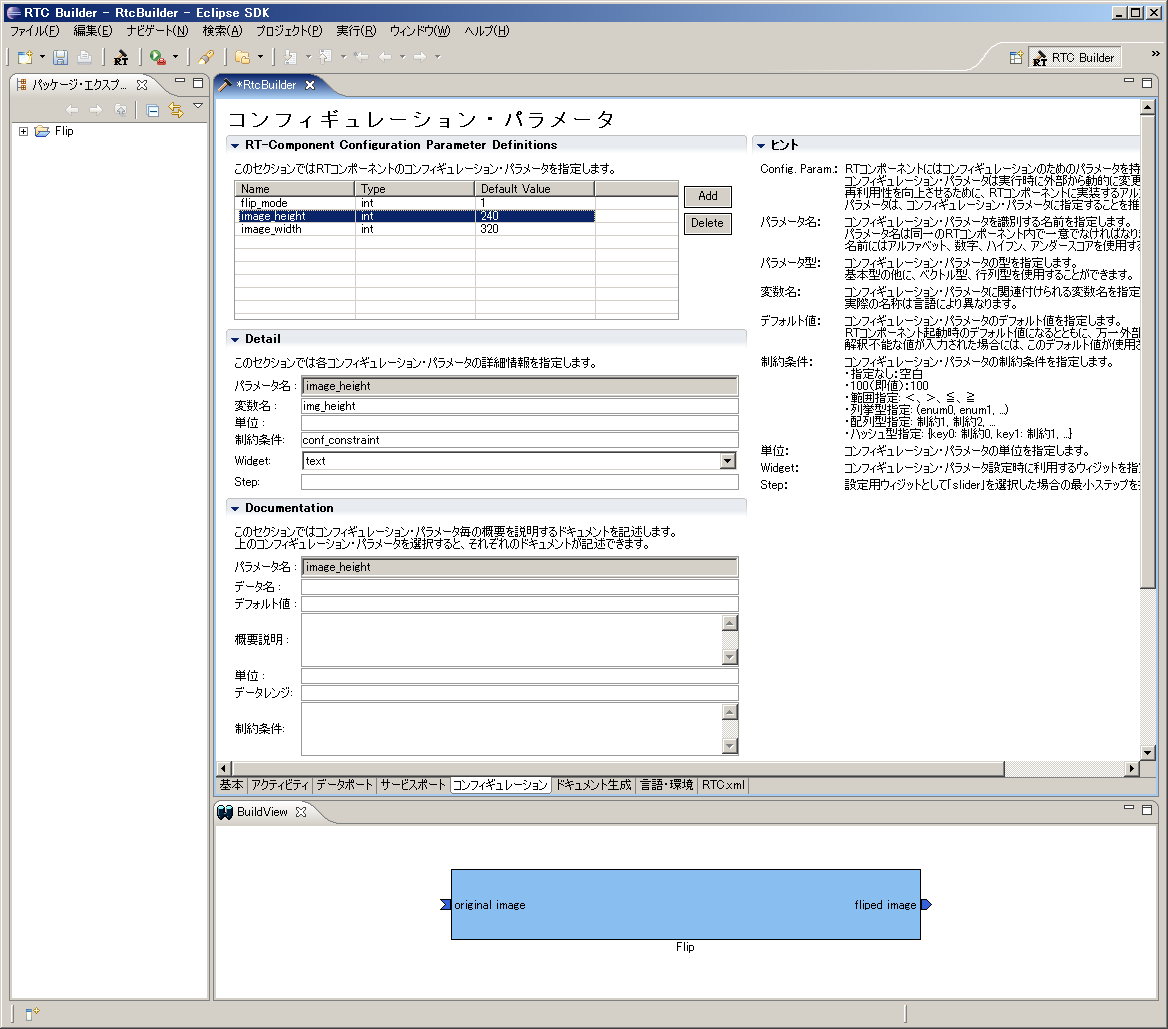

4. 「コンフィギュレーション」タブを選択し、Configuration の変数を入力します。

- flip_mode

- Name: flip_mode

- TYpe: int

- Default Value: 1

- 変数名: flip_mode

- image_height

- Name: image_height

- TYpe: int

- Default Value: 240

- 変数名: img_height

- image_width

- Name: image_width

- TYpe: int

- Default Value: 320

- 変数名: img_width

5. 「言語・環境」タブを選択し、プログラミング言語を選択します。

今回は、C++(言語) を選択します。

6. 「基本」タブにある [コード生成] ボタンをクリックし、コンポーネントの雛型を生成します。

※ 生成されるコード群は、Eclipse 起動時に指定したワークスペースフォルダーの中に生成されます。現在のワークスペースは、[ファイル] > [ワークスペースの切り替え] で確認することができます。

アクティビティ処理の実装

Flip コンポーネントでは、InPort から受け取った画像を画像保存用バッファに保存し、その保存した画像を OpenCV の cvFlip() 関数にて変換します。その後、変換された画像を OutPort から送信します。

onActivated()、onExecute()、onDeactivated()での処理内容を図19に示します。

onExecute() での処理を図20に示します。

OpenCV 用ユーザープロパティシートのコピー

プロパティシートとは、コンパイルに必要な種々のオプション(インクルードパス、ライブラリロードバス、ライブラリ)やマクロを記述した VC の設定ファイルの一種です。 RTCBuilder や rtc-template で生成した VC 用のプロジェクトでは、VC のプロパティシートを使用して各種オプションを与えています。また、ユーザーがオプションを追加できるように、ユーザー定義のプロパティシートもインクルードするようになっています。- rtm_config.vsprop:OpenRTM に関する情報を含むプロパティシート。インストールされている OpenRTM-aist に依存するファイルであるため、copyprops.bat を使用して OpenRTM のシステムディレクトリーからカレントのプロジェクトへコピーします。

- user_config.vsprops:ユーザー定義のプロパティシート。デフォルトでは空っぽです。使い方は、ソースコード:OpenRTM-aist/win32/OpenRTM-aist/example/USBCamera の中に入っている user_config.vsprops (OpenCV 用の設定)を参考にしてください。

以下の内容を user_config.vsprops というファイル名で保存し、Flip フォルダーにコピーしてください。

もしくは、下記より vsprops ファイルをダウンロードし、Flip フォルダーに保存してください。

※ 既にFlipフォルダーには user_config.vsprops ファイルが存在しておりますが、上書きして構いません。

<?xml version="1.0" encoding="shift_jis"?>

<VisualStudioPropertySheet

ProjectType="Visual C++"

Version="8.00"

Name="OpenCV"

>

<Tool

Name="VCCLCompilerTool"

AdditionalIncludeDirectories="$(cv_includes)"

/>

<Tool

Name="VCLinkerTool"

AdditionalLibraryDirectories="$(cv_libdir)"

/>

<UserMacro

Name="user_lib"

Value="$(cv_lib)"

/>

<UserMacro

Name="user_libd"

Value="$(cv_libd)"

/>

<UserMacro

Name="cv_root"

Value="C:\Program Files\OpenCV"

/>

<UserMacro

Name="cv_includes"

Value=""$(cv_root)\cv\include";"$(cv_root)\cvaux\include";"$(cv_root)\cxcore\include";"$(cv_root)\otherlibs\highgui";"$(cv_root)\otherlibs\cvcam\include""

/>

<UserMacro

Name="cv_libdir"

Value=""$(cv_root)\lib""

/>

<UserMacro

Name="cv_bin"

Value="$(cv_root)\bin"

/>

<UserMacro

Name="cv_lib"

Value="cv.lib cvcam.lib highgui.lib cxcore.lib"

/>

<UserMacro

Name="cv_libd"

Value="cv.lib cvcam.lib highgui.lib cxcore.lib"

/>

</VisualStudioPropertySheet>copyprops.bat の実行

copyprops.bat というファイルを実行することで、rtm_config.vsprops というファイルがコピーされます。

rtm_config.vsprops ファイルは、RTコンポーネントを VC++ でビルドするために必要なインクルードパスやリンクするライブラリ等が記述されたファイルです。

ヘッダファイルの編集

- OpenCV のライブラリを使用するため、OpenCV のインクルードファイルをインクルードします。

//OpenCV 用インクルードファイルのインクルード #include<cv.h> #include<cxcore.h> #include<highgui.h>

- この cvFlip コンポーネントでは、画像領域の確保、Flip 処理、確保した画像領域の解放のそれぞれの処理を行います。これらの処理は、それぞれ onActivated()、onDeactivated()、onExecute() のコールバック関数で呼ぶことにしますので、これら3つの関数のコメントアウトを解除します。

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);- 反転した画像の保存用にメンバー変数を追加します。

IplImage* m_image_buff; IplImage* m_flip_image_buff;

ソースファイルの編集

下記のように、onActivated()、onDeactivated()、onExecute()を実装します。

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの確保

m_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

m_flip_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_image_buff);

cvReleaseImage(&m_flip_image_buff);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_image_origIn.isNew()) {

// InPortデータの読み込み

m_image_origIn.read();

// InPortの画像データをIplImageのimageDataにコピー

memcpy(m_image_buff->imageData,(void *)&(m_image_orig.data[0]),m_image_orig.data.length());

// InPortからの画像データを反転する。 m_flip_mode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_image_buff, m_flip_image_buff, m_flip_mode);

// 画像データのサイズ取得

int len = m_flip_image_buff->nChannels * m_flip_image_buff->width * m_flip_image_buff->height;

m_image_flip.data.length(len);

// 反転した画像データを OutPort にコピー

memcpy((void *)&(m_image_flip.data[0]),m_flip_image_buff->imageData,len);

// 反転した画像データを OutPort から出力する。

m_image_flipOut.write();

}

return RTC::RTC_OK;

}ビルドの実行

図21のようにし、コンポーネントのビルドを行います。

Flip コンポーネントの動作確認

ここでは、OpenRTM-aist のサンプルコンポーネントに含まれている USBCameraAqcuireComp コンポーネントと、USBCameraMonitorCom コンポーネント、それと、Flip コンポーネントを接続し動作確認を行います。

NameService の起動

omniORB のネームサービスを起動します。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [C++] > [examples] をクリックし、[Start Naming Service] をクリックしてください。

rtc.conf の作成

RTコンポーネントでは、ネームサーバーのアドレスやネームサーバーへの登録フォーマットなどの情報を rtc.conf というファイルで指定する必要があります。

下記の内容を rtc.conf というファイル名で保存し、Flip\FlipComp\Debug (もしくは、Release) フォルダーに置いてください。

corba.nameservers: localhost naming.formats: %n.rtc

Flip コンポーネントの起動

Flip コンポーネントを起動します。

先程 rtc.conf ファイルを置いたフォルダーにある、FlipComp.exe ファイルを実行してください。

USBCameraAqcuire、USBCameraMonitor コンポーネントの起動

USB カメラのキャプチャ画像を OutPort から出力する USBCameraAqcuireComp コンポーネントと、InPort で受け取った画像を画面に表示する USBCameraMonitorCOmp コンポーネントを起動します。

これら2つのコンポーネントは、下記の手順にて起動できます。

[スタート] > [すべてのプログラム] > [OpenRTM-aist] > [C++] > [examples] をクリックし、「USBCameraAqcuireComp」と「USBCameraMonitorCOmp」をそれぞれクリックして実行します。

コンポーネントの接続

図22のように、RTSystemEditor にて USBCameraAqcuireComp,Flip、USBCameraMonitorComp コンポーネントを接続します。

Flip コンポーネントのコンフィギュレーションの変更

図23のようにコンフィギュレーションビューにてコンフィギュレーションを変更することができます。

ELECOM製 の UCAM-DLM 130HWH (白いUSBカメラ) を使用の場合は、image_height と image_width パラメーターを下記のように変更してください。

image_height : 480 image_width : 640

また、ELECOM製 の UCAM-DLM 130HWH (白いUSBカメラ) を使用の場合は、USBCameraMonitor の image_height,image_width パラメーターも 上記のように変更する必要があります。

コンポーネントの Activate

RTSystemEditor の上部にあります「ALL」というアイコンをクリックし、全てのコンポーネントをアクティベートします。

正常にアクティベートされた場合、図24のように黄緑色でコンポーネントが表示されます。

動作確認

Flip コンポーネントのコンフィギュレーションパラメーター「flip_mode」を「0」や「-1」などに変更し、画像の反転が行われるかを確認してください。

Flip コンポーネントのソースファイル

// -*- C++ -*-

/*!

* @file Flip.cpp

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#include "Flip.h"

// Module specification

static const char* flip_spec[] =

{

"implementation_id", "Flip",

"type_name", "Flip",

"description", "Flip image component",

"version", "1.0.0",

"vendor", "AIST",

"category", "Category",

"activity_type", "PERIODIC",

"kind", "DataFlowComponent",

"max_instance", "1",

"language", "C++",

"lang_type", "compile",

"exec_cxt.periodic.rate", "1.0",

// Configuration variables

"conf.default.flip_mode", "1",

"conf.default.image_height", "240",

"conf.default.image_width", "320",

""

};

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip::Flip(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

m_image_origIn("original_image", m_image_orig),

m_image_flipOut("fliped_image", m_image_flip),

dummy(0),

m_image_buff(0),

m_flip_image_buff(0)

{

// Registration: InPort/OutPort/Service

// Set InPort buffers

registerInPort("original_image", m_image_origIn);

// Set OutPort buffer

registerOutPort("fliped_image", m_image_flipOut);

}

/*!

* @brief destructor

*/

Flip::~Flip()

{

}

RTC::ReturnCode_t Flip::onInitialize()

{

// Bind variables and configuration variable

bindParameter("flip_mode", m_flip_mode, "1");

bindParameter("image_height", m_img_height, "240");

bindParameter("image_width", m_img_width, "320");

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onActivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの確保

m_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

m_flip_image_buff = cvCreateImage(cvSize(m_img_width, m_img_height), IPL_DEPTH_8U, 3);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onDeactivated(RTC::UniqueId ec_id)

{

// イメージ用メモリーの解放

cvReleaseImage(&m_image_buff);

cvReleaseImage(&m_flip_image_buff);

return RTC::RTC_OK;

}

RTC::ReturnCode_t Flip::onExecute(RTC::UniqueId ec_id)

{

// 新しいデータのチェック

if (m_image_origIn.isNew()) {

// InPort データの読み込み

m_image_origIn.read();

// InPortの 画像データを IplImage の imageData にコピー

memcpy(m_image_buff->imageData,(void *)&(m_image_orig.data[0]),m_image_orig.data.length());

// InPortからの画像データを反転する。 m_flip_mode 0: X軸周り, 1: Y軸周り, -1: 両方の軸周り

cvFlip(m_image_buff, m_flip_image_buff, m_flip_mode);

// 画像データのサイズ取得

int len = m_flip_image_buff->nChannels * m_flip_image_buff->width * m_flip_image_buff->height;

m_image_flip.data.length(len);

// 反転した画像データを OutPort にコピー

memcpy((void *)&(m_image_flip.data[0]),m_flip_image_buff->imageData,len);

// 反転した画像データを OutPort から出力する。

m_image_flipOut.write();

}

return RTC::RTC_OK;

}

extern "C"

{

void FlipInit(RTC::Manager* manager)

{

RTC::Properties profile(flip_spec);

manager->registerFactory(profile,

RTC::Create<Flip>,

RTC::Delete<Flip>);

}

};Flip コンポーネントのヘッダファイル

// -*- C++ -*-

/*!

* @file Flip.h

* @brief Flip image component

* @date $Date$

*

* $Id$

*/

#ifndef FLIP_H

#define FLIP_H

#include <rtm/Manager.h>

#include <rtm/DataFlowComponentBase.h>

#include <rtm/CorbaPort.h>

#include <rtm/DataInPort.h>

#include <rtm/DataOutPort.h>

#include <rtm/idl/BasicDataTypeSkel.h>

// (1) OpenCV 用インクルードファイルのインクルード

#include<cv.h>

#include<cxcore.h>

#include<highgui.h>

using namespace RTC;

/*!

* @class Flip

* @brief Flip image component

*

*/

class Flip

: public RTC::DataFlowComponentBase

{

public:

/*!

* @brief constructor

* @param manager Maneger Object

*/

Flip(RTC::Manager* manager);

/*!

* @brief destructor

*/

~Flip();

/*!

*

* The initialize action (on CREATED->ALIVE transition)

* formaer rtc_init_entry()

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onInitialize();

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

protected:

// Configuration variable declaration

/*!

* flip_mode = 0: flipping around x-axis

* flip_mode > 1: flipping around y-axis

* flip_mode < 0: flipping around both axises

* - Name: flip_mode flip_mode

* - DefaultValue: 1

*/

int m_flip_mode;

/*!

*

* - Name: m_img_height

* - DefaultValue: 240

* - 画像の高さ

*/

int m_img_height;

/*!

*

* - Name: m_img_width

* - DefaultValue: 320

* - 画像の幅

*/

int m_img_width;

// DataInPort declaration

TimedOctetSeq m_image_orig;

InPort<TimedOctetSeq> m_image_origIn;

// DataOutPort declaration

TimedOctetSeq m_image_flip;

OutPort<TimedOctetSeq> m_image_flipOut;

private:

int dummy;

IplImage* m_image_buff;

IplImage* m_flip_image_buff;

};

extern "C"

{

void FlipInit(RTC::Manager* manager);

};

#endif // FLIP_HFlip コンポーネントのビルド済みパッケージ

ビルド済みパッケージを下記からダウンロードできます。

拡張子を"zip_"としてますので、"zip"にリネームしてから解凍して下さい。

おまけ(物体追跡コンポーネント)

OpenCVのライブラリを用いて、物体追跡を行うコンポーネントです。

コンポーネントの概要

InPort からの画像データを表示し、マウスで選択されたオブジェクトを追跡するコンポーネント。

OutPort からは、物体追跡画像と、マウスで選択した位置からの移動量を出力する。

画像のサイズと、明度、彩度はコンフィグレーションにて変更可能。

作成する RTC の仕様は以下のとおりです。

- InPort

- キャプチャされた画像データ (TimedOctetSeq)

- OutPort

- 物体追跡画像データ (TimedOctetSeq)

- OutPort

- マウスで選択したオブジェクトの中心位置の移動量 (TimedFloatSeq)

- Configuration

- 明度の最大値(int) default: 256

- 明度の最小値(int) default: 10

- 彩度の最小値(int) default: 30

- 画像の高さ(int) default: 240

- 画像の幅(int) default: 320

RTCBuilder でのプロファイル情報入力内容

基本情報

- Module name: ObjectTracking

- Module description: Object tracking component

- OutputProject: ObjectTracking

データポート

- InPort Profile:

- Port Name: in_image

- Data Type: TimedOctetSeq

- Var Name: in_image

- Disp. Position: left

- OutPort Profile:

- Port Name: tracing_image

- Data Type: TimedOctetSeq

- Var Name: tracking_image

- Disp. Position: right

- OutPort Profile:

- Port Name: displacement

- Data Type: TimedFloatSeq

- Var Name: displacement

- Disp. Position: right

コンフィギュレーションパラメーター

- brightness_max

- Name: brightness_max

- TYpe: int

- Default Value: 256

- 変数名: b_max

- brightness_min

- Name: brightness_min

- TYpe: int

- Default Value: 10

- 変数名: b_min

- saturation_min

- Name: saturation_min

- TYpe: int

- Default Value: 30

- 変数名: s_min

- image_height

- Name: image_height

- TYpe: int

- Default Value: 240

- 変数名: img_height

- image_width

- Name: image_width

- TYpe: int

- Default Value: 320

- 変数名: img_width

ObjectTracking コンポーネントのソースファイル

// -*- C++ -*-

/*!

* @file ObjectTracking.cpp

* @brief Object tracking component

* @date $Date$

*

* $Id$

*/

#include "ObjectTracking.h"

#define HIST_RANGE_MAX 180.0

#define HIST_RANGE_MIN 0.0

// 入力画像用 IplImage

IplImage* g_image;

// CamShift トラッキング用変数

CvPoint g_origin;

CvRect g_selection; //

// 初期追跡領域の設定判別フラグ値 (0: 設定なし, 1: 設定あり)

int g_select_object;

// トラッキングの開始/停止用フラグ値 (0: 停止, -1: 開始, 1: トラッキング中)

int g_track_object;

// オブジェクト選択判定用フラグ(0: 1以外 1: 選択された直後)

int g_selected_flag;

// 選択された範囲の中心座標

float g_selected_x;

float g_selected_y;

// Module specification

static const char* objecttracking_spec[] =

{

"implementation_id", "ObjectTracking",

"type_name", "ObjectTracking",

"description", "Object tracking component",

"version", "1.0.0",

"vendor", "AIST",

"category", "Category",

"activity_type", "PERIODIC",

"kind", "DataFlowComponent",

"max_instance", "1",

"language", "C++",

"lang_type", "compile",

"exec_cxt.periodic.rate", "1.0",

// Configuration variables

"conf.default.brightness_max", "256",

"conf.default.brightness_min", "10",

"conf.default.saturation_min", "30",

"conf.default.image_height", "240",

"conf.default.image_width", "320",

""

};

/*!

* @brief constructor

* @param manager Maneger Object

*/

ObjectTracking::ObjectTracking(RTC::Manager* manager)

: RTC::DataFlowComponentBase(manager),

m_in_imageIn("in_image", m_in_image),

m_tracking_imageOut("tracing_image", m_tracking_image),

m_displacementOut("displacement", m_displacement),

dummy(0),

m_hsv(0), m_hue(0), m_mask(0), m_backproject(0),

m_hist(0), m_backproject_mode(0),m_hdims(16),

m_init_flag(0)

{

// Registration: InPort/OutPort/Service

// Set InPort buffers

registerInPort("in_image", m_in_imageIn);

// Set OutPort buffer

registerOutPort("tracing_image", m_tracking_imageOut);

registerOutPort("displacement", m_displacementOut);

m_hranges_arr[0] = HIST_RANGE_MIN;

m_hranges_arr[1] = HIST_RANGE_MAX;

m_hranges = m_hranges_arr;

}

/*!

* @brief destructor

*/

ObjectTracking::~ObjectTracking()

{

}

RTC::ReturnCode_t ObjectTracking::onInitialize()

{

// Bind variables and configuration variable

bindParameter("brightness_max", m_b_max, "256");

bindParameter("brightness_min", m_b_min, "10");

bindParameter("saturation_min", m_s_min, "30");

bindParameter("image_height", m_img_height, "240");

bindParameter("image_width", m_img_width, "320");

m_displacement.data.length(2);

return RTC::RTC_OK;

}

RTC::ReturnCode_t ObjectTracking::onActivated(RTC::UniqueId ec_id)

{

m_init_flag = 0;

// ウインドウを生成する

cvNamedWindow( "ObjectTracking", 1 );

// マウス操作時のコールバック処理の登録

cvSetMouseCallback( "ObjectTracking", on_mouse, 0 );

g_selected_flag = 0;

g_selected_x = 0.0;;

g_selected_y = 0.0;;

return RTC::RTC_OK;

}

RTC::ReturnCode_t ObjectTracking::onDeactivated(RTC::UniqueId ec_id)

{

if (m_init_flag) {

// メモリーを解放する

cvReleaseImage(&g_image);

cvReleaseImage(&m_hsv);

cvReleaseImage(&m_hue);

cvReleaseImage(&m_mask);

cvReleaseImage(&m_backproject);

}

// ウインドウを破棄する

cvDestroyWindow("ObjectTracking");

m_init_flag = 0;

return RTC::RTC_OK;

}

RTC::ReturnCode_t ObjectTracking::onExecute(RTC::UniqueId ec_id)

{

if (m_in_imageIn.isNew()) {

m_in_imageIn.read();

if(!m_init_flag) allocateBuffers();

memcpy(g_image->imageData,(void *)&(m_in_image.data[0]),m_in_image.data.length());

cvShowImage("ObjectTracking", g_image);

// キャプチャされた画像を HSV 表色系に変換して hsv に格納

cvCvtColor( g_image, m_hsv, CV_BGR2HSV );

// g_track_objectフラグが0以下なら、以下の処理を行う

if( g_track_object )

{

cvInRangeS( m_hsv, cvScalar(HIST_RANGE_MIN,m_s_min,MIN(m_b_min,m_b_max),0),

cvScalar(HIST_RANGE_MAX,256,MAX(m_b_min,m_b_max),0), m_mask );

cvSplit( m_hsv, m_hue, 0, 0, 0 );

if( g_track_object < 0 ) calcHistogram();

// バックプロジェクションを計算する

cvCalcBackProject( &m_hue, m_backproject, m_hist );

// backProjectionのうち、マスクが1であるとされた部分のみ残す

cvAnd( m_backproject, m_mask, m_backproject, 0 );

// CamShift法による領域追跡を実行する

cvCamShift( m_backproject, m_track_window,

cvTermCriteria( CV_TERMCRIT_EPS | CV_TERMCRIT_ITER, 10, 1 ),

&m_track_comp, &m_track_box );

m_track_window = m_track_comp.rect;

if( m_backproject_mode )

cvCvtColor( m_backproject, g_image, CV_GRAY2BGR );

if( g_image->origin )

m_track_box.angle = -m_track_box.angle;

cvEllipseBox( g_image, m_track_box, CV_RGB(255,0,0), 3, CV_AA, 0 );

// マウスで選択された領域の中心座標を保存

if (g_selected_flag) {

g_selected_x = m_track_box.center.x;

g_selected_y = m_track_box.center.y;

g_selected_flag = 0;

}

// マウスで選択された位置からの移動量をOutPortから出力

m_displacement.data[0] = m_track_box.center.x - g_selected_x;

m_displacement.data[1] = -(m_track_box.center.y - g_selected_y);

m_displacementOut.write();

}

// マウスで選択中の初期追跡領域の色を反転させる

if( g_select_object && g_selection.width > 0 && g_selection.height > 0 )

{

cvSetImageROI( g_image, g_selection );

cvXorS( g_image, cvScalarAll(255), g_image, 0 );

cvResetImageROI( g_image );

}

// 画像を表示する

cvShowImage( "ObjectTracking", g_image );

// 画像をOutPortから出力する

int len = g_image->nChannels * g_image->width * g_image->height;

m_tracking_image.data.length(len);

memcpy((void *)&(m_tracking_image.data[0]),g_image->imageData,len);

m_tracking_imageOut.write();

// キー入力を待ち、押されたキーによって処理を分岐させる

int c = cvWaitKey(10);

// while無限ループから脱出(プログラムを終了)

if( (char) c == 27 ) {

this->exit();

}

}

return RTC::RTC_OK;

}

/*!

* 全てのイメージ用メモリーの確保

*/

void ObjectTracking::allocateBuffers() {

g_image = cvCreateImage( cvSize(m_img_width,m_img_height),8, 3 );

m_hsv = cvCreateImage( cvSize(m_img_width,m_img_height),8, 3 );

m_hue = cvCreateImage( cvSize(m_img_width,m_img_height),8, 1 );

m_mask = cvCreateImage( cvSize(m_img_width,m_img_height),8, 1 );

m_backproject = cvCreateImage( cvSize(m_img_width,m_img_height),8, 1 );

m_hist = cvCreateHist( 1, &m_hdims, CV_HIST_ARRAY, &m_hranges, 1 );

m_init_flag = 1;

}

/*!

* ヒストグラムの計算

*/

void ObjectTracking::calcHistogram() {

float max_val = 0.f;

cvSetImageROI( m_hue, g_selection );

cvSetImageROI( m_mask, g_selection );

// ヒストグラムを計算し、最大値を求める

cvCalcHist( &m_hue, m_hist, 0, m_mask );

cvGetMinMaxHistValue( m_hist, 0, &max_val, 0, 0 );

// ヒストグラムの縦軸(頻度)を0-255のダイナミックレンジに正規化

cvConvertScale( m_hist->bins, m_hist->bins, max_val ? 255. / max_val : 0., 0 );

// hue,mask画像に設定された ROI をリセット

cvResetImageROI( m_hue );

cvResetImageROI( m_mask );

m_track_window = g_selection;

// track_object をトラッキング中にする

g_track_object = 1;

}

extern "C"

{

void ObjectTrackingInit(RTC::Manager* manager)

{

RTC::Properties profile(objecttracking_spec);

manager->registerFactory(profile,

RTC::Create<ObjectTracking>,

RTC::Delete<ObjectTracking>);

}

//

// マウスドラッグによって初期追跡領域を指定する

//

// 引数:

// event : マウス左ボタンの状態

// x : マウスが現在ポイントしているx座標

// y : マウスが現在ポイントしているy座標

// flags : 本プログラムでは未使用

// param : 本プログラムでは未使用

//

void on_mouse( int event, int x, int y, int flags, void* param )

{

// 画像が取得されていなければ、処理を行わない

if( !g_image )

return;

// 原点の位置に応じてyの値を反転(画像の反転ではない)

if( g_image->origin )

y = g_image->height - y;

// マウスの左ボタンが押されていれば以下の処理を行う

if( g_select_object )

{

g_selection.x = MIN(x,g_origin.x);

g_selection.y = MIN(y,g_origin.y);

g_selection.width = g_selection.x + CV_IABS(x - g_origin.x);

g_selection.height = g_selection.y + CV_IABS(y - g_origin.y);

g_selection.x = MAX( g_selection.x, 0 );

g_selection.y = MAX( g_selection.y, 0 );

g_selection.width = MIN( g_selection.width, g_image->width );

g_selection.height = MIN( g_selection.height, g_image->height );

g_selection.width -= g_selection.x;

g_selection.height -= g_selection.y;

}

// マウスの左ボタンの状態によって処理を分岐

switch( event )

{

case CV_EVENT_LBUTTONDOWN:

// マウスの左ボタンが押されたのであれば、

// 原点および選択された領域を設定

g_origin = cvPoint(x,y);

g_selection = cvRect(x,y,0,0);

g_select_object = 1;

break;

case CV_EVENT_LBUTTONUP:

// マウスの左ボタンが離されたとき、width と height がどちらも正であれば、

// g_track_objectフラグを開始フラグにする

g_select_object = 0;

if( g_selection.width > 0 && g_selection.height > 0 ) {

g_track_object = -1;

g_selected_flag = 1;

}

break;

}

}

};ObjectTracking コンポーネントのヘッダファイル

// -*- C++ -*-

/*!

* @file ObjectTracking.h

* @brief Object tracking component

* @date $Date$

*

* $Id$

*/

#ifndef OBJECTTRACKING_H

#define OBJECTTRACKING_H

#include <rtm/Manager.h>

#include <rtm/DataFlowComponentBase.h>

#include <rtm/CorbaPort.h>

#include <rtm/DataInPort.h>

#include <rtm/DataOutPort.h>

#include <rtm/idl/BasicDataTypeSkel.h>

#include <cv.h>

#include <highgui.h>

#include <stdio.h>

#include <ctype.h>

using namespace RTC;

/*!

* @class ObjectTracking

* @brief Object tracking component

*

*/

class ObjectTracking

: public RTC::DataFlowComponentBase

{

public:

/*!

* @brief constructor

* @param manager Maneger Object

*/

ObjectTracking(RTC::Manager* manager);

/*!

* @brief destructor

*/

~ObjectTracking();

/*!

*

* The initialize action (on CREATED->ALIVE transition)

* formaer rtc_init_entry()

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onInitialize();

/***

*

* The activated action (Active state entry action)

* former rtc_active_entry()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onActivated(RTC::UniqueId ec_id);

/***

*

* The deactivated action (Active state exit action)

* former rtc_active_exit()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onDeactivated(RTC::UniqueId ec_id);

/***

*

* The execution action that is invoked periodically

* former rtc_active_do()

*

* @param ec_id target ExecutionContext Id

*

* @return RTC::ReturnCode_t

*

*

*/

virtual RTC::ReturnCode_t onExecute(RTC::UniqueId ec_id);

/*!

* 入力された1つの色相値を RGB に変換する